Sönen ve taşan gradyanlar

PyTorch ile Orta Düzey Deep Learning

Michal Oleszak

Machine Learning Engineer

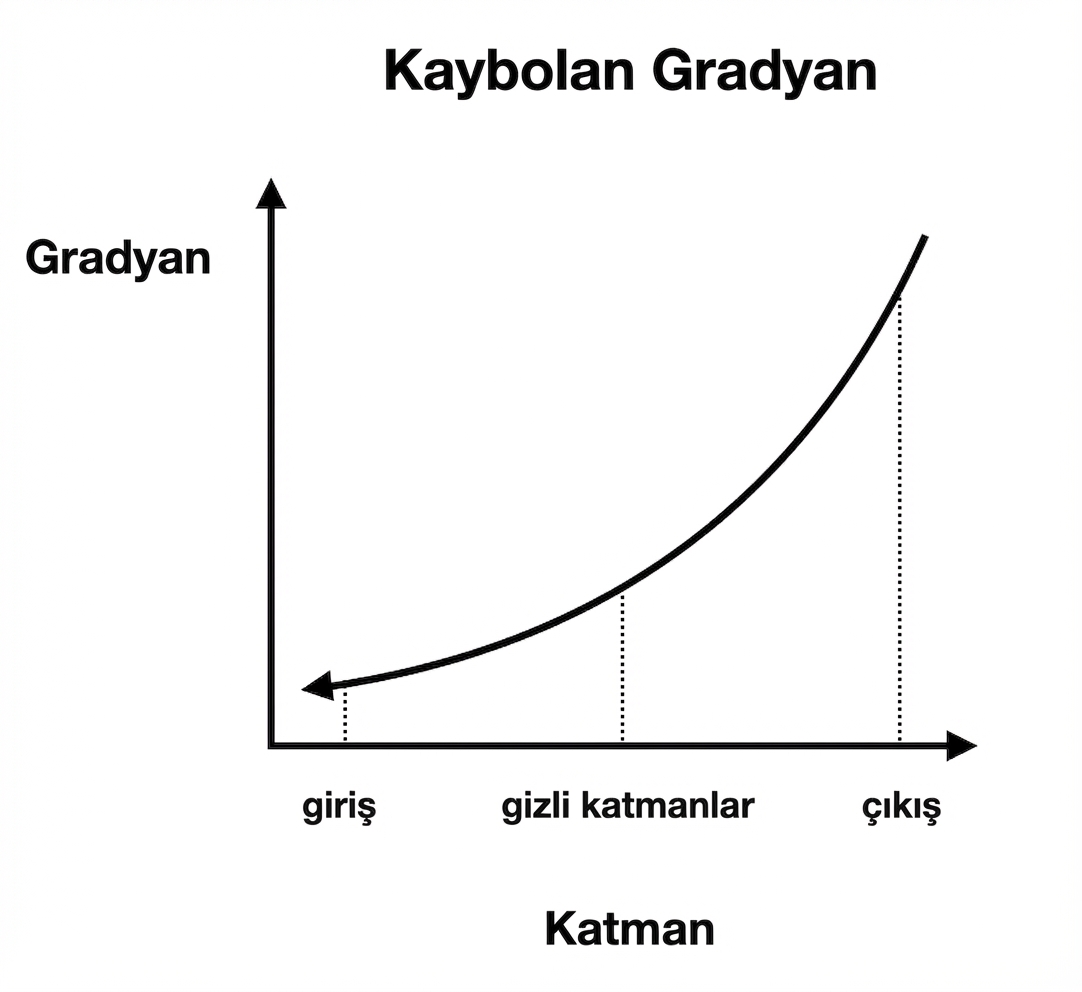

Sönen gradyanlar

- Geri yayılımda gradyanlar giderek küçülür

- Erken katmanlar küçük parametre güncellemeleri alır

- Model öğrenemez

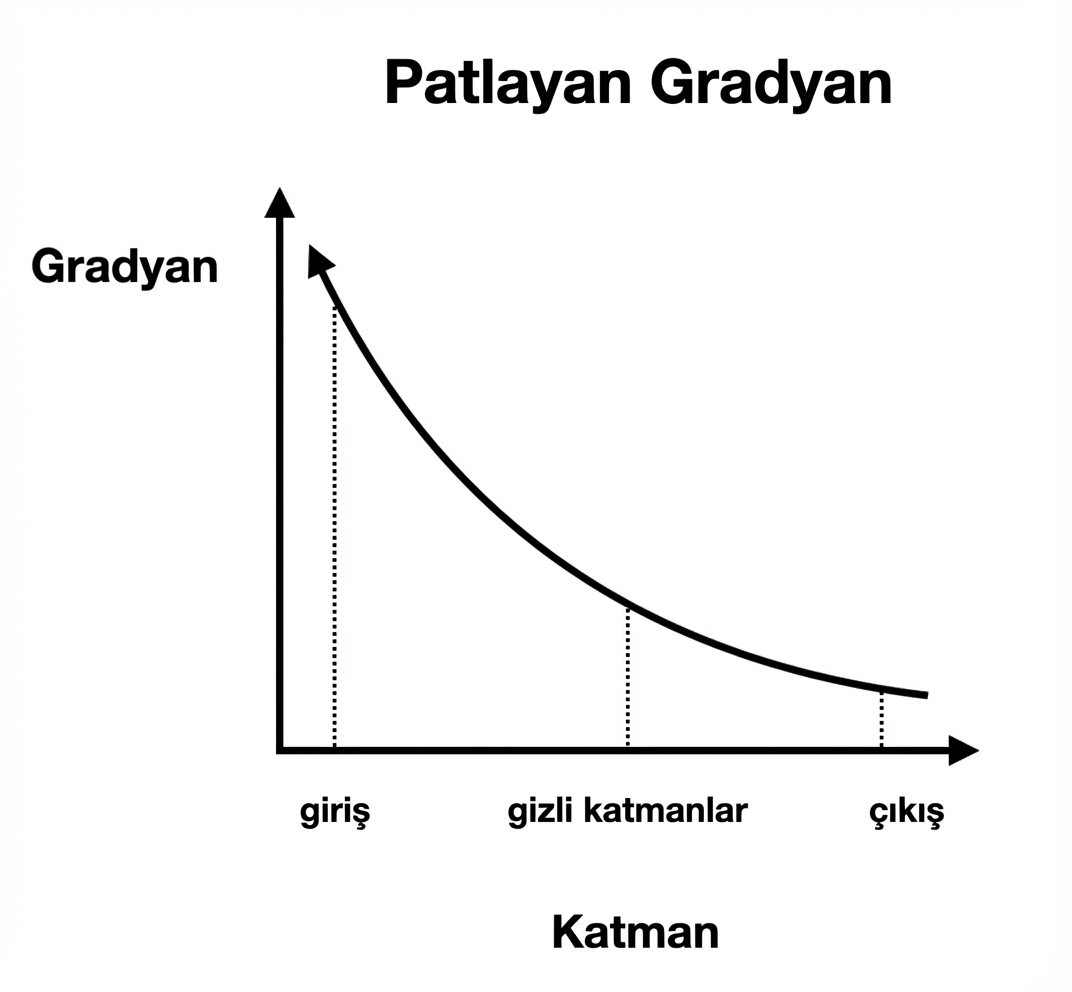

Taşan gradyanlar

- Gradyanlar giderek büyür

- Parametre güncellemeleri aşırı büyüktür

- Eğitim ıraksar

Dengesiz gradyanlara çözüm

- Doğru ağırlık başlatma

- Uygun aktivasyonlar

- Batch normalization

Ağırlık başlatma

layer = nn.Linear(8, 1)

print(layer.weight)

Parameter containing:

tensor([[-0.0195, 0.0992, 0.0391, 0.0212,

-0.3386, -0.1892, -0.3170, 0.2148]])

Ağırlık başlatma

İyi başlangıç şunları sağlar:

- Katman girdi varyansı = katman çıktı varyansı

- Katmandan önce/sonra gradyan varyansı aynı

Bunu sağlama yöntemi aktivasyona bağlıdır:

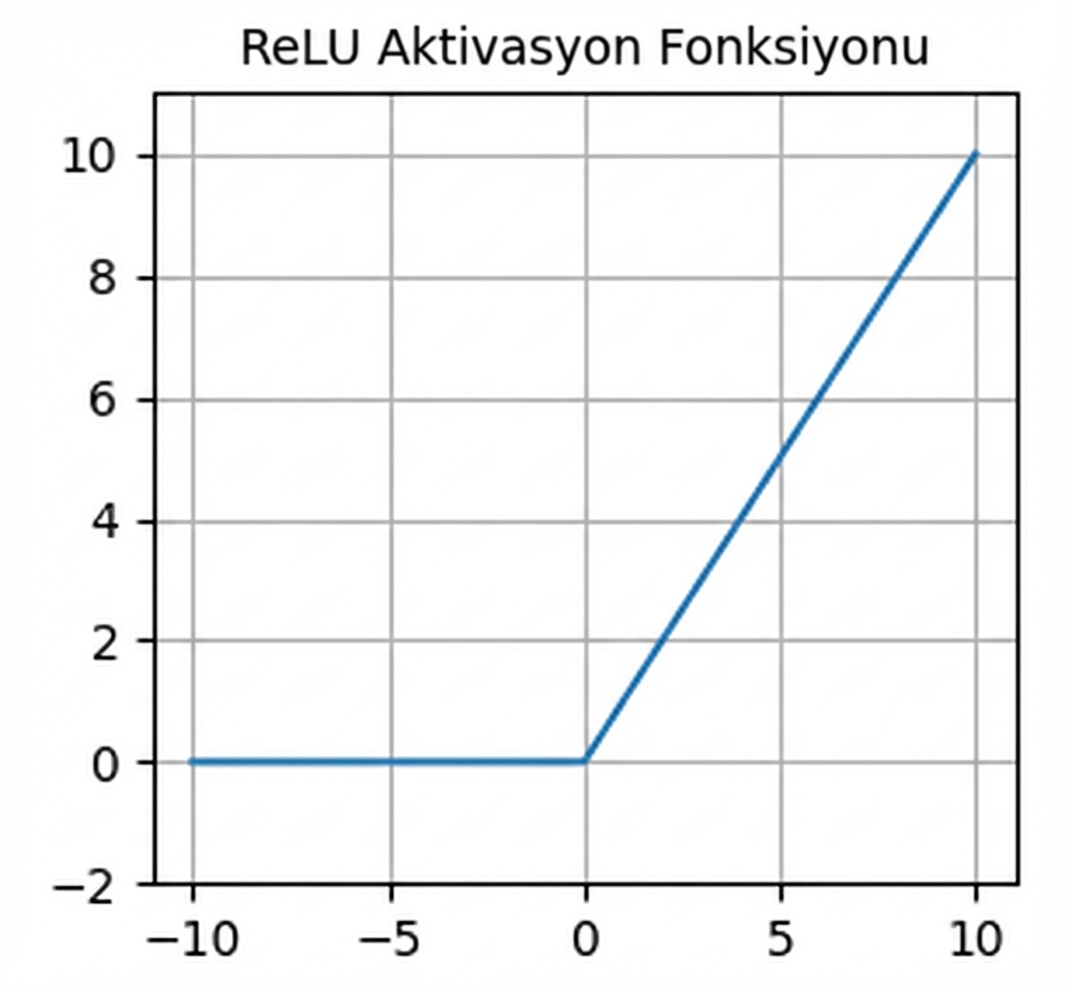

- ReLU ve benzerleri için He/Kaiming başlangıcı kullanılır

Ağırlık başlatma

import torch.nn.init as init

init.kaiming_uniform_(layer.weight)

print(layer.weight)

Parameter containing:

tensor([[-0.3063, -0.2410, 0.0588, 0.2664,

0.0502, -0.0136, 0.2274, 0.0901]])

He / Kaiming başlatma

init.kaiming_uniform_(self.fc1.weight)

init.kaiming_uniform_(self.fc2.weight)

init.kaiming_uniform_(

self.fc3.weight,

nonlinearity="sigmoid",

)

He / Kaiming başlatma

import torch.nn as nn import torch.nn.init as init class Net(nn.Module): def __init__(self): super().__init__() self.fc1 = nn.Linear(9, 16) self.fc2 = nn.Linear(16, 8) self.fc3 = nn.Linear(8, 1)init.kaiming_uniform_(self.fc1.weight) init.kaiming_uniform_(self.fc2.weight) init.kaiming_uniform_( self.fc3.weight, nonlinearity="sigmoid", )

def forward(self, x):

x = nn.functional.relu(self.fc1(x))

x = nn.functional.relu(self.fc2(x))

x = nn.functional.sigmoid(self.fc3(x))

return x

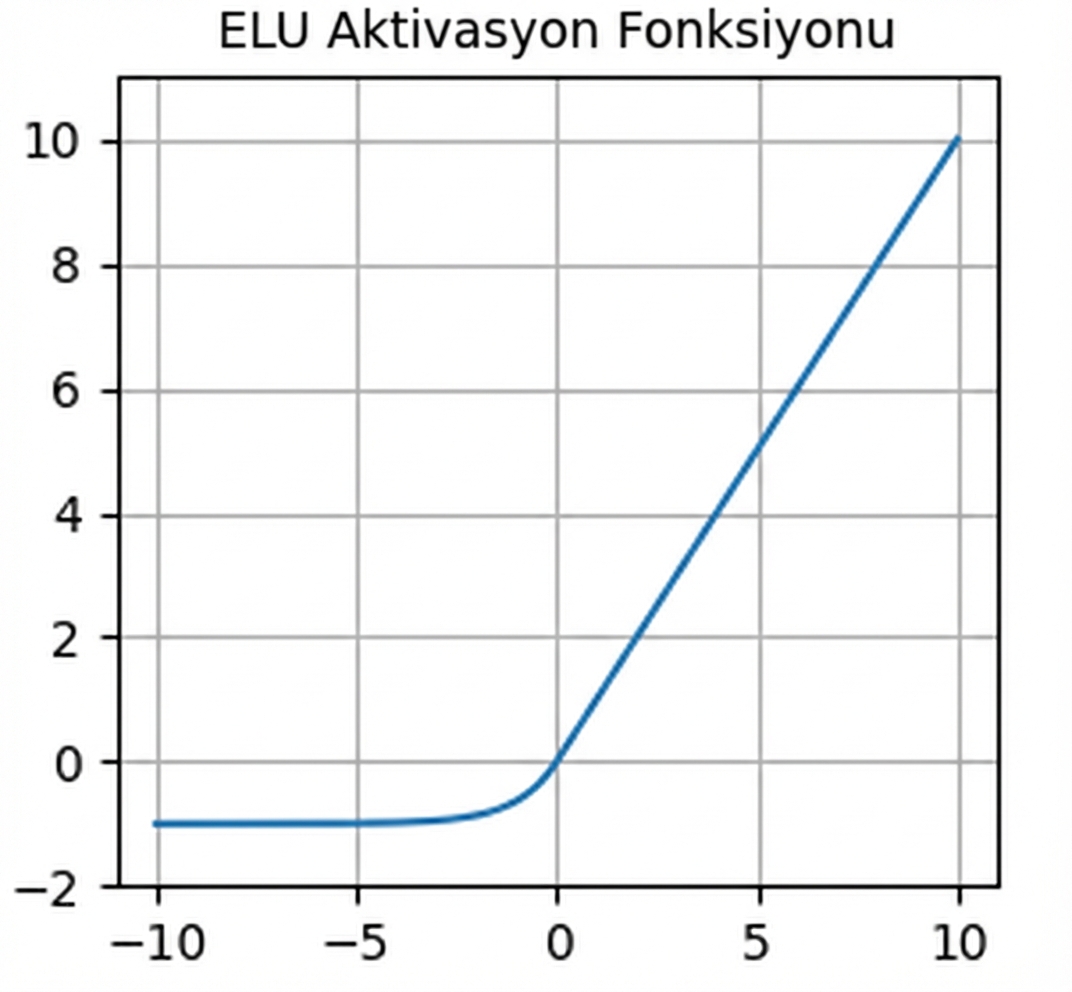

Aktivasyon fonksiyonları

- Sıklıkla varsayılan aktivasyon

nn.functional.relu()- Negatif girdilerde sıfır — ölen nöronlar

nn.functional.elu()- Negatif değerler için sıfır olmayan gradyanlar — ölen nöronlara karşı yardımcı

- Ortalama çıktı sıfır civarı — sönen gradyanlara karşı yardımcı

Batch normalization

Bir katmandan sonra:

Çıktıları şu şekilde normalize edin:

- Ortalamayı çıkarın

- Standart sapmaya bölün

Normalize çıktıları öğrenilen parametrelerle ölçekleyip kaydırın

Model her katman için en iyi girdi dağılımını öğrenir:

- Kayıp daha hızlı düşer

- Dengesiz gradyanlara karşı yardımcıdır

Batch normalization

class Net(nn.Module): def __init__(self): super().__init__() self.fc1 = nn.Linear(9, 16) self.bn1 = nn.BatchNorm1d(16) ...def forward(self, x): x = self.fc1(x) x = self.bn1(x) x = nn.functional.elu(x) ...

Haydi pratik yapalım!

PyTorch ile Orta Düzey Deep Learning