Büyük Verinin Temelleri

PySpark ile Big Data Temelleri

Upendra Devisetty

Science Analyst, CyVerse

Büyük Veri nedir?

- Büyük veri, geleneksel veri işleme yazılımları için fazla karmaşık veri kümelerinin incelenmesi ve uygulamalarını ifade eder - Vikipedi

Büyük Verinin 3 V'si

Hacim, Çeşitlilik ve Hız

Hacim: Verinin boyutu

Çeşitlilik: Farklı kaynaklar ve biçimler

Hız: Verinin akış hızı

Büyük Veri kavramları ve terimleri

Kümeli hesaplama: Birden çok makinenin kaynaklarının bir araya getirilmesi

Paralel hesaplama: Tek bilgisayarda eşzamanlı hesaplama

Dağıtık hesaplama: Paralel çalışan düğümler (ağlı bilgisayarlar) topluluğu

Yığın işleme: İşi küçük parçalara bölüp ayrı makinelerde çalıştırma

Gerçek zamanlı işleme: Veriyi anında işleme

Büyük Veri işleme sistemleri

Hadoop/MapReduce: Java ile yazılmış, ölçeklenebilir ve hataya dayanıklı çerçeve

Açık kaynak

Yığın işleme

Apache Spark: Genel amaçlı ve çok hızlı küme hesaplama sistemi

Açık kaynak

Hem yığın hem gerçek zamanlı veri işleme

Not: Günümüzde Apache Spark, Hadoop/MapReduce’a tercih edilmektedir

Apache Spark çerçevesinin özellikleri

Dağıtık küme hesaplama çerçevesi

Büyük veri kümeleri için verimli bellek içi hesaplamalar

Çok hızlı veri işleme çerçevesi

Java, Scala, Python, R ve SQL desteği sağlar

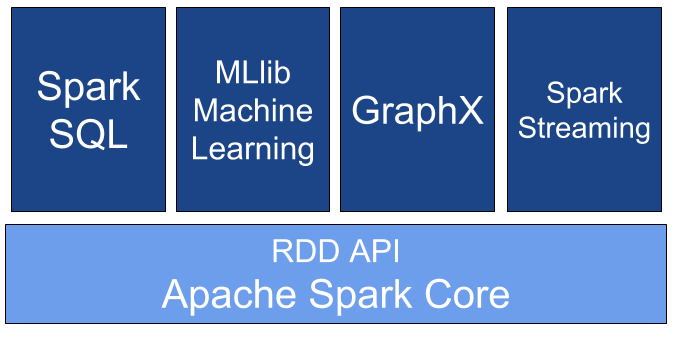

Apache Spark Bileşenleri

Spark dağıtım kipleri

Yerel kip: Dizüstünüz gibi tek makine

- Test, hata ayıklama ve gösterimler için uygundur

Küme kipi: Önceden tanımlı makineler grubu

- Üretim için iyidir

İş akışı: Yerel -> kümeler

Kod değişikliği gerekmez

Sırada PySpark var

PySpark ile Big Data Temelleri