Monte Carlo yöntemleri

Python ile Gymnasium'da Reinforcement Learning

Fouad Trad

Machine Learning Engineer

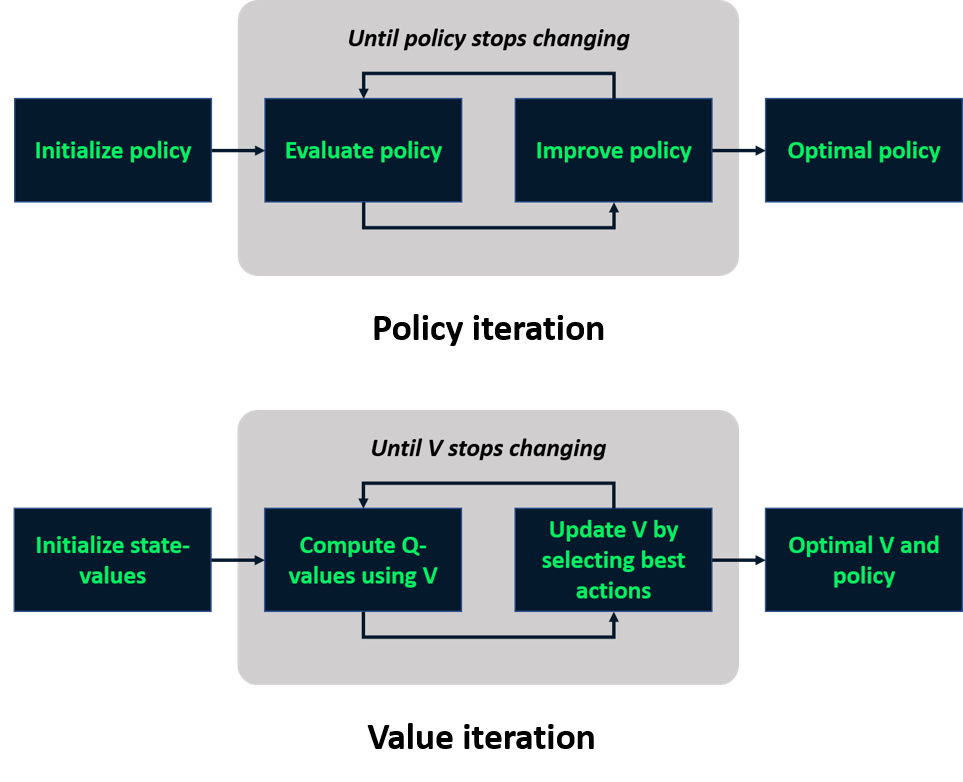

Tekrar: modele dayalı öğrenme

- Ortam dinamiklerinin bilgisine dayanır

- Ortamla etkileşim yoktur

Modelden bağımsız öğrenme

- Ortam dinamiklerinin bilgisine dayanmaz

- Aracı, ortamla etkileşir

- Deneme-yanılmayla politika öğrenir

- Gerçek dünyaya daha uygundur

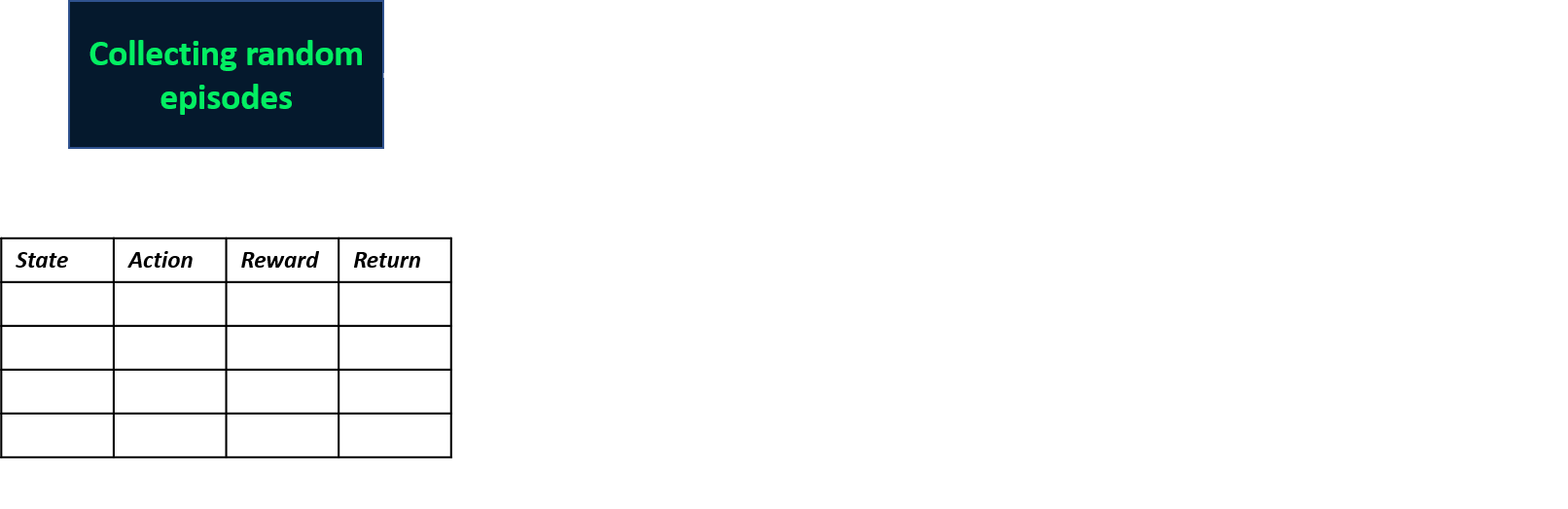

Monte Carlo yöntemleri

- Modelden bağımsız teknikler

- Q-değerlerini bölümlerden tahmin eder

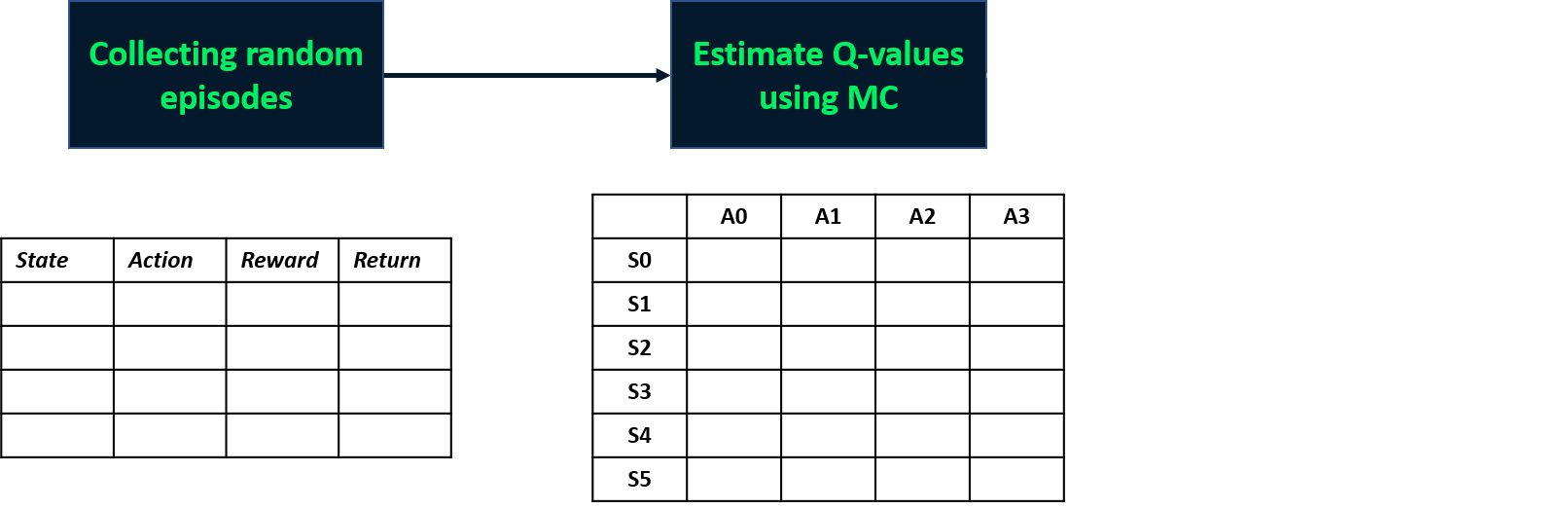

Monte Carlo yöntemleri

- Modelden bağımsız teknikler

- Q-değerlerini bölümlerden tahmin eder

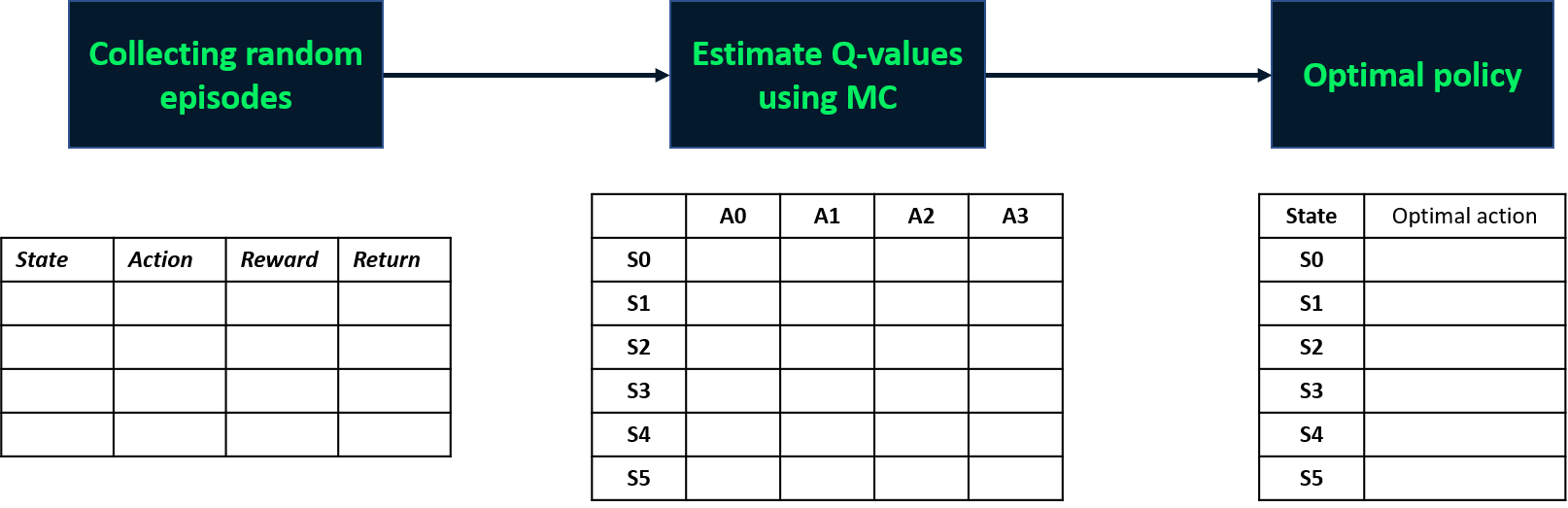

Monte Carlo yöntemleri

- Modelden bağımsız teknikler

- Q-değerlerini bölümlerden tahmin eder

- İki yöntem: ilk-ziyaret, her-ziyaret

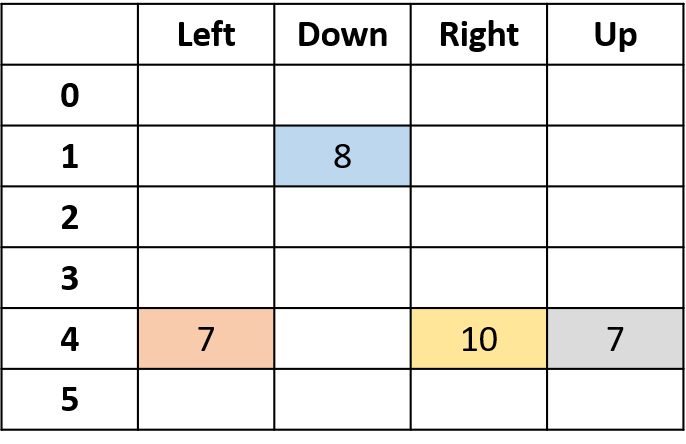

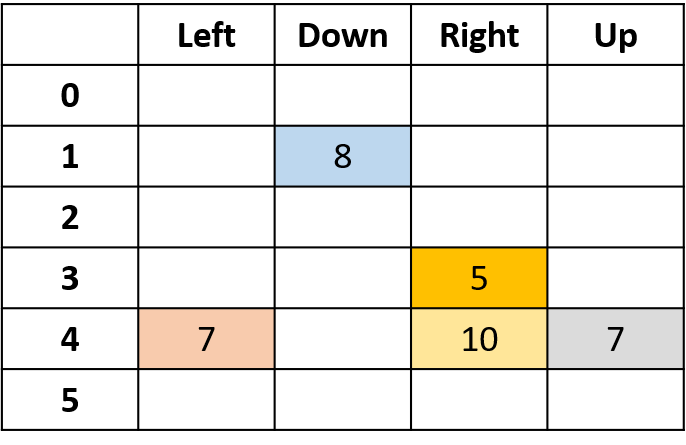

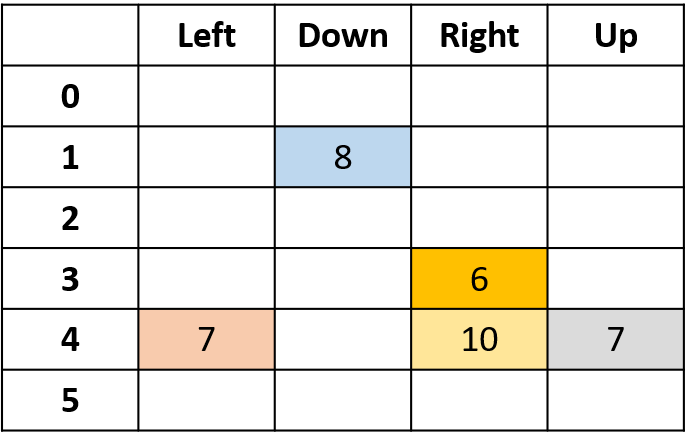

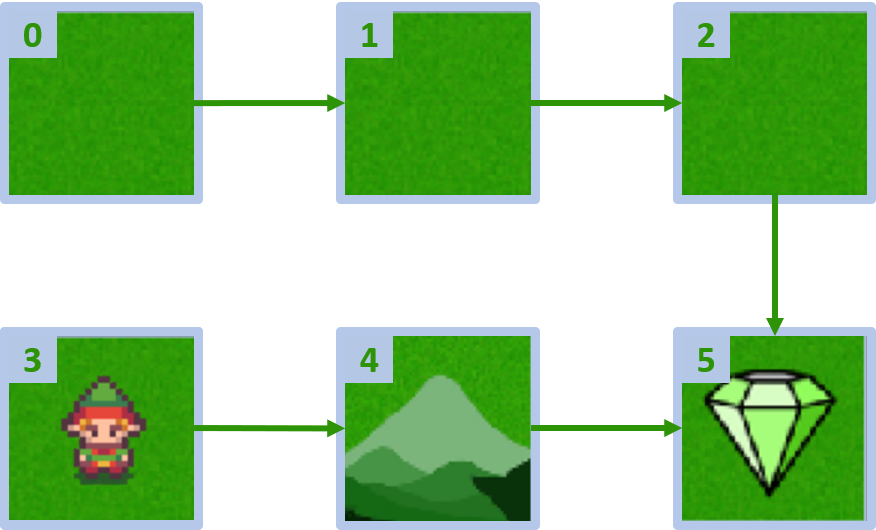

Özel ızgara dünya

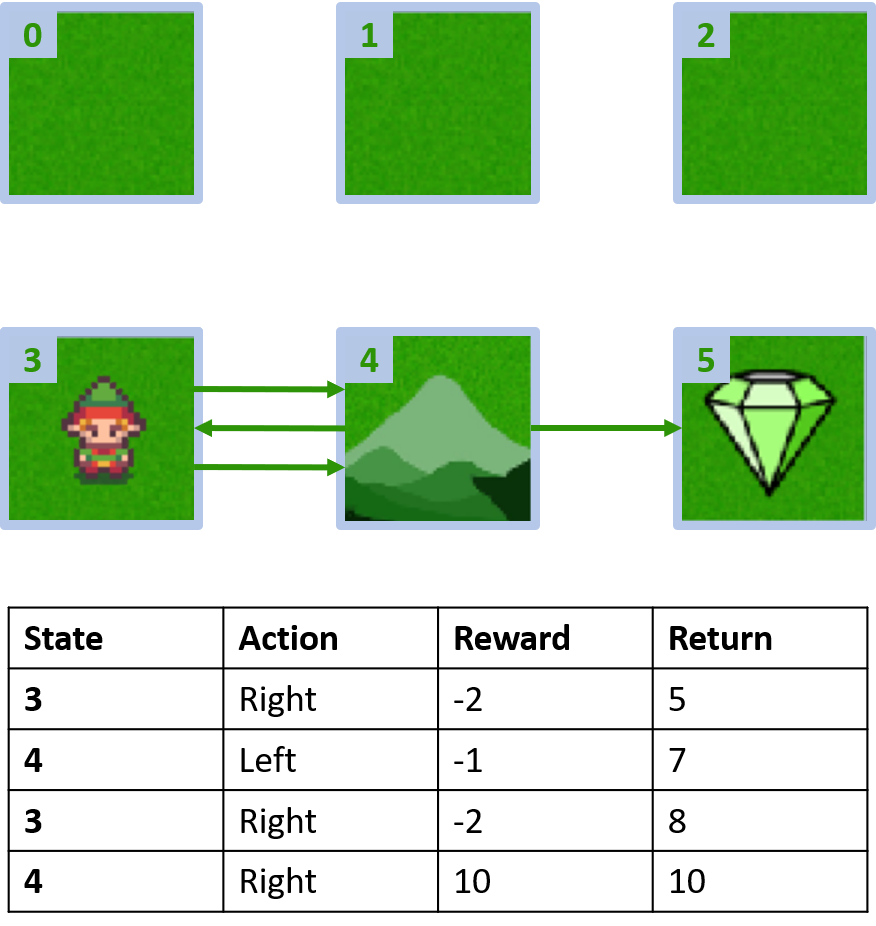

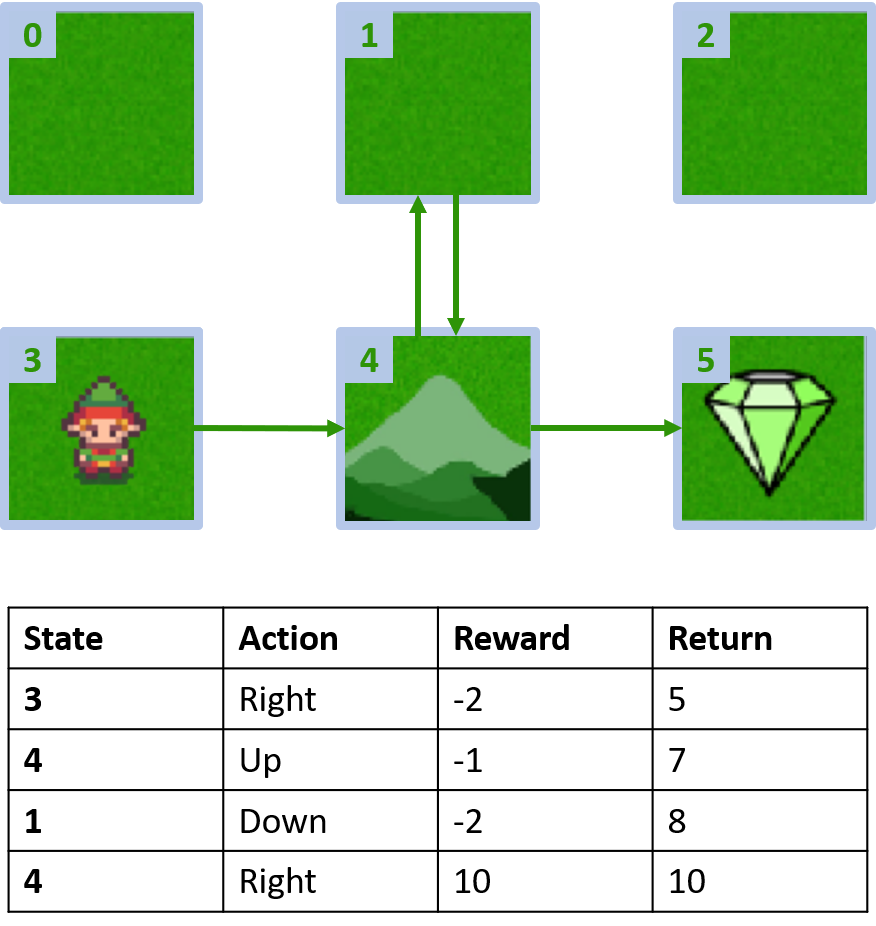

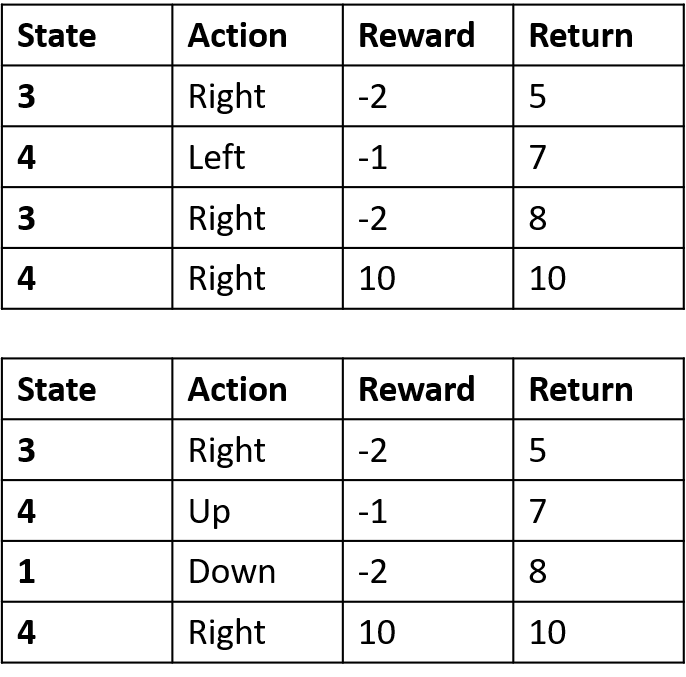

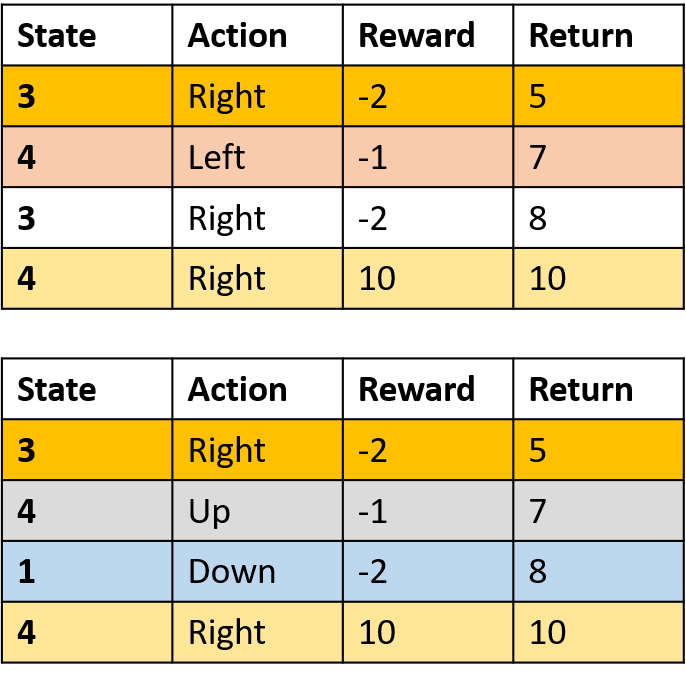

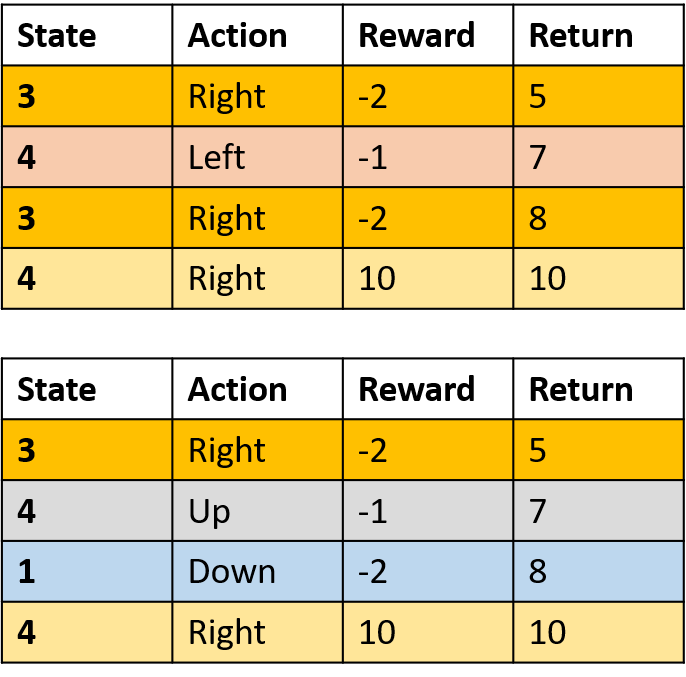

İki bölüm toplama

Q-değerlerini tahmin etme

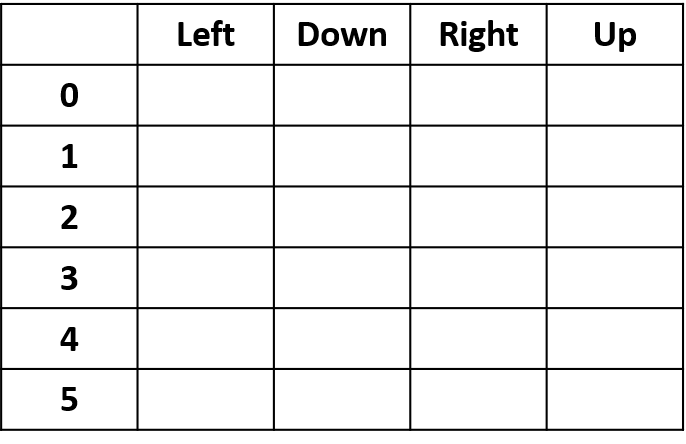

- Q-tablosu: Q-değerleri tablosu

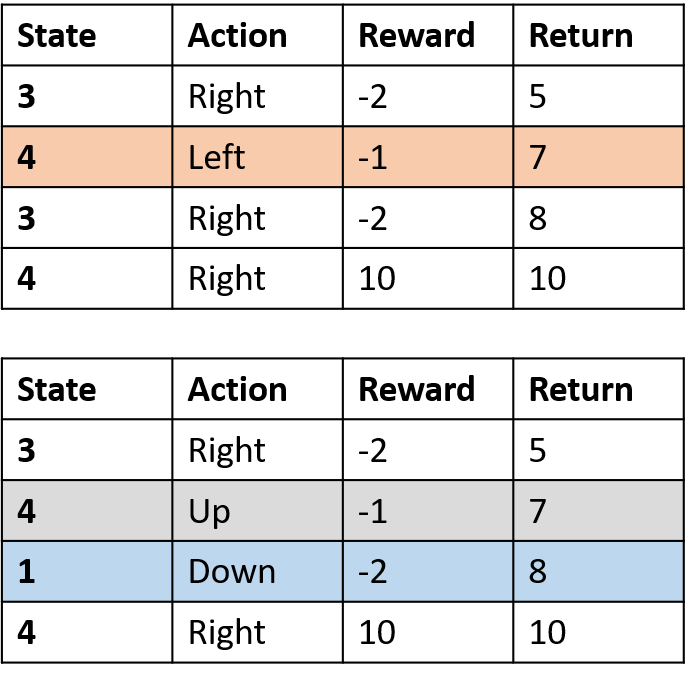

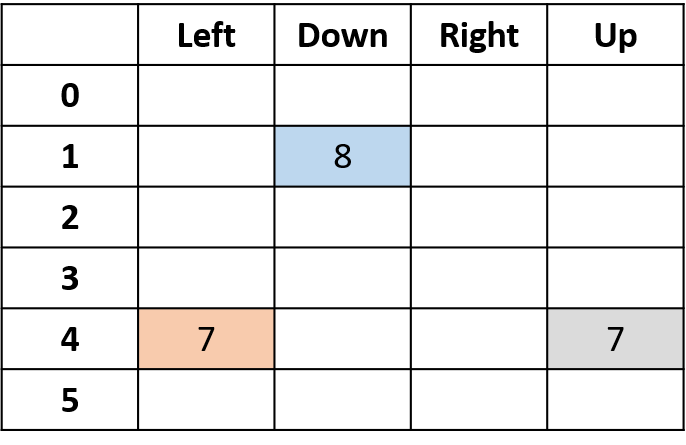

Q(4, sol), Q(4, yukarı) ve Q(1, aşağı)

- (s,a) bir kez görünür -> getiriyle doldur

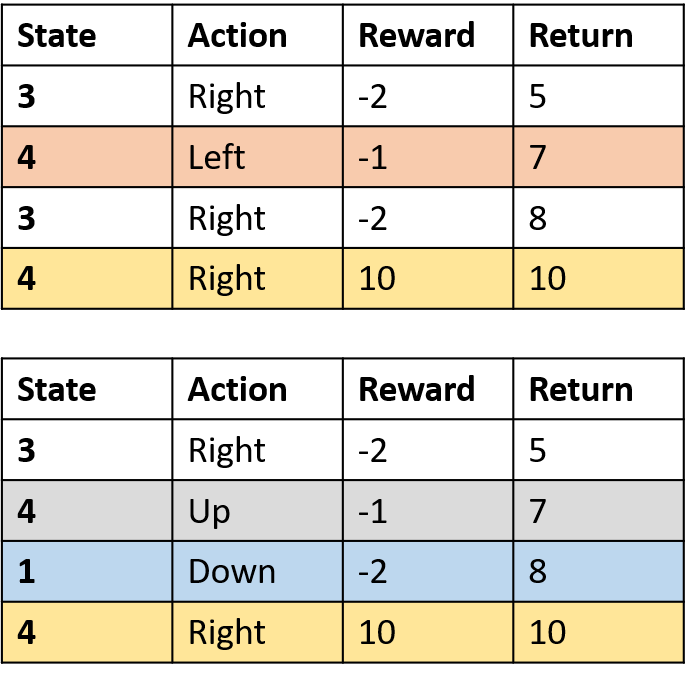

Q(4, sağ)

- (s,a) bölüm başına bir kez -> ortalama al

Q(3, sağ) - ilk-ziyaret Monte Carlo

- Bölüm içinde (s,a) için ilk ziyareti ortala

Q(3, sağ) - her-ziyaret Monte Carlo

- Bölüm içinde (s,a) için her ziyareti ortala

Bir bölüm üretme

def generate_episode(): episode = [] state, info = env.reset()terminated = False while not terminated: action = env.action_space.sample()next_state, reward, terminated, truncated, info = env.step(action)episode.append((state, action, reward)) state = next_statereturn episode

İlk-ziyaret Monte Carlo

def first_visit_mc(num_episodes): Q = np.zeros((num_states, num_actions)) returns_sum = np.zeros((num_states, num_actions)) returns_count = np.zeros((num_states, num_actions))for i in range(num_episodes): episode = generate_episode() visited_states_actions = set()for j, (state, action, reward) in enumerate(episode):if (state, action) not in visited_states:returns_sum[state, action] += sum([x[2] for x in episode[j:]])returns_count[state, action] += 1 visited_states_actions.add((state, action))nonzero_counts = returns_count != 0Q[nonzero_counts] = returns_sum[nonzero_counts] / returns_count[nonzero_counts] return Q

Her-ziyaret Monte Carlo

def every_visit_mc(num_episodes):

Q = np.zeros((num_states, num_actions))

returns_sum = np.zeros((num_states, num_actions))

returns_count = np.zeros((num_states, num_actions))

for i in range(num_episodes):

episode = generate_episode()

for j, (state, action, reward) in enumerate(episode):

returns_sum[state, action] += sum([x[2] for x in episode[j:]])

returns_count[state, action] += 1

nonzero_counts = returns_count != 0

Q[nonzero_counts] = returns_sum[nonzero_counts] / returns_count[nonzero_counts]

return Q

En iyi politikayı elde etme

def get_policy():

policy = {state: np.argmax(Q[state]) for state in range(num_states)}

return policy

Hepsini birleştirme

Q = first_visit_mc(1000)policy_first_visit = get_policy()print("First-visit policy: \n", policy_first_visit)Q = every_visit_mc(1000)policy_every_visit = get_policy()print("Every-visit policy: \n", policy_every_visit)

First-visit policy:

{0: 2, 1: 2, 2: 1,

3: 2, 4: 2, 5: 0}

Every-visit policy:

{0: 2, 1: 2, 2: 1,

3: 2, 4: 2, 5: 0}

Hadi pratik yapalım!

Python ile Gymnasium'da Reinforcement Learning