Keşif ve sömürü dengesini kurma

Python ile Gymnasium'da Reinforcement Learning

Fouad Trad

Machine Learning Engineer

Rastgele eylemlerle eğitim

- Ajan ortamı keşfeder

- Öğrenilen bilgiye dayalı strateji iyileştirmesi yok

- Eğitim bitince ajan bilgiyi kullanır

Keşif–sömürü ödünleşimi

- Keşif ve sömürüyü dengeler

- Sürekli keşif strateji iyileştirmesini engeller

- Yalnızca sömürü, keşfedilmemiş fırsatları kaçırır

Yemek seçimi

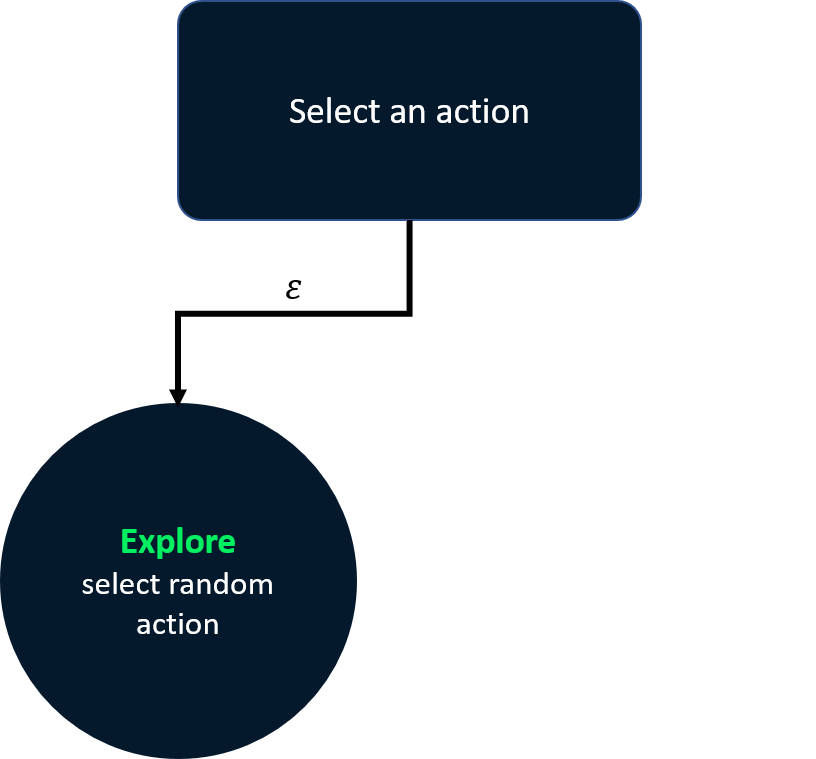

Epsilon-greedy stratejisi

- Epsilon olasılığıyla keşfet

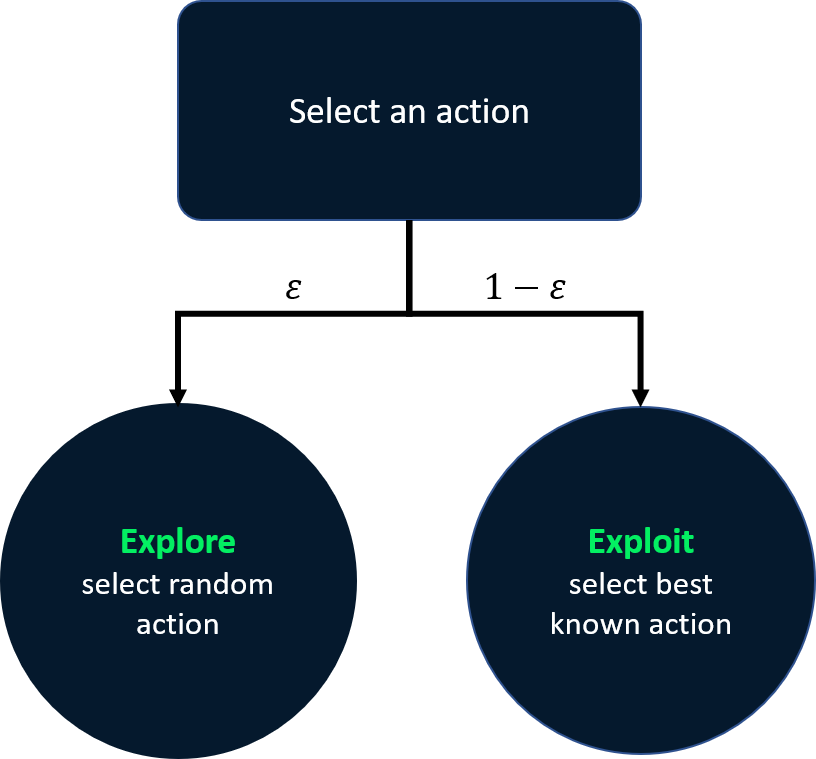

Epsilon-greedy stratejisi

- Epsilon olasılığıyla keşfet

- 1-epsilon olasılığıyla sömür

- Bilgiyi kullanırken sürekli keşfi sağlar

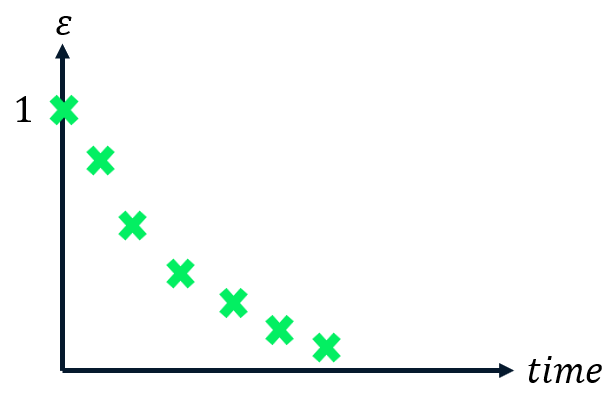

Azalan epsilon-greedy stratejisi

- Zamanla epsilon azaltılır

- Başta daha fazla keşif

- Sonrasında daha fazla sömürü

- Ajan biriken bilgisine giderek daha çok güvenir

Frozen Lake ile uygulama

env = gym.make('FrozenLake', is_slippery=True) action_size = env.action_space.n state_size = env.observation_space.n Q = np.zeros((state_size, action_size))alpha = 0.1 gamma = 0.99 total_episodes = 10000

epsilon_greedy() uygulaması

def epsilon_greedy(state):if np.random.rand() < epsilon: action = env.action_space.sample() # Exploreelse: action = np.argmax(Q[state, :]) # Exploit return action

Epsilon-greedy eğitimi

epsilon = 0.9 # Exploration raterewards_eps_greedy = []

for episode in range(total_episodes): state, info = env.reset() terminated = False episode_reward = 0 while not terminated: action = epsilon_greedy(state) new_state, reward, terminated, truncated, info = env.step(action) Q[state, action] = update_q_table(state, action, new_state) state = new_stateepisode_reward += reward rewards_eps_greedy.append(episode_reward)

Azalan epsilon-greedy eğitimi

epsilon = 1.0 # Exploration rate epsilon_decay = 0.999 min_epsilon = 0.01rewards_decay_eps_greedy = [] for episode in range(total_episodes): state, info = env.reset() terminated = False episode_reward = 0 while not terminated: action = epsilon_greedy(state) new_state, reward, terminated, truncated, info = env.step(action) episode_reward += reward Q[state, action] = update_q_table(state, action, new_state) state = new_state rewards_decay_eps_greedy.append(episode_reward)epsilon = max(min_epsilon, epsilon * epsilon_decay)

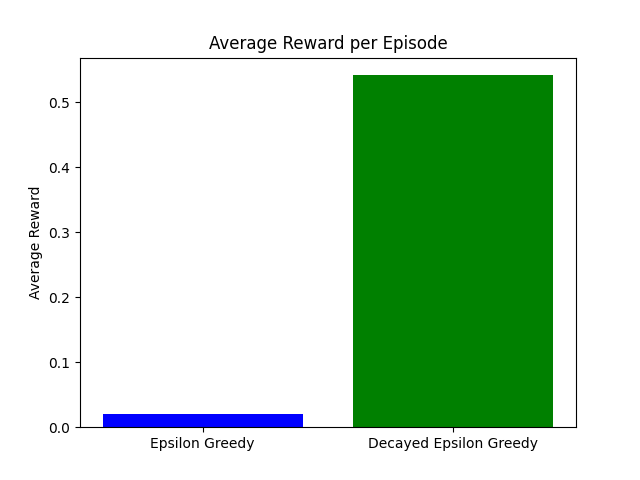

Stratejileri karşılaştırma

avg_eps_greedy= np.mean(rewards_eps_greedy)

avg_decay = np.mean(rewards_decay_eps_greedy)

plt.bar(['Epsilon Greedy', 'Decayed Epsilon Greedy'],

[avg_eps_greedy, avg_decay],

color=['blue', 'green'])

plt.title('Average Reward per Episode')

plt.ylabel('Average Reward')

plt.show()

Haydi pratik yapalım!

Python ile Gymnasium'da Reinforcement Learning