Çok kollu biraderler

Python ile Gymnasium'da Reinforcement Learning

Fouad Trad

Machine Learning Engineer

Çok kollu biraderler

- Kumarbazın karşısında slot makineleri

- Amaç → kazanımı en çoklamak

- Çözüm → keşif-sömürü dengesi

Slot makineleri

- Bir koldan ödül 0 veya 1'dir

- Ajanın hedefi → toplam ödülü en çoklamak

Problemi çözme

- Azalan epsilon-greedy

- Epsilon → rastgele makine seç

Problemi çözme

- Azalan epsilon-greedy

- Epsilon → rastgele makine seç

- 1 - epsilon → şu ana kadarki en iyiyi seç

- Epsilon zamanla azalır

Başlatma

n_bandits = 4 true_bandit_probs = np.random.rand(n_bandits)n_iterations = 100000 epsilon = 1.0 min_epsilon = 0.01 epsilon_decay = 0.999counts = np.zeros(n_bandits) # Her bir biraderin kaç kez oynandığıvalues = np.zeros(n_bandits) # Her bir biraderin tahmini kazanma olasılığırewards = np.zeros(n_iterations) # Ödül geçmişiselected_arms = np.zeros(n_iterations, dtype=int) # Kol seçim geçmişi

Etkileşim döngüsü

for i in range(n_iterations): arm = epsilon_greedy()reward = np.random.rand() < true_bandit_probs[arm]rewards[i] = reward selected_arms[i] = arm counts[arm] += 1values[arm] += (reward - values[arm]) / counts[arm]epsilon = max(min_epsilon, epsilon * epsilon_decay)

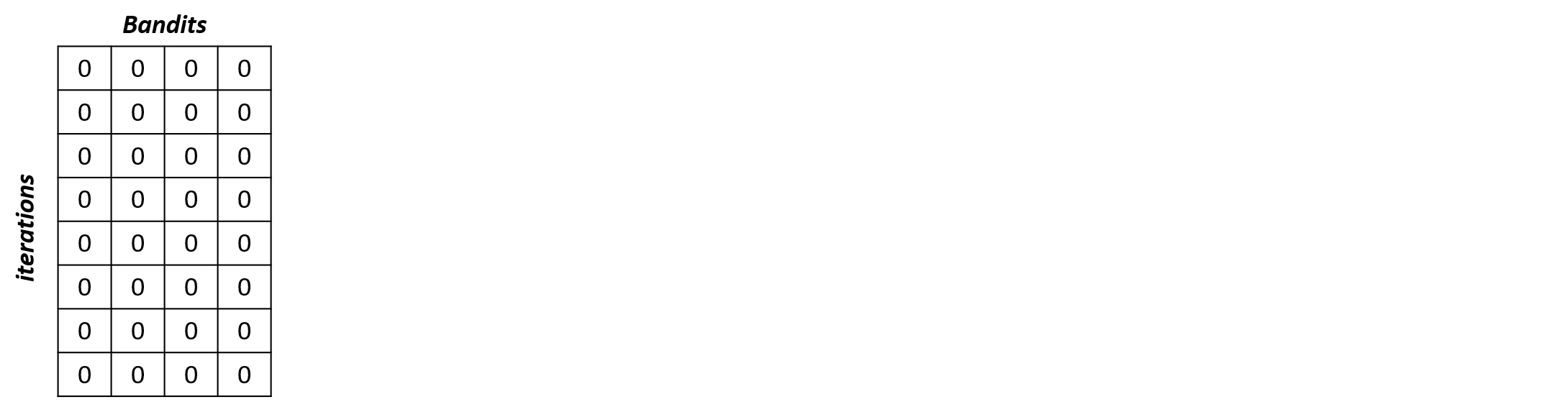

Seçimlerin analizi

selections_percentage = np.zeros((n_iterations, n_bandits))

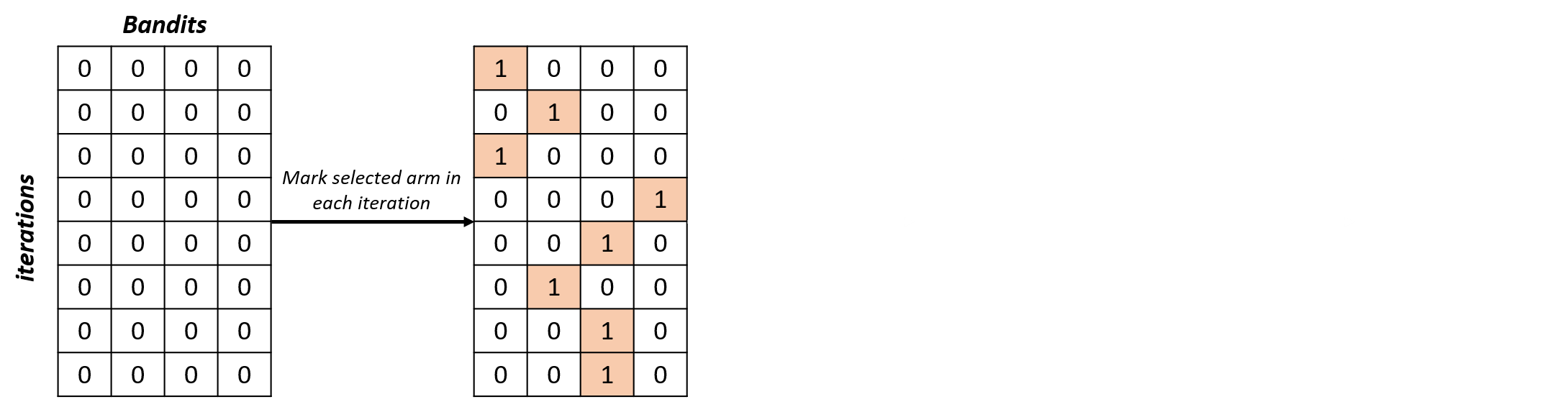

Seçimlerin analizi

selections_percentage = np.zeros((n_iterations, n_bandits))for i in range(n_iterations): selections_percentage[i, selected_arms[i]] = 1

Seçimlerin analizi

selections_percentage = np.zeros((n_iterations, n_bandits))for i in range(n_iterations): selections_percentage[i, selected_arms[i]] = 1selections_percentage = np.cumsum(selections_percentage, axis=0) / np.arange(1, n_iterations + 1).reshape(-1, 1)

Seçimlerin analizi

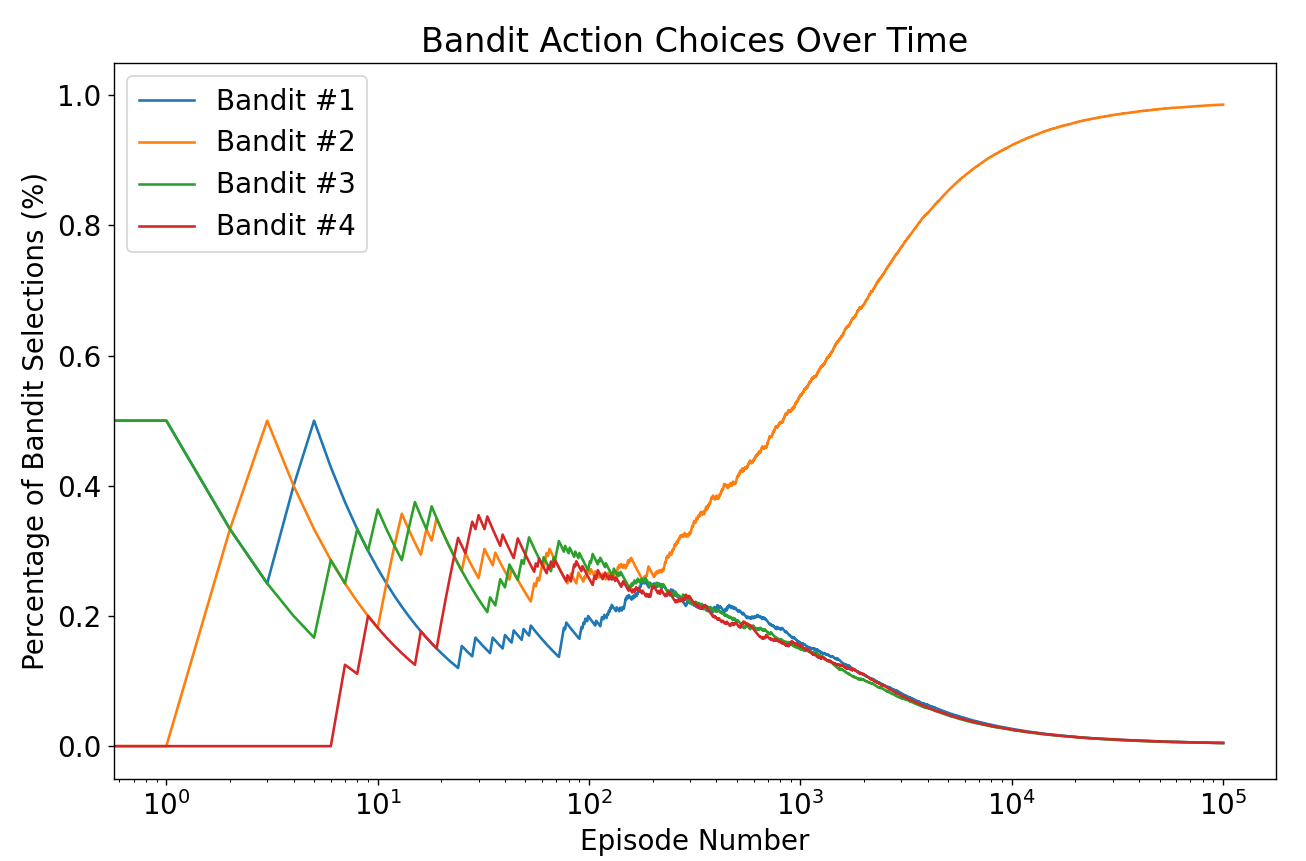

for arm in range(n_bandits): plt.plot(selections_percentage[:, arm], label=f'Bandit #{arm+1}') plt.xscale('log') plt.title('Zaman İçinde Birader Eylem Seçimleri') plt.xlabel('Bölüm Numarası') plt.ylabel('Birader Seçim Yüzdesi (%)') plt.legend() plt.show()for i, prob in enumerate(true_bandit_probs, 1): print(f"Bandit #{i} -> {prob:.2f}")

Birader #1 -> 0.37

Birader #2 -> 0.95

Birader #3 -> 0.73

Birader #4 -> 0.60

- Ajan en yüksek olasılıklı biraderi seçmeyi öğrenir

Hadi pratik yapalım!

Python ile Gymnasium'da Reinforcement Learning