Databricks SQL’e başlama

Databricks Kavramları

Kevin Barlow

Data Practitioner

SQL İşlem vs. Genel İşlem

Veri bilimi veya veri mühendisliği iş yükleri için işlem kümeleri tasarlamak...

import pyspark.sql.functions as F

spark_df = (spark

.read

.table('user_table'))

spark_df = (spark_df

.withColumn('score',

F.flatten(...))

)

SQL iş yükleri için işlem tasarlamaktan doğası gereği farklıdır

SELECT *

FROM user_table u

LEFT JOIN product_use p

ON u.userId = p.userId

WHERE country = 'USA'

AND utilization >= 0.6

SQL Warehouse

SQL Warehouse

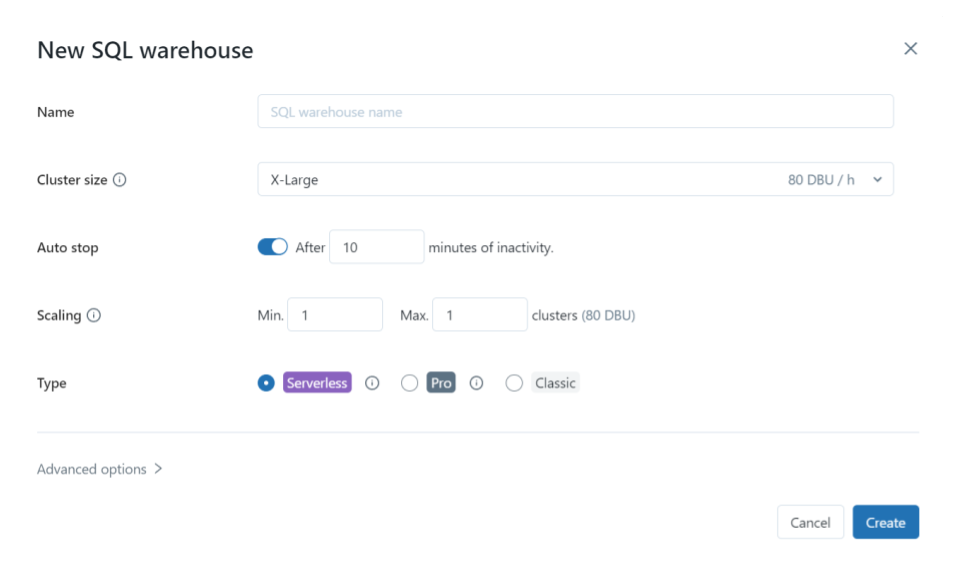

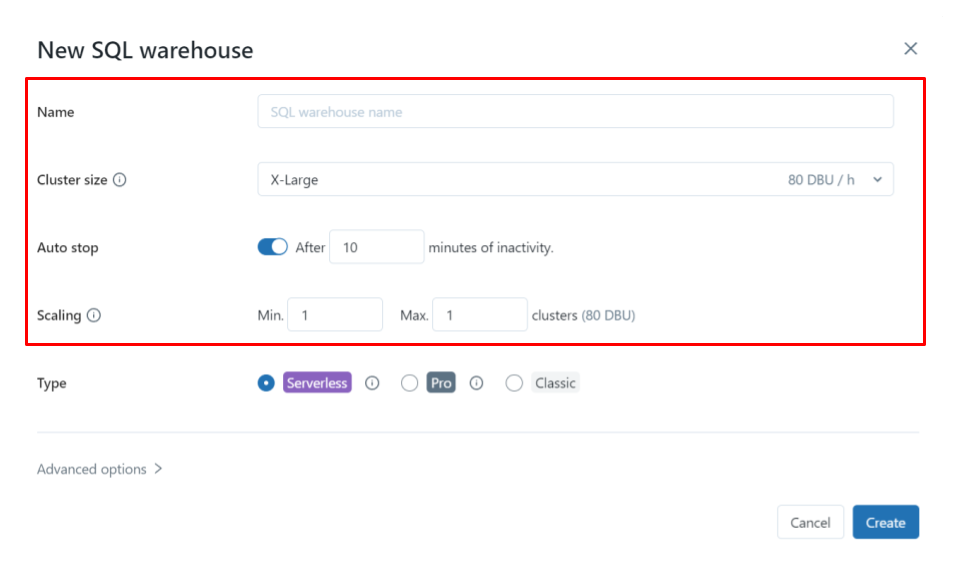

SQL Warehouse Yapılandırma Seçenekleri

- Küme Adı

- Küme Boyutu (S, M, L, vb.)

- Ölçekleme davranışı

SQL Warehouse

SQL Warehouse Yapılandırma Seçenekleri

- Küme Adı

- Küme Boyutu (S, M, L, vb.)

- Ölçekleme davranışı

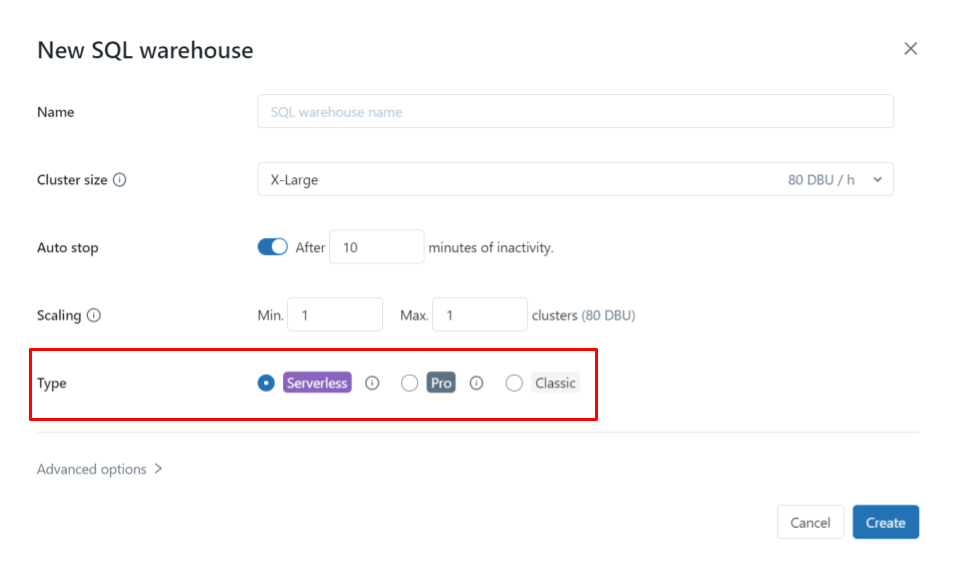

- Küme Türü

SQL Warehouse Türleri

Farklı türler farklı avantajlar sunar

Classic

- En temel SQL işlem gücü

- Müşteri bulutunda

Pro

- Classic’ten daha gelişmiş özellikler

- Müşteri bulutunda

Serverless

- En yeni özellikler

- Databricks bulutunda

- En uygun maliyet/performans

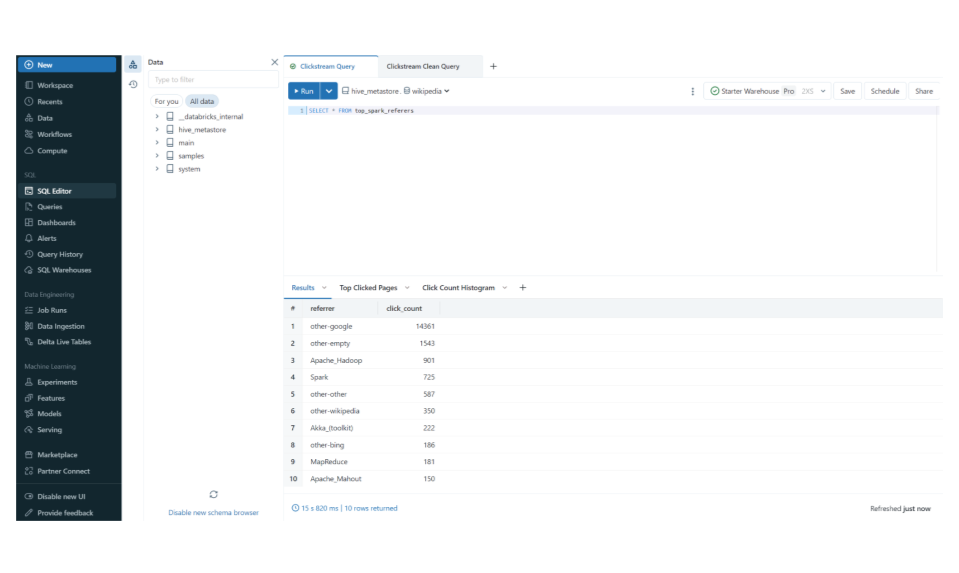

SQL Düzenleyici

Yaygın SQL Komutları

COPY INTO

- Ham veriyi alıp Delta’ya koyar

- ETL’in Extract aşaması

COPY INTO my_table

FROM '/path/to/files'

FILEFORMAT = <format>

FORMAT_OPTIONS ('mergeSchema' = 'true')

COPY_OPTIONS ('mergeSchema' = 'true');

CREATE <entity> AS

- Tablo veya Görünüm oluşturur

- ETL’in Transform aşaması

CREATE TABLE events

USING DELTA

AS (

SELECT *

FROM raw_events

WHERE ...

)

Hadi pratik yapalım!

Databricks Kavramları