Metin Sınıflandırmasına Genel Bakış

PyTorch ile Metin için Deep Learning

Shubham Jain

Instructor

Metin sınıflandırmasının tanımı

- Metne etiket atama

- Sözcük ve cümlelere anlam kazandırma

- Yapısız veriyi düzenler ve yapı kazandırır

Uygulamalar:

- Yorumlarda müşteri duygu analizi

- E-postalarda spam tespiti

- Haberleri ilgili konularla etiketleme

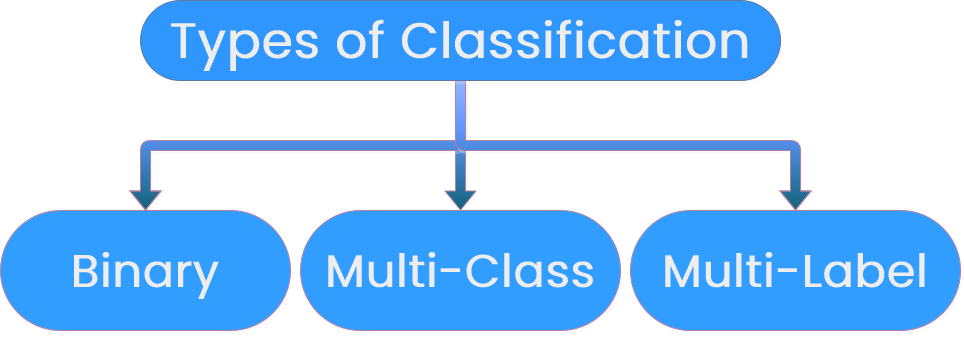

Türler: ikili, çok sınıflı, çok etiketli

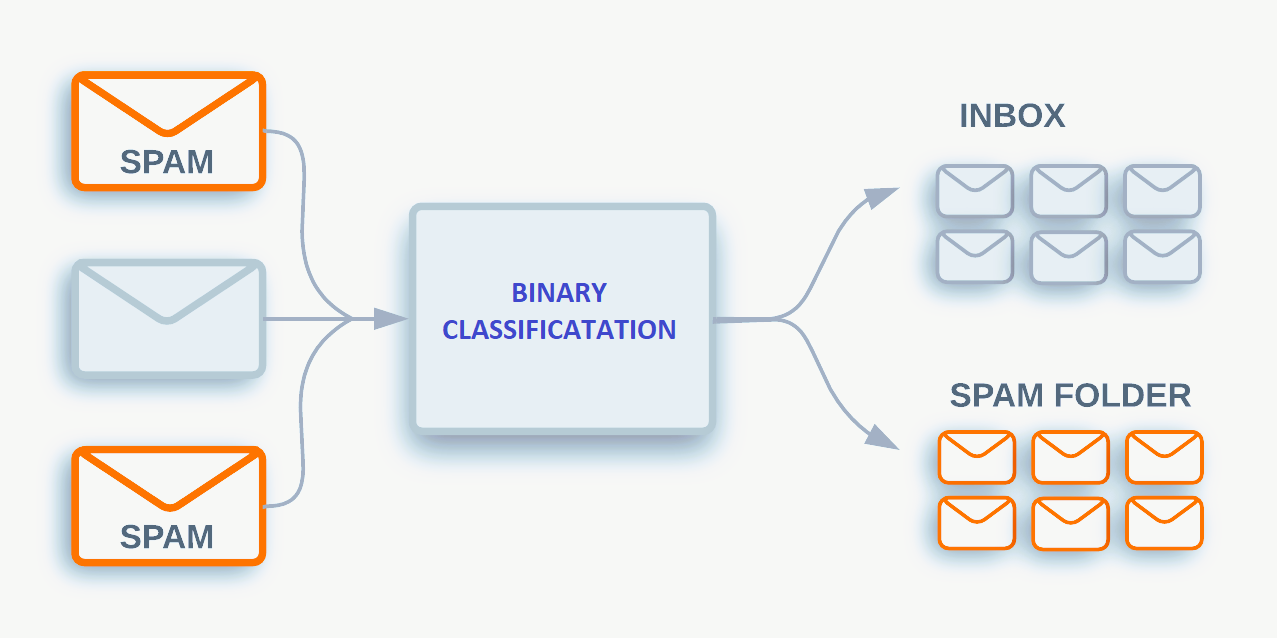

İkili sınıflandırma

- İki kategoriye ayırma

- Örnek: e-posta spam tespiti

- E-postalar 'spam' veya 'spam değil' olarak sınıflandırılabilir

1 https://storage.googleapis.com/gweb-cloudblog-publish/images/image4_v2LFcq0.max-1200x1200.png

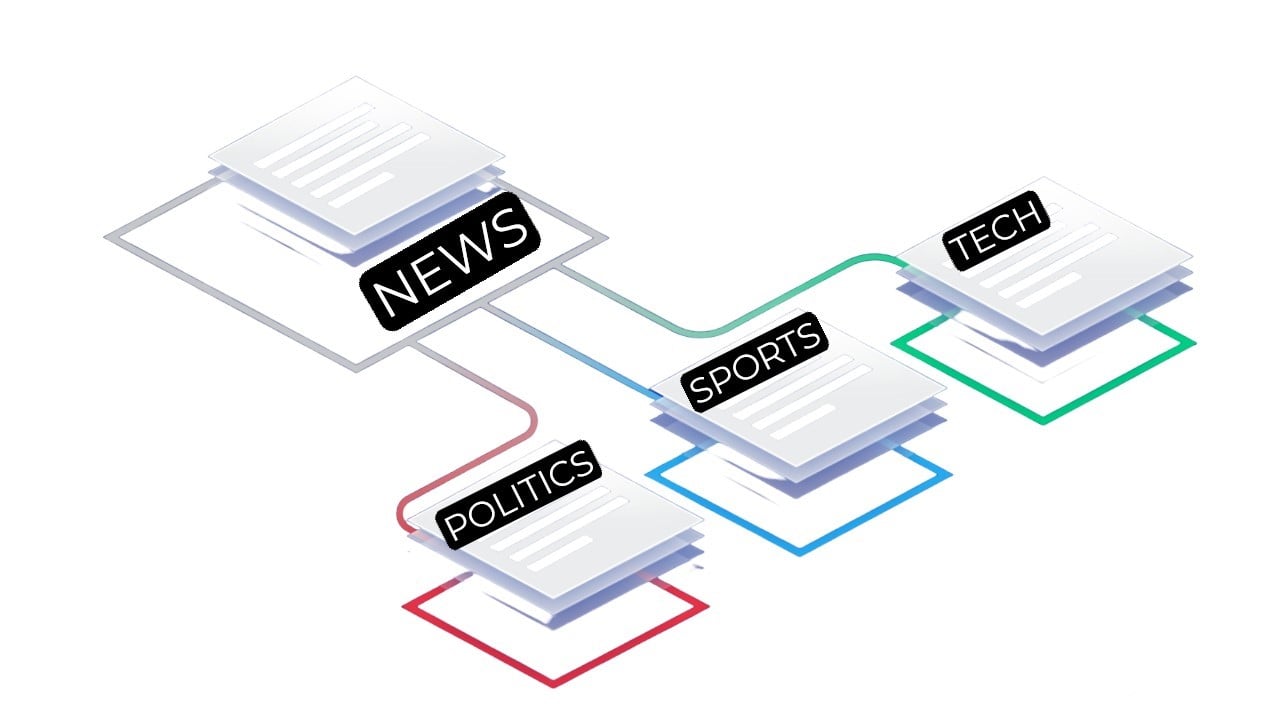

Çok sınıflı sınıflandırma

- Birden çok kategoriye ayırma

- Örnek: Haberler şu kategorilere ayrılabilir:

- Siyaset

- Spor

- Teknoloji

Çok etiketli sınıflandırma

- Her metne birden çok etiket atanabilir

- Örnek: Kitaplar birden çok türe ait olabilir

- Aksiyon

- Macera

- Fantastik

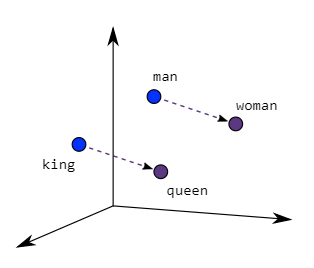

Kelime gömmeleri nedir

- Önceki kodlama teknikleri iyi bir ilk adımdır

- Genellikle çok fazla özellik üretir ve benzer sözcükleri ayırt edemez

- Kelime gömmeleri sözcükleri sayısal vektörlere eşler

- Anlamsal ilişki örneği:

- Kral ve kraliçe

- Erkek ve kadın

Sözcükten indekse eşleme

- Örnek:

- "King" -> 1

- "Queen" -> 2

- Sıkışık ve hesaplama açısından verimli

- Boru hattında tokenlemeden sonra gelir

PyTorch'ta kelime gömmeleri

torch.nn.Embedding:- İndekslerden kelime vektörleri oluşturur

- Girdi: ['The', 'cat', 'sat', 'on', 'the', 'mat'] için indeksler

Embedding for 'the': tensor([-0.4689, 0.3164, -0.2971, -0.1291, 0.4064])

Embedding for 'cat': tensor([-0.0978, -0.4764, 0.0476, 0.1044, -0.3976])

Embedding for 'sat': tensor([ 0.2731, 0.4431, 0.1275, 0.1434, -0.4721])

torch.nn.Embedding kullanımı

import torch from torch import nnwords = ["The", "cat", "sat", "on", "the", "mat"] word_to_idx = {word: i for i, word in enumerate(words)}inputs = torch.LongTensor([word_to_idx[w] for w in words])embedding = nn.Embedding(num_embeddings=len(words), embedding_dim=10)output = embedding(inputs)print(output)

tensor([[ 1.0624, 0.6792, 0.0459, ... -1.0828, -0.4475, 0.4868],

...

[1.5766, 0.0106, 0.1161, ...,, -0.0859, 1.3160, 1.3621])

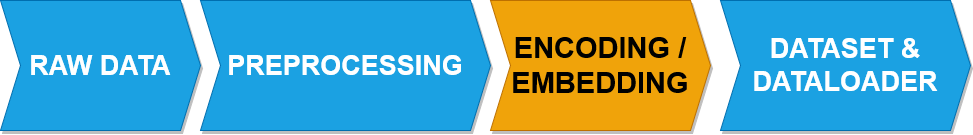

Boru hattında embedding kullanımı

def preprocess_sentences(text): # Tokenization # Stemming ...# Word to index mappingclass TextDataset(Dataset): def __init__(self, encoded_sentences): self.data = encoded_sentences def __len__(self): return len(self.data) def __getitem__(self, index): return self.data[index]

def text_processing_pipeline(text): tokens = preprocess_sentences(text) dataset = TextDataset(tokens) dataloader = DataLoader(dataset, batch_size=2, shuffle=True) return dataloader, vectorizertext = "Your sample text here." dataloader, vectorizer = text_processing_pipeline(text)embedding = nn.Embedding(num_embeddings=10, embedding_dim=50) for batch in dataloader: output = embedding(batch) print(output)

Hadi pratik yapalım!

PyTorch ile Metin için Deep Learning