Metin sınıflandırma modellerine karşı düşmanca saldırılar

PyTorch ile Metin için Deep Learning

Shubham Jain

Instructor

Düşmanca saldırılar nedir?

- Girdi verisine küçük oynamalar

- Rastgele değil, hesaplı kötü niyetli değişiklikler

- Yapay zekânın kararını ciddi biçimde etkileyebilir

Sağlamlığın önemi

- Yorumları toksik/zararsız diye sınıflayan sistemler

- Önyargılı veriden olumsuz stereotipleri istemeden pekiştirme

- Yanıltıcı bilgi verme

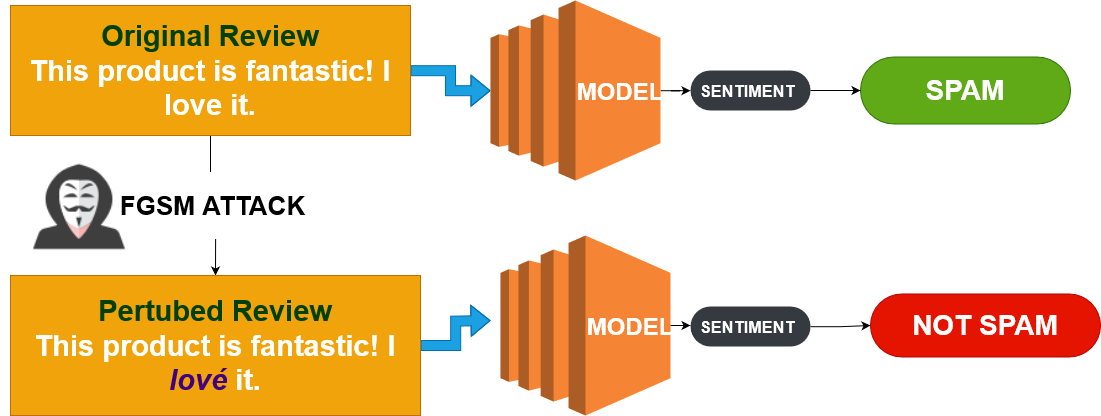

Hızlı Gradyan İşareti Yöntemi (FGSM)

- Modelin öğrendiği bilgiyi sömürür

- En küçük değişiklikle modeli yanıltır

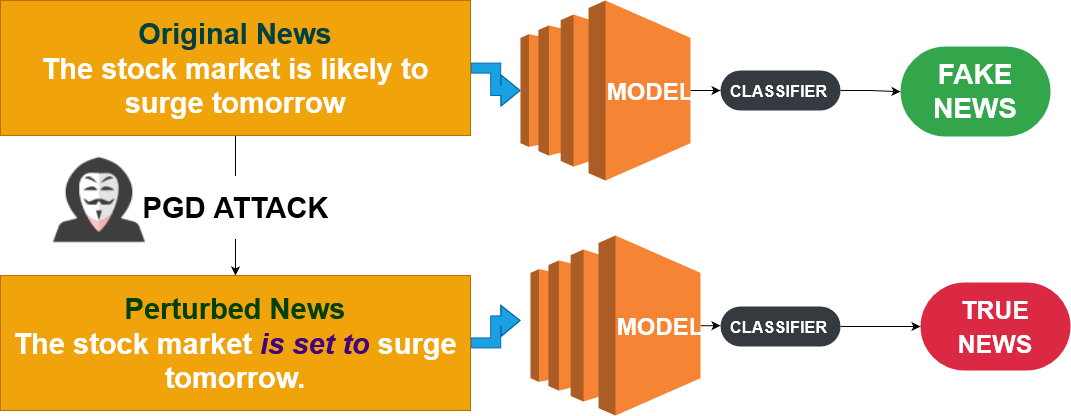

Yansıtılmış Gradyan İnişi (PGD)

- FGSM'den daha gelişmiş: yinelemeli

- En etkili bozulmayı arar

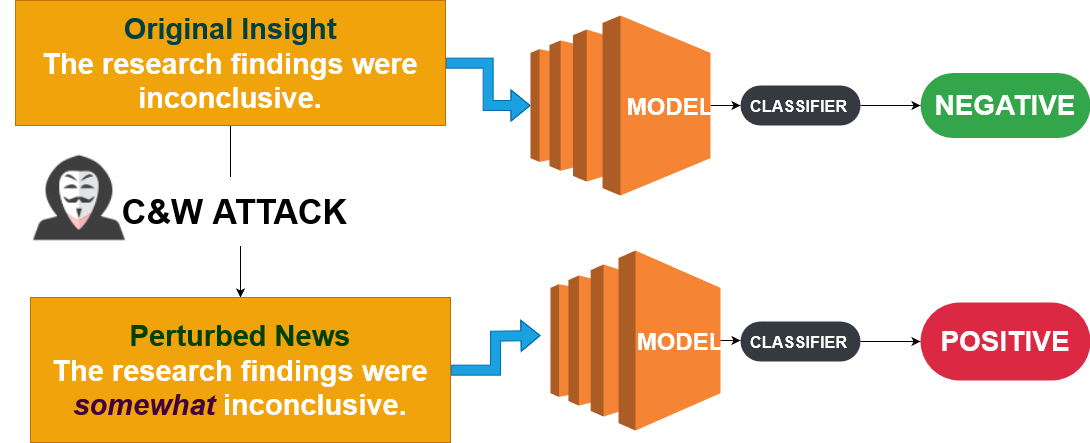

Carlini & Wagner (C&W) saldırısı

- Kayıp fonksiyonunu eniyiler

- Sadece aldatmak değil, fark edilmemek de hedeflenir

Savunma inşası: stratejiler

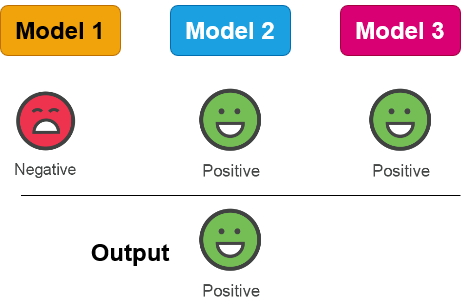

- Model Toplulaştırma:

- Birden çok model kullanın

- Sağlam Veri Artırma:

- Veri artırma

- Düşmanca Eğitim:

- Aldatmayı öngörün

Savunma inşası: araçlar ve teknikler

- PyTorch Robustness Toolbox:

- Metin modellerini güçlendirin

- Gradyan Maskeleme:

- Açık kalıpları gizlemek için eğitime çeşitlilik ekleyin

- Düzenlileştirme Teknikleri:

- Model dengesini koruyun

1 https://adversarial-robustness-toolbox.readthedocs.io/en/latest/, https://stock.adobe.com/ie/contributor/209161356/designer-s-circle

Hadi pratik yapalım!

PyTorch ile Metin için Deep Learning