Etkinleştirme (aktivasyon) fonksiyonları

Python ile TensorFlow’a Giriş

Isaiah Hull

Visiting Associate Professor of Finance, BI Norwegian Business School

Aktivasyon fonksiyonu nedir?

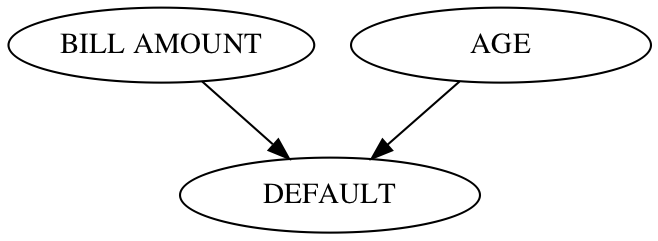

- Tipik bir gizli katmanın bileşenleri

- Doğrusal: Matris çarpımı

- Doğrusal olmayan: Aktivasyon fonksiyonu

Doğrusal olmayanlık neden önemlidir

Doğrusal olmayanlık neden önemlidir

Basit bir örnek

import numpy as np

import tensorflow as tf

# Örnek borçlu özelliklerini tanımlayın

young, old = 0.3, 0.6

low_bill, high_bill = 0.1, 0.5

# Tüm özellik kombinasyonları için matris çarpımı adımını uygulayın

young_high = 1.0*young + 2.0*high_bill

young_low = 1.0*young + 2.0*low_bill

old_high = 1.0*old + 2.0*high_bill

old_low = 1.0*old + 2.0*low_bill

Basit bir örnek

# Gençler için temerrüt tahminlerindeki fark

print(young_high - young_low)

# Yaşlılar için temerrüt tahminlerindeki fark

print(old_high - old_low)

0.8

0.8

Basit bir örnek

# Gençler için temerrüt tahminlerindeki fark

print(tf.keras.activations.sigmoid(young_high).numpy() -

tf.keras.activations.sigmoid(young_low).numpy())

# Yaşlılar için temerrüt tahminlerindeki fark

print(tf.keras.activations.sigmoid(old_high).numpy() -

tf.keras.activations.sigmoid(old_low).numpy())

0.16337568

0.14204389

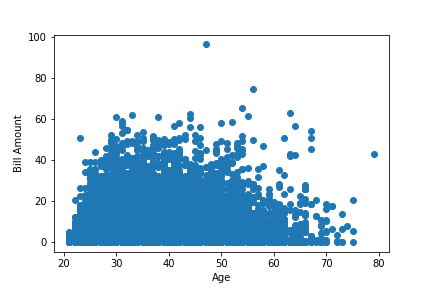

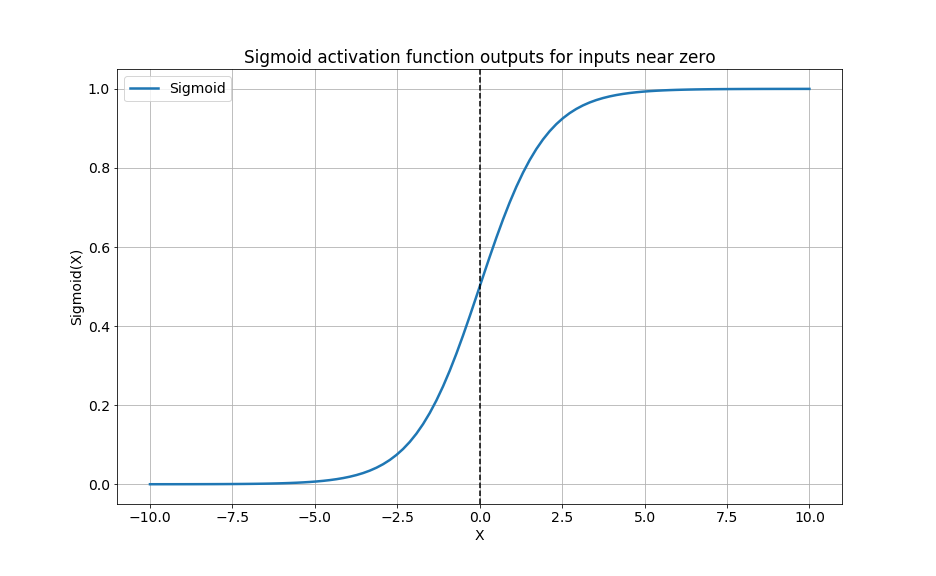

Sigmoid aktivasyon fonksiyonu

- Sigmoid aktivasyon fonksiyonu

- İkili sınıflandırma

- Düşük seviye:

tf.keras.activations.sigmoid() - Yüksek seviye:

sigmoid

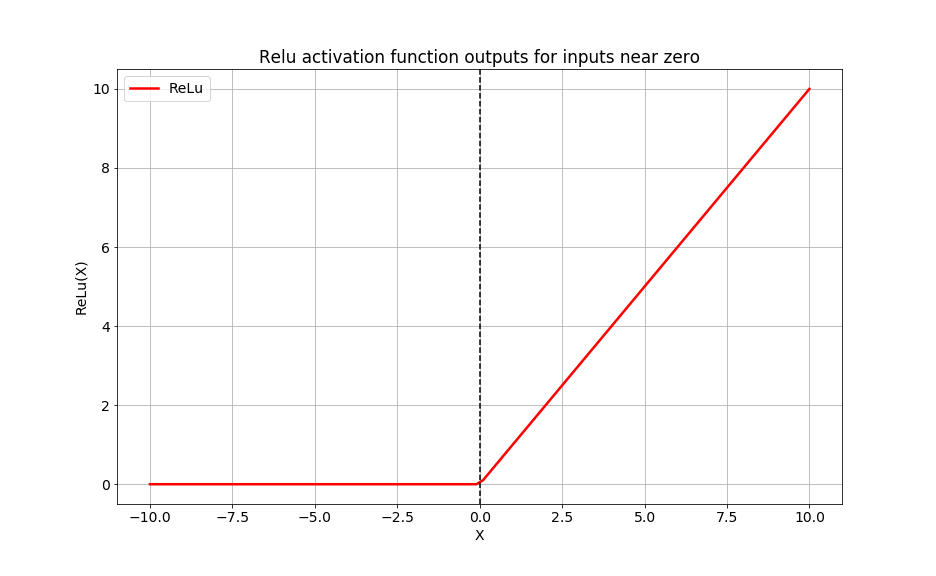

ReLU aktivasyon fonksiyonu

- ReLU aktivasyon fonksiyonu

- Gizli katmanlar

- Düşük seviye:

tf.keras.activations.relu() - Yüksek seviye:

relu

Softmax aktivasyon fonksiyonu

- Softmax aktivasyon fonksiyonu

- Çıkış katmanı (>2 sınıf)

- Düşük seviye:

tf.keras.activations.softmax() - Yüksek seviye:

softmax

Sinir ağlarında aktivasyon fonksiyonları

import tensorflow as tf

# Girdi katmanını tanımlayın

inputs = tf.constant(borrower_features, tf.float32)

# Yoğun katman 1'i tanımlayın

dense1 = tf.keras.layers.Dense(16, activation='relu')(inputs)

# Yoğun katman 2'yi tanımlayın

dense2 = tf.keras.layers.Dense(8, activation='sigmoid')(dense1)

# Çıkış katmanını tanımlayın

outputs = tf.keras.layers.Dense(4, activation='softmax')(dense2)

Hadi pratik yapalım!

Python ile TensorFlow’a Giriş