Avantajlı Aktör-Kritik

Python ile Deep Reinforcement Learning

Timothée Carayol

Principal Machine Learning Engineer, Komment

Neden aktör-kritik?

REINFORCE sınırlamaları:

- Yüksek varyans

- Düşük örnek verimliliği

Aktör-Kritik yöntemleri bir kritik ağ ekler, Zaman Farkı (TD) öğrenmesini mümkün kılar

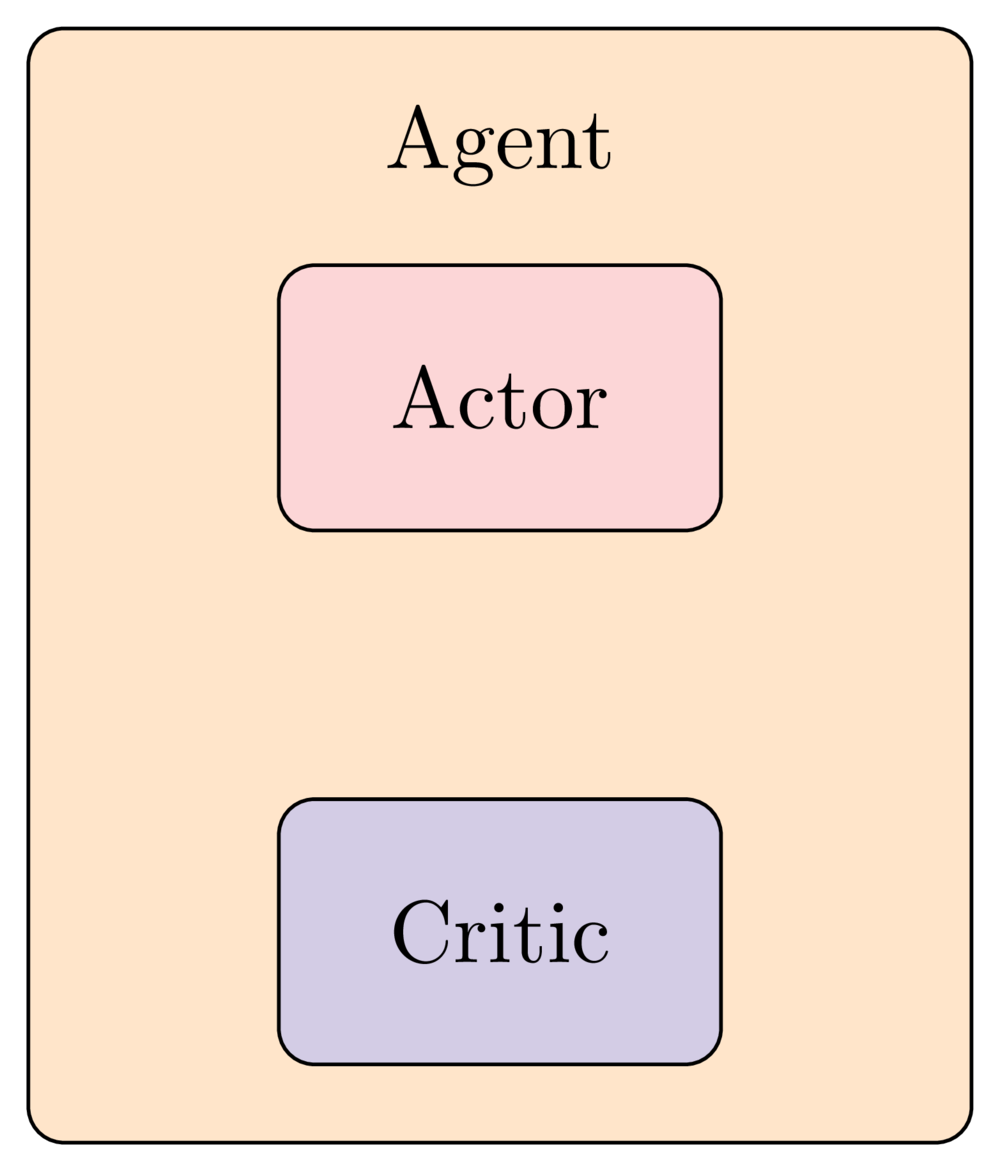

Aktör-Kritik yöntemlerinin sezgisi

Aktör ağı:

- Karar verir

- Değerlendiremez

Kritik ağ:

- Her adımda aktöre geri bildirim sağlar

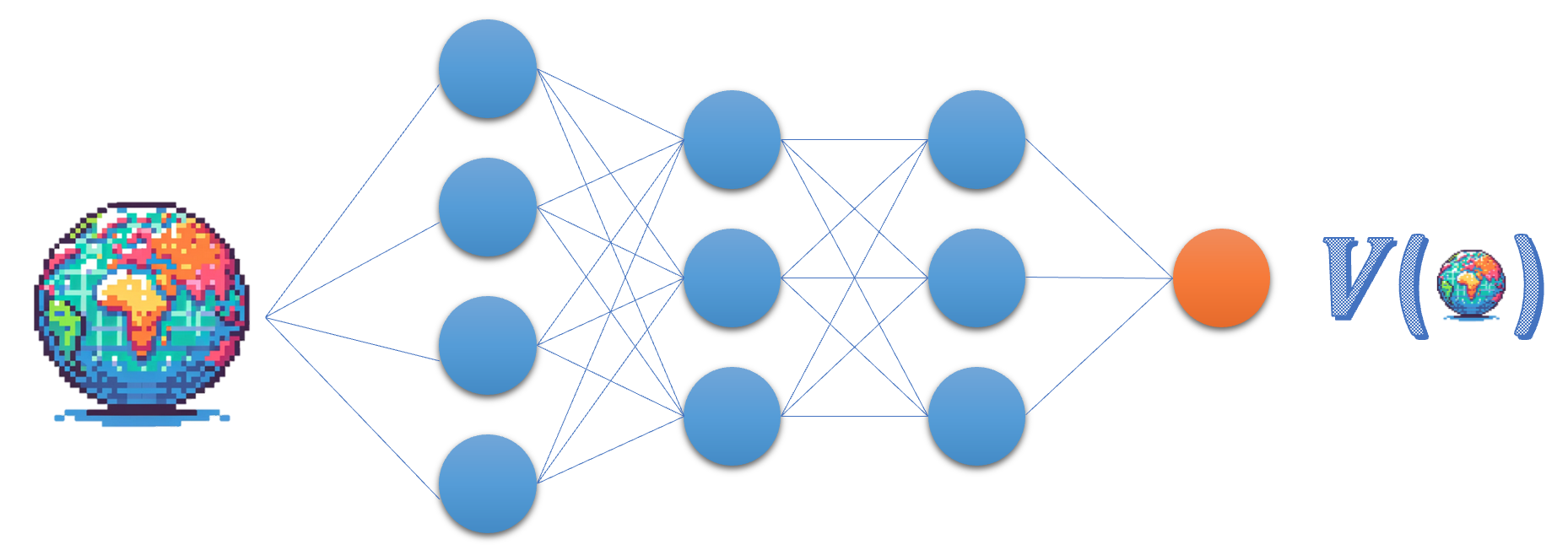

Kritik ağı

- Kritik, durum değer fonksiyonunu yaklaştırır

- Eylem $a_t$’yi avantaj veya TD hatasına göre değerlendirir

class Critic(nn.Module): def __init__(self, state_size): super(Critic, self).__init__() self.fc1 = nn.Linear(state_size, 64) self.fc2 = nn.Linear(64, 1)def forward(self, state): x = torch.relu(self.fc1(torch.tensor(state))) value = self.fc2(x) return valuecritic_network = Critic(8)

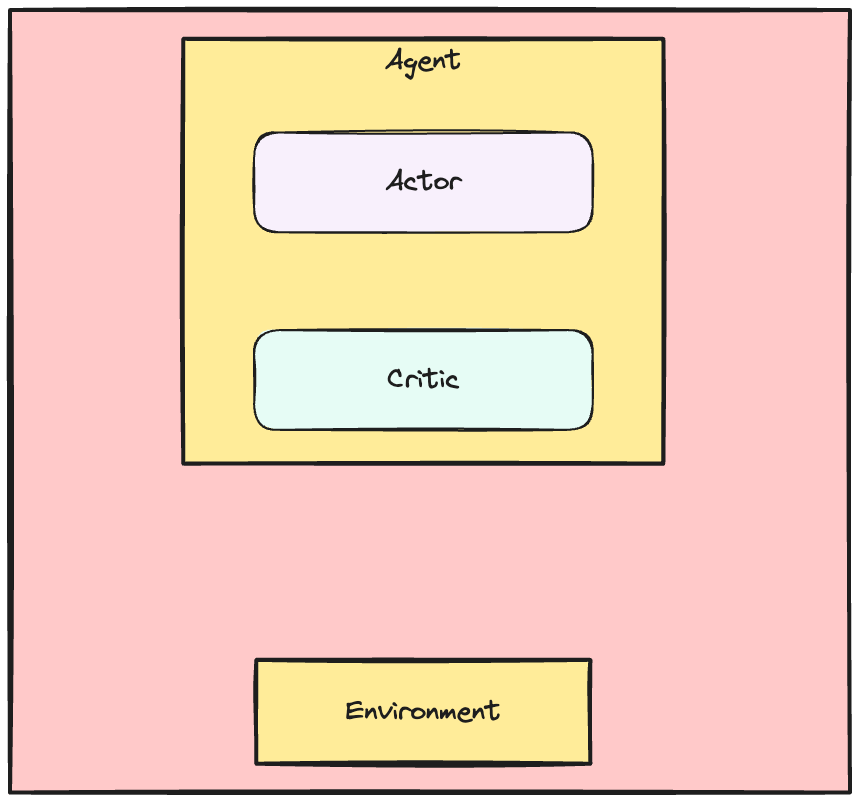

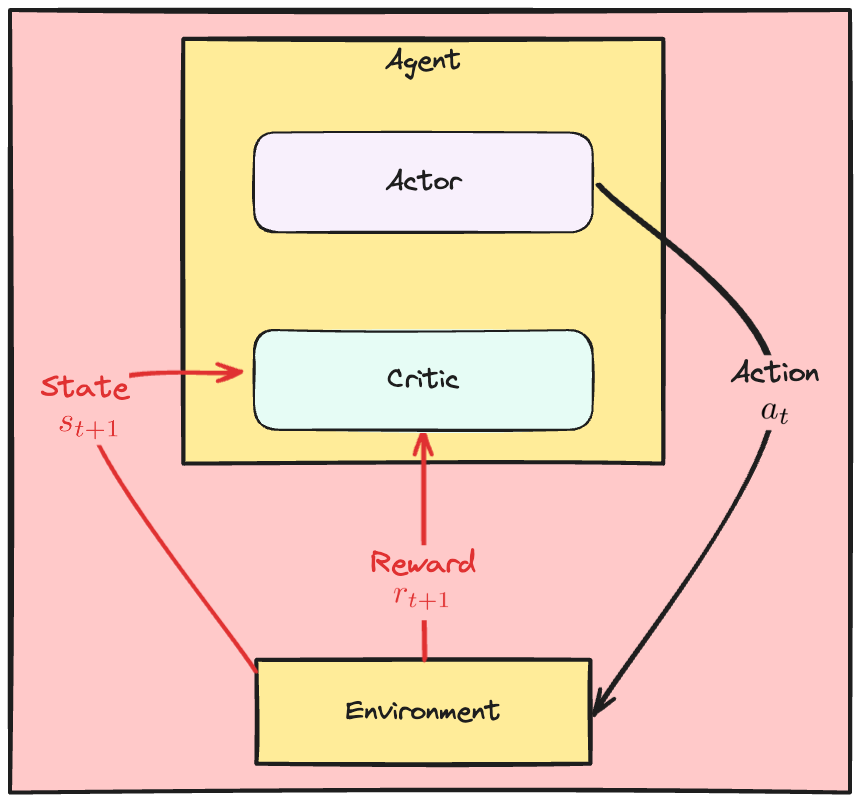

Aktör-Kritik dinamikleri

- Her adımda:

- Aktör eylem seçer (REINFORCE’taki politika ağı ile aynı)

Aktör-Kritik dinamikleri

- Her adımda:

- Aktör eylem seçer (REINFORCE’taki politika ağı ile aynı)

- Kritik ödül ve durumu gözlemler

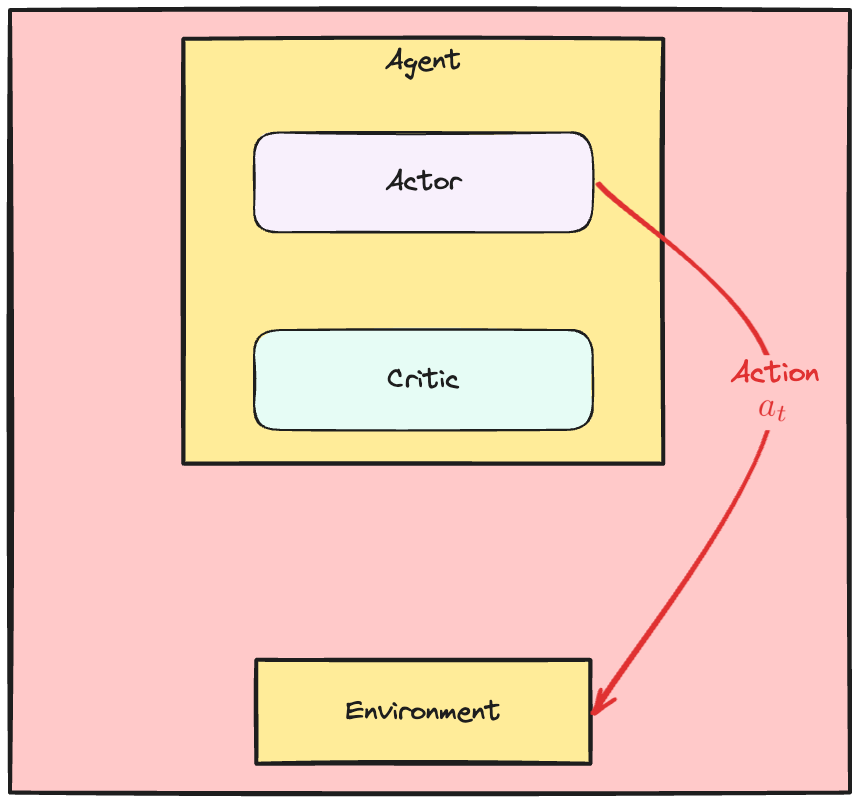

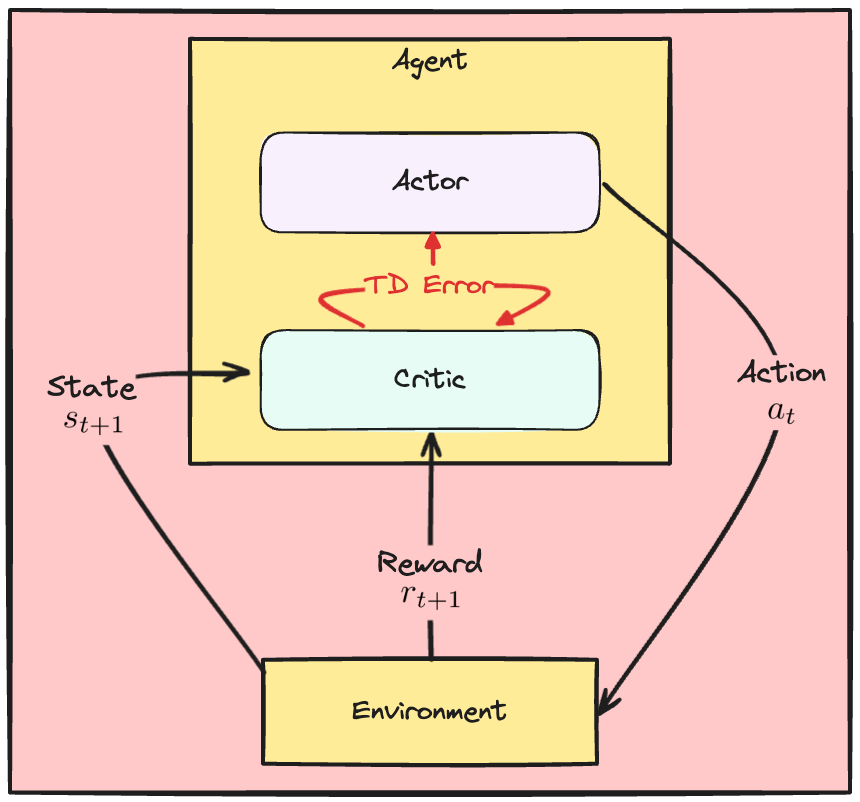

Aktör-Kritik dinamikleri

- Her adımda:

- Aktör eylem seçer (REINFORCE’taki politika ağı ile aynı)

- Kritik ödül ve durumu gözlemler

- Kritik TD hatasını hesaplar

- Aktör ve Kritik, ağırlıkları güncellemek için TD hatasını kullanır

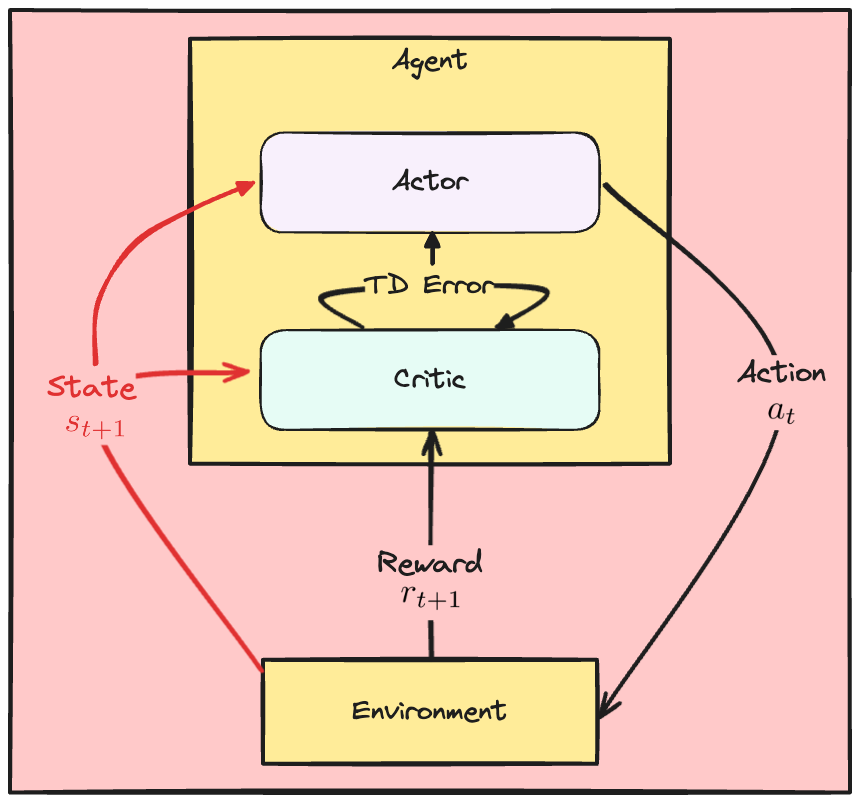

Aktör-Kritik dinamikleri

- Her adımda:

- Aktör eylem seçer (REINFORCE’taki politika ağı ile aynı)

- Kritik ödül ve durumu gözlemler

- Kritik TD hatasını hesaplar

- Aktör ve Kritik, ağırlıkları güncellemek için TD hatasını kullanır

- Güncellenmiş Aktör yeni durumu gözlemler

Aktör-Kritik dinamikleri

- Her adımda:

- Aktör eylem seçer (REINFORCE’taki politika ağı ile aynı)

- Kritik ödül ve durumu gözlemler

- Kritik TD hatasını hesaplar

- Aktör ve Kritik, ağırlıkları güncellemek için TD hatasını kullanır

- Güncellenmiş Aktör yeni durumu gözlemler

- ... başa dönülür

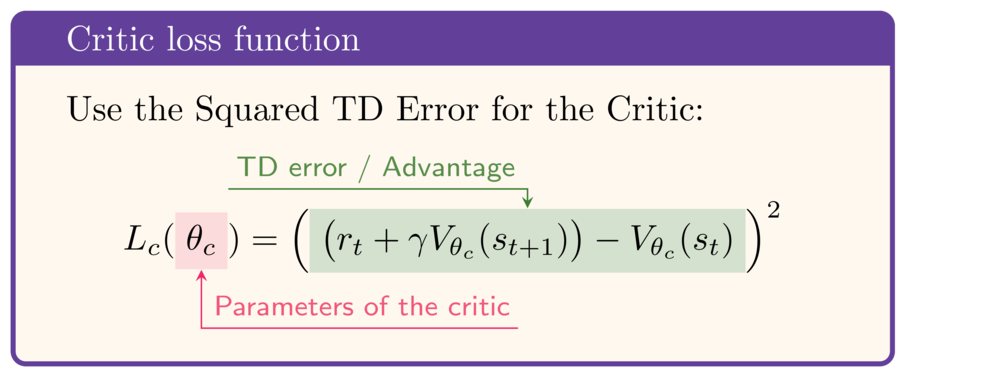

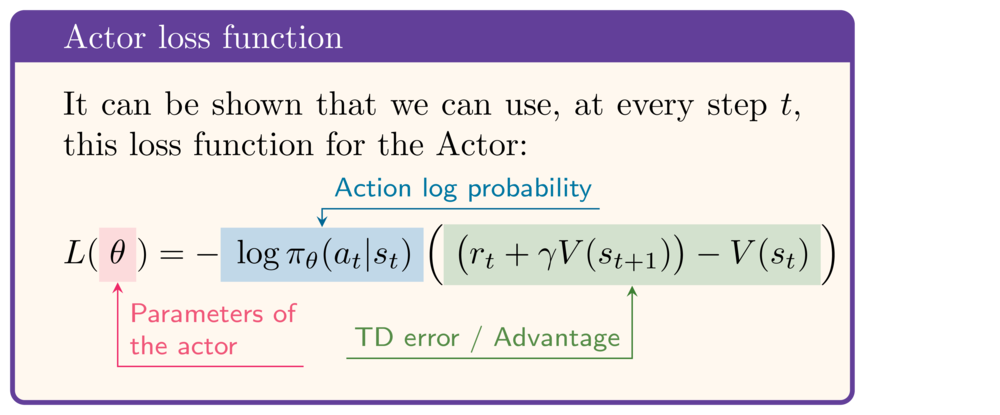

A2C kayıpları

Kritik

- Kritik kaybı: kare TD hatası

Aktör

- TD hatası, kritiğin değerlendirmesini yansıtır

- TD hatası pozitif olan eylemlerin olasılığını artırın

Kayıpların hesaplanması

def calculate_losses(critic_network, action_log_prob, reward, state, next_state, done):# Critic provides the state value estimates value = critic_network(state)next_value = critic_network(next_state)td_target = (reward + gamma * next_value * (1-done))td_error = td_target - value# Apply formulas for actor and critic losses actor_loss = -action_log_prob * td_error.detach()critic_loss = td_error ** 2return actor_loss, critic_loss

- TD Hatasını hesaplayın

- Aktör kaybını hesaplayın

- Gradyanların kritik ağırlıklara gitmesini durdurmak için

.detach()kullanın

- Gradyanların kritik ağırlıklara gitmesini durdurmak için

- Kritik kaybını hesaplayın

Aktör-Kritik eğitim döngüsü

for episode in range(10): state, info = env.reset() done = False while not done:# Select action action, action_log_prob = select_action(actor, state)next_state, reward, terminated, truncated, _ = env.step(action) done = terminated or truncated# Calculate losses actor_loss, critic_loss = calculate_losses(critic, action_log_prob, reward, state, next_state, done)# Update actor actor_optimizer.zero_grad(); actor_loss.backward(); actor_optimizer.step()# Update critic critic_optimizer.zero_grad(); critic_loss.backward(); critic_optimizer.step()state = next_state

Vamos praticar!

Python ile Deep Reinforcement Learning