Politika gradyanı ve REINFORCE

Python ile Deep Reinforcement Learning

Timothée Carayol

Principal Machine Learning Engineer, Komment

DQN ile farklar

- REINFORCE: Monte Carlo, Temporal Difference değil

- Güncelleme her adımda değil, bölüm sonunda

- İstenirse birkaç bölümden sonra güncellenebilir

- Değer fonksiyonu yok

- Hedef ağ yok

- Epsilon-greediness yok

- Deneyim tekrar oynatma yok

REINFORCE eğitim döngüsü yapısı

for episode in range(num_episodes):# 1. Bölümü başlatwhile not done:# 2. Eylem seç# 3. Eylemi oyna, sonraki durum ve ödülü al# 4. (İskontolu) ödülü getirime ekle# 5. Durumu güncelle# 6. Kayıp hesapla# 7. Politika ağını gradyan inişiyle güncelle

Eylem seçimi

from torch.distributions import Categorical def select_action(policy_network, state): action_probs = policy_network(state)action_dist = Categorical(action_probs)action = action_dist.sample()log_prob = action_dist.log_prob(action)return action.item(), log_prob.reshape(1)action, log_prob = select_action( policy_network, state)

- Olasılıkları ağdan al

- Bir eylem örnekle

- Eylem ve ilgili log-olasılığı döndür

Örneklenen eylem indeksi: 1

Örneklenen eylemin log olasılığı: -1.38

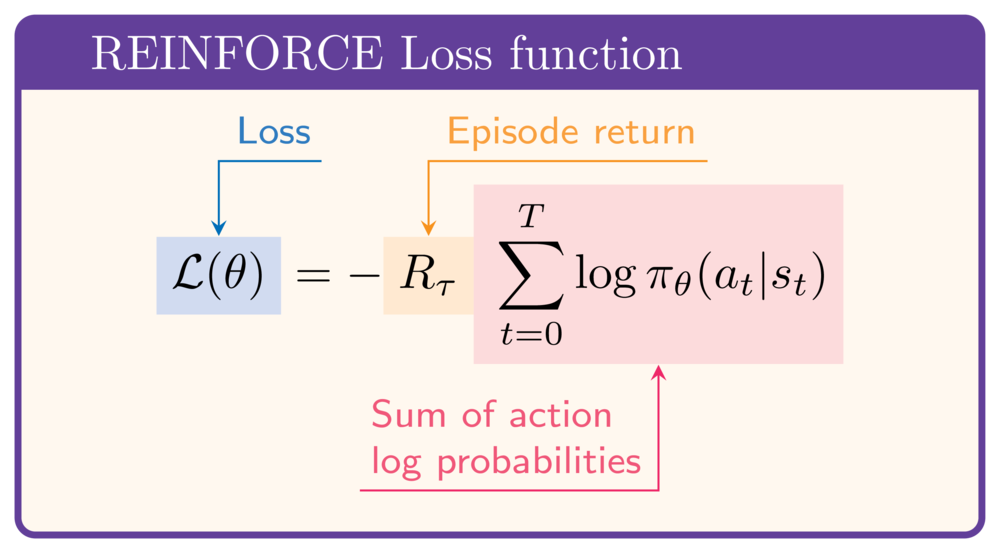

Kayıp hesaplama

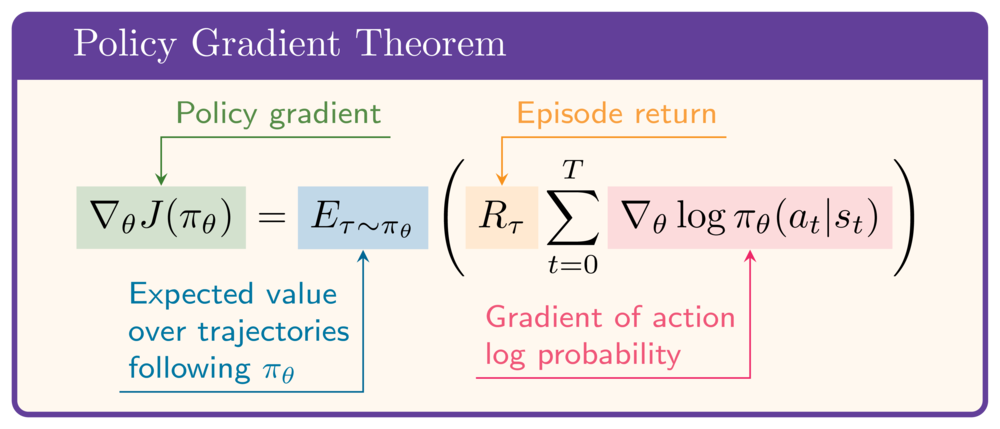

Politika gradyanı teoremine dönelim:

Python'da:

- $R_{\tau}$,

episode_return - $\log\pi_\theta(a_t|s_t)$ vektörü,

episode_log_probs

loss = -episode_return * episode_log_probs.sum()

REINFORCE eğitim döngüsü

for episode in range(50): state, info = env.reset(); done = False; step = 0; episode_log_probs = torch.tensor([])R = 0while not done: step += 1 action, log_prob = select_action(policy_network, state)next_state, reward, terminated, truncated, _ = env.step(action) done = terminated or truncatedR += (gamma ** step) * rewardepisode_log_probs = torch.cat((episode_log_probs, log_prob))state = next_stateloss = - R * episode_log_probs.sum()optimizer.zero_grad(); loss.backward(); optimizer.step()

Haydi pratik yapalım!

Python ile Deep Reinforcement Learning