Scikit-Learn'de Rastgele Arama

Python'da Hiperparametre Ayarlama

Alex Scriven

Data Scientist

GridSearchCV ile karşılaştırma

Tekerleği yeniden icat etmeye gerek yok. Grid Search adımlarını hatırlayalım:

- Bir algoritma/tahminleyici seçin

- Ayarlanacak hiperparametreleri belirleyin

- Her hiperparametre için bir değer aralığı belirleyin

- Bir çapraz doğrulama düzeni belirleyin; ve

- Bir skor fonksiyonu belirleyin

- Ek yararlı bilgi veya işlevler ekleyin

Grid Search ile karşılaştırma

Yalnızca bir fark var:

- Adım 7 = Kaç örnek alınacağını belirleyin (sonra örnekleyin)

Hepsi bu! (çoğunlukla)

Scikit-Learn Modüllerini Karşılaştırma

Modüller de benzer:

GridSearchCV:

sklearn.model_selection.GridSearchCV(estimator, param_grid,

scoring=None, fit_params=None,

n_jobs=None,

refit=True, cv='warn', verbose=0,

pre_dispatch='2*n_jobs',

error_score='raise-deprecating',

return_train_score='warn')

RandomizedSearchCV:

sklearn.model_selection.RandomizedSearchCV(estimator,

param_distributions, n_iter=10,

scoring=None, fit_params=None,

n_jobs=None, refit=True,

cv='warn', verbose=0,

pre_dispatch='2*n_jobs',

random_state=None,

error_score='raise-deprecating',

return_train_score='warn')

Temel farklar

İki temel fark:

n_iter, rastgele aramanın ızgaranızdan alacağı örnek sayısıdır. Önceki örnekte 300 yaptınız.param_distributions,param_grid'den biraz farklıdır; örnekleme için dağılım tanımlamaya olanak tanır.- Varsayılan olarak tüm kombinasyonların seçilme olasılığı eşittir.

RandomizedSearchCV Nesnesi Oluşturma

Şimdi küçük farkımızla, ızgara aramadaki gibi bir rastgele arama nesnesi oluşturabiliriz:

# Set up the sample space learn_rate_list = np.linspace(0.001,2,150) min_samples_leaf_list = list(range(1,51)) # Create the grid parameter_grid = { 'learning_rate' : learn_rate_list, 'min_samples_leaf' : min_samples_leaf_list}# Define how many samples number_models = 10

RandomizedSearchCV Nesnesi Oluşturma

Şimdi nesneyi oluşturabiliriz

# Create a random search object

random_GBM_class = RandomizedSearchCV(

estimator = GradientBoostingClassifier(),

param_distributions = parameter_grid,

n_iter = number_models,

scoring='accuracy',

n_jobs=4,

cv = 10,

refit=True,

return_train_score = True)

# Fit the object to our data

random_GBM_class.fit(X_train, y_train)

Çıktıyı analiz etme

Çıktı birebir aynıdır!

Hangi hiperparametre değerlerinin seçildiğini nasıl görürüz?

cv_results_ sözlüğünde (ilgili param_ sütunlarında)!

Listeleri çıkarın:

rand_x = list(random_GBM_class.cv_results_['param_learning_rate'])

rand_y = list(random_GBM_class.cv_results_['param_min_samples_leaf'])

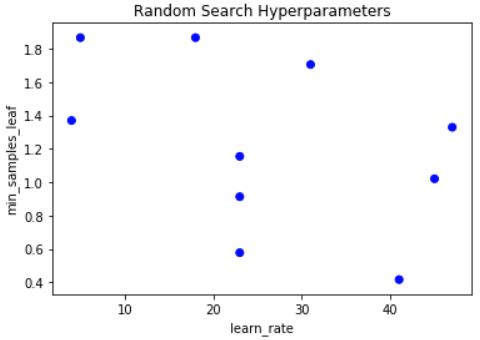

Çıktıyı analiz etme

Görselleştirmeyi oluşturalım:

# Make sure we set the limits of Y and X appriately x_lims = [np.min(learn_rate_list), np.max(learn_rate_list)] y_lims = [np.min(min_samples_leaf_list), np.max(min_samples_leaf_list)]# Plot grid results plt.scatter(rand_y, rand_x, c=['blue']*10) plt.gca().set(xlabel='learn_rate', ylabel='min_samples_leaf', title='Random Search Hyperparameters') plt.show()

Çıktıyı analiz etme

Öncekine benzer bir grafik:

Haydi pratik yapalım!

Python'da Hiperparametre Ayarlama