Ödül modellerine genel bakış

İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)

Mina Parham

AI Engineer

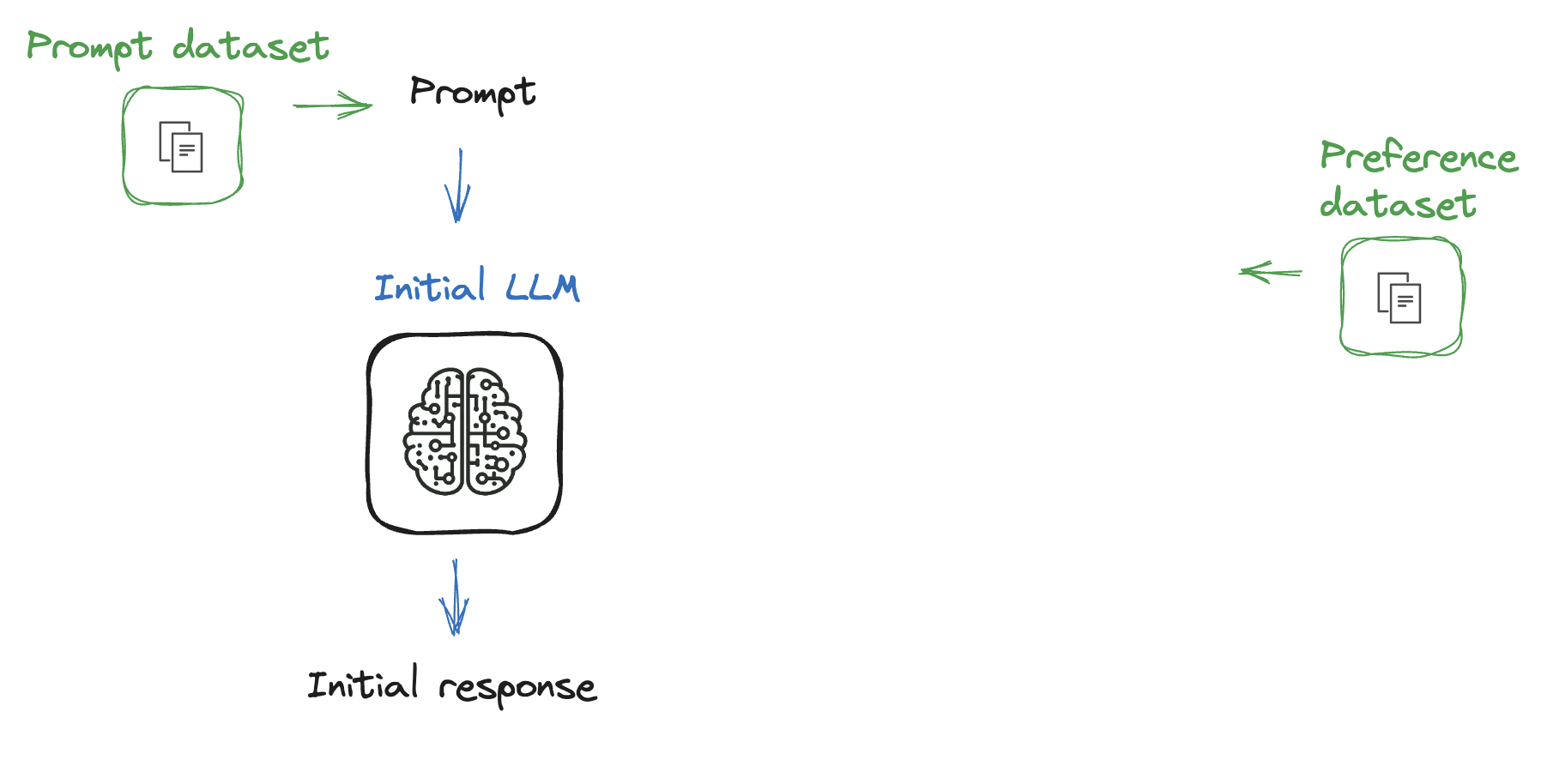

Şu ana kadarki süreç

Şu ana kadarki süreç

Ödül modeli nedir?

Ödül modeli nedir?

- Model, ajanı bilgilendirir

- Ajan, ödülü en üst düzeye çıkarmak için modeli değerlendirir

Reward trainer kullanımı

from trl import RewardTrainer, RewardConfigfrom transformers import AutoModelForSequenceClassification, AutoTokenizerfrom datasets import load_dataset

# Önceden eğitilmiş modeli ve belirteçleyiciyi yükleyin model = AutoModelForSequenceClassification.from_pretrained("gpt2", num_labels=1) tokenizer = AutoTokenizer.from_pretrained("gpt2")# Gerekli biçimde veri kümesini yükleyin dataset = load_dataset("path/to/dataset")

Ödül modelini eğitme

# Eğitim argümanlarını tanımlayın training_args = RewardConfig(output_dir="path/to/output/dir",per_device_train_batch_size=8, per_device_eval_batch_size=8,num_train_epochs=3,learning_rate=1e-3)

Ödül modelini eğitme

# RewardTrainer'ı başlatın

trainer = RewardTrainer(

model=model,

args=training_args,

train_dataset=dataset["train"],

eval_dataset=dataset["validation"],

tokenizer=tokenizer,

)

# Ödül modelini eğitin

trainer.train()

Hadi pratik yapalım!

İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)