RLHF'te verimli ince ayar

İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)

Mina Parham

AI Engineer

Parametre-verimli ince ayar

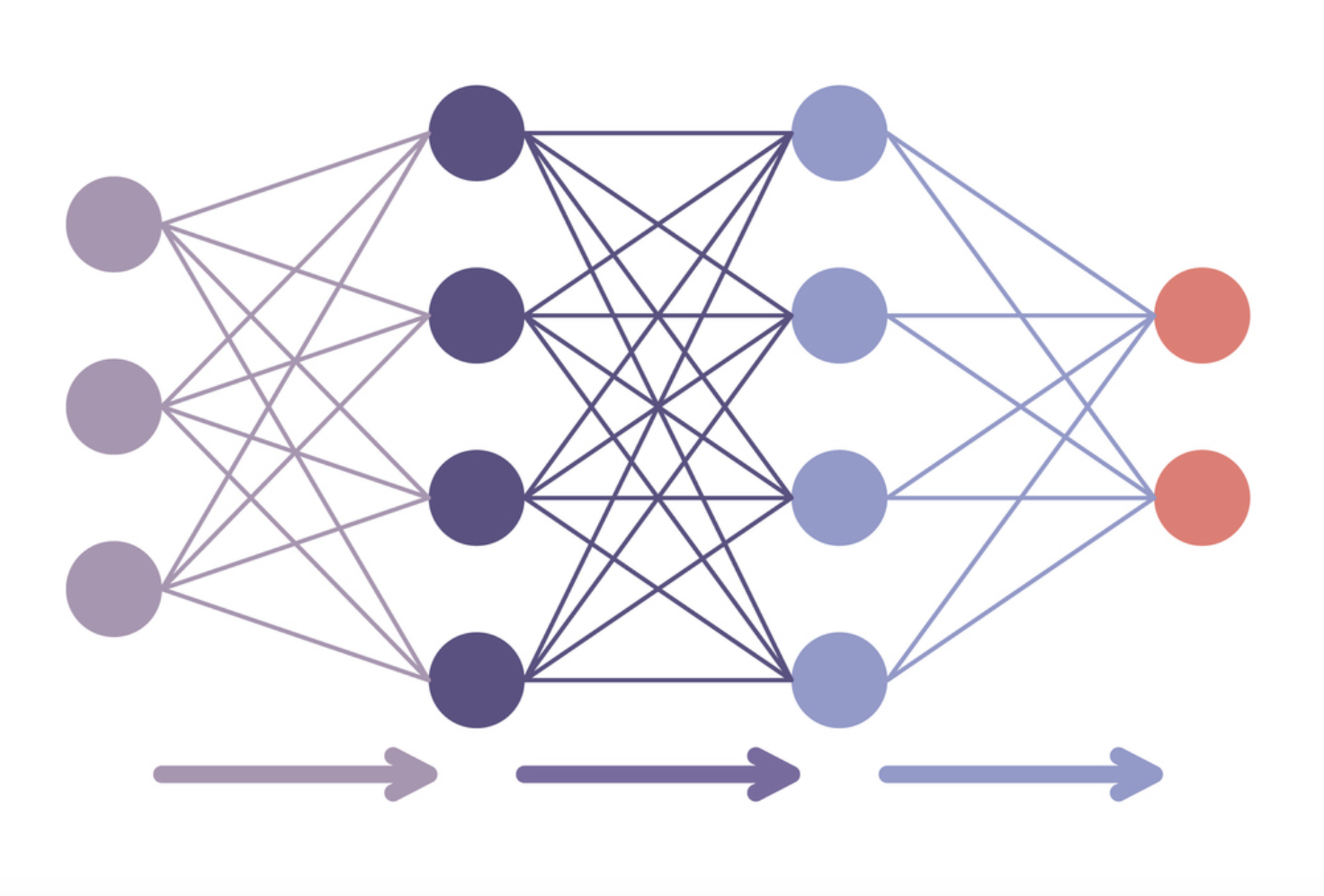

- Tüm modeli ince ayarlama

Parametre-verimli ince ayar

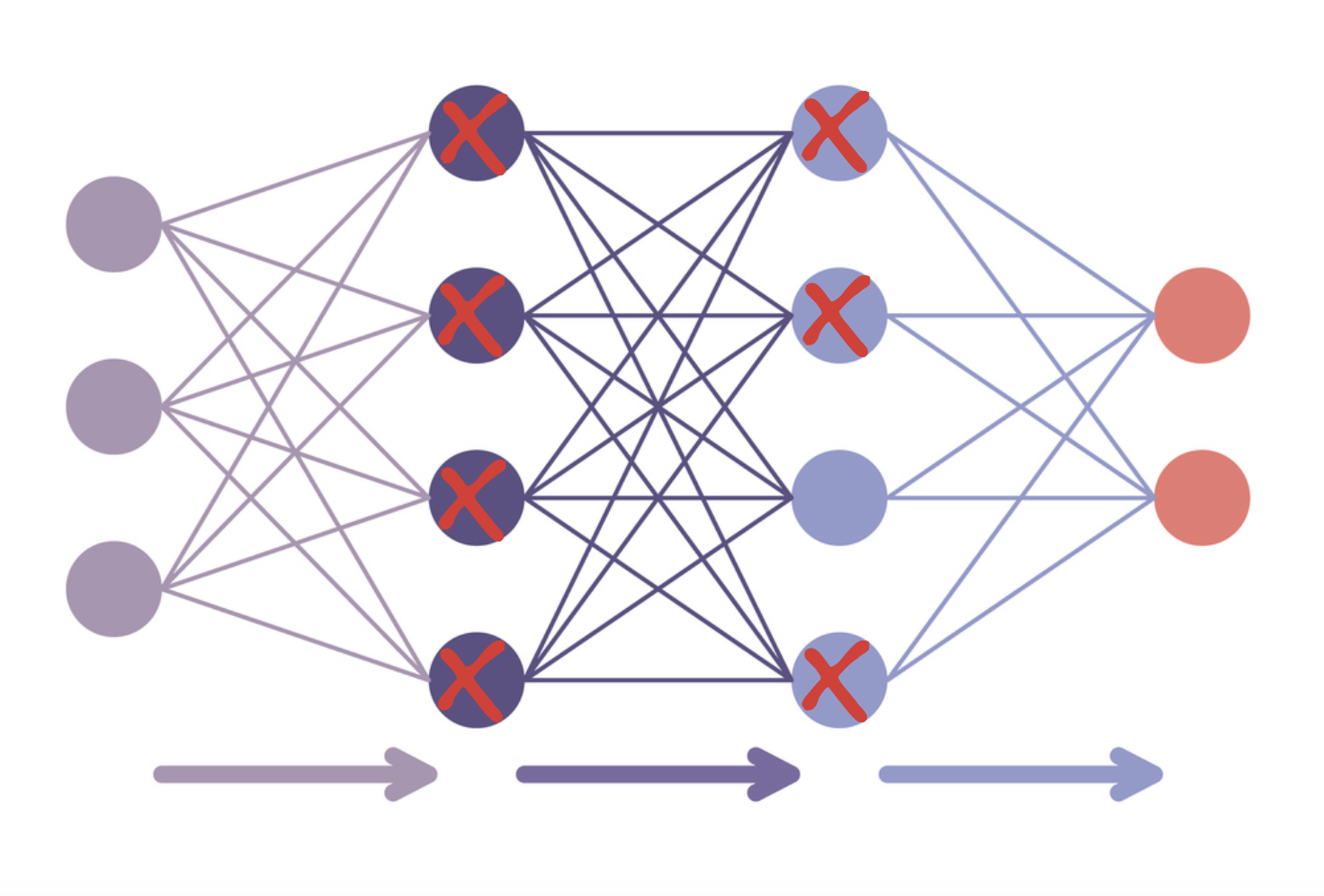

- PEFT ile ince ayar

- LoRA: yalnızca birkaç katmanı ayarlar

- Kuantizasyon: veri türü hassasiyetini düşürür

Adım 1: etkin modeli 8-bit hassasiyetle yükleyin

from peft import prepare_model_for_int8_trainingpretrained_model = AutoModelForCausalLM.from_pretrained( model_name, load_in_8bit=True )pretrained_model_8bit = prepare_model_for_int8_training(pretrained_model)

Adım 2: peft ile ek eğitilebilir adaptörler ekleyin

from peft import LoraConfig, get_peft_modelconfig = LoraConfig(r=32, # Rank of the low-rank matriceslora_alpha=32, # Scaling factor for the LoRA updateslora_dropout=0.1, # Dropout rate for LoRA layersbias="lora_only"# Only update bias terms for LoRA layers, others remain frozen)lora_model = get_peft_model(pretrained_model_8bit, config) model = AutoModelForCausalLMWithValueHead.from_pretrained(lora_model)

Adım 3: başvuru ve etkin logitler için tek model kullanın

ppo_trainer = PPOTrainer(

config, # The config we just defined

model, # Our PPO model

ref_model=None,

tokenizer=tokenizer,

dataset=dataset,

data_collator=collator,

optimizer=optimizer

)

Hadi pratik yapalım!

İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)