Önceden eğitilmiş LLM’leri keşfetme

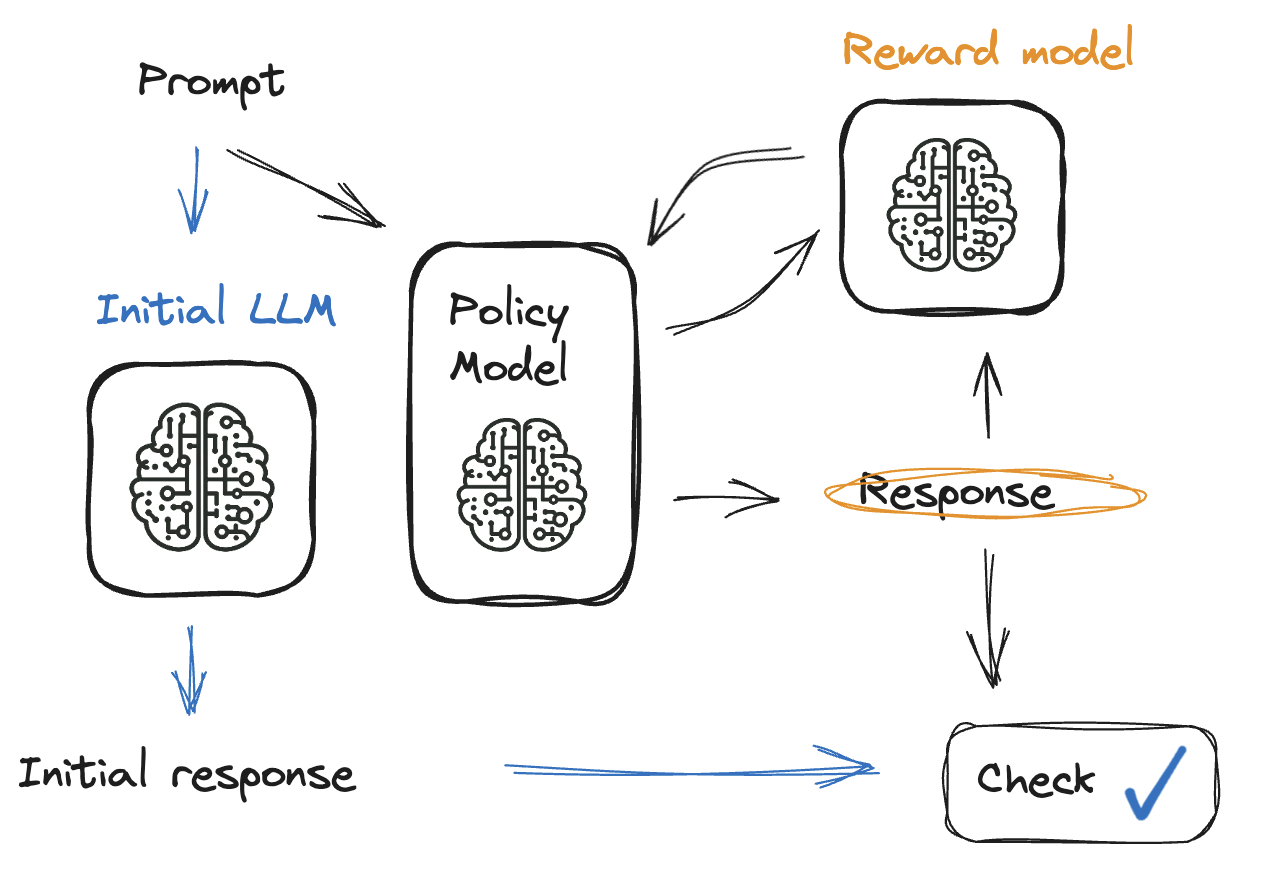

İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)

Mina Parham

AI Engineer

İnce ayarın önemi

İnce ayarın önemi

Bir LLM’yi ince ayarlamaya adım adım rehber

Bir LLM’yi ince ayarlamaya adım adım rehber

Bir LLM’yi ince ayarlamaya adım adım rehber

Adım 1: Kullanılacak veriyi yükleme

from datasets import load_dataset

import pandas as pd

# `load_dataset`, farklı kaynaklardan veri kümelerini yükleme ve ön işlemeyi kolaylaştırır

# Minimum kurulumla çok sayıda veri kümesine kolay erişim sağlar

dataset = load_dataset("mteb/tweet_sentiment_extraction")

df = pd.DataFrame(dataset['train'])

id text label label_text

0 cb774db0d1 I'd have responded, if I were going 1 neutral

1 549e992a42 Sooo SAD I will miss you in San Diego!!! 0 negative

2 08ac60f138 my boss is bullying me... 0 negative

Adım 2: Önceden eğitilmiş bir model seçme

from transformers import AutoModelForCausalLM

# AutoModelForCausalLM, modelleri yükleme ve değiştirmeyi kolaylaştırır

model = AutoModelForCausalLM.from_pretrained("openai-gpt")

- Nedensel modeller: önceki belirteçler sonrakileri “nedenler”

Adım 3: Belirteçleyici (tokenizer)

from transformers import AutoTokenizer

# `AutoTokenizer`, belirtilen model için doğru belirteçleyiciyi yükler

tokenizer = AutoTokenizer.from_pretrained("openai-gpt")

tokenizer.add_special_tokens({'pad_token': '[PAD]'})

model.resize_token_embeddings(len(tokenizer))

- Doldurma (padding): eşit boyutlu metin yığınları için

Adım 3: Belirteçleyici (tokenizer)

def tokenize_function(examples):

tokenized = tokenizer(examples["content"], padding="max_length", truncation=True)

return tokenized

tokenized_datasets = dataset.map(tokenize_function, batched=True)

- Batched parametresi: daha hızlı işleme için

Adım 4: Trainer yöntemiyle ince ayar

training_args = TrainingArguments(

output_dir="test_trainer",

per_device_train_batch_size=1,

per_device_eval_batch_size=1,

gradient_accumulation_steps=4)

trainer = Trainer(

model=model,

args=training_args,

train_dataset=tokenized_dataset["train"],

eval_dataset=tokenized_dataset["test"])

trainer.train()

Haydi pratik yapalım!

İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)