RLHF'ye Giriş

İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)

Mina Parham

AI Engineer

Kursa hoş geldiniz!

- Eğitmen: Mina Parham

- Yapay Zekâ Mühendisi

- Büyük Dil Modelleri (LLM'ler)

- İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)

- Konu: İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)

Kursa hoş geldiniz!

- Eğitmen: Mina Parham

- Yapay Zekâ Mühendisi

- Büyük Dil Modelleri (LLM'ler)

- İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)

- Konu: İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)

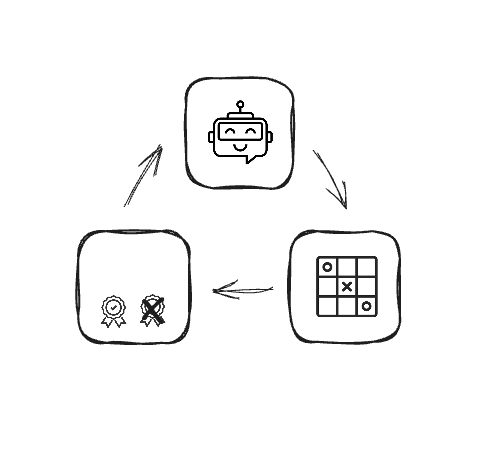

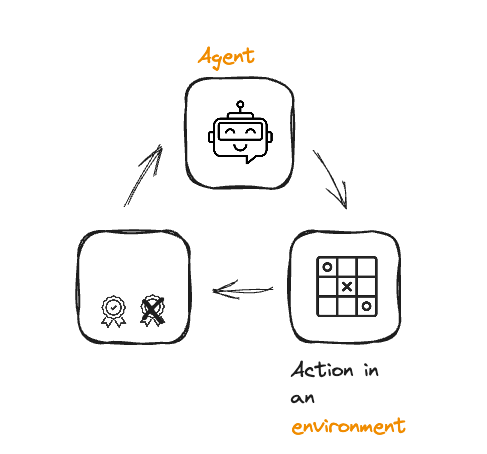

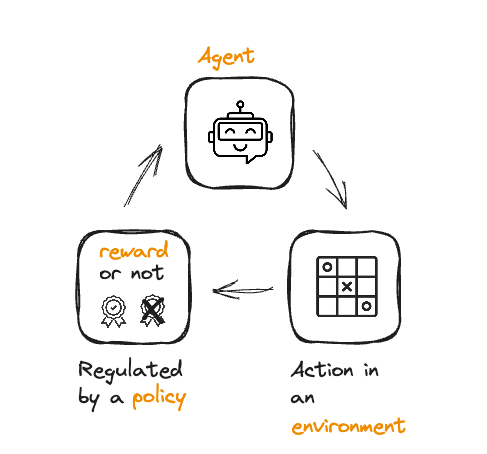

Pekiştirmeli öğrenme özeti

Pekiştirmeli öğrenme özeti

Pekiştirmeli öğrenme özeti

Pekiştirmeli öğrenme özeti

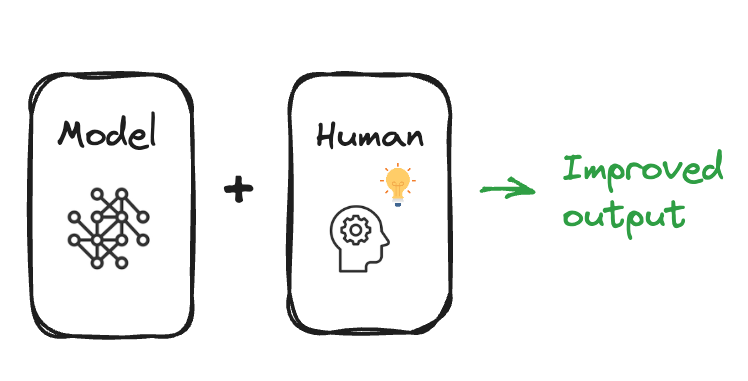

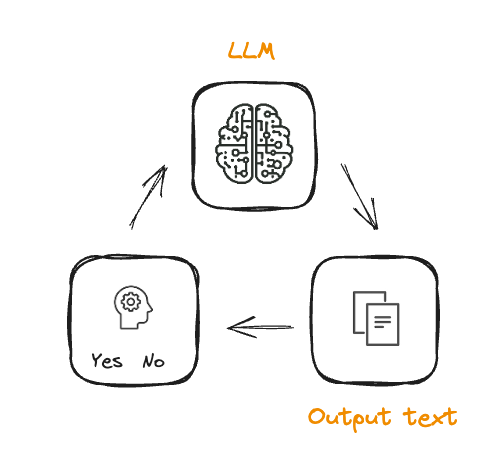

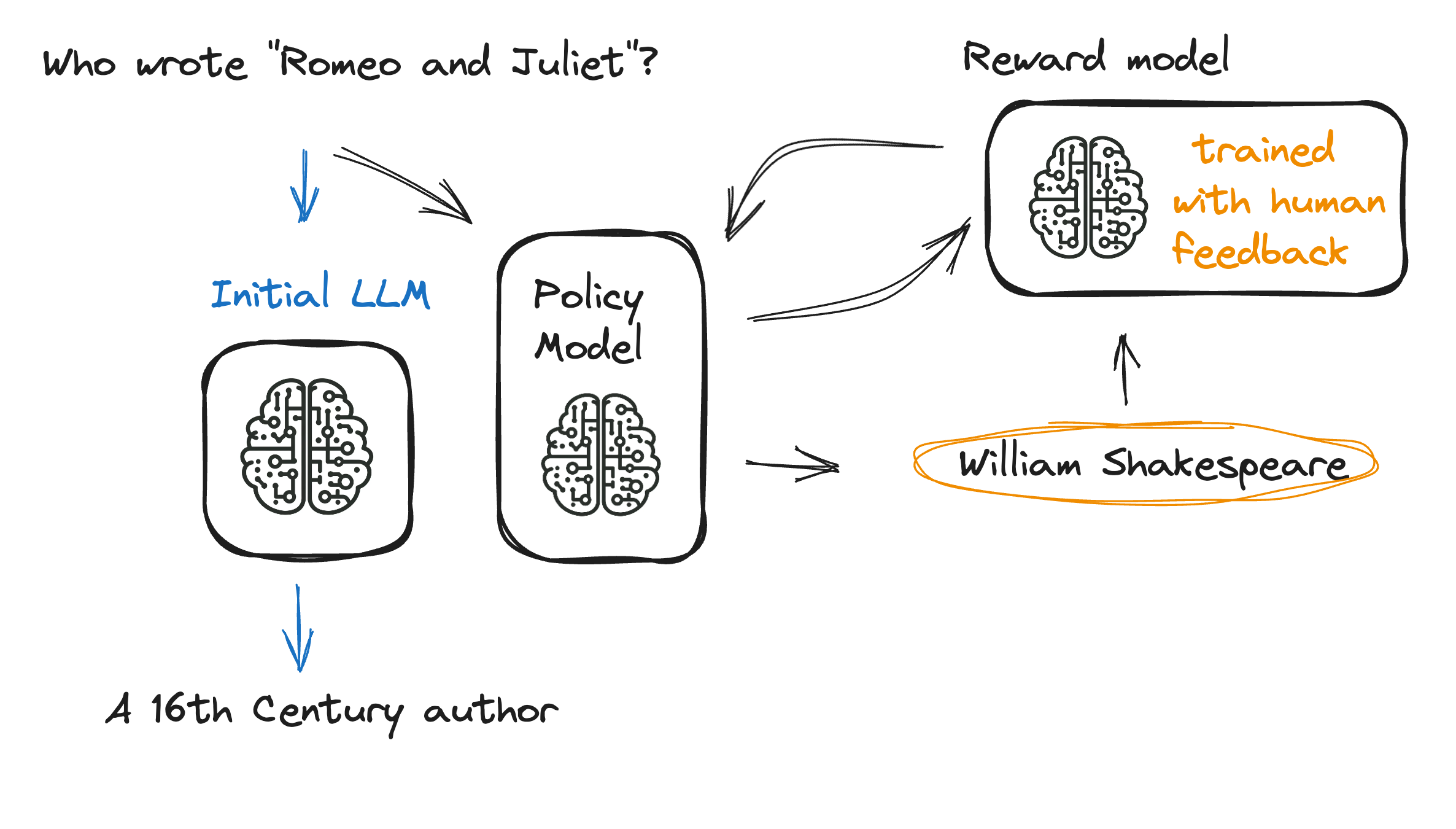

RL'den RLHF'ye

RL'den RLHF'ye

RL'den RLHF'ye

- Ödül modeli eğitimi

- İnsan tercihleriyle hizalama

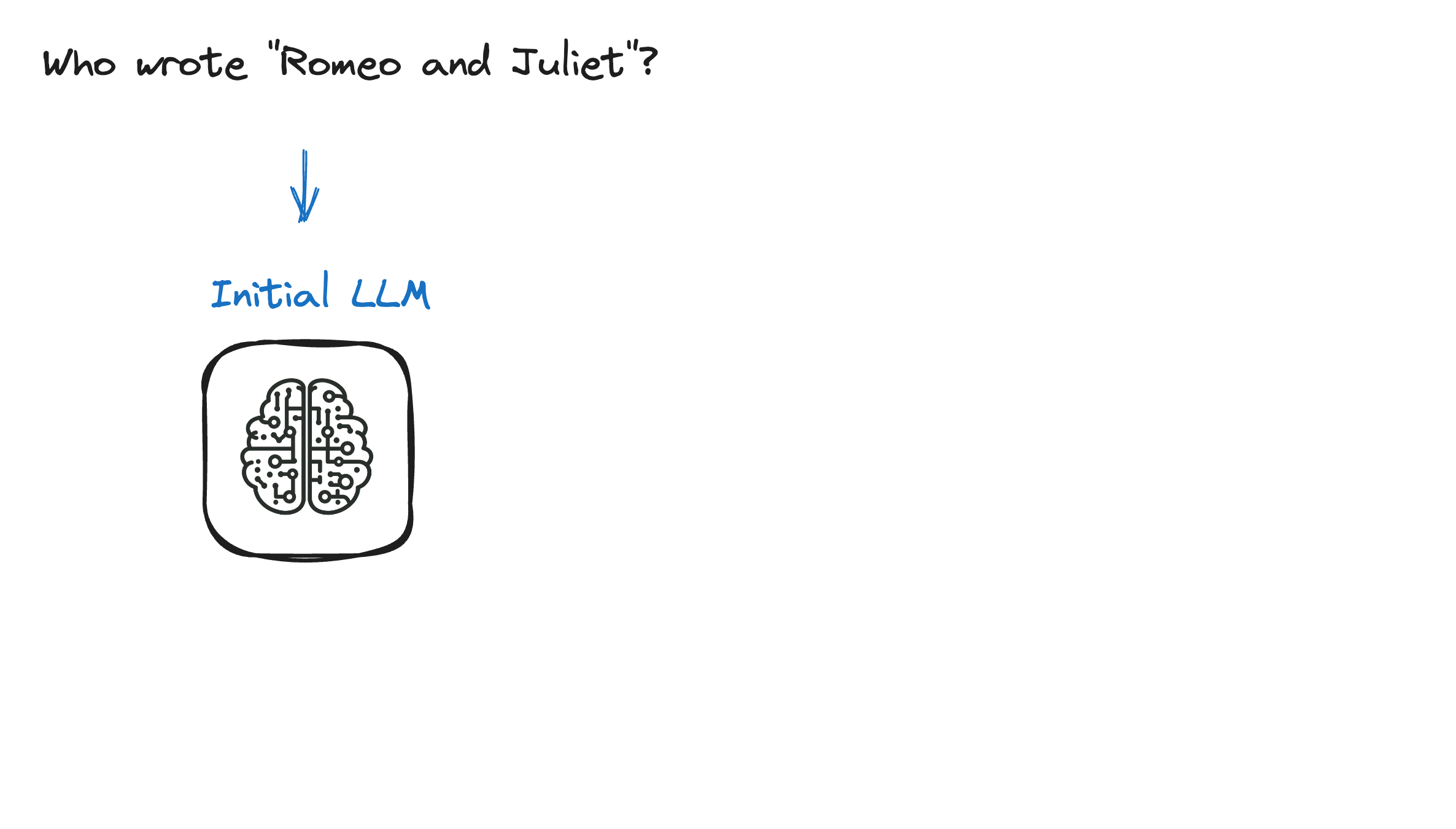

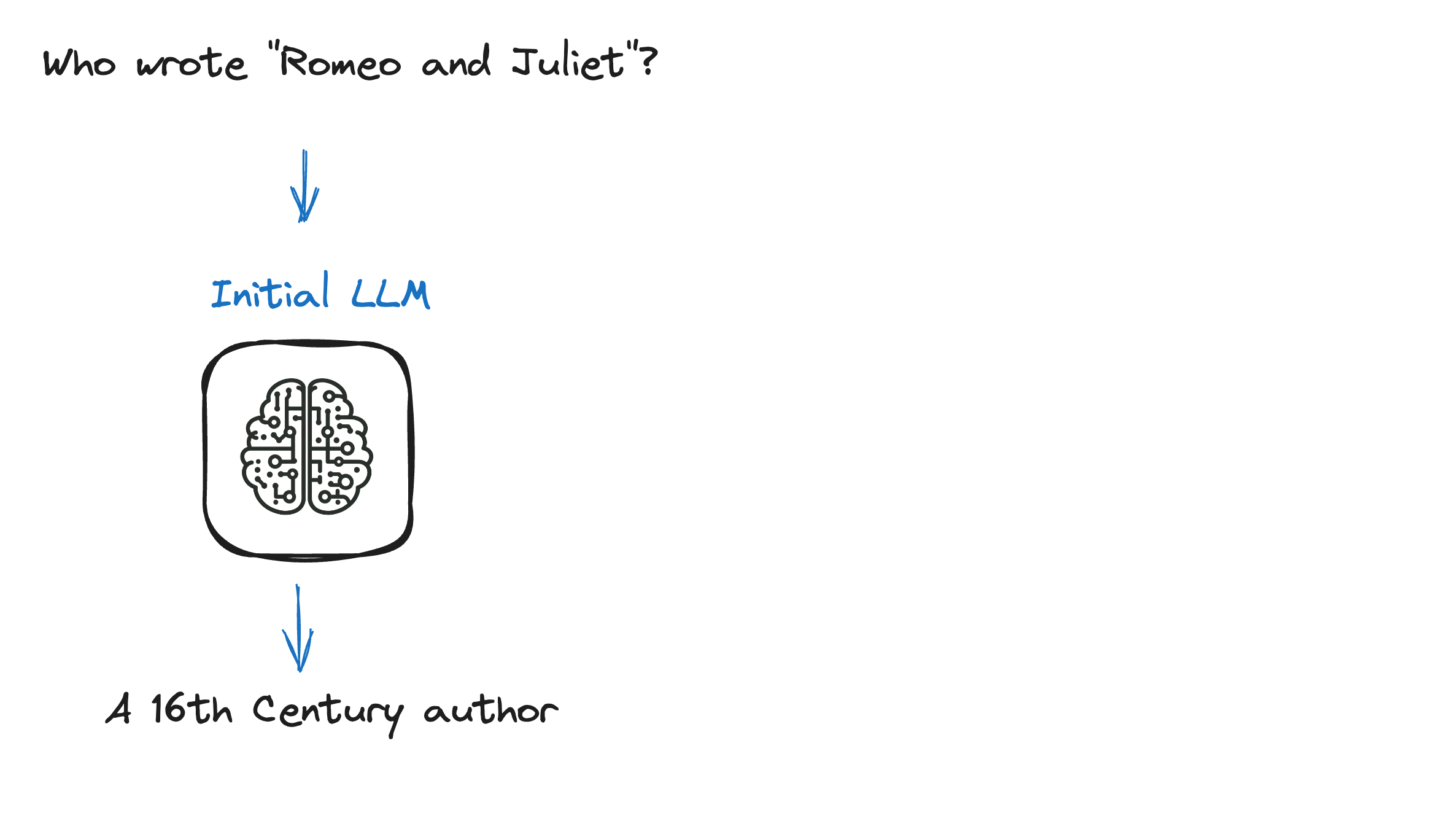

RLHF'de LLM ince ayarı

RLHF'de LLM ince ayarı

- Başlangıç LLM eğitimi

Tam RLHF süreci

Tam RLHF süreci

Tam RLHF süreci

Tam RLHF süreci

Tam RLHF süreci

Tam RLHF süreci

RLHF ile ayarlı LLM'lerle etkileşim

- Hugging Face'de önceden eğitilmiş RLHF modelleri 🤗

from transformers import pipelinetext_generator = pipeline('text-generation', model='lvwerra/gpt2-imdb-pos-v2')# Provide a review prompt review_prompt = "This is definitely a" # Generate the continuation output = text_generator(review_prompt, max_length=50) #Print the generated text print(output[0]['generated_text'])

This is definitely a crucial improvement.

RLHF ile ayarlı LLM'lerle etkileşim

from transformers import pipeline, AutoModelForSequenceClassification, AutoTokenizer# Instantiate the pre-trained model and tokenizer model = AutoModelForSequenceClassification.from_pretrained("lvwerra/distilbert-imdb") tokenizer = AutoTokenizer.from_pretrained("lvwerra/distilbert-imdb")# Use pipeline to create the sentiment analyzer sentiment_analyzer = pipeline('sentiment-analysis', model=model, tokenizer=tokenizer) # Pass the text to the sentiment analyzer and print the result sentiment = sentiment_analyzer("This is definitely a crucial improvement.")print(f"Sentiment Analysis Result: {sentiment}")

positive

Hadi pratik yapalım!

İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)