PPO ile eğitim

İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)

Mina Parham

AI Engineer

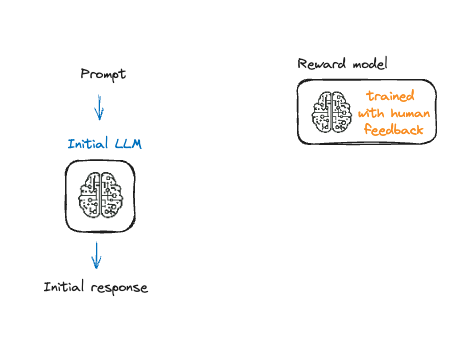

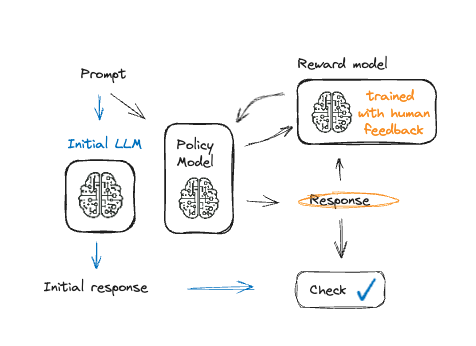

Pekiştirmeli öğrenme ile ince ayar

Pekiştirmeli öğrenme ile ince ayar

PPO ile Dil Modelini İnce Ayarlama

PPO ile Dil Modelini İnce Ayarlama

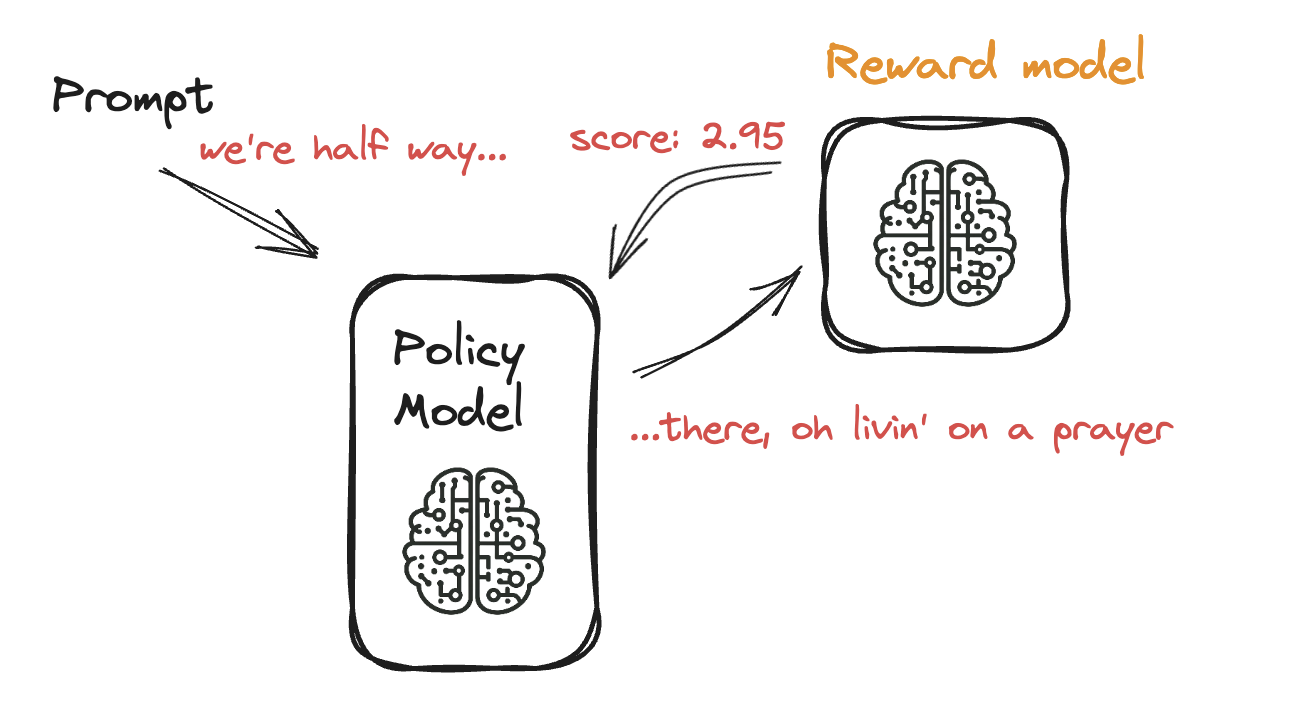

PPO ile Dil Modelini İnce Ayarlama

PPO ile Dil Modelini İnce Ayarlama

- PPO: modele kademeli ayarlama

- Geri bildirime aşırı uyumu önler

TRL ile PPOTrainer uygulama

from trl import PPOConfig

config = PPOConfig(model_name="gpt2",learning_rate=1.4e-5)

from trl import AutoModelForCausalLMWithValueHead

model = AutoModelForCausalLMWithValueHead.from_pretrained(config.model_name)

tokenizer = AutoTokenizer.from_pretrained(config.model_name)

from trl import PPOTrainer

ppo_trainer = PPOTrainer(model=model,config=config,dataset=dataset,

tokenizer=tokenizer)

Eğitim döngüsünü başlatma

for epoch in tqdm(range(10), "epoch: "):for batch in tqdm(ppo_trainer.dataloader):# Get responses response_tensors = ppo_trainer.generate(batch["input_ids"])batch["response"] = [tokenizer.decode(r.squeeze()) for r in response_tensors]# Compute reward score texts = [q + r for q, r in zip(batch["query"], batch["response"])]rewards = reward_model(texts)stats = ppo_trainer.step(query_tensors, response_tensors, rewards) ppo_trainer.log_stats(stats, batch, rewards)

Hadi pratik yapalım!

İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)