Model ölçütleri ve ayarlamalar

İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)

Mina Parham

AI Engineer

Neden bir referans modeli kullanılır?

- Anlamsız çıktılar

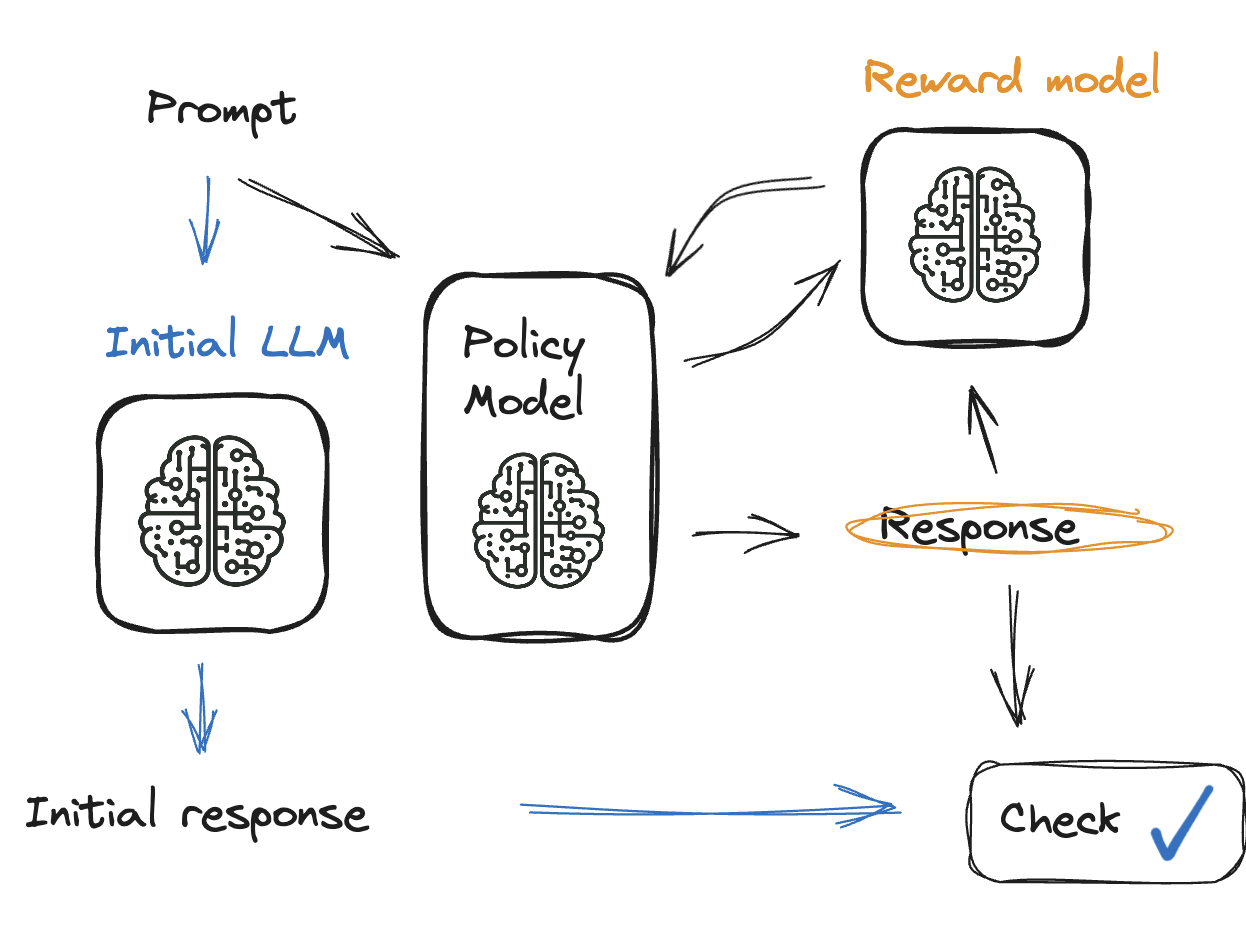

Model çıktısını kontrol etme

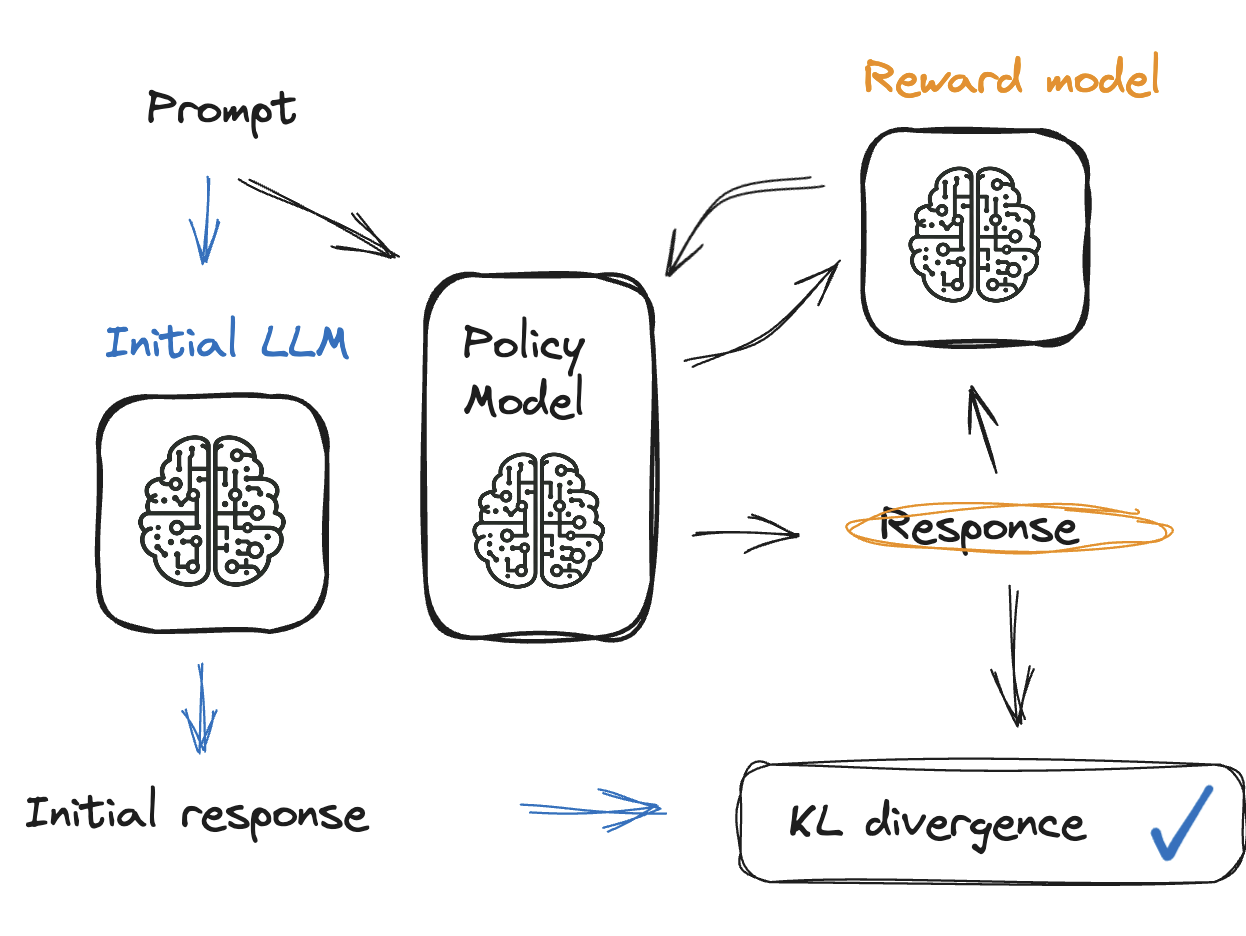

Çözüm: KL ayrışımı

Çözüm: KL ayrışımı

- Ceza, ödül modeline eklenir

- Model ilgisiz çıktılar üretirse ceza onu yönlendirir

- KL ayrışımı, mevcut modelle ödül modelini karşılaştırır

- 0 ile 10 arasında, asla negatif değil

Parametreleri ayarlama

generation_kwargs = {"min_length": -1, # don't ignore the EOS token"top_k": 0.0, # no top-k sampling"top_p": 1.0, "do_sample": True, "pad_token_id": tokenizer.eos_token_id, "max_new_tokens": 32}

- Parametreler politika modeline aktarılır

Ödül modelini kontrol etme

Ödül modelini kontrol etme

Çıktıyı (ödül) kontrol etme

reward_model_results.head()

|ID | Yorum |Duygu |Ödül |

|---|----------------------------------------------|----------|-----|

| 1 | Bu etkinlik harikaydı! Çok eğlendim! | Pozitif | 0.9 |

| 2 | Berbat bir deneyim, bir daha gelmem. | Negatif | -0.8|

| 3 | Fena değildi, olağanüstü bir şey yoktu. | Nötr | 0.2 |

| 4 | Etkinlik kötü organize edilmiş ve kaotikti. | Negatif | -0.85|

| 5 | Harika insanlarla müthiş zaman geçirdim! | Pozitif | 0.95|

Ödül modelini kontrol etme

- 👍 👎 Aşırı uçları kontrol edin

extreme_positive = reward_model_results[reward_model_results['Reward'] >= 0.9] extreme_negative = reward_model_results[reward_model_results['Reward'] <= -0.8]

🧑🔬 Dengeli veri kümesi sağlayın

sentiment_distribution = reward_model_results['Sentiment'].value_counts()📊 Ödül modelini normalleştirin

from sklearn.preprocessing import MinMaxScaler scaler = MinMaxScaler(feature_range=(-1, 1)) scaler.fit_transform(reward_model_results[['Reward']])

Hadi pratik yapalım!

İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)