Çeşitli geri bildirim kaynaklarını dahil etme

İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)

Mina Parham

AI Engineer

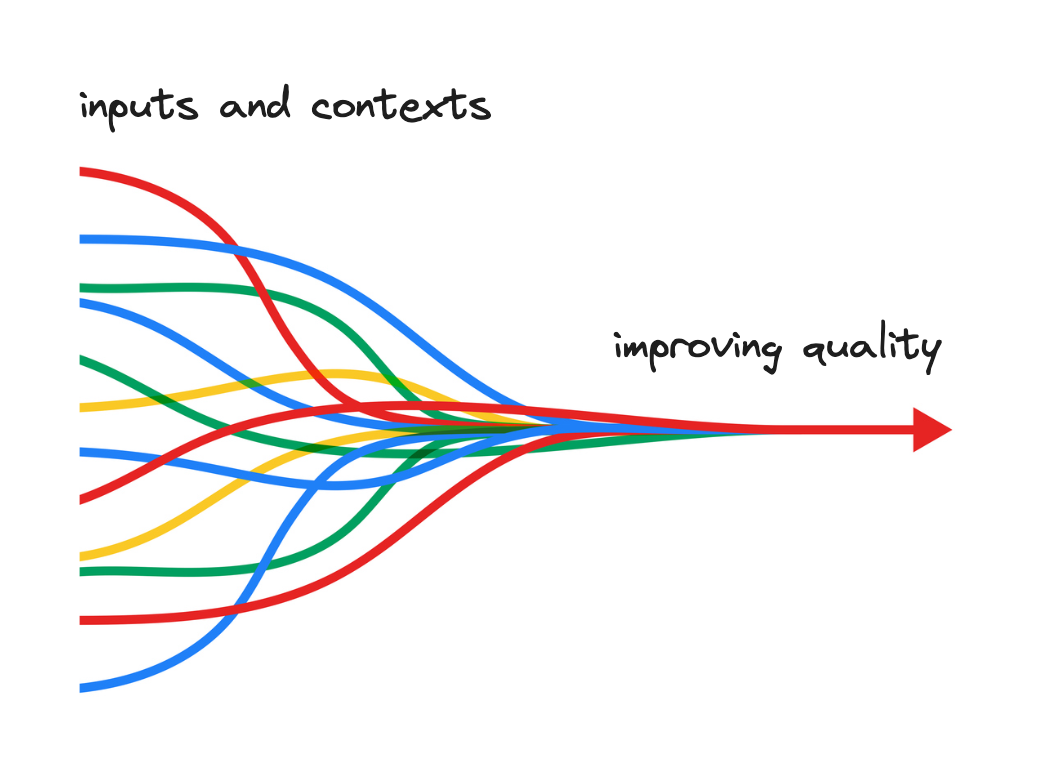

Geliştirilmiş model genellemesi

- Farklı bakış açıları ve bağlamları yansıtır

- Tercih ve değerleri geneller

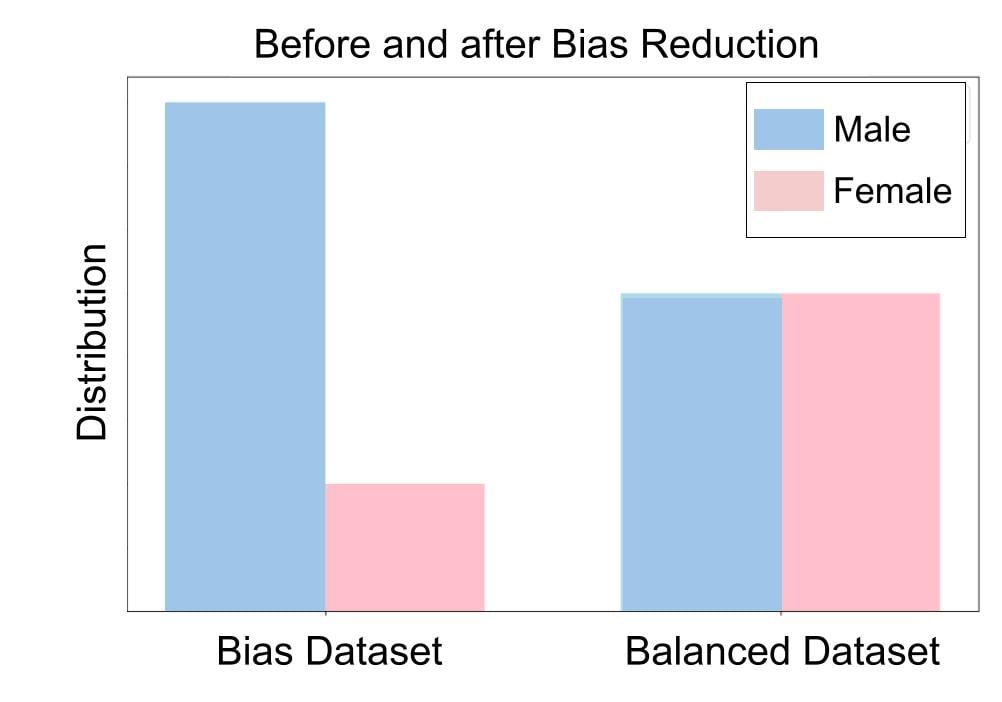

Azaltılmış önyargı

- Bireysel önyargıları azaltır

- Daha dengeli ve adil çıktı üretir

İnsan değerleriyle daha iyi uyum

- Karmaşık insan tercihleri

- Kültürler ve geçmişler temsil edilir

Gelişmiş uyum kabiliyeti

- Daha geniş kullanıcı ihtiyaç ve tercihlerine yanıt verir

- Farklı bakış açılarını yansıtır

Artan sağlamlık

- Farklı türde girdilere dayanıklıdır

- Performansını artırır

Birden çok kaynaktan tercih verisini entegre etme

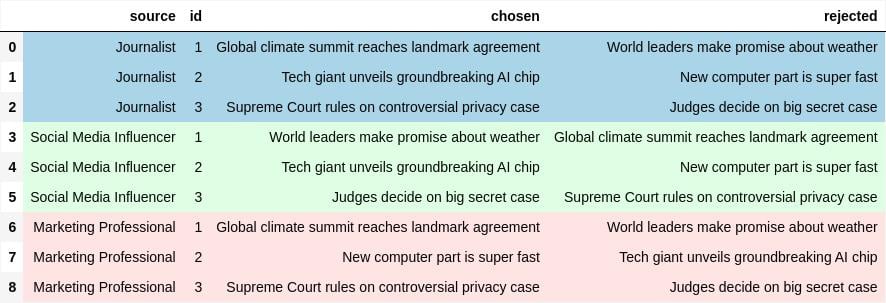

Kaynakları 'Gazeteci', 'Sosyal Medya Fenomeni' ve 'Pazarlama Uzmanı' olan tercih verisi preference_df:

Çoğunluk oylaması

Bu örnek veri, 'id' ile gruplanarak kolayca entegre edilebilir:

df_majority = preference_df.groupby(['id']).apply(majority_vote)

Ardından çoğunluk oylaması kullanılır:

from collections import Counter

def majority_vote(df):

votes = Counter(zip(df['chosen'], df['rejected']))

return max(votes, key=votes.get)

Güvenilmez tercih veri kaynakları

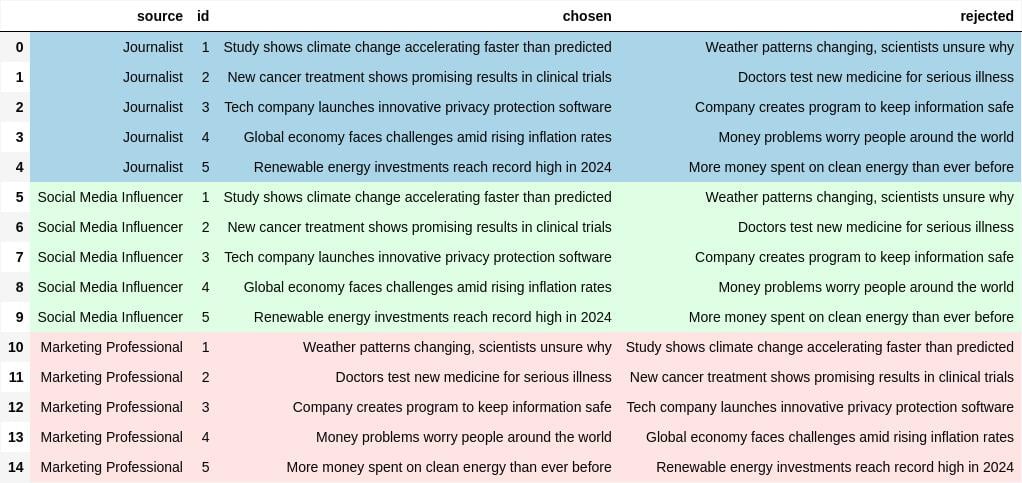

Aynı üç uzmana ait preference_df2 tercih verisi:

Güvenilmez tercih veri kaynakları

- Güvenilmez kaynakları belirlemek için

preference_df2satırları üzerinde yineleme:

df_majority = preference_df2.groupby('id').apply(majority_vote)disagreements = {source: 0 for source in preference_df2['source'].unique()}for _, row in preference_df2.iterrows(): if (row['chosen'], row['rejected']) != df_majority[row['id']]: disagreements[row['source']] += 1detect_unreliable_source = max(disagreements, key=disagreements.get)

Hadi pratik yapalım!

İnsan Geri Bildiriminden Pekiştirmeli Öğrenme (RLHF)