GRU ve LSTM hücreleri

Keras ile Dil Modellemesi için Yinelenen Sinir Ağları (RNN)

David Cecchini

Data Scientist

Artık gradyan sönmesi yok

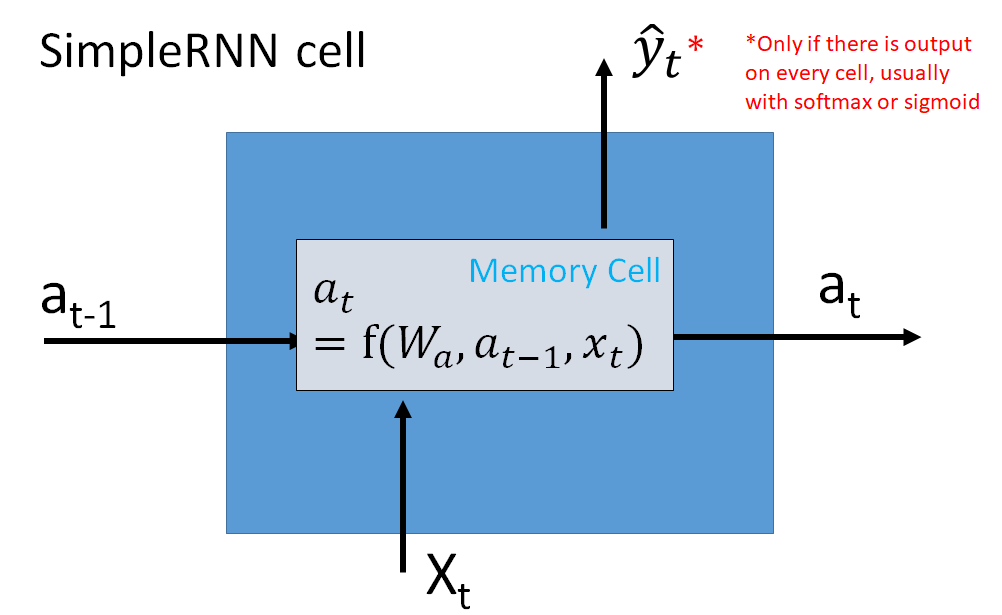

simpleRNNhücresi gradyan sorunları yaşayabilir.- Ağırlık matrisinin t'inci kuvveti diğer terimleri çarpar

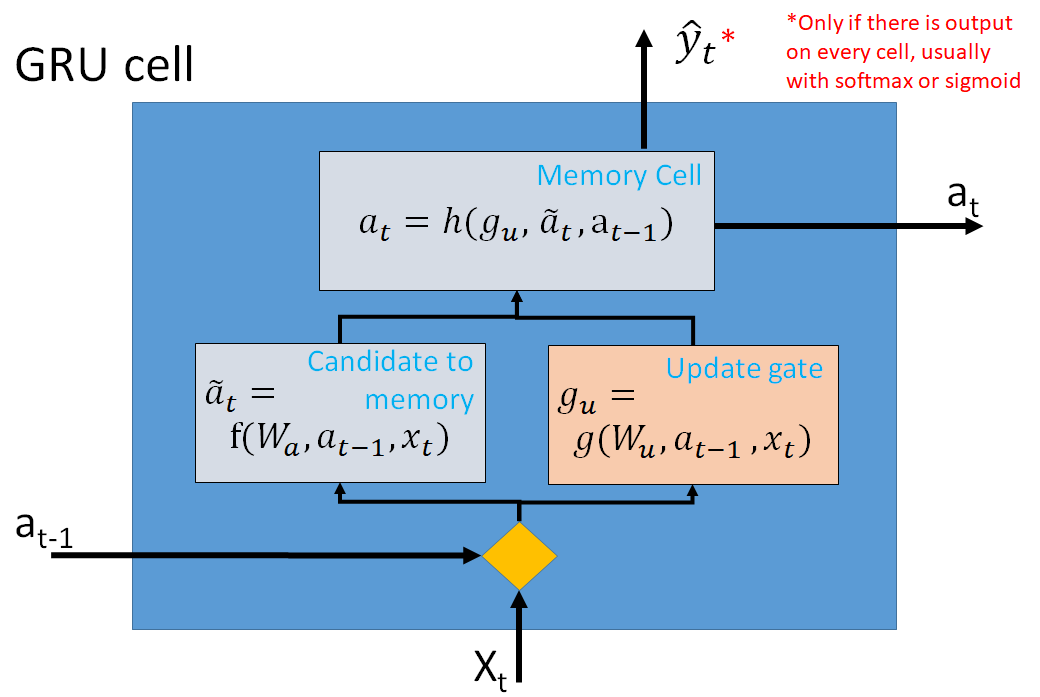

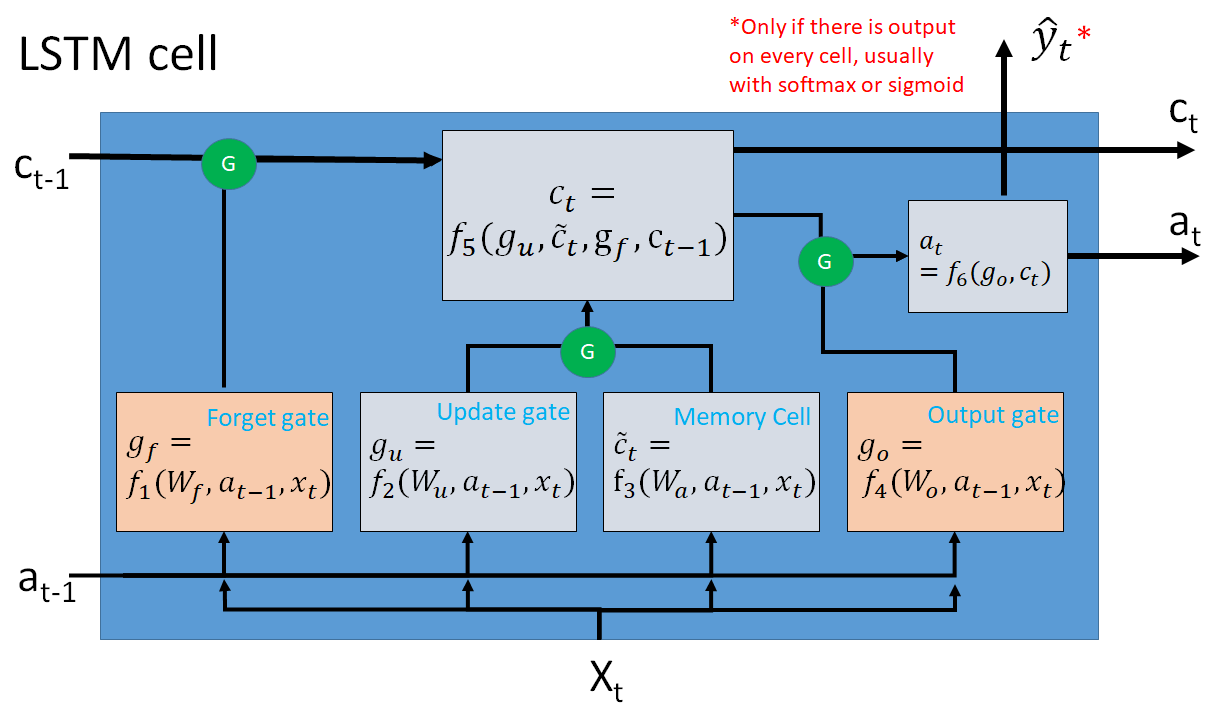

GRUveLSTMhücrelerinde gradyan sönmesi olmaz- Kapıları sayesinde

- Ağırlık matrisi terimleri geri kalanla çarpılmaz

- Patlayan gradyanlar daha kolay çözülebilir

Keras'ta kullanım

# Import the layers

from tensorflow import keras

from tensorflow.keras.layers import GRU, LSTM

# Add the layers to a model

model.add(GRU(units=128, return_sequences=True, name='GRU layer'))

model.add(LSTM(units=64, return_sequences=False, name='LSTM layer'))

Haydi pratik yapalım!

Keras ile Dil Modellemesi için Yinelenen Sinir Ağları (RNN)