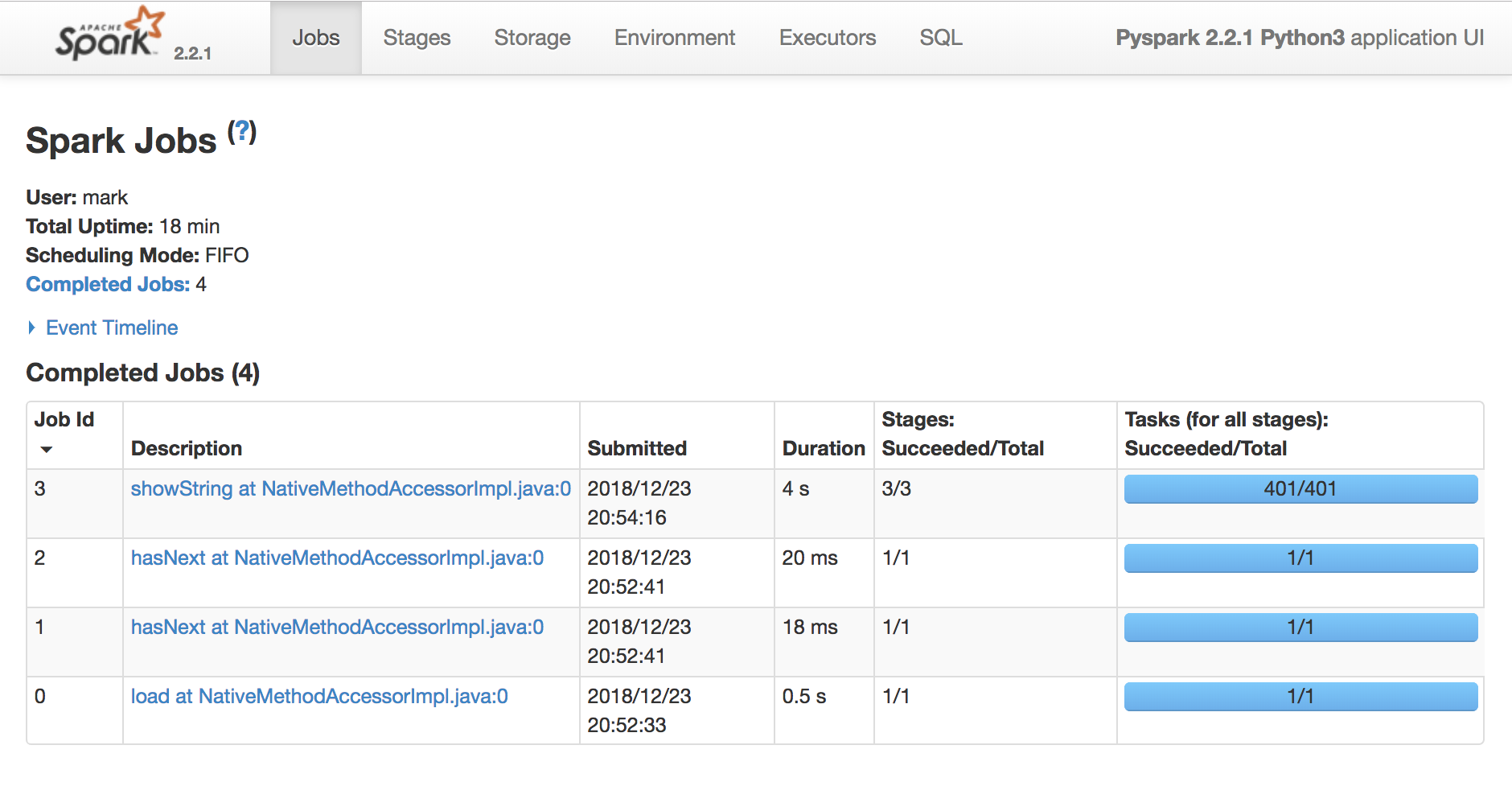

Spark UI

Python ile Spark SQL'e Giriş

Mark Plutowski

Data Scientist

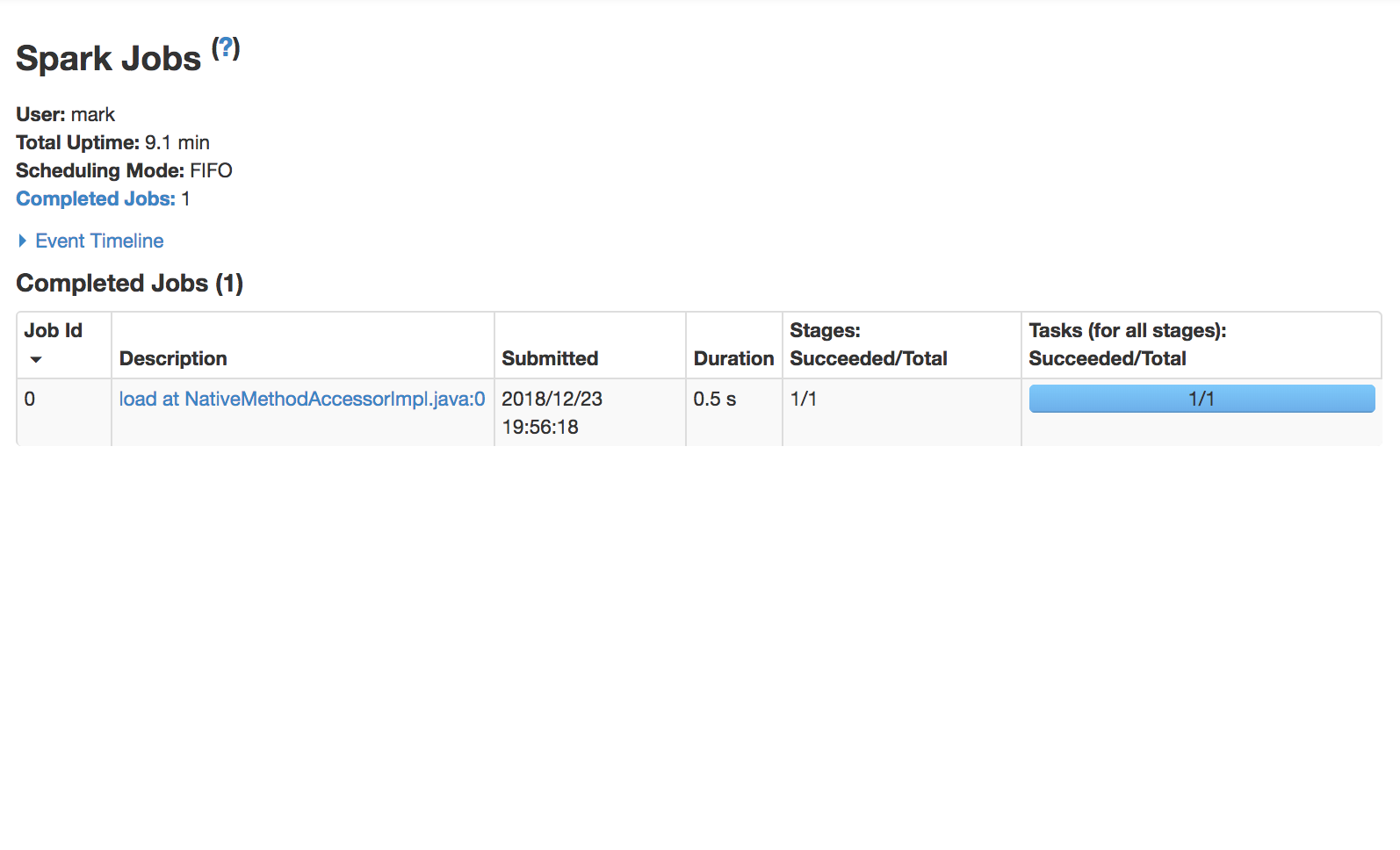

Yürütmeyi incelemek için Spark UI'ı kullanın

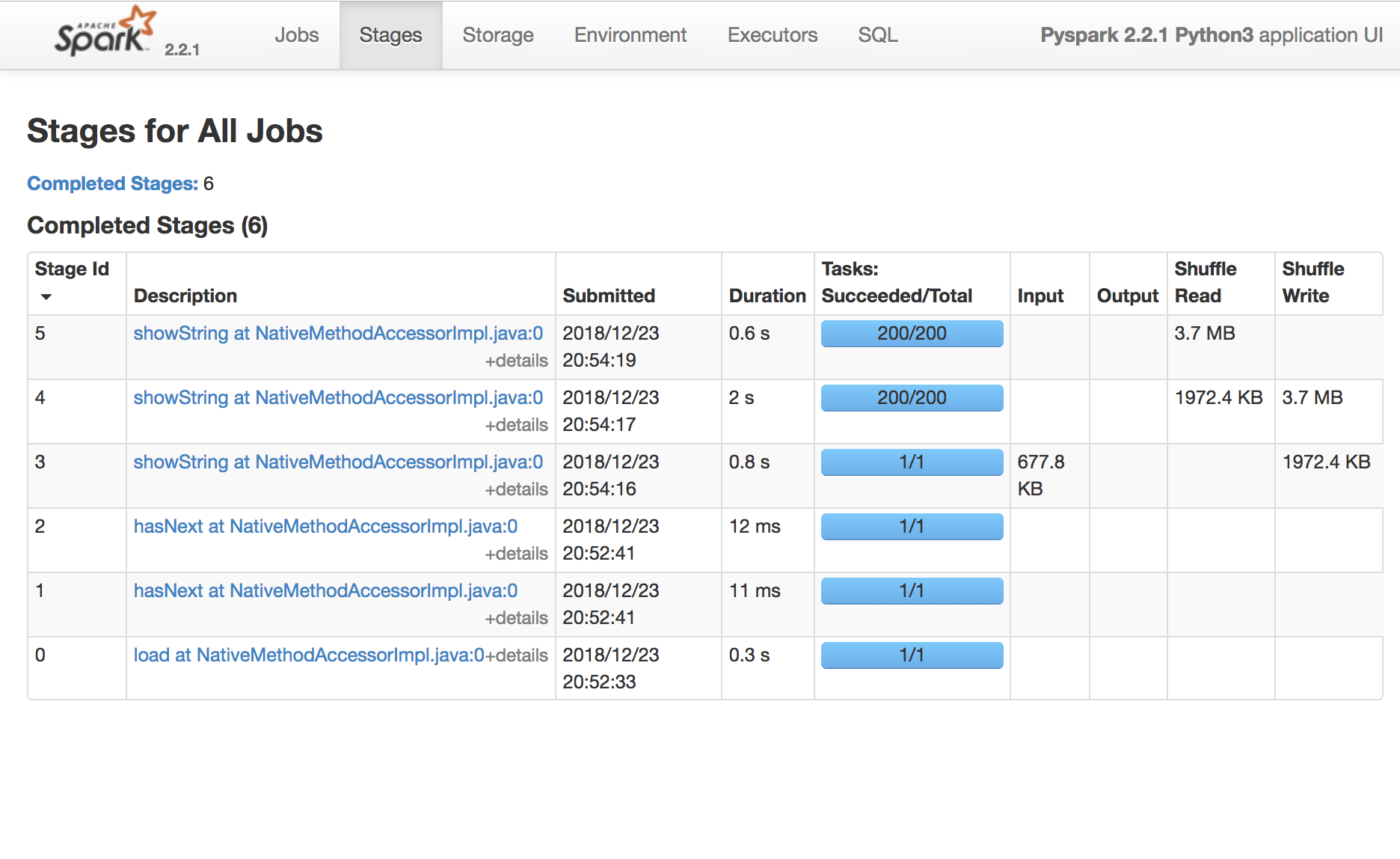

Spark Görevi (Task) tek bir CPU'da çalışan yürütme birimidir

Spark Aşaması (Stage) aynı hesabı paralel yapan görev grubudur; her görev genelde verinin farklı bir alt kümesinde çalışır

Spark İşi (Job) bir eylemle tetiklenen ve bir veya daha çok aşamaya bölünen hesaptır.

Spark UI'ı bulma

- http://[DRIVER_HOST]:4040

- http://[DRIVER_HOST]:4041

- http://[DRIVER_HOST]:4042

- http://[DRIVER_HOST]:4043

...

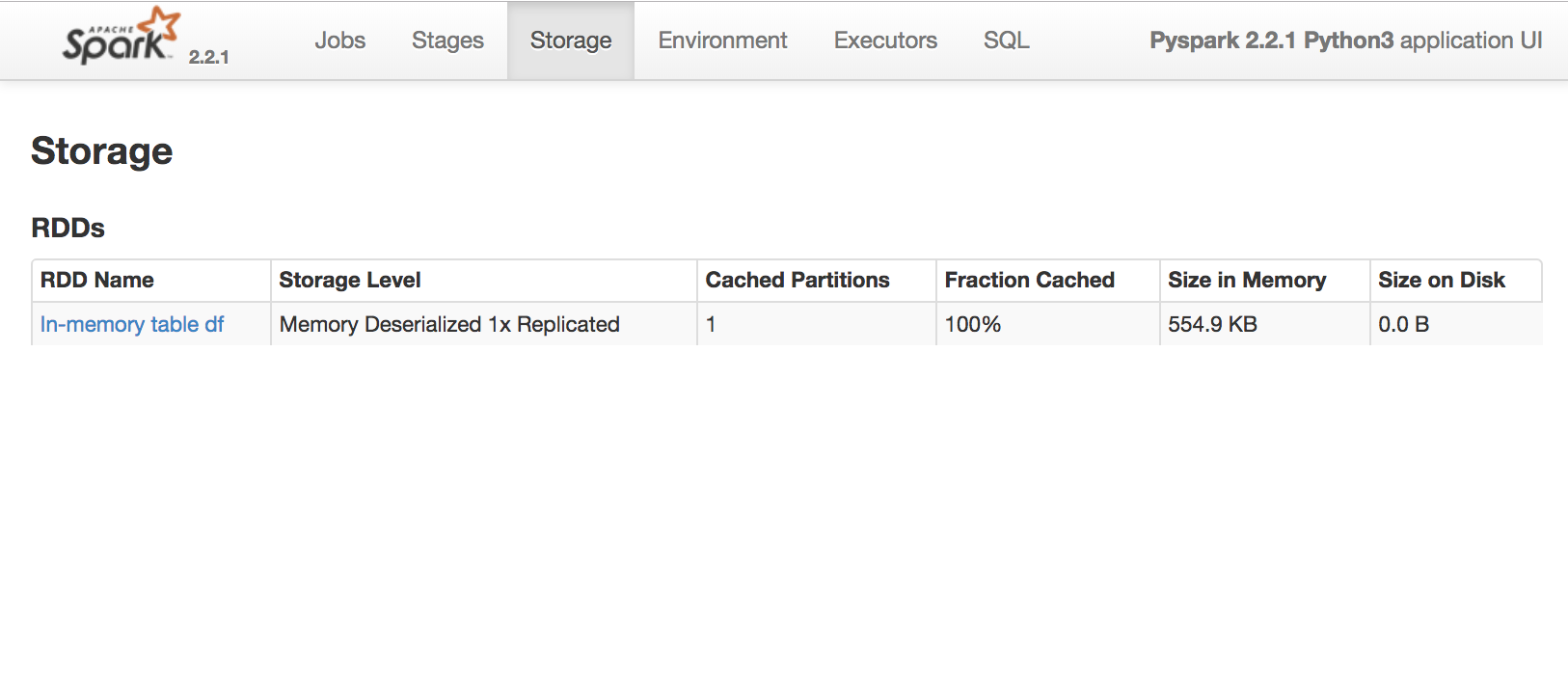

Spark katalog işlemleri

spark.catalog.cacheTable('table1')spark.catalog.uncacheTable('table1')spark.catalog.isCached('table1')spark.catalog.dropTempView('table1')

Spark Kataloğu

spark.catalog.listTables()

[Table(name='text', database=None, description=None, tableType='TEMPORARY', isTemporary=True)]

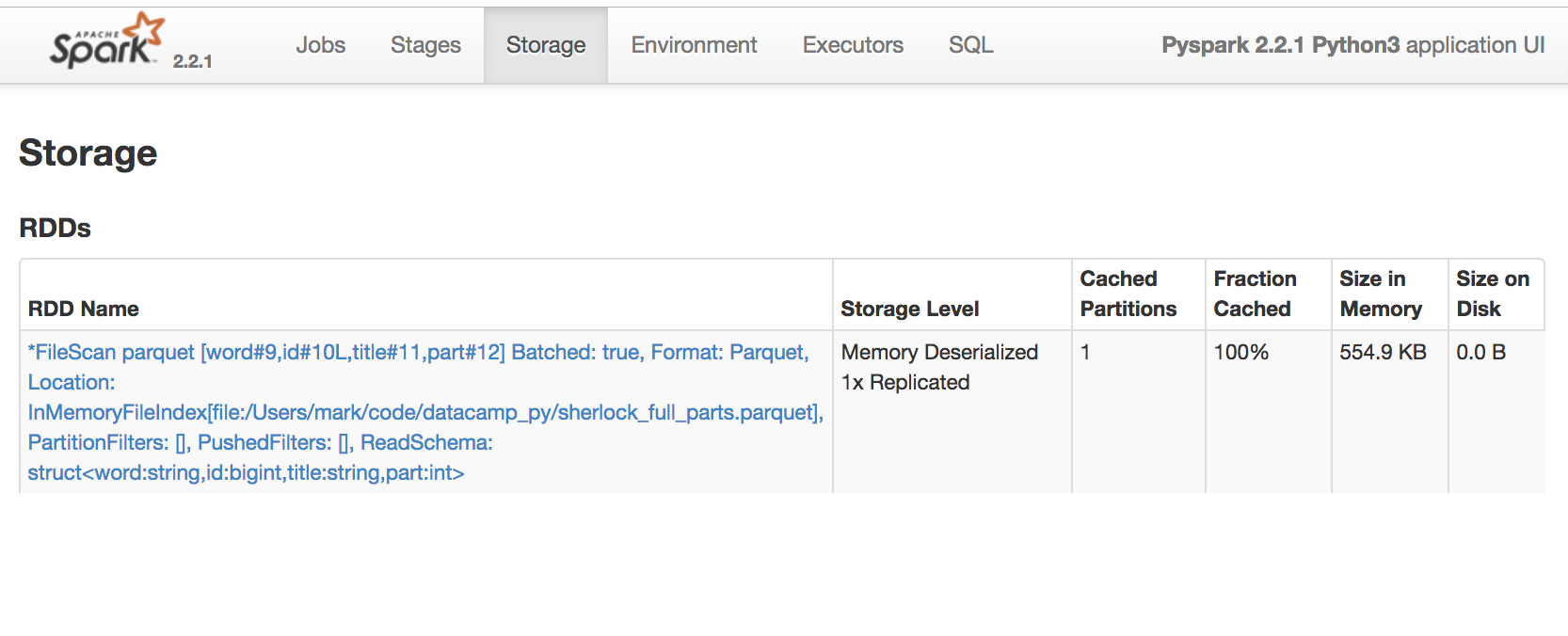

Spark UI Storage sekmesi

Veri bölümlerinin nerede olduğunu gösterir

- bellekte,

- diskte,

- küme genelinde,

- belirli bir anda.

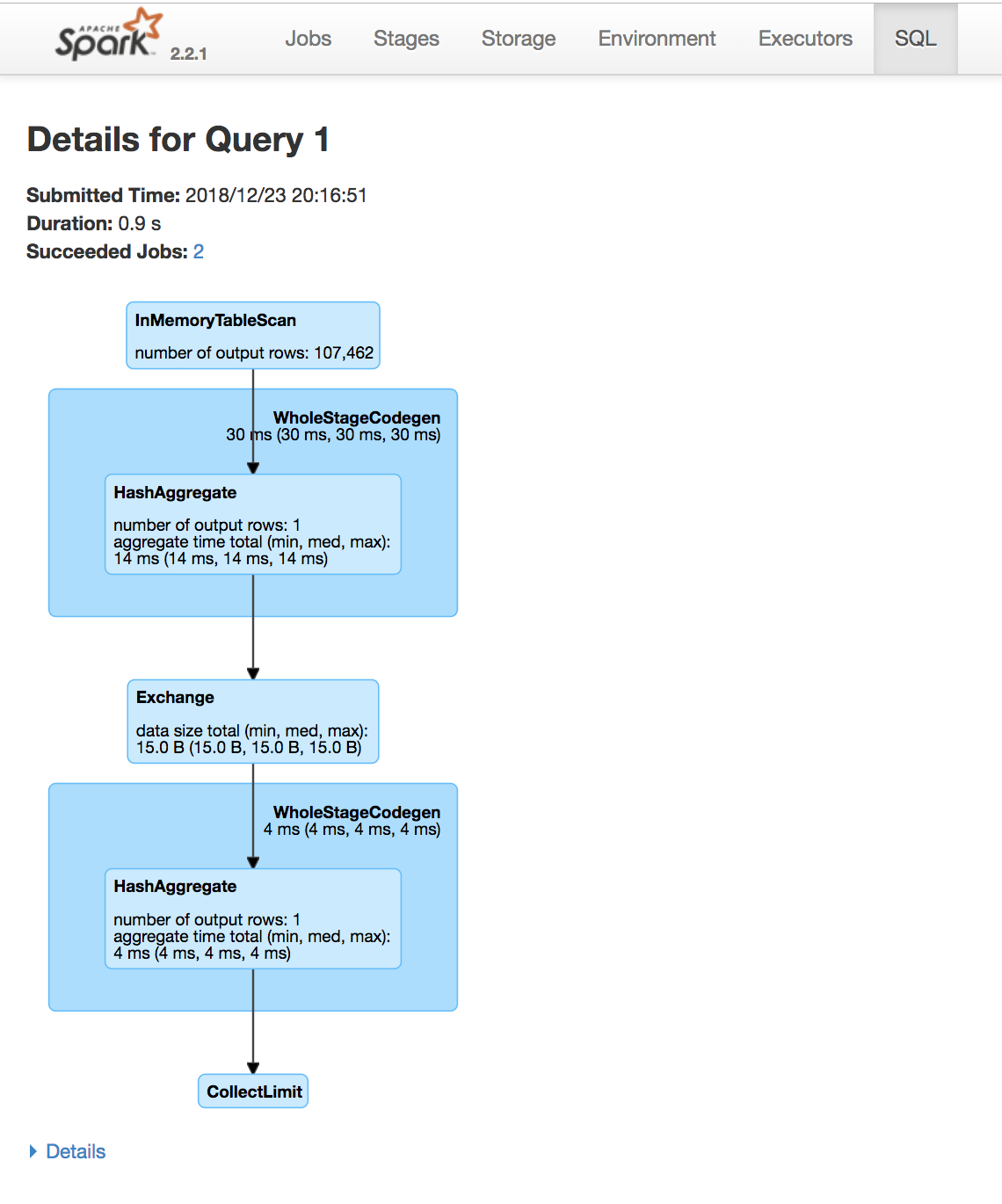

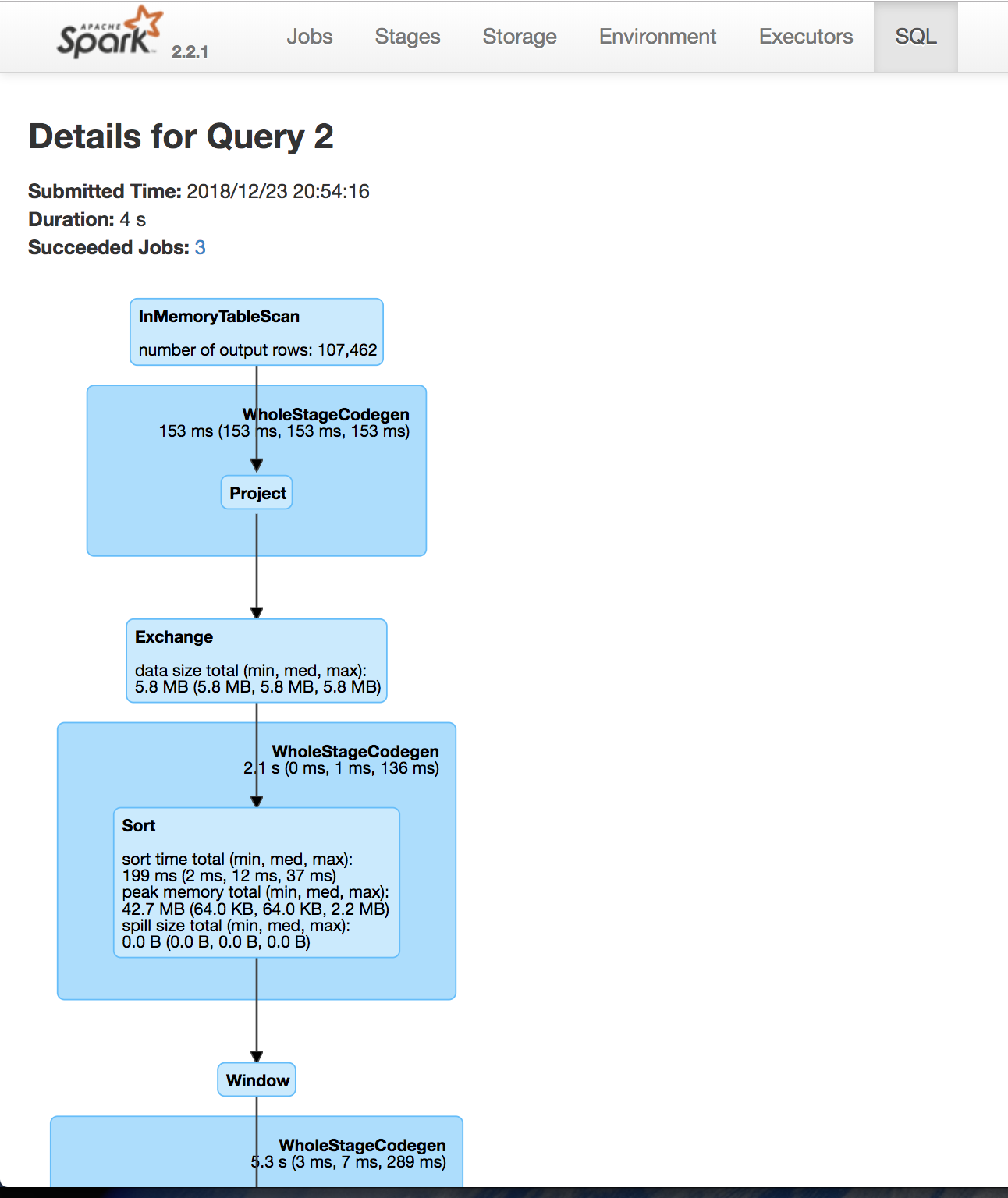

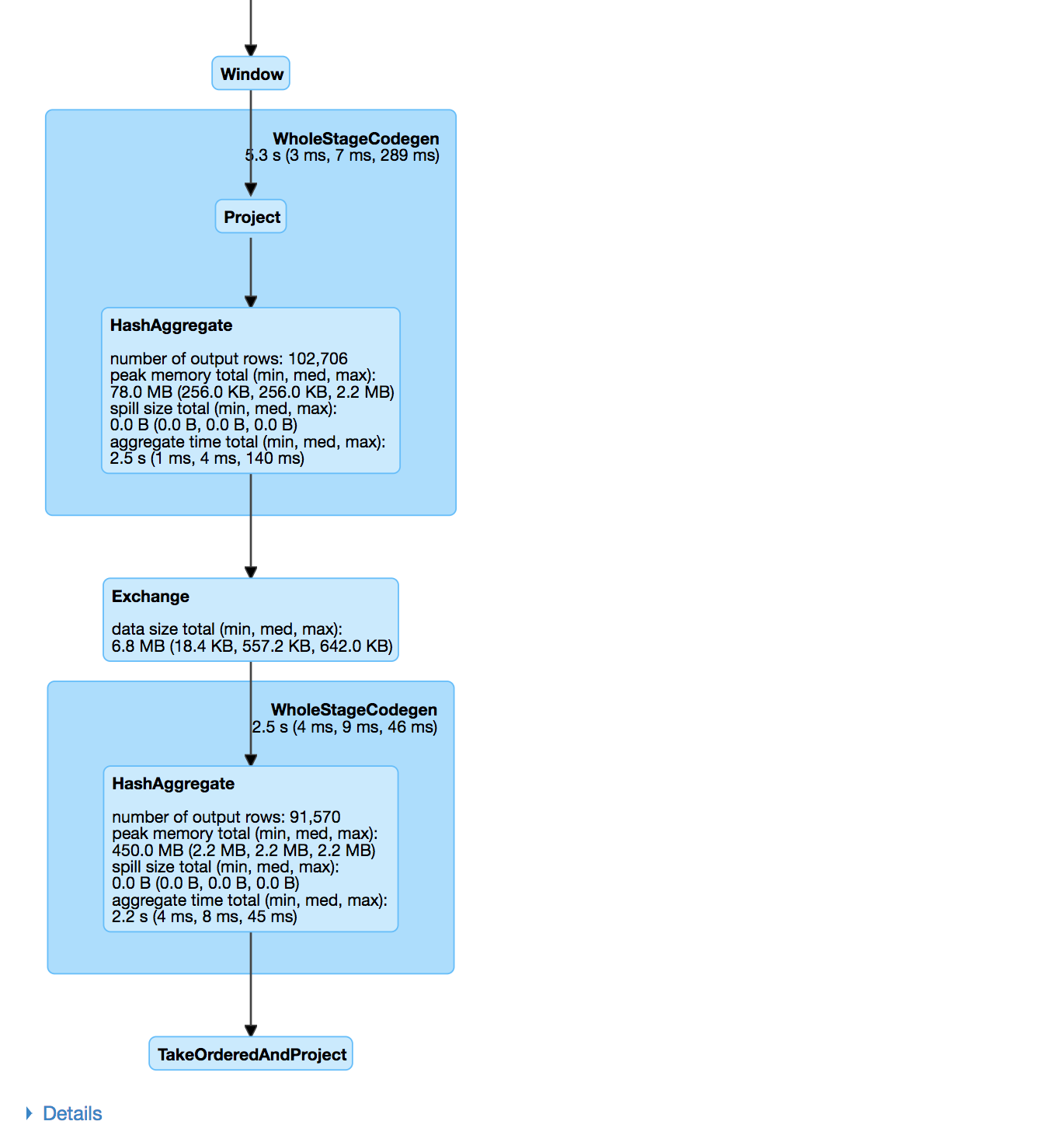

Spark UI SQL sekmesi

query3agg = """ SELECT w1, w2, w3, COUNT(*) as count FROM ( SELECT word AS w1, LEAD(word,1) OVER(PARTITION BY part ORDER BY id ) AS w2, LEAD(word,2) OVER(PARTITION BY part ORDER BY id ) AS w3 FROM df ) GROUP BY w1, w2, w3 ORDER BY count DESC """spark.sql(query3agg).show()

Ayo berlatih!

Python ile Spark SQL'e Giriş