Delta Lake tablo iyileştirme

Microsoft Fabric ile Verileri Dönüştür ve Analiz Et

Luis Silva

Solution Architect - Data & AI

Delta Lake nedir?

- Lakehouse’lar için açık kaynak depolama katmanı

- ACID işlemler, meta veri yönetimi ve sürümlendirme

- Fabric, standart olarak Delta Lake tablo biçimini (Parquet) kullanır

- Fabric deneyimleri arasında birlikte çalışabilirlik

Tablo bakımı

- Delta tablolarını formda tutun

- Tablo bakım işlemleri:

- Optimize

- V-Order

- Vacuum

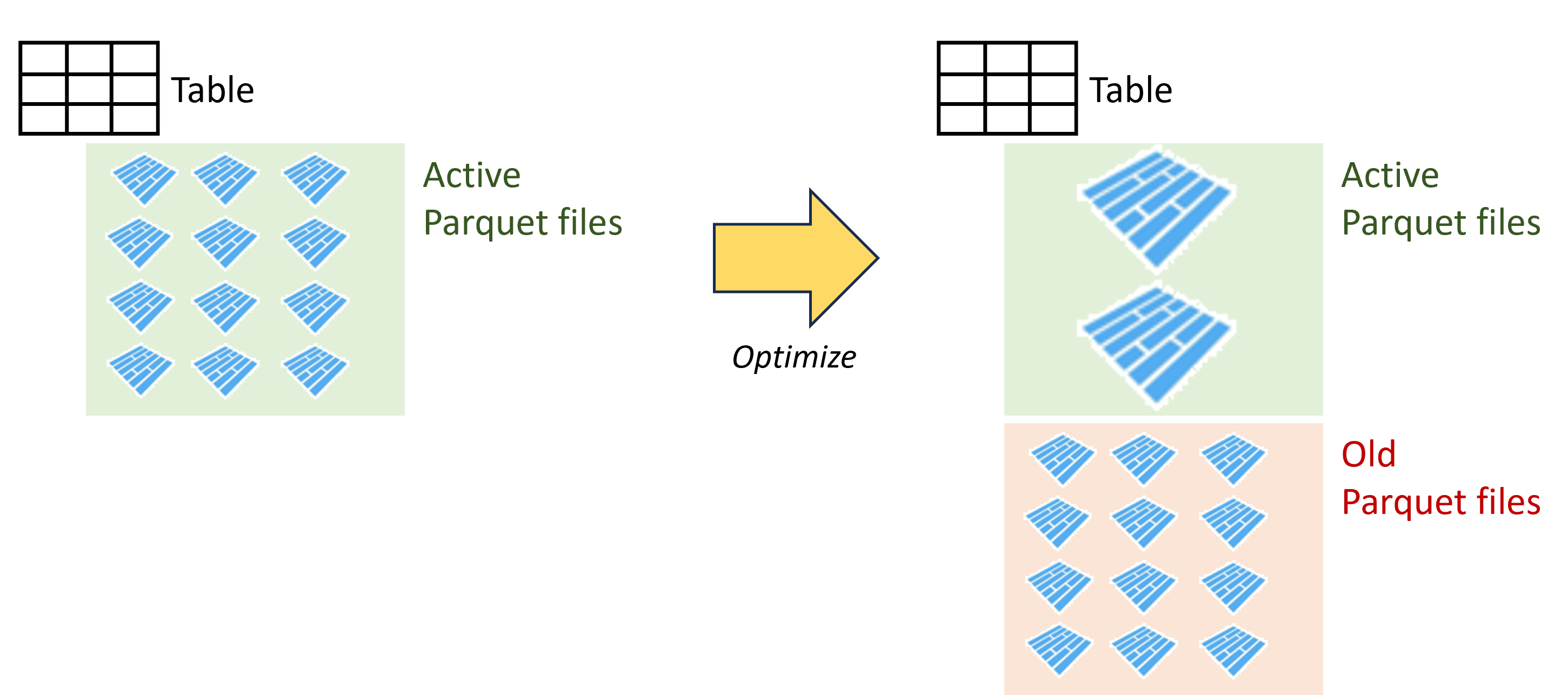

Optimize

- Çok sayıda küçük Parquet dosyasını büyük bir dosyada birleştirir

- İdeal dosya boyutu 128MB–1GB

- Sıkıştırma ve dağıtımı iyileştirir; okuma verimini artırır

- Büyük tabloları yükledikten sonra optimize önerilir

Optimize

- Çok sayıda küçük Parquet dosyasını büyük bir dosyada birleştirir

- İdeal dosya boyutu 128MB–1GB

- Sıkıştırma ve dağıtımı iyileştirir; okuma verimini artırır

- Büyük tabloları yükledikten sonra optimize önerilir

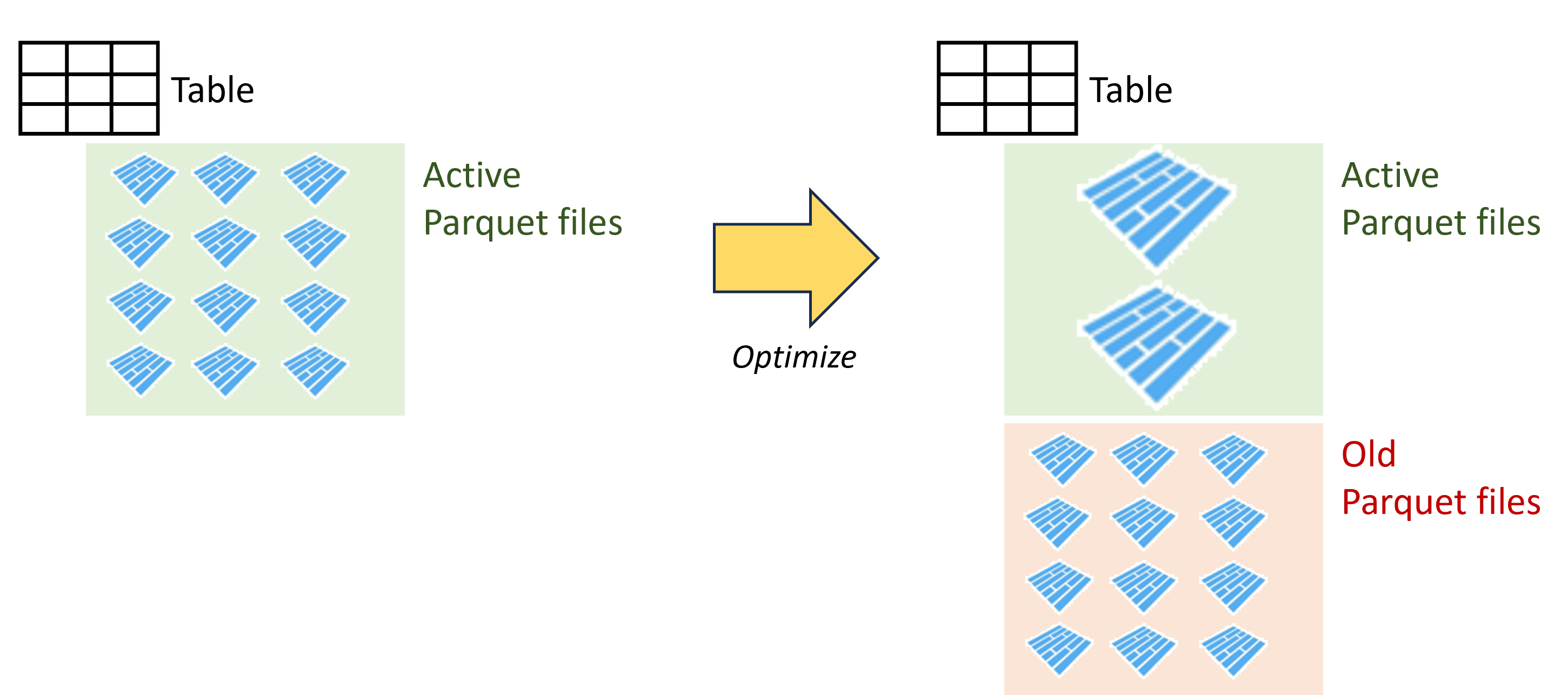

Lakehouse explorer’dan Optimize komutunu çalıştırma

Spark SQL ile Optimize komutunu çalıştırma

%%sql

OPTIMIZE <lakehouse>.<table>;

PySpark ile Optimize komutunu çalıştırma

from delta.tables import DeltaTable

dt = DeltaTable.forPath( spark, "Tables/<table>" )

dt.optimize().executeCompaction()

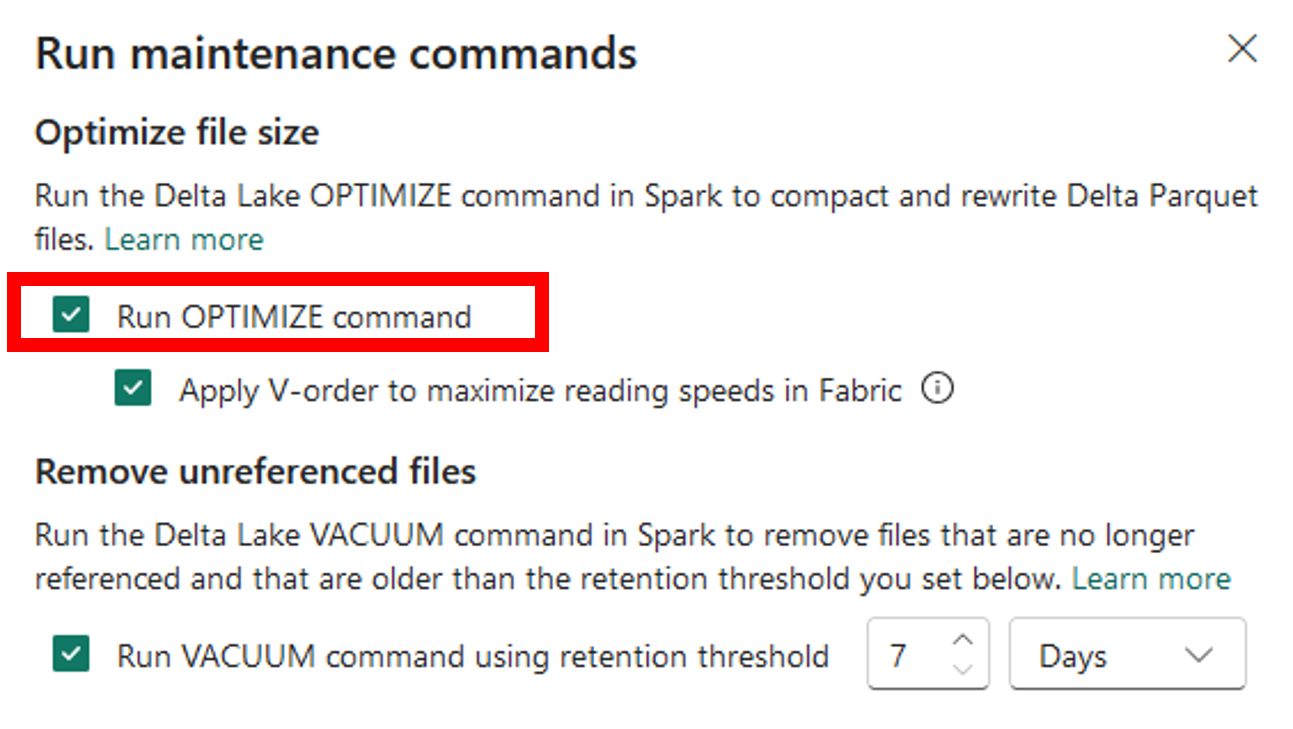

V-Order

- Parquet yazarken uygulanan özel iyileştirme

- Varsayılan olarak etkindir

Lakehouse explorer’dan V-Order uygulama

Apache Spark oturumunda V-Order yazımını kontrol etme

Oturum için V-Order’ı etkinleştirin

%%sql SET spark.sql.parquet.vorder.enabled=TRUEOturum için V-Order’ı devre dışı bırakın

%%sql SET spark.sql.parquet.vorder.enabled=FALSE

Tabloyu iyileştirirken V-Order uygulama

%%sql

OPTIMIZE <table|fileOrFolderPath> VORDER;

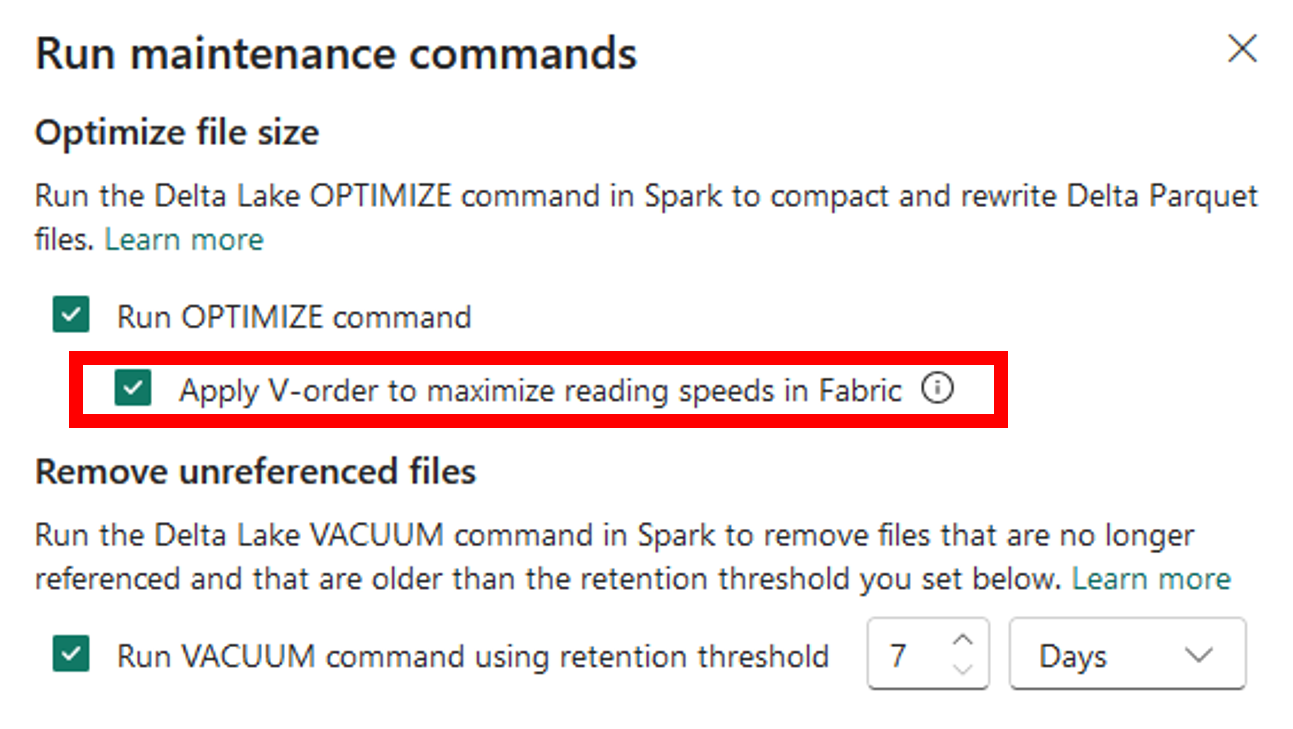

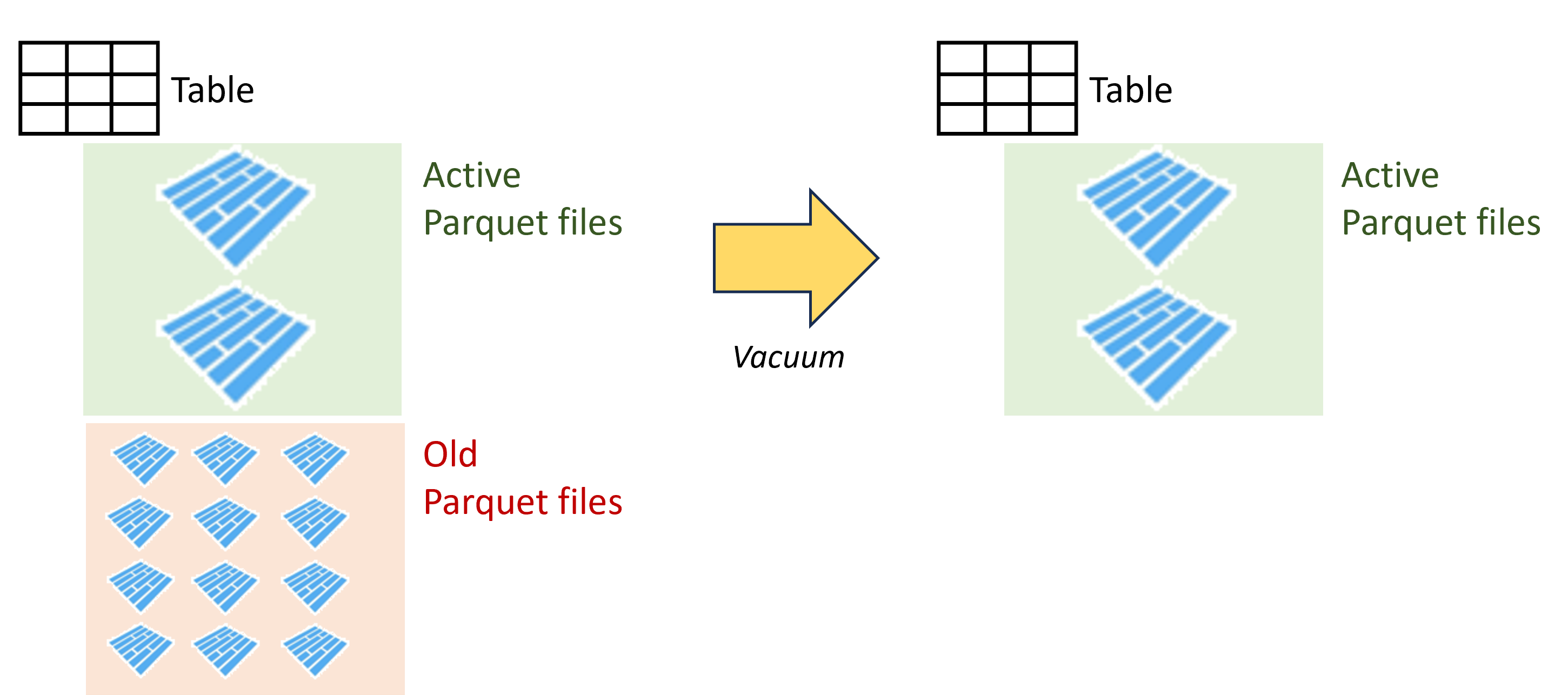

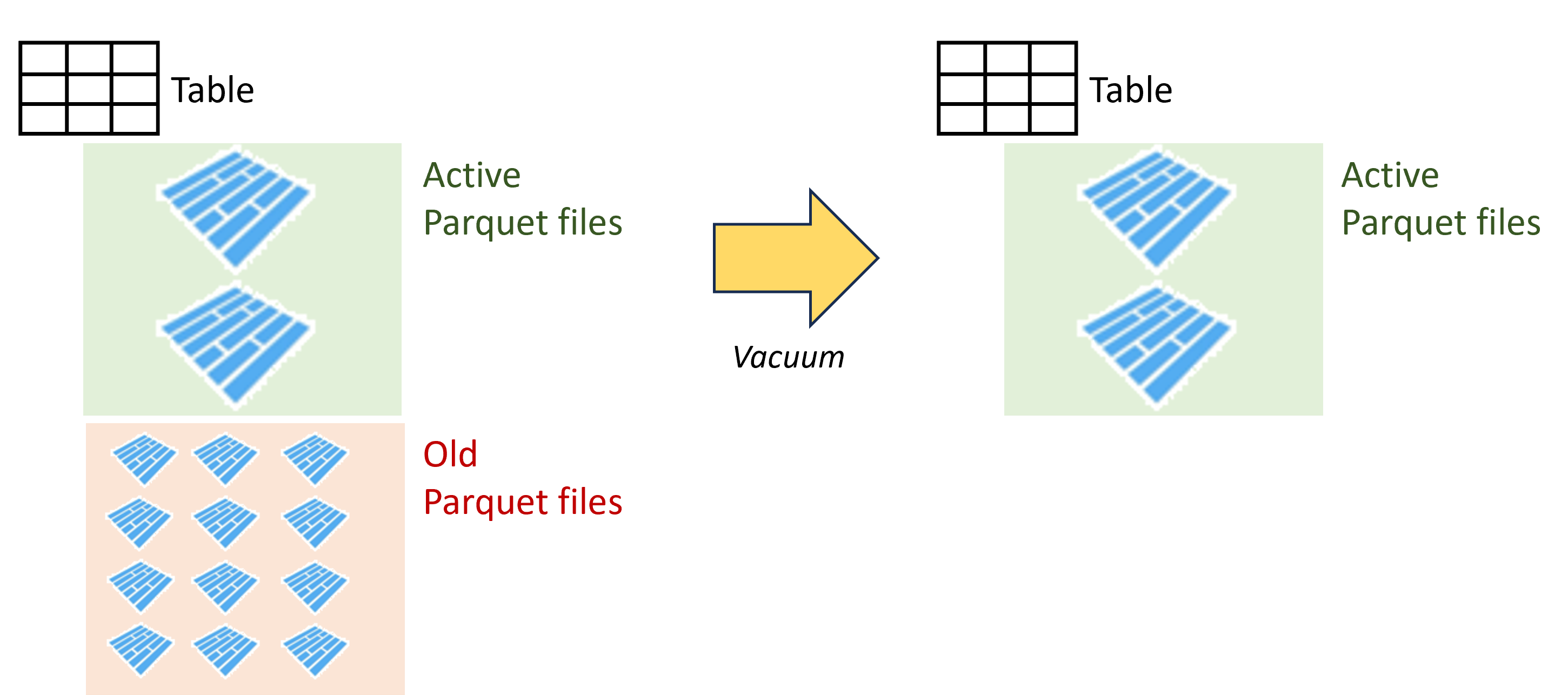

Vacuum

- Koruma eşiğinden daha eski ve artık gereksiz dosyaları kaldırır

- Bulut depolama maliyetlerini düşürür

Vacuum

- Koruma eşiğinden daha eski ve artık gereksiz dosyaları kaldırır

- Bulut depolama maliyetlerini düşürür

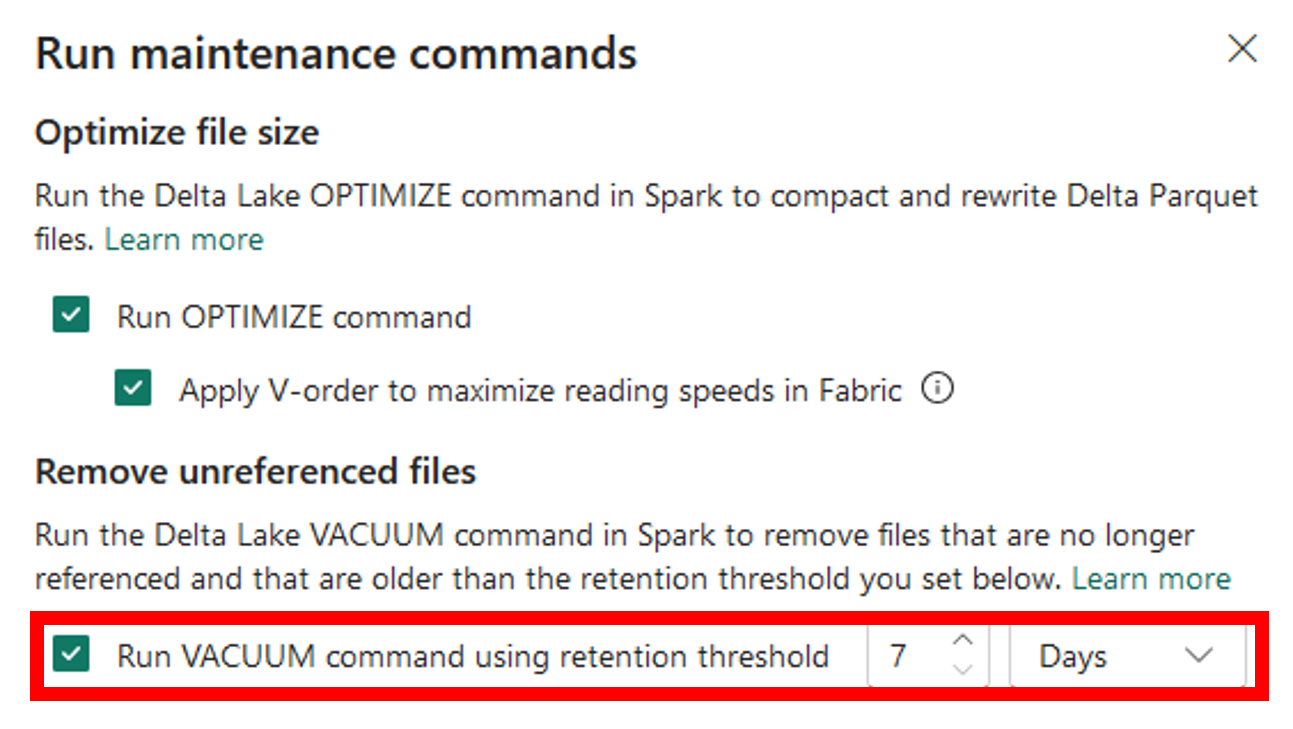

Lakehouse explorer’dan Vacuum çalıştırma

Hadi pratik yapalım!

Microsoft Fabric ile Verileri Dönüştür ve Analiz Et