caret ile hiperparametre ayarlama

R'de Hiperparametre Ayarlama

Dr. Shirin Elsinghorst

Senior Data Scientist

ABD 2016 seçiminden seçmen veri seti

- Eğitim ve test kümelerine ayırın

library(tidyverse)

glimpse(voters_train_data)

Gözlem: 6,692

Değişken: 42

$ turnout16_2016 <chr> "Did not vote", "Did not vote", "Did not vote", "Did not vote", ...

$ RIGGED_SYSTEM_1_2016 <int> 2, 2, 3, 2, 2, 3, 3, 1, 2, 3, 4, 4, 4, 3, 1, 2, 2, 2, 3, 2, 1, 2, 3, 2, 1, ...

$ RIGGED_SYSTEM_2_2016 <int> 3, 3, 2, 2, 3, 3, 2, 2, 1, 2, 4, 2, 3, 2, 3, 4, 3, 2, 2, 2, 4, 1, 2, 2, 3, ...

$ RIGGED_SYSTEM_3_2016 <int> 1, 1, 3, 1, 1, 1, 2, 1, 1, 2, 1, 2, 1, 2, 1, 1, 1, 2, 2, 3, 1, 3, 2, 1, 1, ...

$ RIGGED_SYSTEM_4_2016 <int> 2, 1, 2, 2, 2, 2, 2, 2, 1, 3, 3, 1, 3, 3, 1, 3, 3, 2, 1, 1, 1, 2, 1, 2, 2, ...

$ RIGGED_SYSTEM_5_2016 <int> 1, 2, 2, 2, 2, 3, 1, 1, 2, 3, 2, 2, 1, 3, 1, 1, 2, 2, 1, 2, 1, 2, 2, 2, 1, ...

$ RIGGED_SYSTEM_6_2016 <int> 1, 1, 2, 1, 2, 2, 2, 1, 2, 2, 1, 3, 1, 3, 1, 1, 1, 2, 1, 1, 1, 2, 2, 2, 1, ...

$ track_2016 <int> 2, 2, 2, 1, 2, 2, 2, 2, 2, 1, 2, 1, 2, 1, 1, 2, 2, 3, 2, 2, 2, 2, 3, 2, 2, ...

...

caret ile başka bir model eğitelim

- Stokastik Gradient Boosting

library(caret)

library(tictoc)

fitControl <- trainControl(method = "repeatedcv", number = 3, repeats = 5)

tic()

set.seed(42)

gbm_model_voters <- train(turnout16_2016 ~ .,

data = voters_train_data,

method = "gbm",

trControl = fitControl,

verbose = FALSE)

toc()

32.934 sn sürdü

caret ile başka bir model eğitelim

gbm_model_voters

Stochastic Gradient Boosting

...

Ayarlama parametreleri genelinde örnekleme sonuçları:

interaction.depth n.trees Accuracy Kappa

1 50 0.9604603 -0.0001774346

...

'Tuning parameter' shrinkage 0.1 değerinde sabit tutuldu

'Tuning parameter' n.minobsinnode 10 değerinde sabit tutuldu

En büyük değeri kullanan Accuracy ile en iyi model seçildi.

Nihai değerler: n.trees = 50,

interaction.depth = 1, shrinkage = 0.1 ve n.minobsinnode = 10.

caret ile Kartezyen ızgara araması

- Hiperparametrelerin bir Kartezyen ızgarasını tanımlayın:

man_grid <- expand.grid(n.trees = c(100, 200, 250), interaction.depth = c(1, 4, 6), shrinkage = 0.1, n.minobsinnode = 10)fitControl <- trainControl(method = "repeatedcv", number = 3, repeats = 5) tic() set.seed(42) gbm_model_voters_grid <- train(turnout16_2016 ~ ., data = voters_train_data, method = "gbm", trControl = fitControl, verbose = FALSE, tuneGrid = man_grid) toc()

85.745 sn sürdü

caret ile Kartezyen ızgara araması

gbm_model_voters_grid

Stochastic Gradient Boosting

...

Ayarlama parametreleri genelinde örnekleme sonuçları:

interaction.depth n.trees Accuracy Kappa

1 100 0.9603108 0.000912769

...

'Tuning parameter' shrinkage 0.1 değerinde sabit tutuldu

'Tuning parameter' n.minobsinnode 10 değerinde sabit tutuldu

En büyük değeri kullanan Accuracy ile en iyi model seçildi.

Nihai değerler: n.trees = 100,

interaction.depth = 1, shrinkage = 0.1 ve n.minobsinnode = 10.

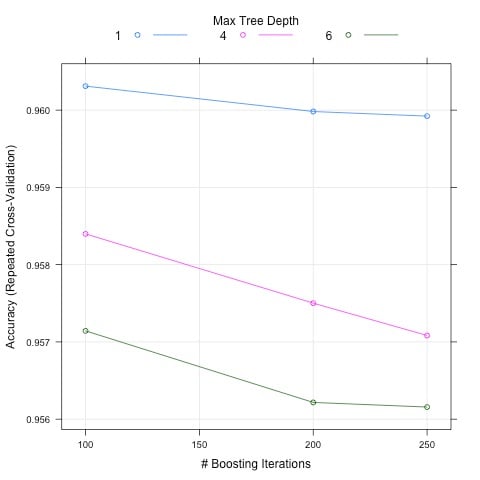

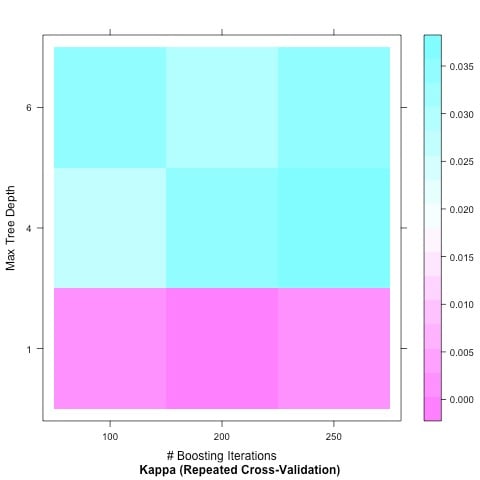

Hiperparametre modellerini görselleştirme

plot(gbm_model_voters_grid)

plot(gbm_model_voters_grid,

metric = "Kappa",

plotType = "level")

Kendiniz deneyin!

R'de Hiperparametre Ayarlama