Activatiefuncties ontdekken

Introductie tot Deep Learning met PyTorch

Jasmin Ludolf

Senior Data Science Content Developer, DataCamp

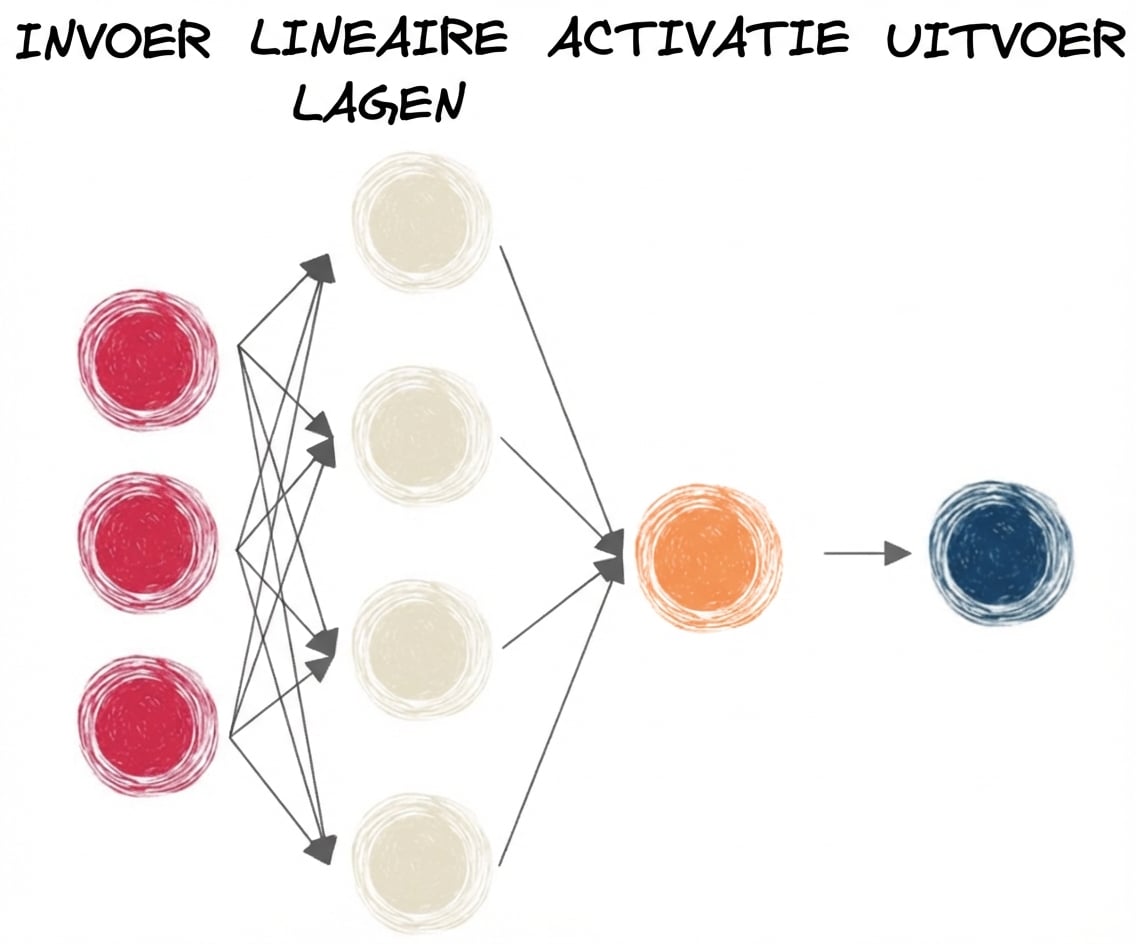

Activatiefuncties

$$

- Activatiefuncties voegen niet-lineariteit toe aan het netwerk

- Sigmoid voor binaire classificatie

- Softmax voor multi-classclassificatie

- Met niet-lineariteit leert een netwerk complexere relaties

- "Pre-activatie"-output gaat naar de activatiefunctie

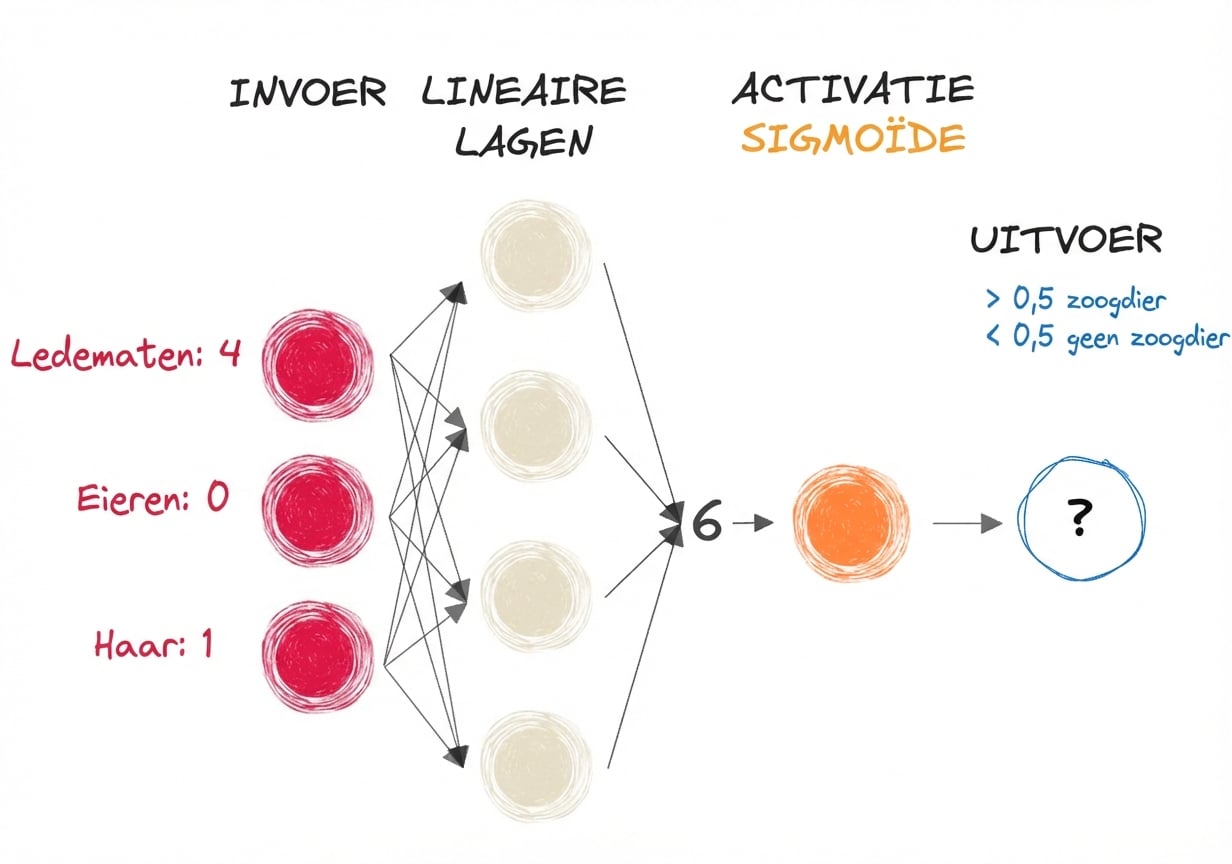

Maak kennis met de sigmoidfunctie

- Zoogdier of niet?

Maak kennis met de sigmoidfunctie

- Zoogdier of niet?

- Input:

- Ledematen: 4

- Eieren: 0

- Haar: 1

Maak kennis met de sigmoidfunctie

- Zoogdier of niet?

- Output naar de lineaire lagen is 6

Maak kennis met de sigmoidfunctie

- Zoogdier of niet?

- We nemen de pre-activatie-output (6) en voeren die door de sigmoidfunctie

Maak kennis met de sigmoidfunctie

- Zoogdier of niet?

- We nemen de pre-activatie-output (6) en voeren die door de sigmoidfunctie

Geeft een waarde tussen 0 en 1

Als output > 0,5, klasselabel = 1 (zoogdier)

- Als output <= 0,5, klasselabel = 0 (geen zoogdier)

Maak kennis met de sigmoidfunctie

import torch import torch.nn as nn input_tensor = torch.tensor([[6]]) sigmoid = nn.Sigmoid()output = sigmoid(input_tensor) print(output)

tensor([[0.9975]])

Activatie als laatste laag

model = nn.Sequential(

nn.Linear(6, 4), # First linear layer

nn.Linear(4, 1), # Second linear layer

nn.Sigmoid() # Sigmoid activation function

)

Sigmoid als laatste stap in een netwerk van lineaire lagen is gelijkwaardig aan traditionele logistische regressie

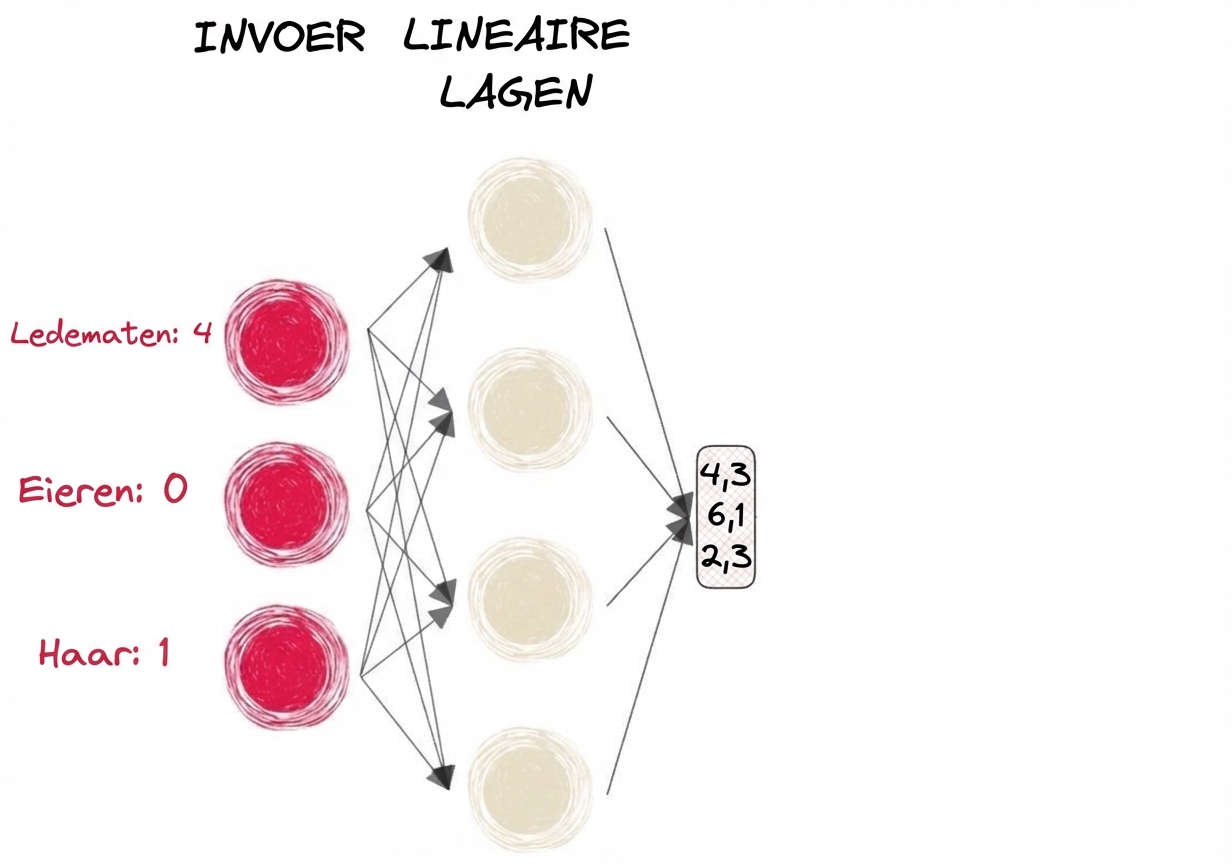

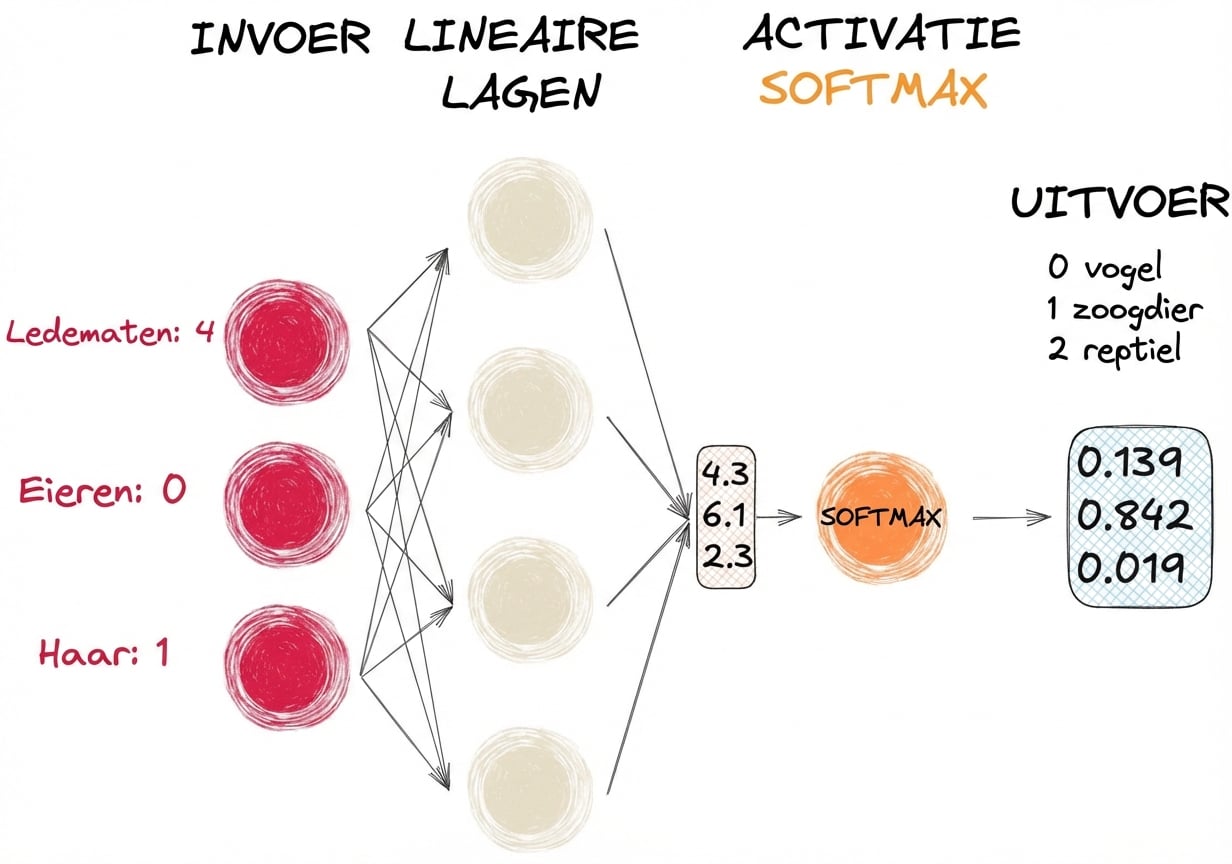

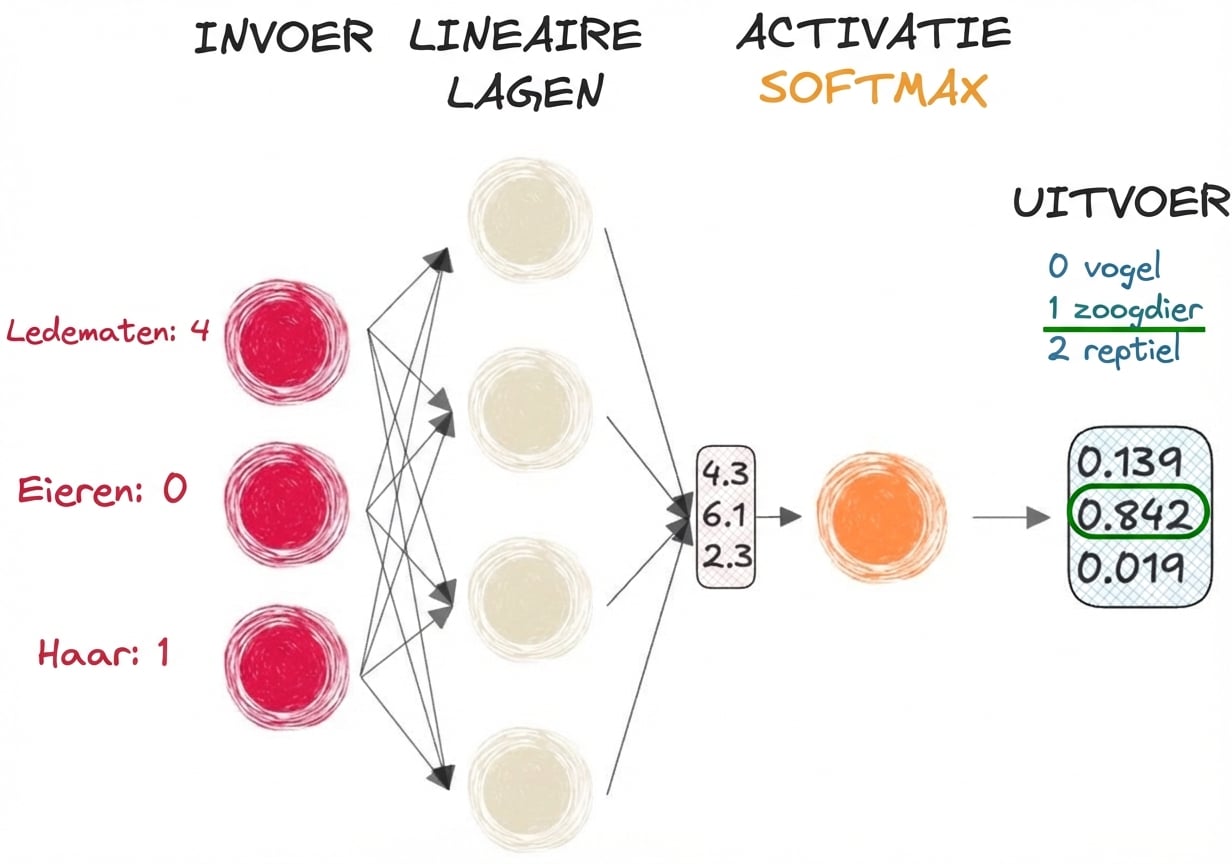

Kennismaken met softmax

- Drie klassen:

Kennismaken met softmax

- Drie klassen:

Kennismaken met softmax

- Drie klassen:

Kennismaken met softmax

- Drie klassen:

Kennismaken met softmax

- Neemt een driedimensionale input en geeft dezelfde vorm terug

Kennismaken met softmax

- Neemt een driedimensionale input en geeft dezelfde vorm terug

- Geeft een kansverdeling:

- Elk element is een kans (tussen 0 en 1)

- De som van de outputvector is gelijk aan 1

Kennismaken met softmax

- Neemt een driedimensionale input en geeft dezelfde vorm terug

- Geeft een kansverdeling:

- Elk element is een kans (tussen 0 en 1)

- De som van de outputvector is gelijk aan 1

Kennismaken met softmax

import torch import torch.nn as nn # Create an input tensor input_tensor = torch.tensor( [[4.3, 6.1, 2.3]]) # Apply softmax along the last dimensionprobabilities = nn.Softmax(dim=-1) output_tensor = probabilities(input_tensor) print(output_tensor)

tensor([[0.1392, 0.8420, 0.0188]])

dim = -1geeft aan dat softmax wordt toegepast op de laatste dimensie van de input-tensornn.Softmax()kan als laatste stap innn.Sequential()

Laten we oefenen!

Introductie tot Deep Learning met PyTorch