ReLU-activatiefuncties

Introductie tot Deep Learning met PyTorch

Jasmin Ludolf

Senior Data Science Content Developer, DataCamp

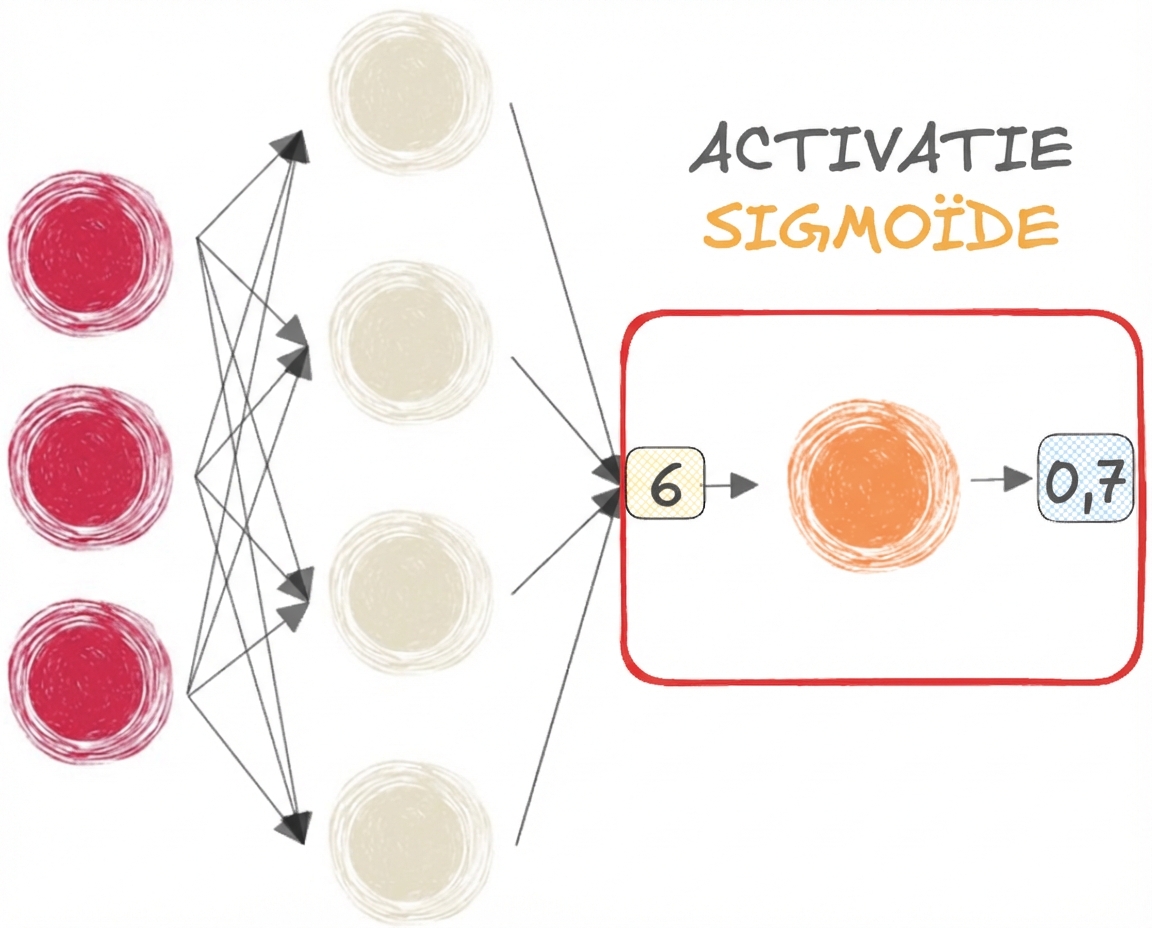

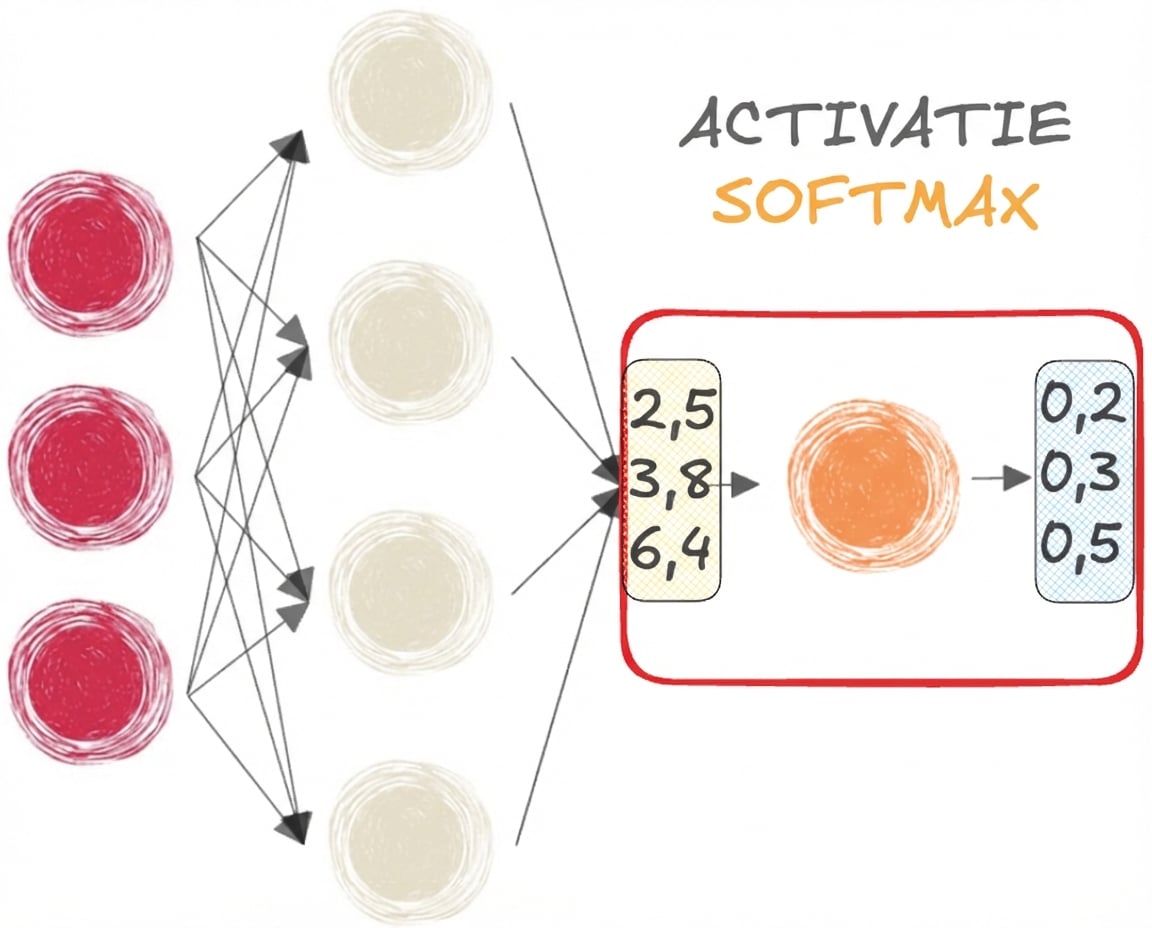

Sigmoid- en softmaxfuncties

$$

- SIGMOID voor BINAIRE classificatie

$$

- SOFTMAX voor MULTIKLASSE classificatie

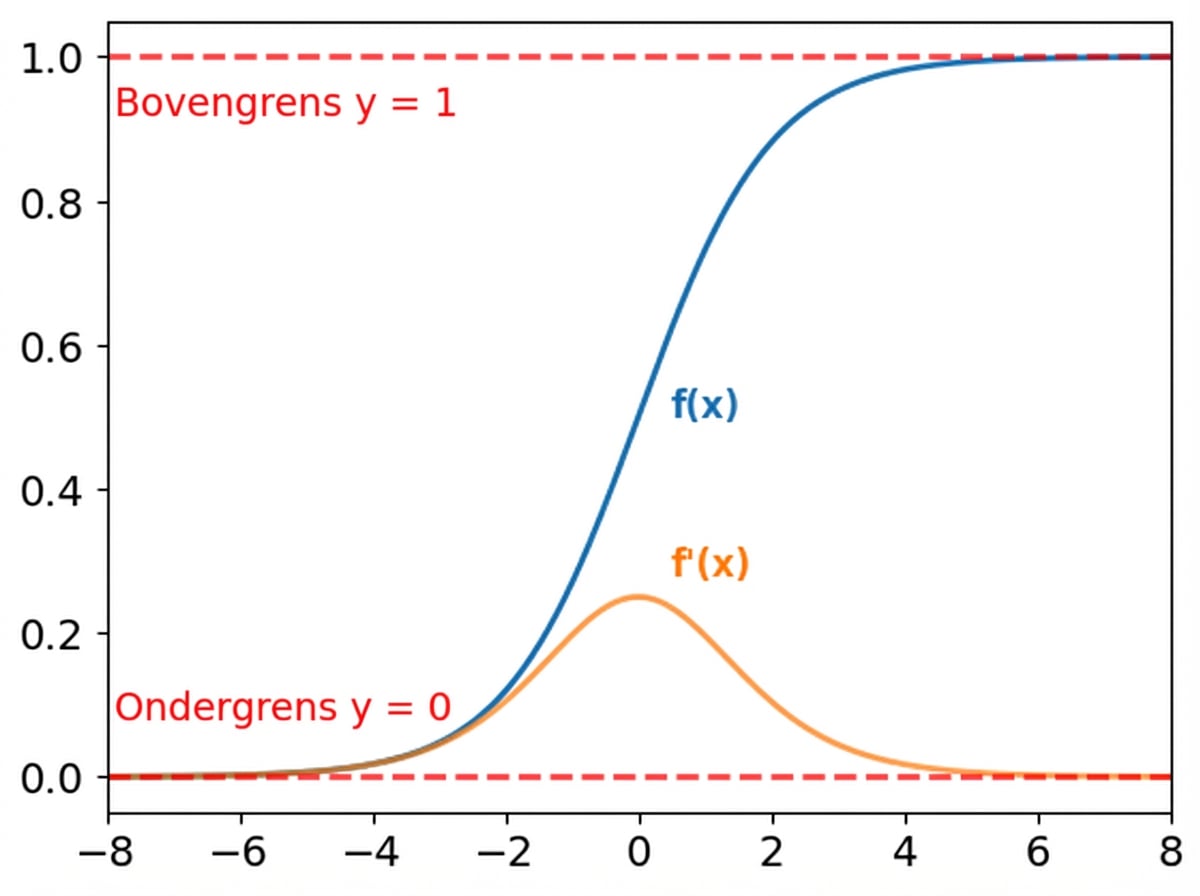

Beperkingen van de sigmoid- en softmaxfunctie

Sigmoid-functie:

- Output tussen 0 en 1

- Overal in een netwerk te gebruiken

Gradiënten:

- Zeer klein voor grote en kleine x-waarden

- Veroorzaakt verzadiging, wat leidt tot het vanishing gradients-probleem

$$

De softmaxfunctie lijdt ook aan verzadiging

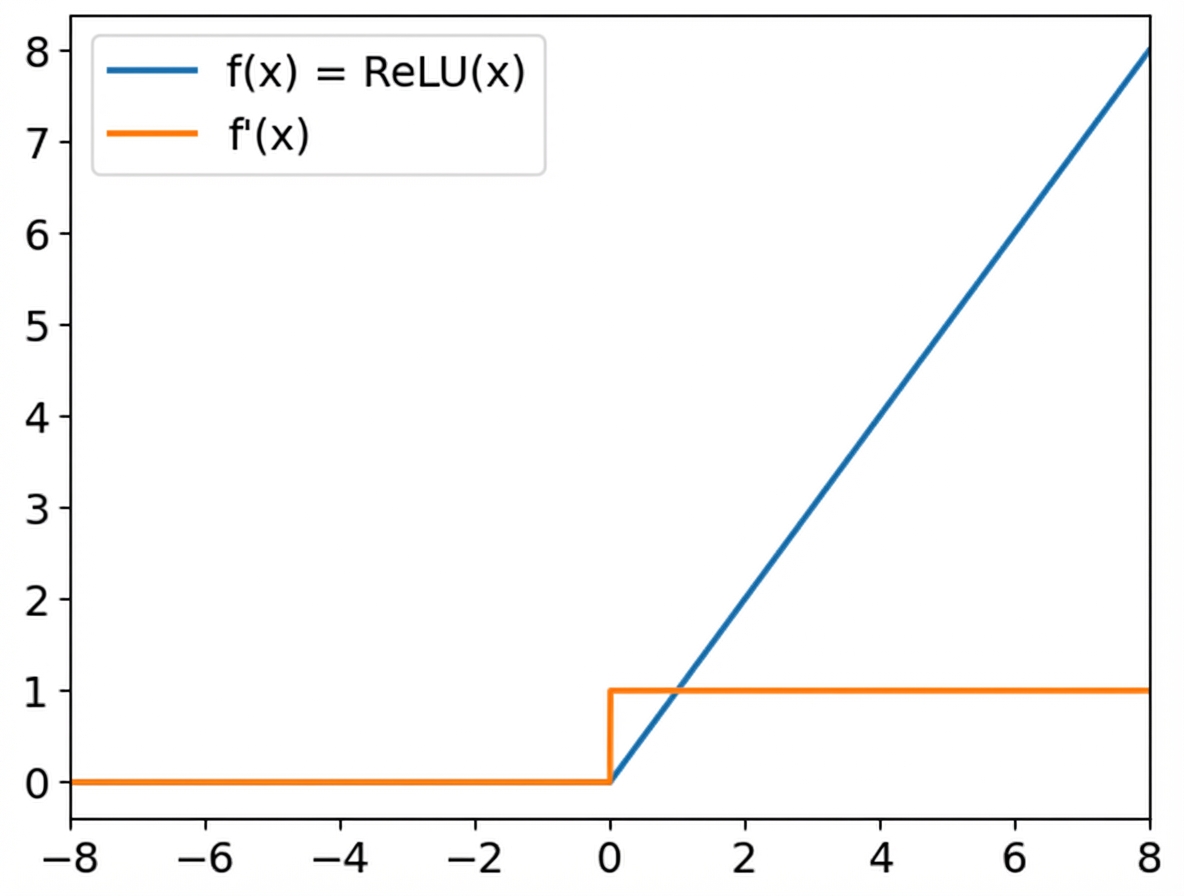

ReLU

Rectified Linear Unit (ReLU):

f(x) = max(x, 0)- Bij positieve inputs: output equals input

- Bij negatieve inputs: output is 0

- Helpt vanishing gradients te verminderen

$$

In PyTorch:

relu = nn.ReLU()

Leaky ReLU

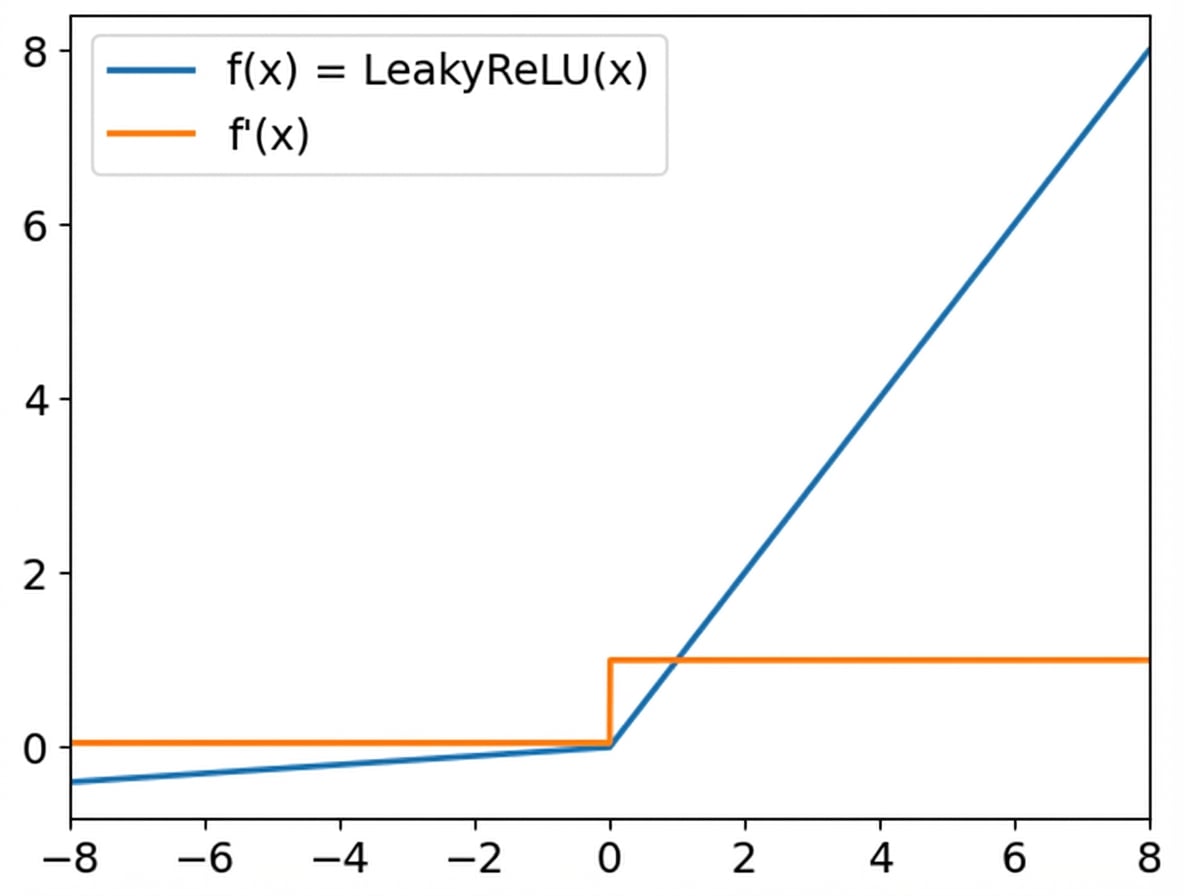

Leaky ReLU:

- Positieve inputs gedragen zich als ReLU

- Negatieve inputs worden geschaald met een kleine coëfficiënt (standaard 0,01)

- Gradiënten voor negatieve inputs zijn niet nul

$$

In PyTorch:

leaky_relu = nn.LeakyReLU(

negative_slope = 0.05)

Laten we oefenen!

Introductie tot Deep Learning met PyTorch