Learning rate en momentum

Introductie tot Deep Learning met PyTorch

Jasmin Ludolf

Senior Data Science Content Developer, DataCamp

Gewichten bijwerken met SGD

- Een neuraal netwerk trainen = een optimalisatieprobleem oplossen.

Stochastic Gradient Descent (SGD)-optimizer

sgd = optim.SGD(model.parameters(), lr=0.01, momentum=0.95)

- Twee argumenten:

- learning rate: bepaalt de stapgrootte

- momentum: voegt traagheid toe om vastlopen te voorkomen

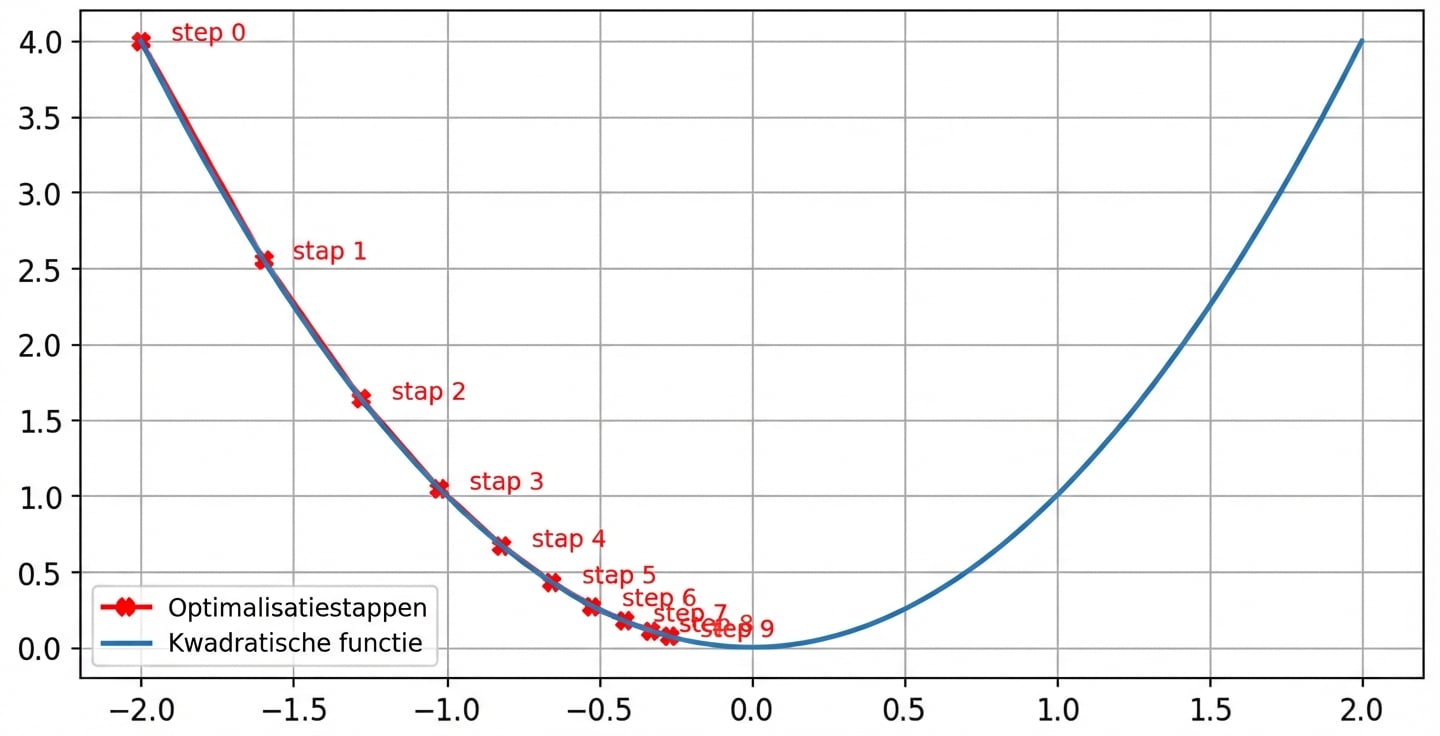

Effect van de learning rate: optimale learning rate

- Stapgrootte neemt af nabij nul als de gradiënt kleiner wordt

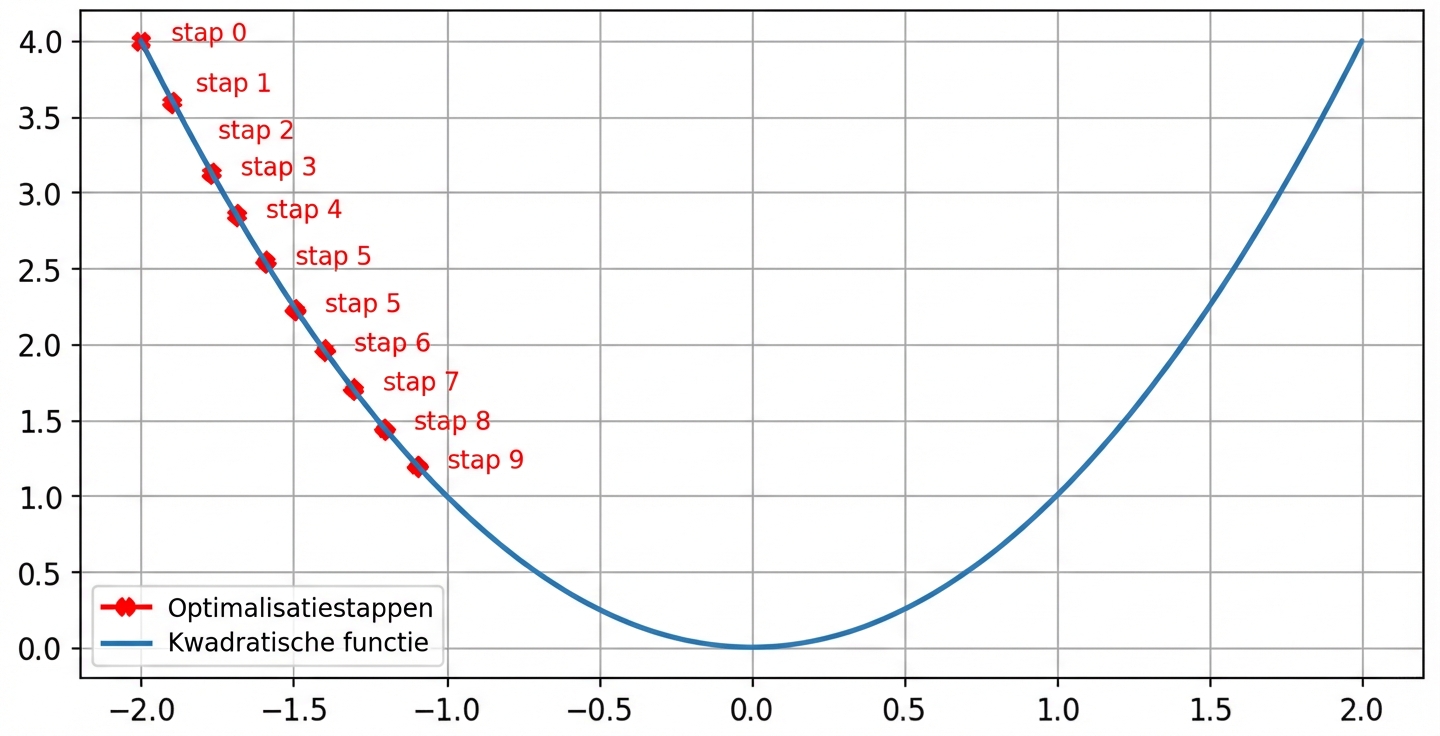

Effect van de learning rate: kleine learning rate

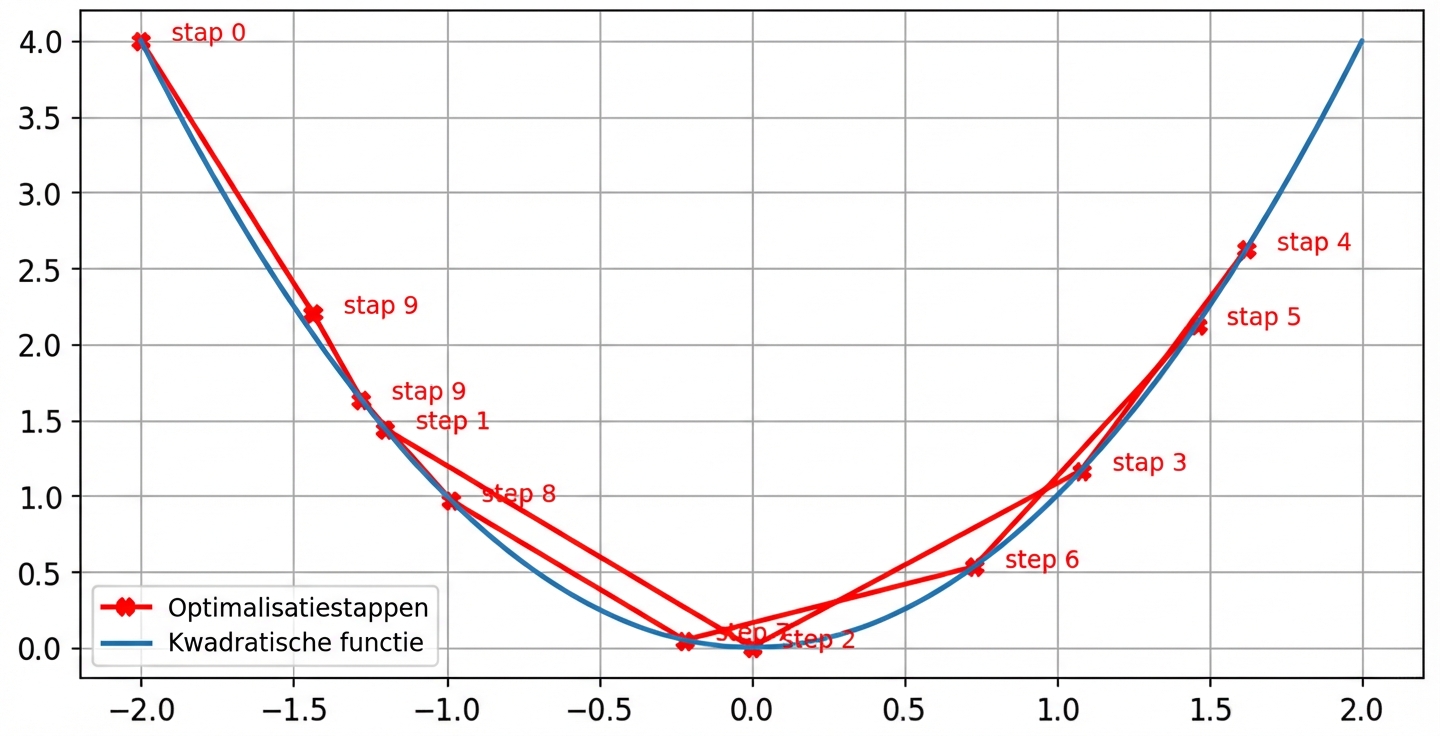

Effect van de learning rate: hoge learning rate

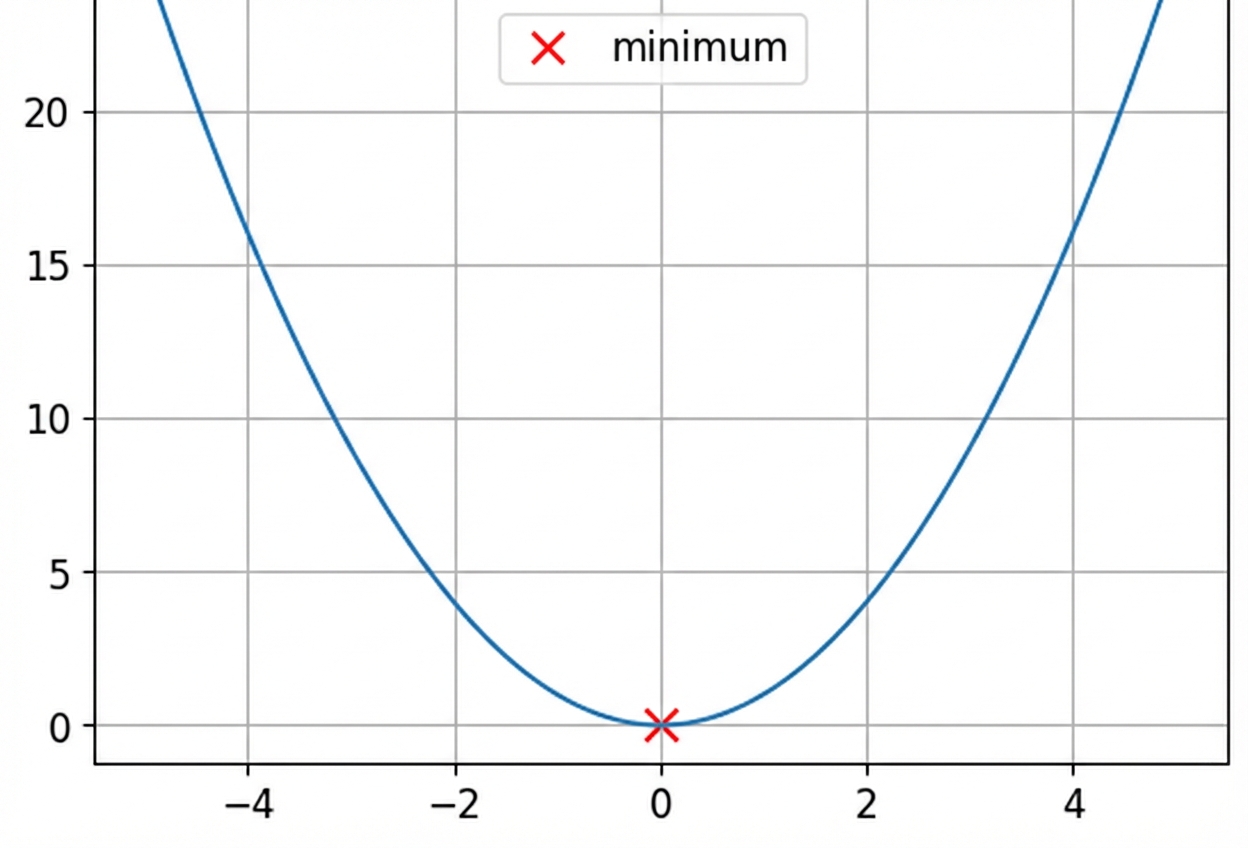

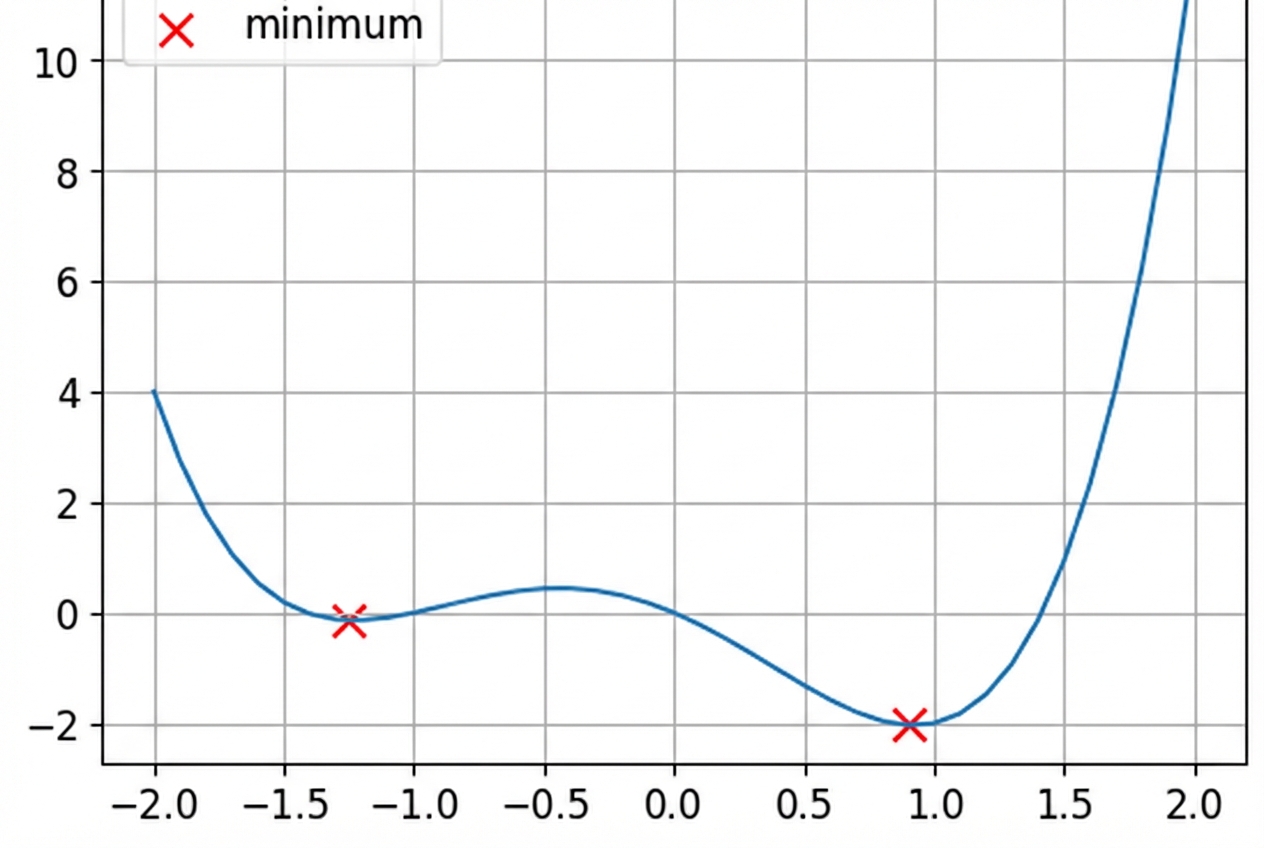

Convexe en niet-convexe functies

Dit is een convexe functie.

Dit is een niet-convexe functie.

- Lossfuncties zijn niet-convex

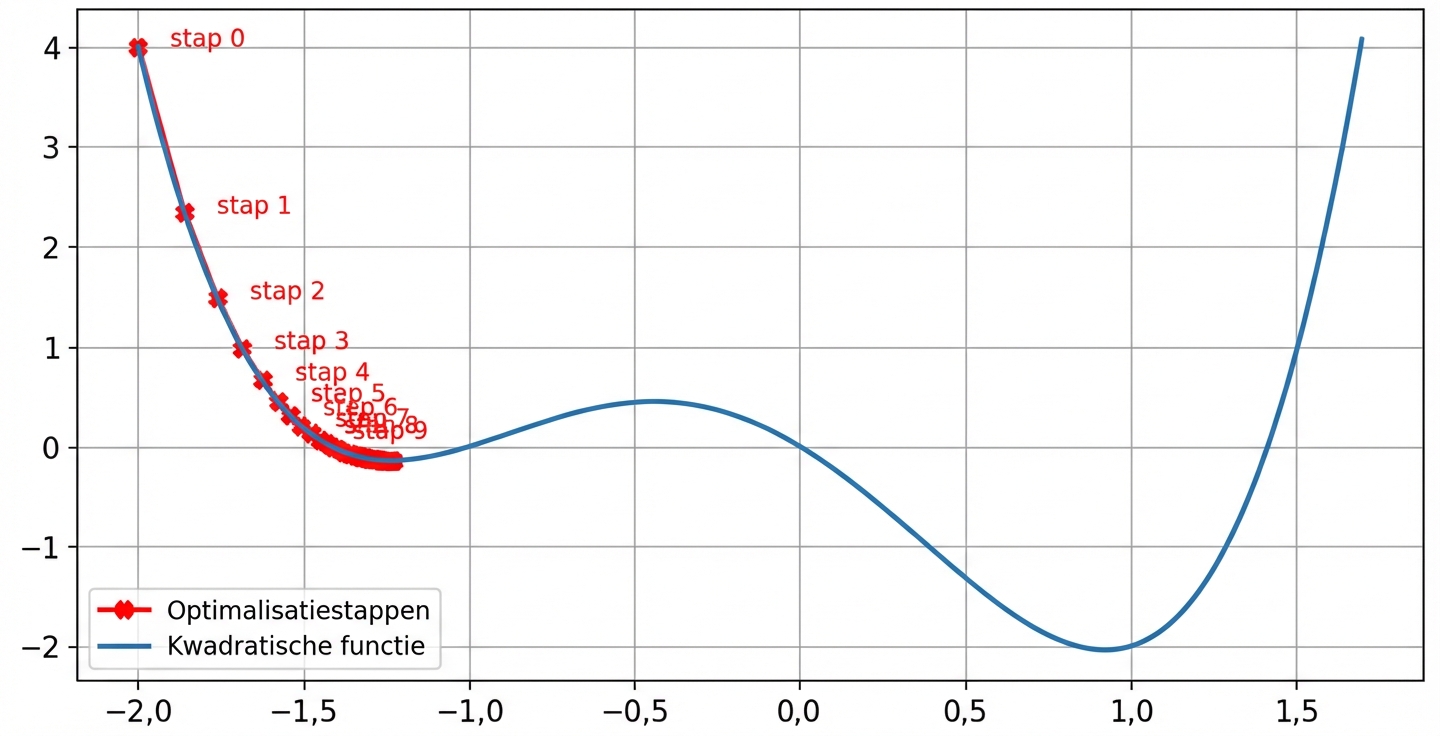

Zonder momentum

lr = 0.01momentum = 0, na 100 stappen minimum gevonden bijx = -1.23eny = -0.14

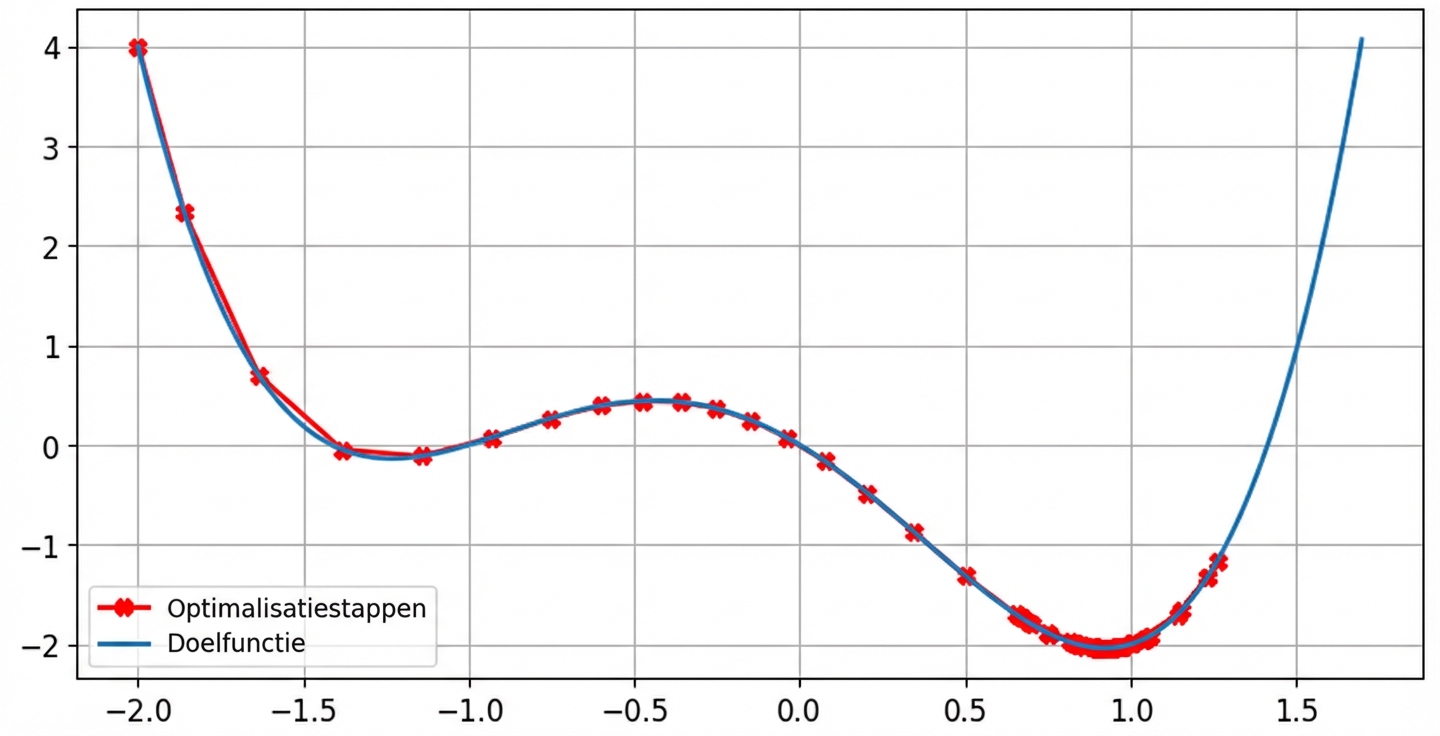

Met momentum

lr = 0.01momentum = 0.9, na 100 stappen minimum gevonden bijx = 0.92eny = -2.04

Samenvatting

$$

| Learning rate | Momentum |

|---|---|

| Bepaalt de stapgrootte | Bepaalt de traagheid |

| Te hoog → slechte prestaties | Helpt lokale minima te ontwijken |

| Te laag → traag trainen | Te klein → optimizer blijft hangen |

| Typisch bereik: 0.01 ($10^{-2}$) en 0.0001 ($10^{-4}$) | Typisch bereik: 0.85–0.99 |

Laten we oefenen!

Introductie tot Deep Learning met PyTorch