Fijn-afstemming

Concepten van Large Language Models (LLMs)

Vidhi Chugh

AI strategist and ethicist

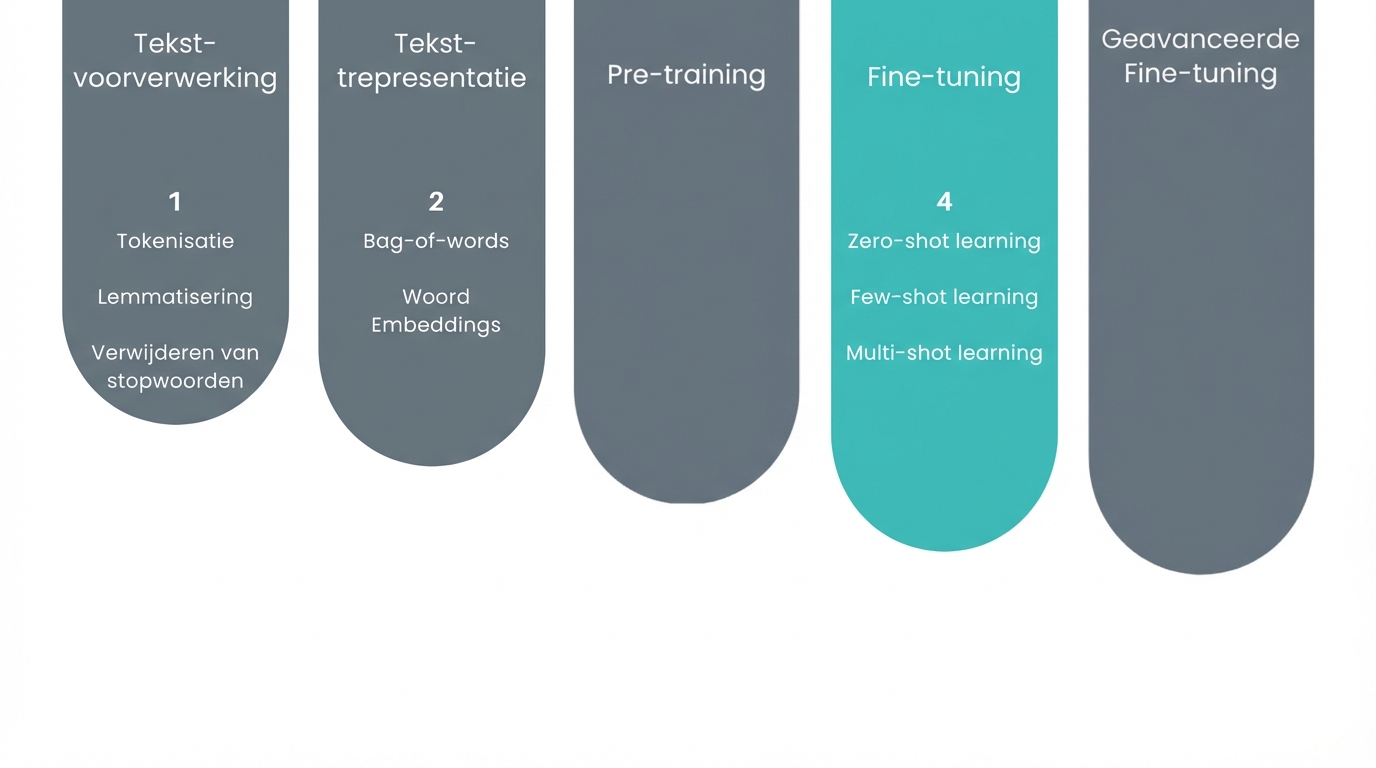

Waar zijn we?

- Pre-training

Schoolopleiding

- Fine-tuning

Universitaire specialisatie

1 Freepik

Uitdagingen van ‘grootte’

- Fine-tuning kan helpen

- Krachtige computers

- Efficiënte trainingsmethoden

- Grote hoeveelheden trainingsdata

Rekenkracht

Geheugen

Verwerkingskracht

Infrastructuur

Duur

- LLM:

- Honderdduizenden Central Processing Units (CPU’s)

- Tienduizenden Graphic Processing Units (GPU’s)

- Een pc: 4-8 CPU en 1-2 GPU’s

1 Freepik

Efficiënt model trainen

- Trainingstijd is enorm

- Duurt weken tot maanden

- Efficiënt trainen = kortere trainingstijd

- 355 jaar rekentijd op één GPU

Data-beschikbaarheid

- Hoge-kwaliteit data nodig

- Om taalkundige nuances en complexiteit te leren

Enkele honderden gigabytes (GB) tekstdata

- Meer dan een miljoen boeken

Enorme hoeveelheid data

De uitdagingen aanpakken

- Fine-tuning

- Pakt enkele van deze uitdagingen aan

- Past een voorgetraind model aan

- Voorgetraind model

- Getraind op algemene datasets

- Niet geoptimaliseerd voor specifieke taken

- Is fijn-af te stemmen voor een specifiek probleem

Fine-tuning vs. Pre-training

Fine-tuning

Compute

- 1-2 CPU’s en GPU’s

- Trainingstijd

- Uren tot dagen

- Data

- ~1 gigabyte

Pre-training

Compute

- Duizenden CPU’s en GPU’s

- Trainingstijd

- Weken tot maanden

- Data

- Honderden gigabytes

Laten we oefenen!

Concepten van Large Language Models (LLMs)