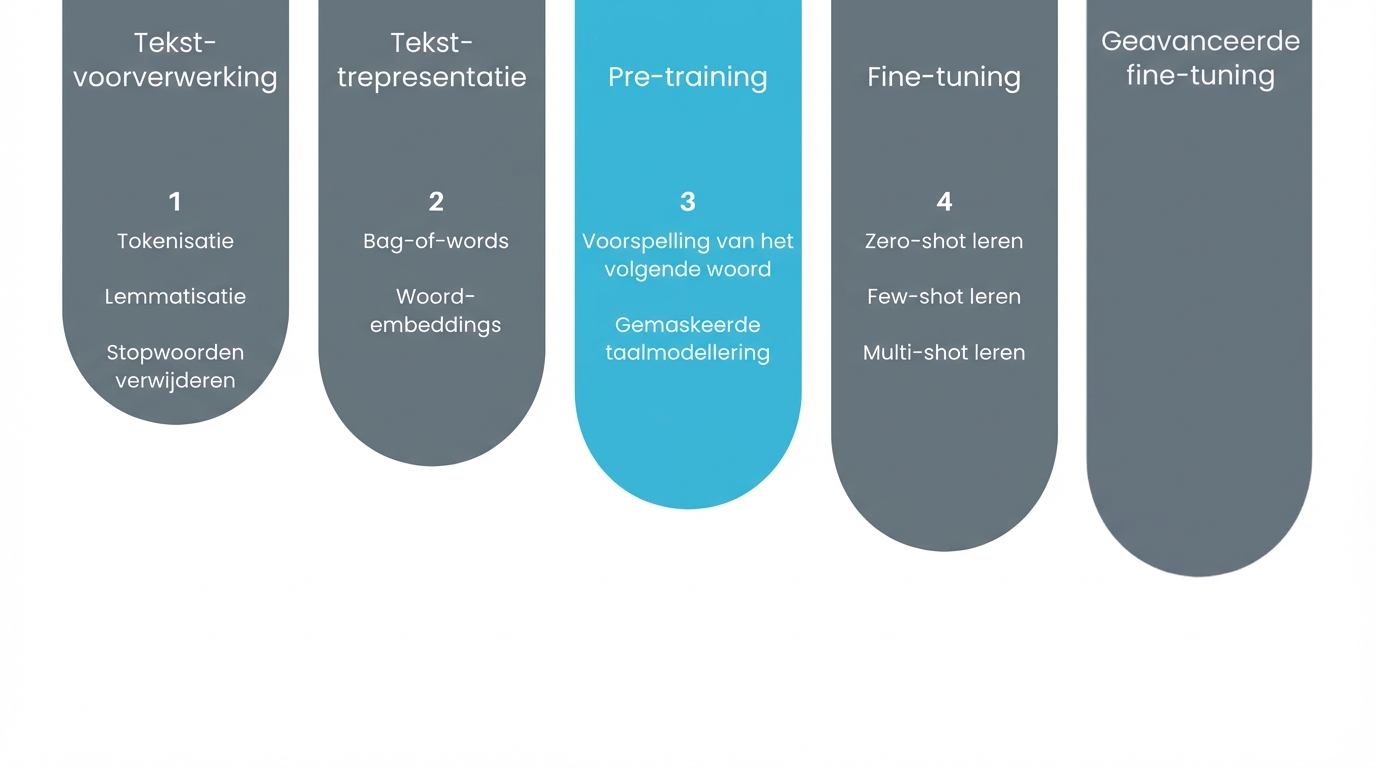

Bouwstenen om LLM's te trainen

Concepten van Large Language Models (LLMs)

Vidhi Chugh

AI strategist and ethicist

Waar staan we?

Generative pre-training

Getraind met generative pre-training

- Invoergegevens van teksttokens

- Getraind om tokens in de dataset te voorspellen

- Typen:

- Volgend woord voorspellen

- Masked language modeling

Volgend woord voorspellen

- Supervised learning-techniek

- Model getraind op input-outputparen

- Voorspelt het volgende woord en genereert samenhangende tekst

- Vangt afhankelijkheden tussen woorden

- Trainingsdata

- Paren van input- en outputvoorbeelden

Trainingsdata voor volgend woord voorspellen

Input

The quick brown

The quick brown fox

The quick brown fox jumps

The quick brown fox jumps over

The quick brown fox jumps over the

The quick brown fox jumps over the lazy

The quick brown fox jumps over the lazy dog.

Output

fox

jumps

over

the

lazy

dog

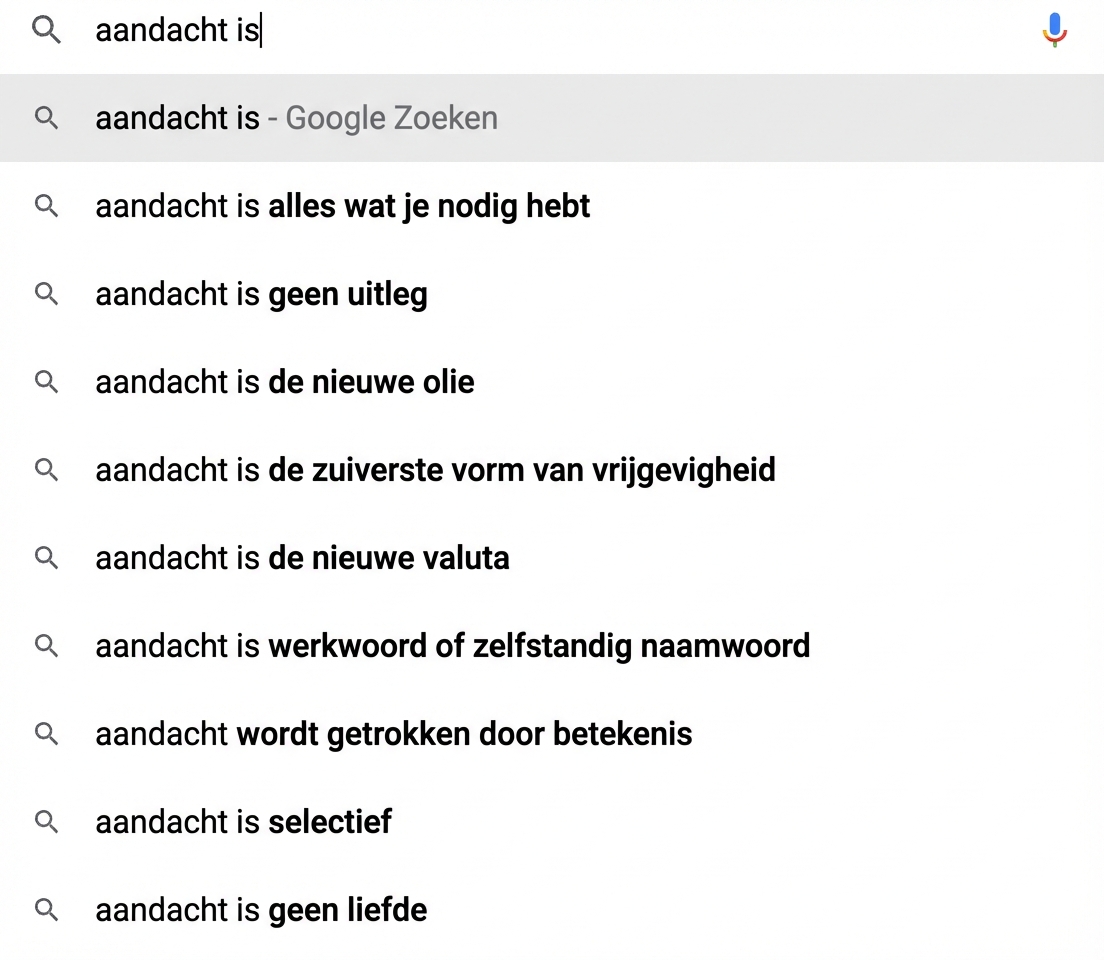

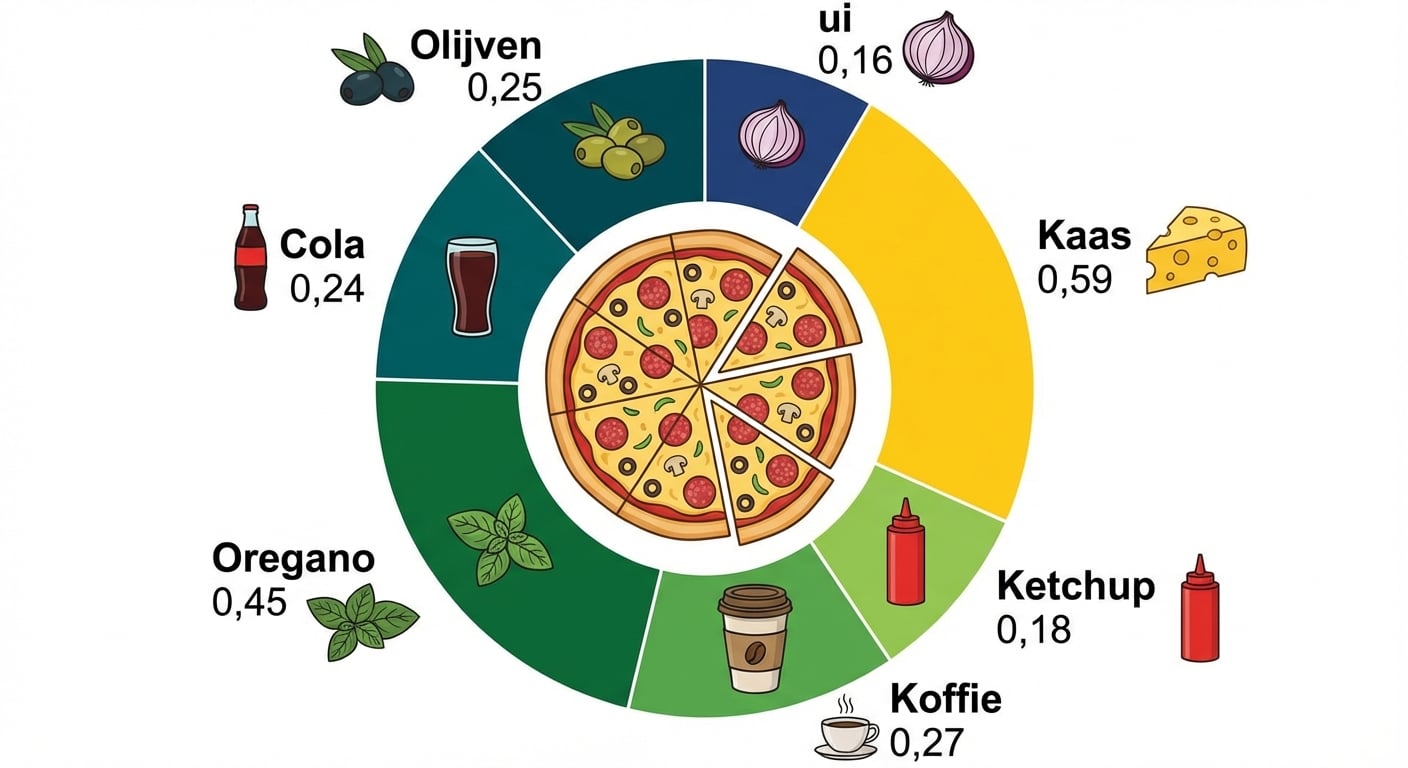

Welk woord past beter bij pizza?

- Meer voorbeelden = betere voorspelling

- Bijvoorbeeld:

- I love to eat pizza with _ _ _ _ _ _

- Cheese is meer gerelateerd aan pizza dan iets anders

Masked language modeling

Verbergt een gekozen woord

Getraind model voorspelt het gemaskeerde woord

Originele tekst: "The quick brown fox jumps over the lazy dog."

Gemaskeerde tekst: "The quick [MASK] fox jumps over the lazy dog."

Doel: voorspel het ontbrekende woord

Gebaseerd op wat is geleerd uit trainingsdata

Laten we oefenen!

Concepten van Large Language Models (LLMs)