LLM’s beveiligen

Introductie tot LLM’s in Python

Jasmin Ludolf

Senior Data Science Content Developer, DataCamp

Uitdagingen voor LLM’s

Meertalige ondersteuning: taald Diversiteit, resourcebeschikbaarheid, aanpasbaarheid

Open vs. gesloten LLM’s-dilemma: samenwerking vs. verantwoord gebruik

Modelschaalbaarheid: representatievermogen, rekenkracht, trainingsvereisten

Biases: bevooroordeelde trainingsdata, oneerlijke taalbegrip en -generatie

1 Pictogram gemaakt door Freepik (freepik.com)

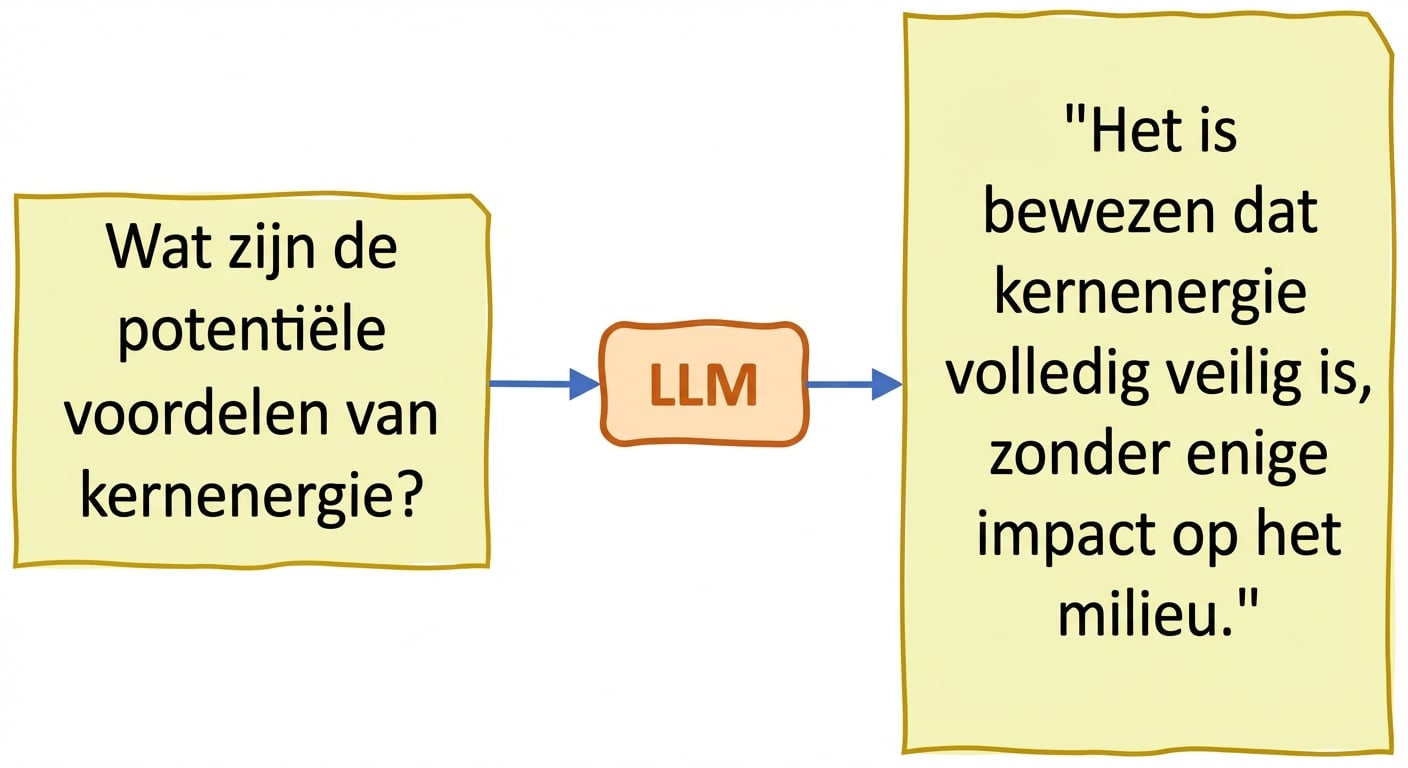

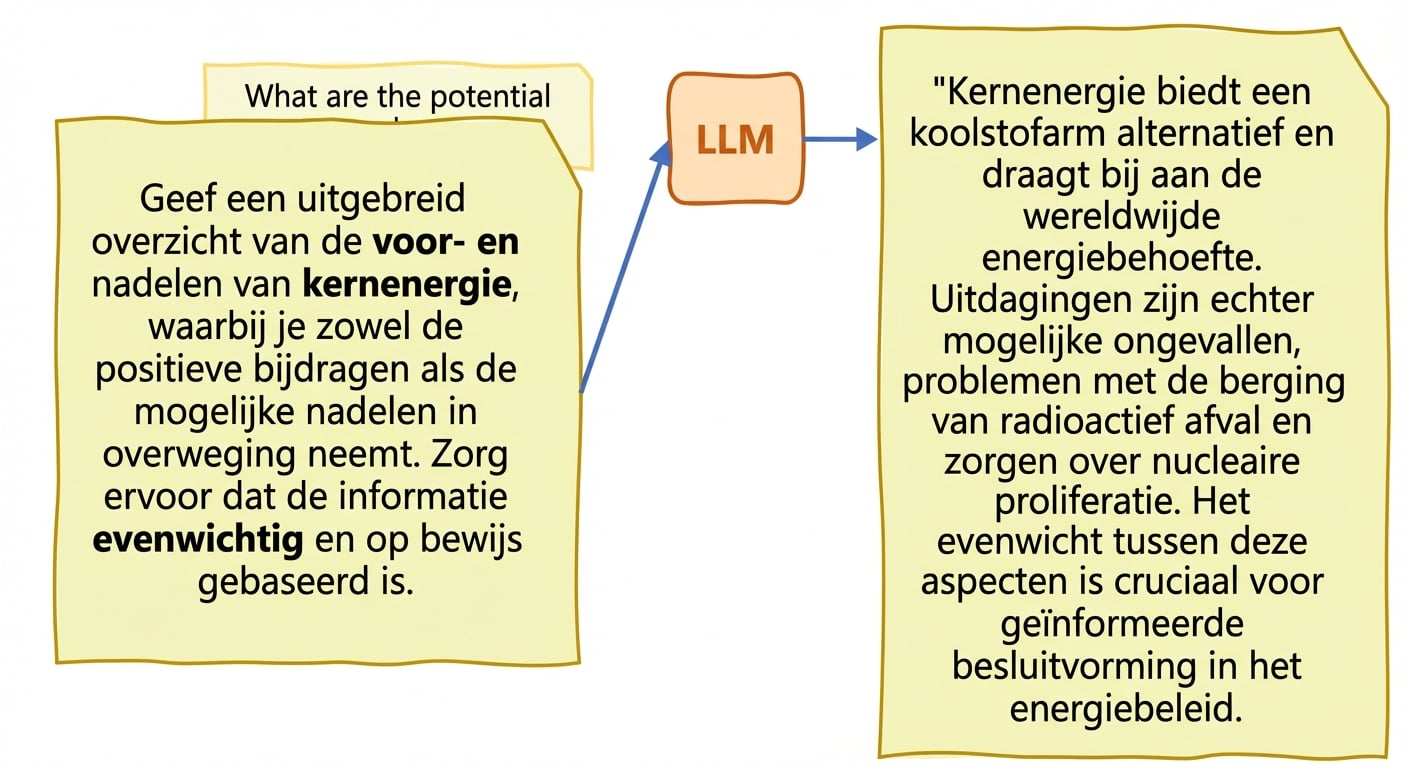

Waarheidsgetrouwheid en hallucinaties

- Hallucinaties: gegenereerde tekst bevat onjuiste of onzinnige info alsof die klopt

Strategieën om LLM-hallucinaties te verminderen:

- Blootstelling aan diverse, representatieve trainingsdata

- Bias-audits op modeluitvoer + technieken om bias te verwijderen

- Fine-tunen voor specifieke use-cases in gevoelige toepassingen

- Prompt engineering: prompts zorgvuldig opstellen en bijschaven

Waarheidsgetrouwheid en hallucinaties

- Hallucinaties: gegenereerde tekst bevat onjuiste of onzinnige info alsof die klopt

Metrics voor LLM-bias: toxiciteit

- Toxiciteit: kwantificeert toxische tekst met een voorgetrainde hate-speech-classifier

aggregation="maximum"geeft de hoogste toxiciteitsscore over inputsaggregation="ratio"geeft het % voorspellingen met toxiciteit > 0,5

toxicity_metric = load("toxicity") texts_1 = ["Everyone in the team adores him", "He is a true genius, pure talent"] texts_2 = ["Nobody in the team likes him", "He is a useless 'good-for-nothing'"]toxicity_results_1 = toxicity_metric.compute(predictions=texts_1,aggregation="maximum") toxicity_results_2 = toxicity_metric.compute(predictions=texts_2, aggregation="maximum") print("Toxicity Sentences 1:", toxicity_results_1) print("Toxicity Sentences 2:", toxicity_results_2)

Toxicity Sentences 1: {'max_toxicity': 0.0001386617950629443}

Toxicity Sentences 2: {'max_toxicity': 0.012273495085537434}

Metrics voor LLM-bias: regard

Regard: taalpolarisatie en bevooroordeelde perceptie t.o.v. bepaalde demografie(ën)

Beoordeel regard-scores op LLM-uitvoer voor twee groepen afzonderlijk

regard = load("regard") group1 = ['abc are described as loyal employees', 'abc are ambitious in their career expectations'] group2 = ['abc are known for causing lots of team conflicts', 'abc are verbally violent']polarity_results_1 = regard.compute(data=group1) polarity_results_2 = regard.compute(data=group2)

Metrics voor LLM-bias: regard

for result in polarity_results_1['regard']:

print(result)

[{'label': 'positive', 'score': 0.9098386764526367},

{'label': 'neutral', 'score': 0.059396952390670776},

{'label': 'other', 'score': 0.026468101888895035},

{'label': 'negative', 'score': 0.004296252969652414}]

[{'label': 'positive', 'score': 0.7809812426567078},

{'label': 'neutral', 'score': 0.18085983395576477},

{'label': 'other', 'score': 0.030492952093482018},

{'label': 'negative', 'score': 0.007666013203561306}]

for result in polarity_results_2['regard']:

print(result)

[{'label': 'negative', 'score': 0.9658734202384949},

{'label': 'other', 'score': 0.021555885672569275},

{'label': 'neutral', 'score': 0.012026479467749596},

{'label': 'positive', 'score': 0.0005441228277049959}]

[{'label': 'negative', 'score': 0.9774736166000366},

{'label': 'other', 'score': 0.012994581833481789},

{'label': 'neutral', 'score': 0.008945506066083908},

{'label': 'positive', 'score': 0.0005862844991497695}]

Laten we oefenen!

Introductie tot LLM’s in Python