Features transformeren voor betere clustering

Unsupervised Learning in Python

Benjamin Wilson

Director of Research at lateral.io

Piëmont-wijnendataset

178 samples van 3 rodewijnsoorten: Barolo, Grignolino en Barbera

Features meten chemische samenstelling, bijv. alcoholgehalte

Visuele eigenschappen zoals “kleurintensiteit”

De wijnen clusteren

from sklearn.cluster import KMeans

model = KMeans(n_clusters=3)

labels = model.fit_predict(samples)

Clusters vs. variëteiten

df = pd.DataFrame({'labels': labels, 'varieties': varieties}) ct = pd.crosstab(df['labels'], df['varieties'])print(ct)

varieties Barbera Barolo Grignolino

labels

0 29 13 20

1 0 46 1

2 19 0 50

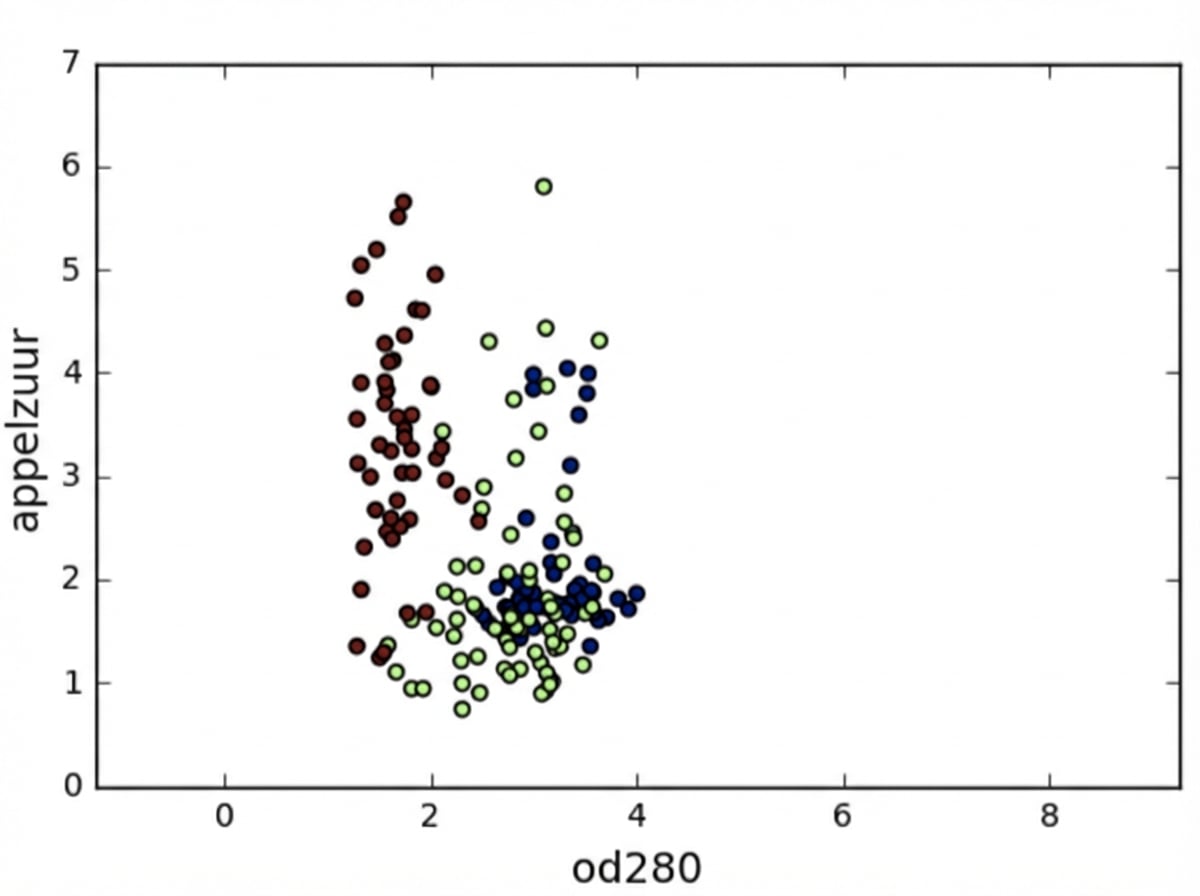

Featurevarianties

De wijnfeatures hebben heel verschillende varianties!

De variantie van een feature meet de spreiding van de waarden

feature variance

alcohol 0.65

malic_acid 1.24

...

od280 0.50

proline 99166.71

Featurevarianties

De wijnfeatures hebben heel verschillende varianties!

De variantie van een feature meet de spreiding van de waarden

feature variance

alcohol 0.65

malic_acid 1.24

...

od280 0.50

proline 99166.71

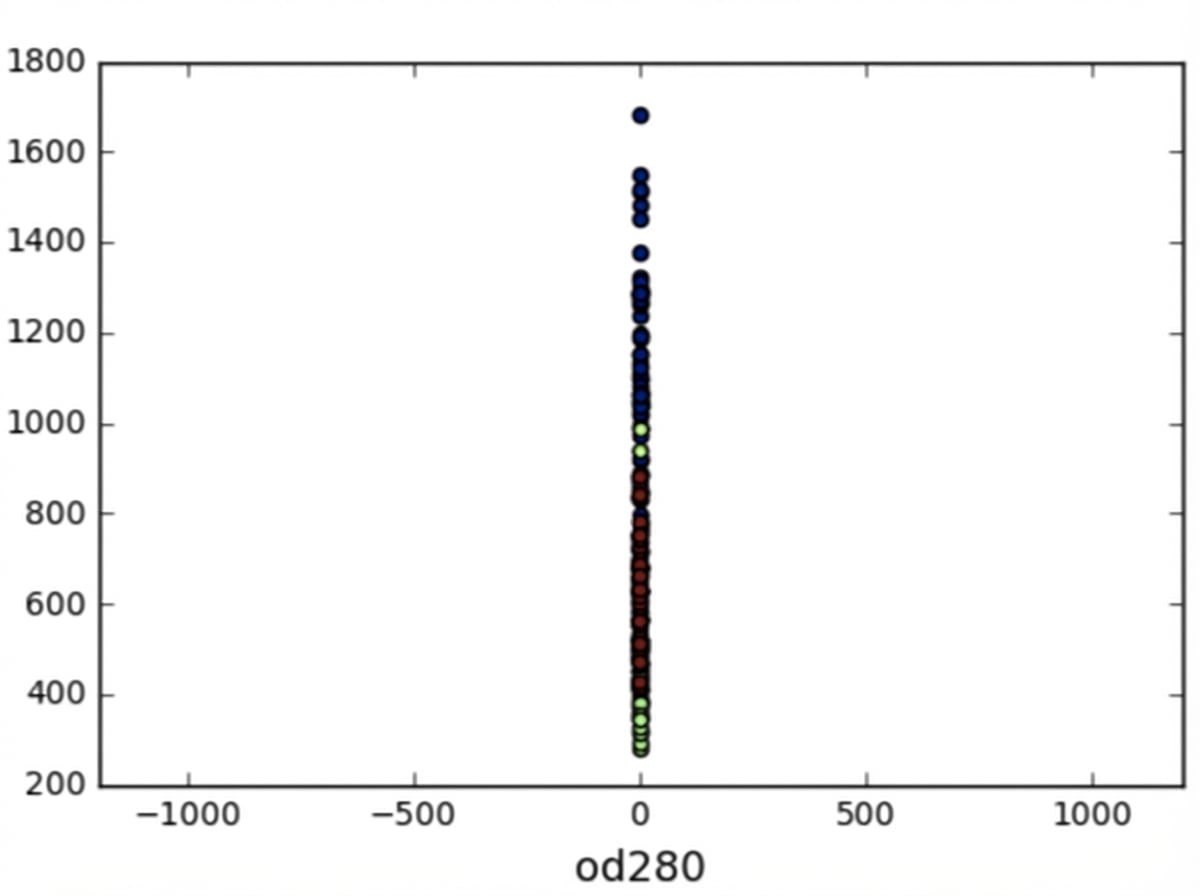

StandardScaler

In kmeans: featurevariantie = invloed van feature

StandardScalerzet elke feature om naar gemiddelde 0 en variantie 1Features zijn dan “gestandaardiseerd”

sklearn StandardScaler

from sklearn.preprocessing import StandardScalerscaler = StandardScaler()scaler.fit(samples) StandardScaler(copy=True, with_mean=True, with_std=True)samples_scaled = scaler.transform(samples)

Vergelijkbare methods

StandardScalerenKMeanshebben vergelijkbare methodsGebruik

fit()/transform()metStandardScalerGebruik

fit()/predict()metKMeans

Eerst StandardScaler, dan KMeans

Twee stappen nodig:

StandardScaler, daarnaKMeansGebruik een

sklearn-pipeline om stappen te combinerenData stroomt van de ene stap naar de volgende

Pipelines combineren meerdere stappen

from sklearn.preprocessing import StandardScaler from sklearn.cluster import KMeans scaler = StandardScaler() kmeans = KMeans(n_clusters=3)from sklearn.pipeline import make_pipelinepipeline = make_pipeline(scaler, kmeans)pipeline.fit(samples)

Pipeline(steps=...)

labels = pipeline.predict(samples)

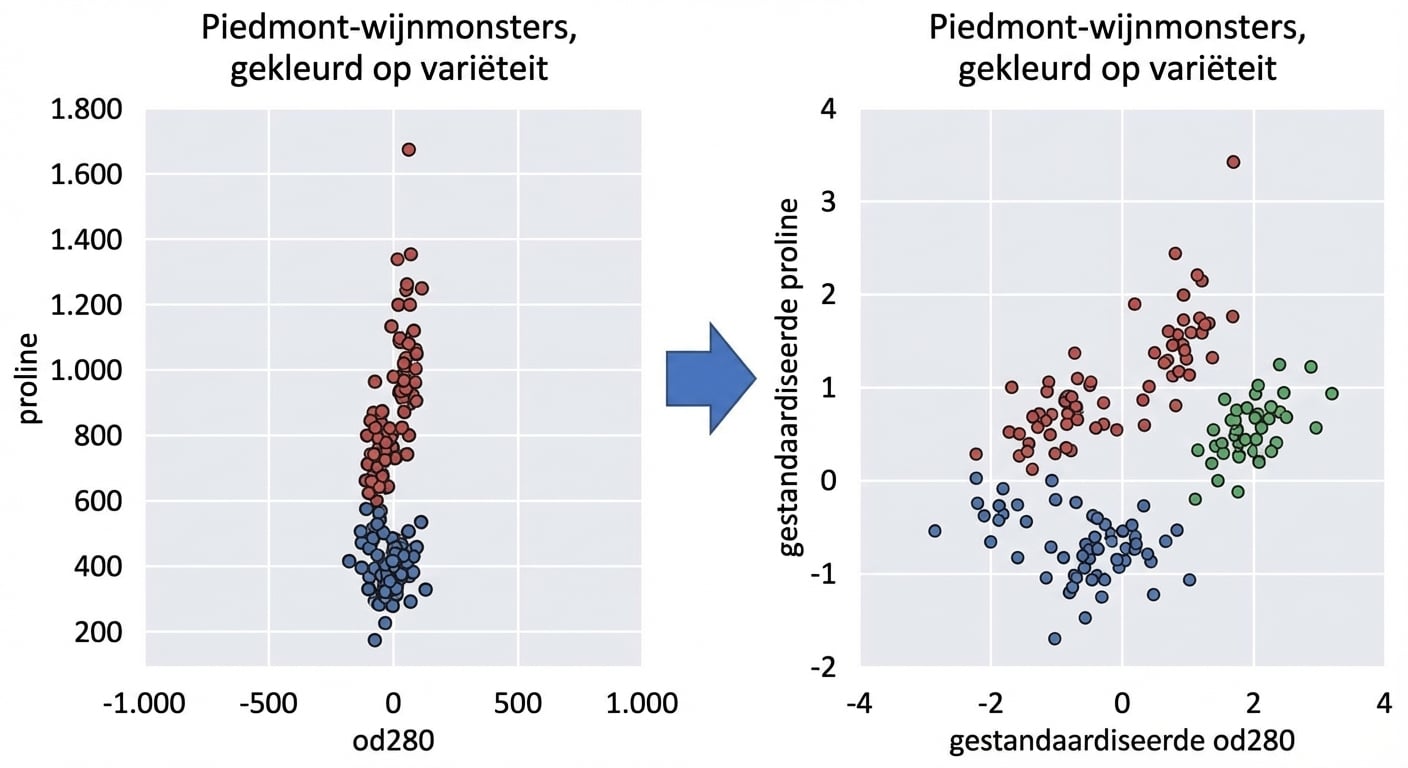

Standaardiseren verbetert clustering

Met featurestandaardisatie:

varieties Barbera Barolo Grignolino

labels

0 0 59 3

1 48 0 3

2 0 0 65

Zonder featurestandaardisatie was het erg slecht:

varieties Barbera Barolo Grignolino

labels

0 29 13 20

1 0 46 1

2 19 0 50

sklearn preprocessing-stappen

StandardScaleris een preprocessing-stapMaxAbsScalerenNormalizerzijn andere voorbeelden

Laten we oefenen!

Unsupervised Learning in Python