Random forests

Machine Learning met boomgebaseerde modellen in Python

Elie Kawerk

Data Scientist

Bagging

Basisestimator: Decision Tree, Logistic Regression, Neural Net, ...

Elke estimator wordt getraind op een aparte bootstrap-steekproef van de trainingset

Estimators gebruiken alle features voor training en predictie

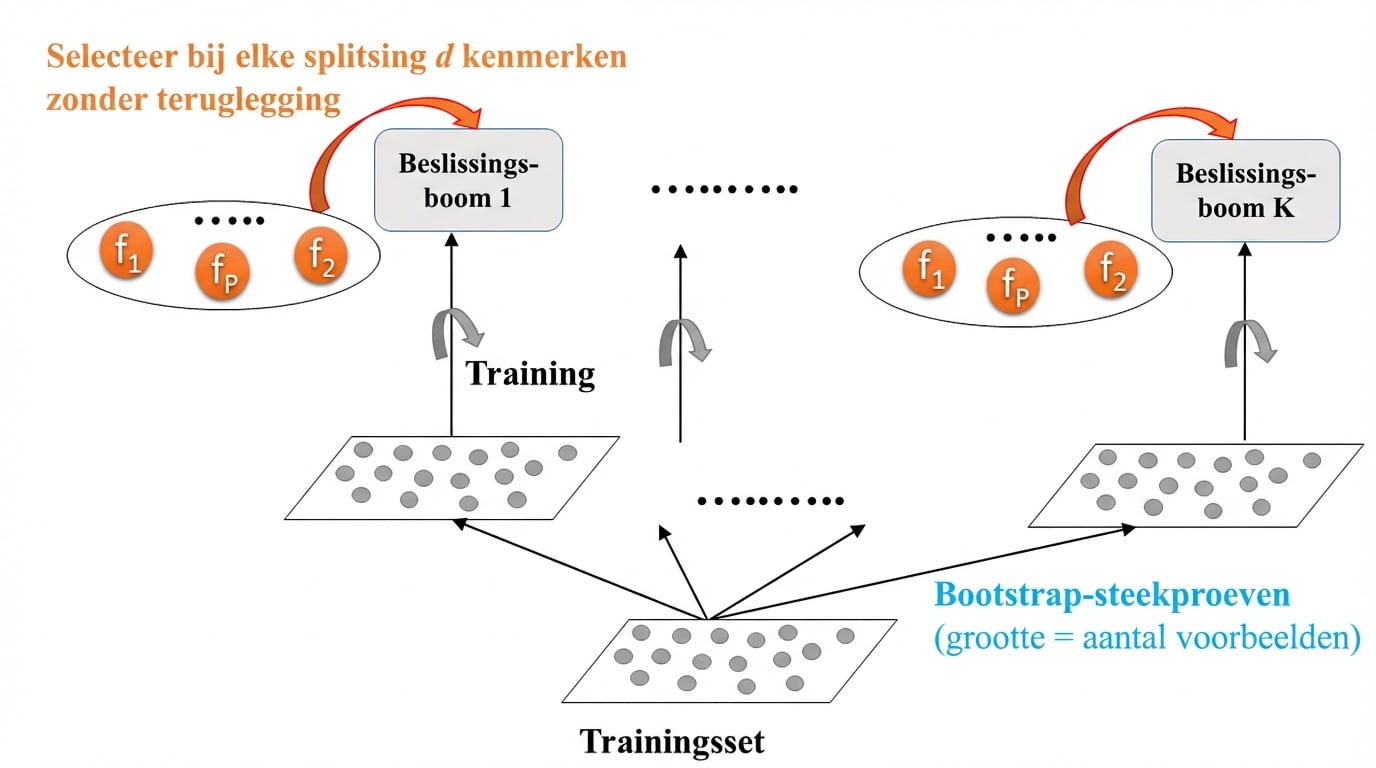

Extra diversiteit met random forests

Basisestimator: Decision Tree

Elke estimator traint op een andere bootstrap-steekproef met dezelfde grootte als de trainingset

RF voegt extra randomisatie toe aan de training van individuele bomen

Er worden per knoop d features zonder terugleggen getrokken

( d < totaal aantal features )

Random forests: training

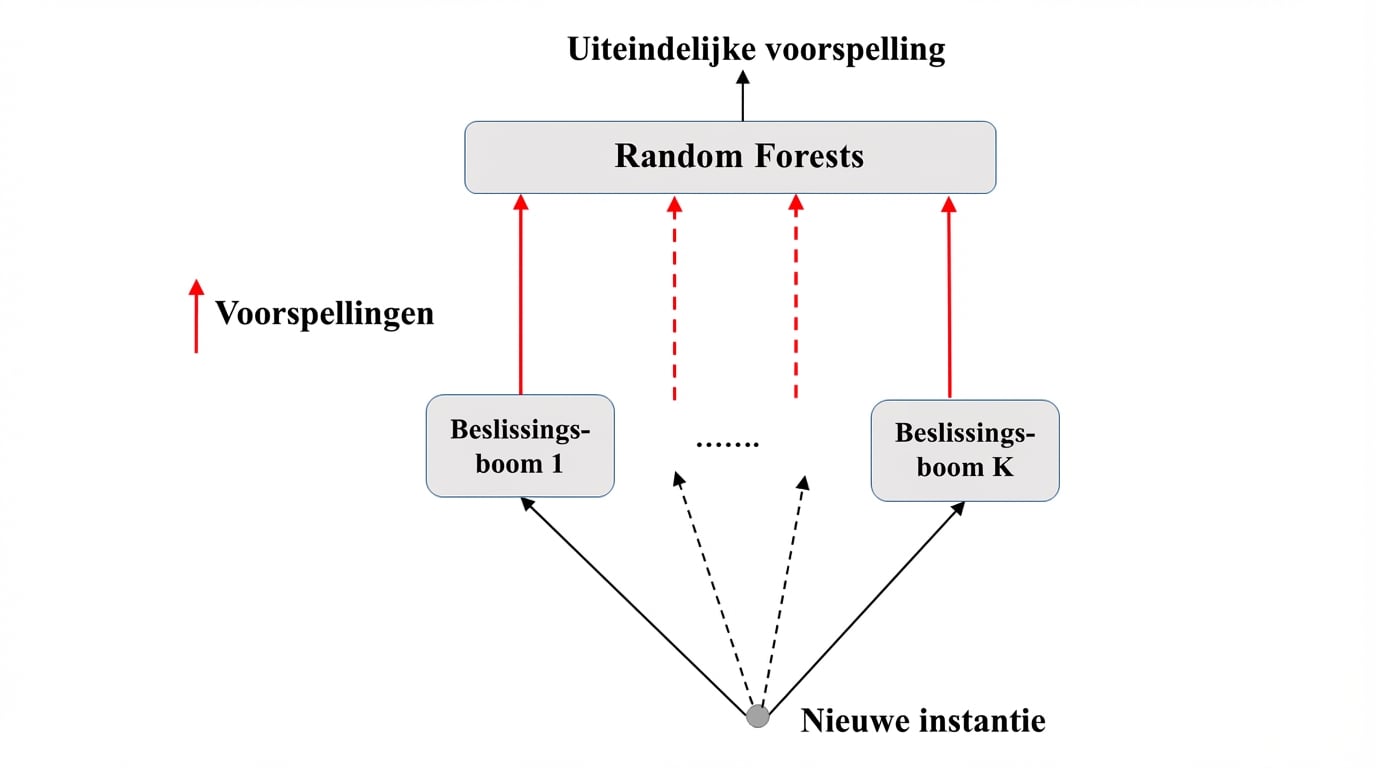

Random forests: predictie

Random forests: classificatie & regressie

Classificatie:

- Aggregreert voorspellingen via meerderheid van stemmen

RandomForestClassifierin scikit-learn

Regressie:

- Aggregreert voorspellingen via gemiddelden

RandomForestRegressorin scikit-learn

RandomForestRegressor in sklearn (auto-dataset)

# Basic imports

from sklearn.ensemble import RandomForestRegressor

from sklearn.model_selection import train_test_split

from sklearn.metrics import mean_squared_error as MSE

# Set seed for reproducibility

SEED = 1

# Split dataset into 70% train and 30% test

X_train, X_test, y_train, y_test = train_test_split(X, y,

test_size=0.3,

random_state=SEED)

# Instantieer een random forest-regressor 'rf' met 400 estimators rf = RandomForestRegressor(n_estimators=400, min_samples_leaf=0.12, random_state=SEED)# Fit 'rf' op de trainingset rf.fit(X_train, y_train) # Voorspel de testlabels 'y_pred' y_pred = rf.predict(X_test)

# Evalueer de RMSE op de testset

rmse_test = MSE(y_test, y_pred)**(1/2)

# Print de RMSE van de testset

print('Test set RMSE of rf: {:.2f}'.format(rmse_test))

Test set RMSE of rf: 3.98

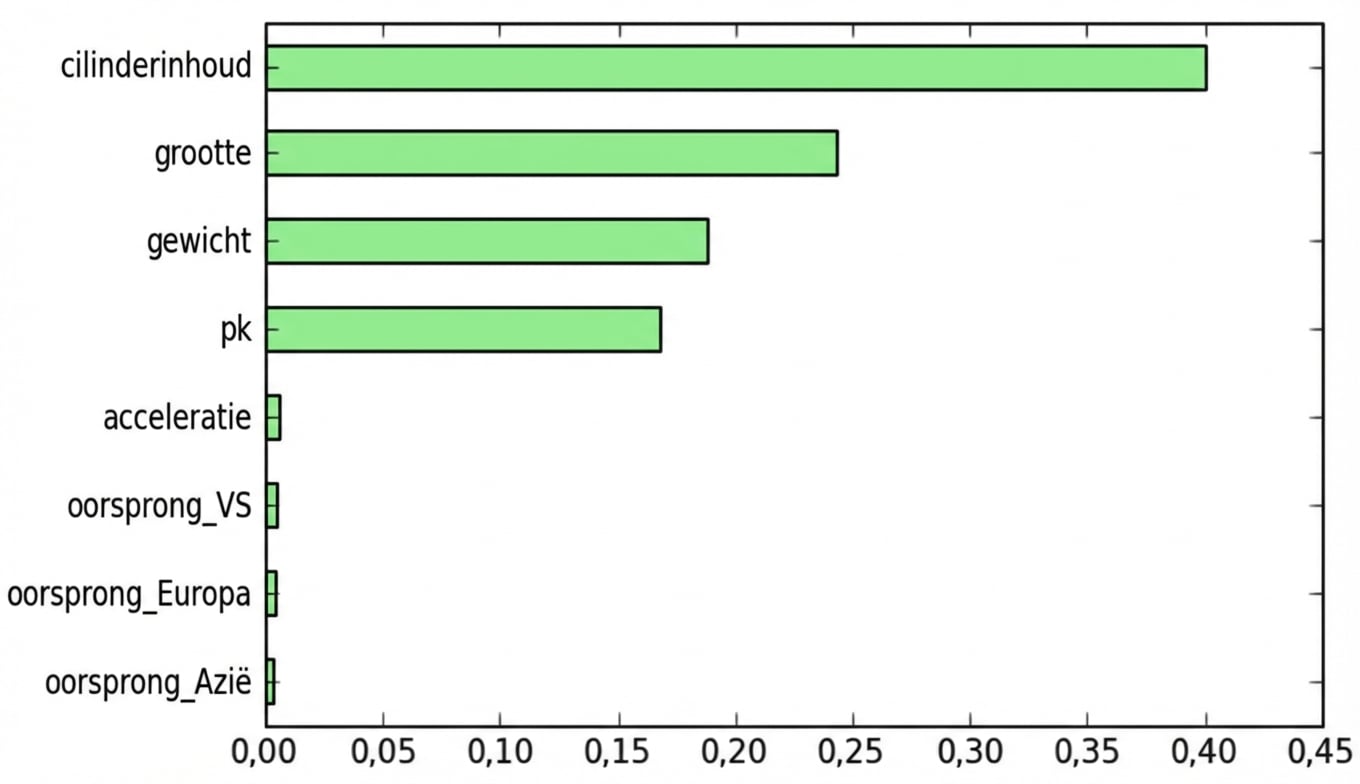

Feature-importance

Bomenmethoden: maken het mogelijk het belang van elke feature in de voorspelling te meten.

In sklearn:

- hoeveel boomknooppunten een feature gebruiken (gewogen gemiddelde) om onzuiverheid te verlagen

- op te vragen via het attribuut

feature_importance_

Feature-importance in sklearn

import pandas as pd

import matplotlib.pyplot as plt

# Maak een pd.Series met feature-importances

importances_rf = pd.Series(rf.feature_importances_, index = X.columns)

# Sorteer importances_rf

sorted_importances_rf = importances_rf.sort_values()

# Maak een horizontale staafgrafiek

sorted_importances_rf.plot(kind='barh', color='lightgreen'); plt.show()

Feature-importance in sklearn

Laten we oefenen!

Machine Learning met boomgebaseerde modellen in Python