Gradient Boosting (GB)

Machine Learning met boomgebaseerde modellen in Python

Elie Kawerk

Data Scientist

Gradient Boosted Trees

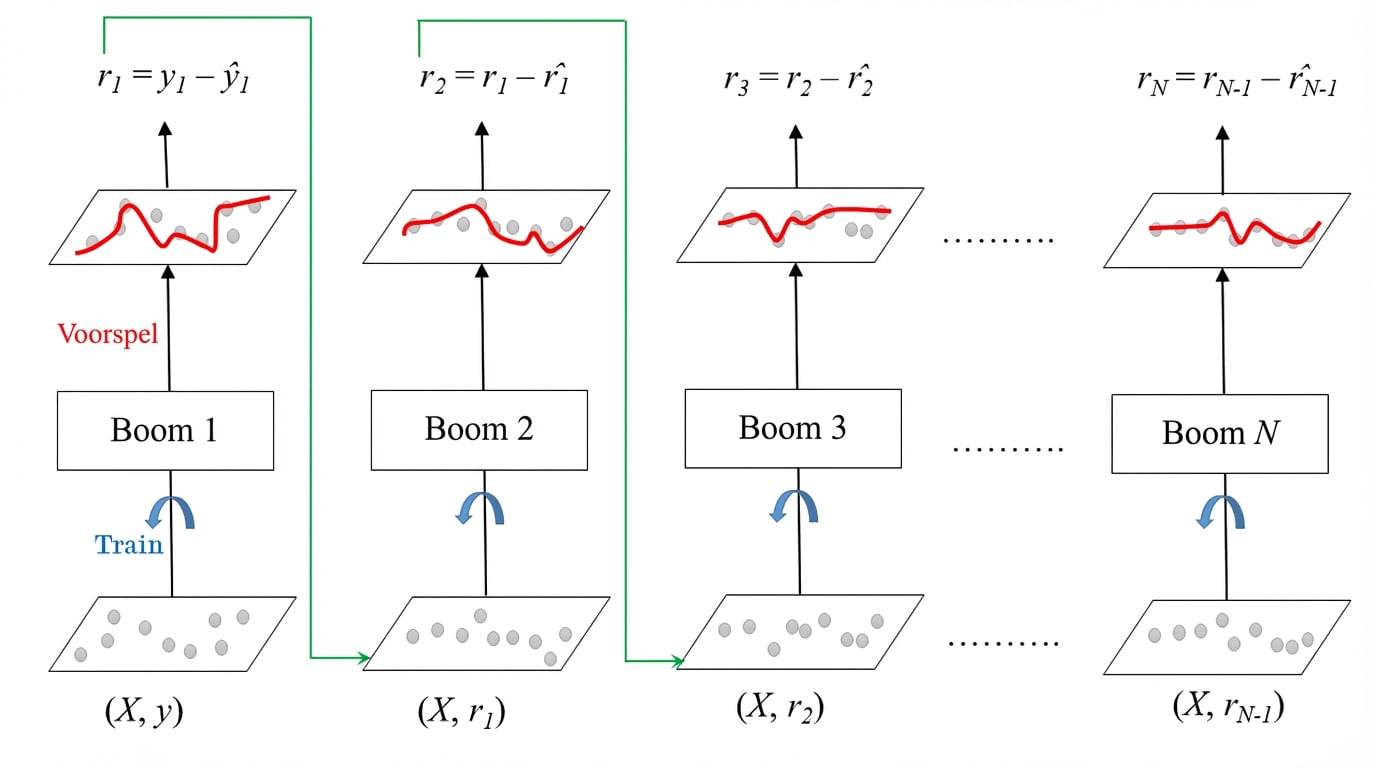

Fouten van voorgangers sequentieel corrigeren.

Past de gewichten van trainingsinstanties niet aan.

Elke voorspeller wordt getraind op de residuen van z’n voorganger.

Gradient Boosted Trees: een CART als basisleer.

Gradient Boosted Trees voor regressie: training

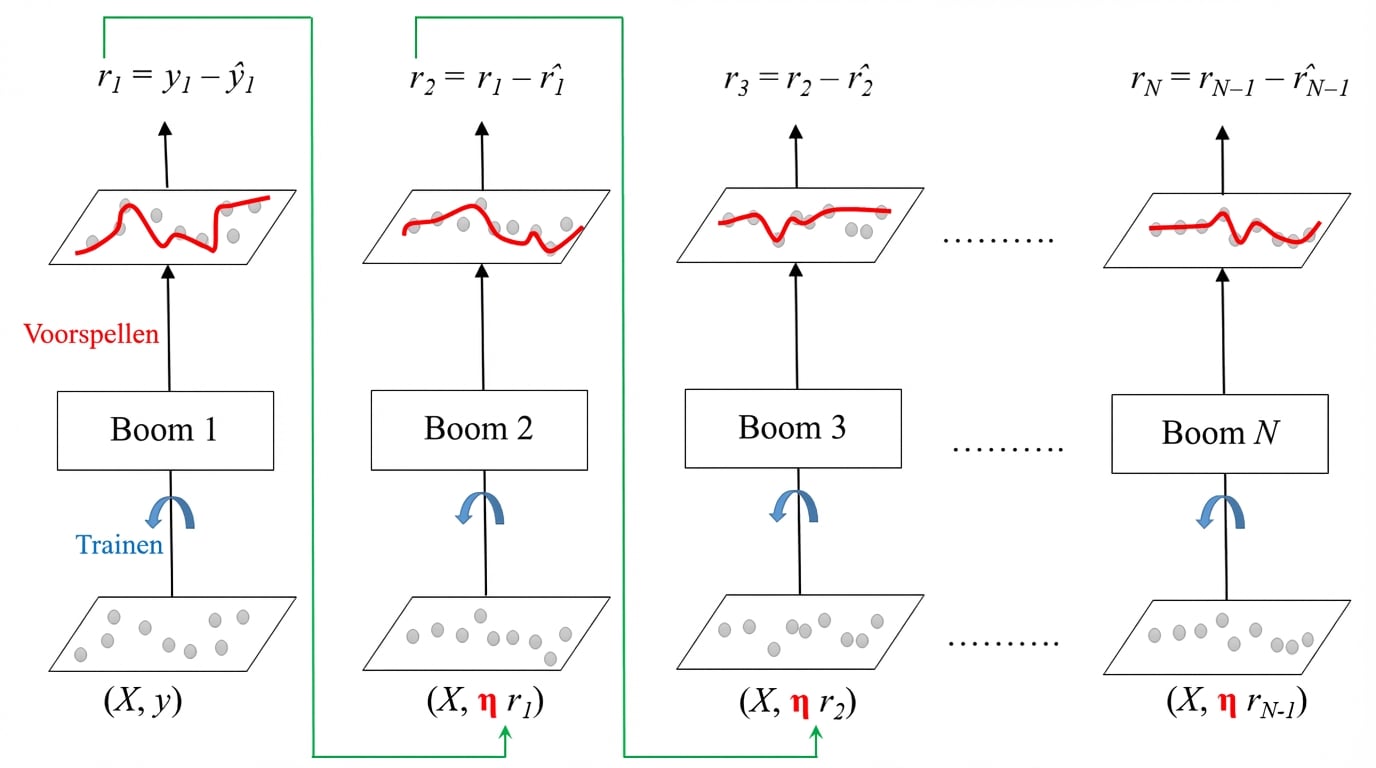

Shrinkage

Gradient Boosted Trees: voorspellen

Regressie:

- $y_{pred} = y_1 + \eta r_1 + ... + \eta r_N$

- In sklearn:

GradientBoostingRegressor.

Classificatie:

- In sklearn:

GradientBoostingClassifier.

- In sklearn:

Gradient Boosting in sklearn (auto-dataset)

# Importeer modellen en hulpfuncties

from sklearn.ensemble import GradientBoostingRegressor

from sklearn.model_selection import train_test_split

from sklearn.metrics import mean_squared_error as MSE

# Stel seed in voor reproduceerbaarheid

SEED = 1

# Splits dataset in 70% train en 30% test

X_train, X_test, y_train, y_test = train_test_split(X,y,

test_size=0.3,

random_state=SEED)

# Instantiateer een GradientBoostingRegressor 'gbt' gbt = GradientBoostingRegressor(n_estimators=300, max_depth=1, random_state=SEED)# Fit 'gbt' op de trainingset gbt.fit(X_train, y_train) # Voorspel de labels voor de testset y_pred = gbt.predict(X_test) # Evalueer de RMSE op de testset rmse_test = MSE(y_test, y_pred)**(1/2) # Print de RMSE van de testset print('Test set RMSE: {:.2f}'.format(rmse_test))

Test set RMSE: 4.01

Laten we oefenen!

Machine Learning met boomgebaseerde modellen in Python