Modeloptimalisatie begrijpen

Introductie tot Deep Learning in Python

Dan Becker

Data Scientist and contributor to Keras and TensorFlow libraries

Waarom optimaliseren lastig is

- Tegelijk 1000en parameters met complexe relaties optimaliseren

- Updates verbeteren het model soms nauwelijks

- Updates te klein (lage learning rate) of te groot (hoge learning rate)

Stochastic gradient descent

def get_new_model(input_shape = input_shape):

model = Sequential()

model.add(Dense(100, activation='relu', input_shape = input_shape))

model.add(Dense(100, activation='relu'))

model.add(Dense(2, activation='softmax'))

return(model)

lr_to_test = [.000001, 0.01, 1]

# Loop over learning rates

for lr in lr_to_test:

model = get_new_model()

my_optimizer = SGD(lr=lr)

model.compile(optimizer = my_optimizer, loss = 'categorical_crossentropy')

model.fit(predictors, target)

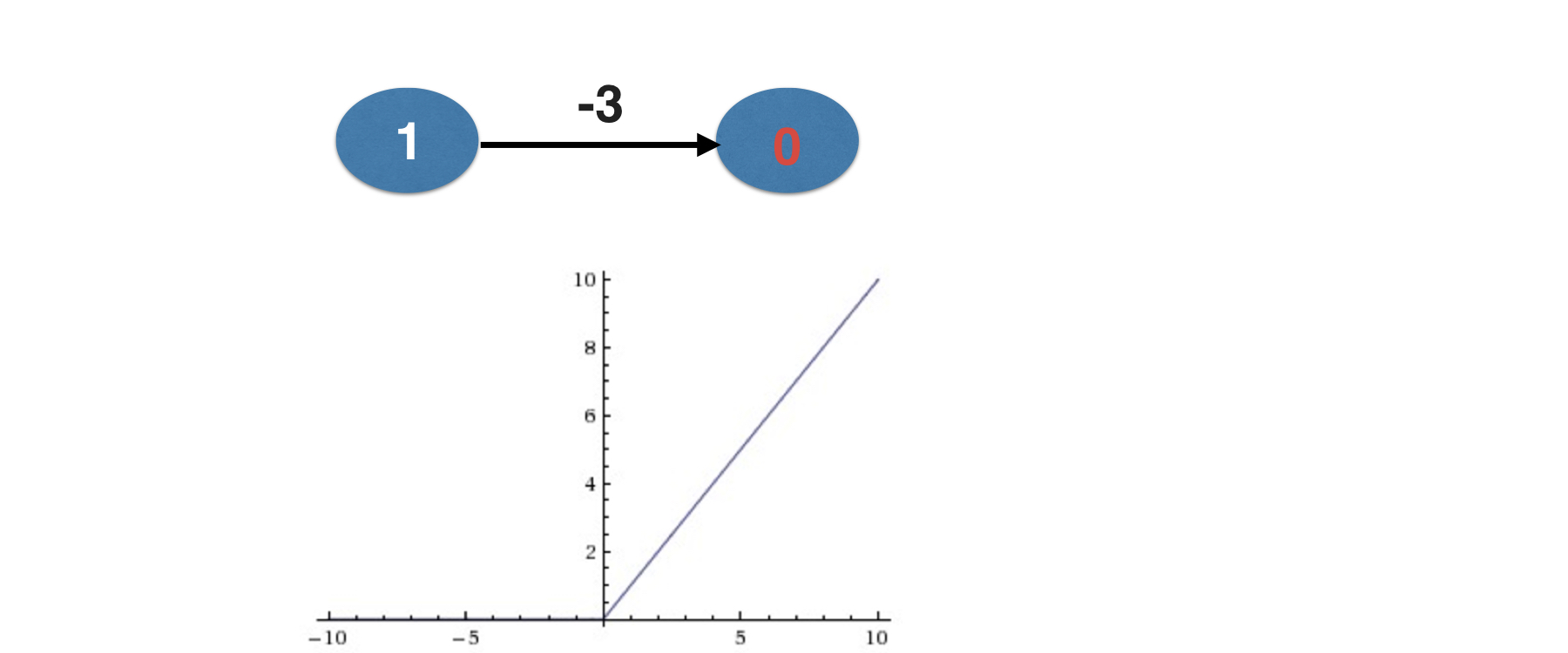

Het 'dode neuronen'-probleem

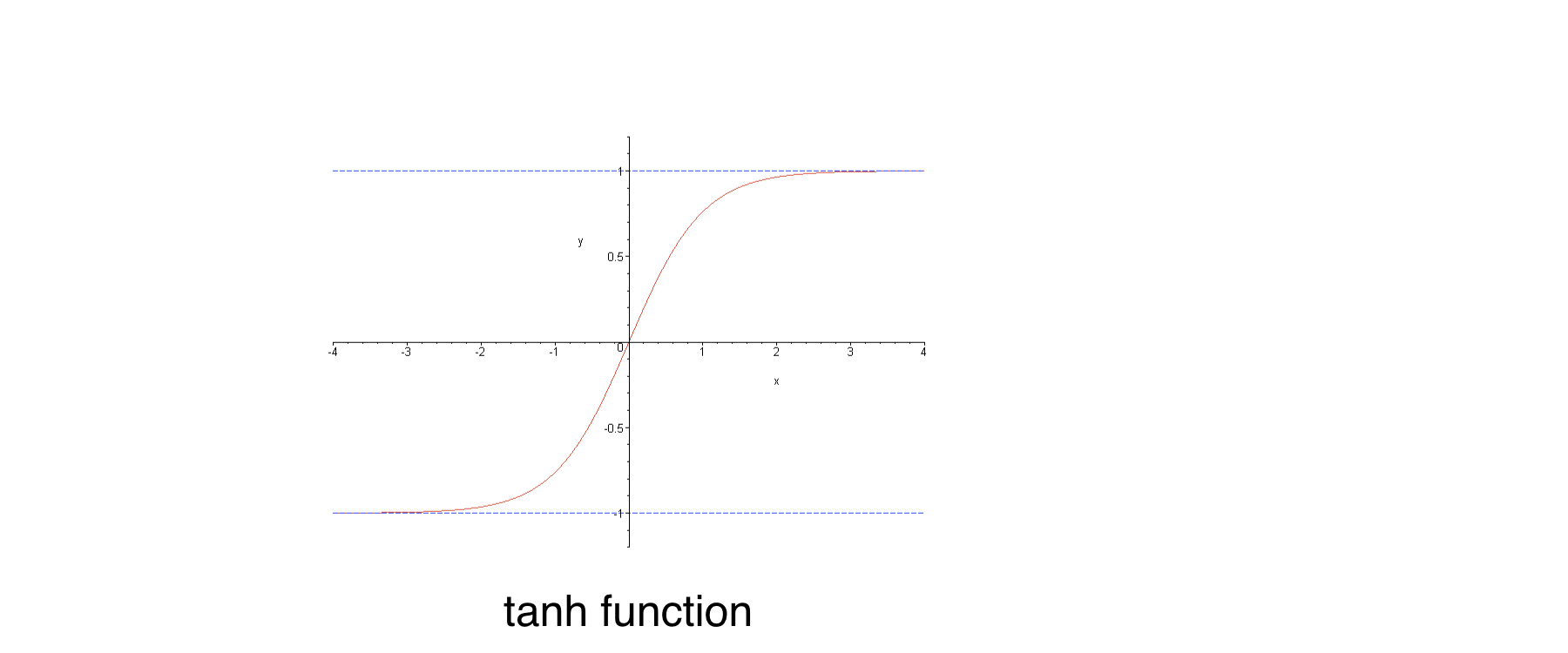

Verdrinkende gradiënten

Verdrinkende gradiënten

- Treedt op wanneer veel lagen erg kleine hellingen hebben (bv. op het vlakke deel van de tanh-curve)

- In diepe netwerken waren backprop-updates bijna 0

Laten we oefenen!

Introductie tot Deep Learning in Python