LSTM- en GRU-cellen

Gevorderde Deep Learning met PyTorch

Michal Oleszak

Machine Learning Engineer

Kortetermijngeheugenprobleem

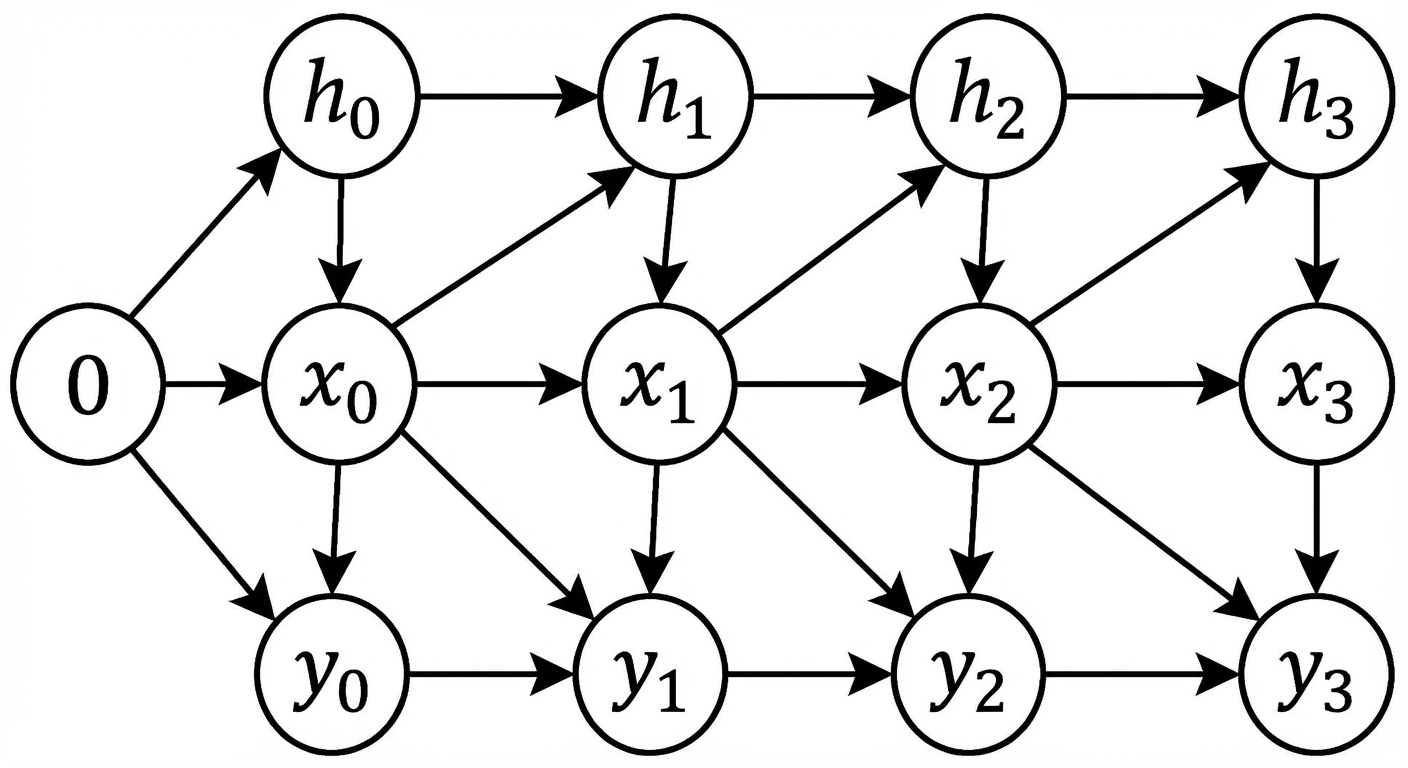

- RNN-cellen bewaren geheugen via hidden state

- Dit geheugen is zeer kortetermijn

- Twee krachtigere cellen lossen dit op:

- LSTM (Long Short-Term Memory)

- GRU (Gated Recurrent Unit)

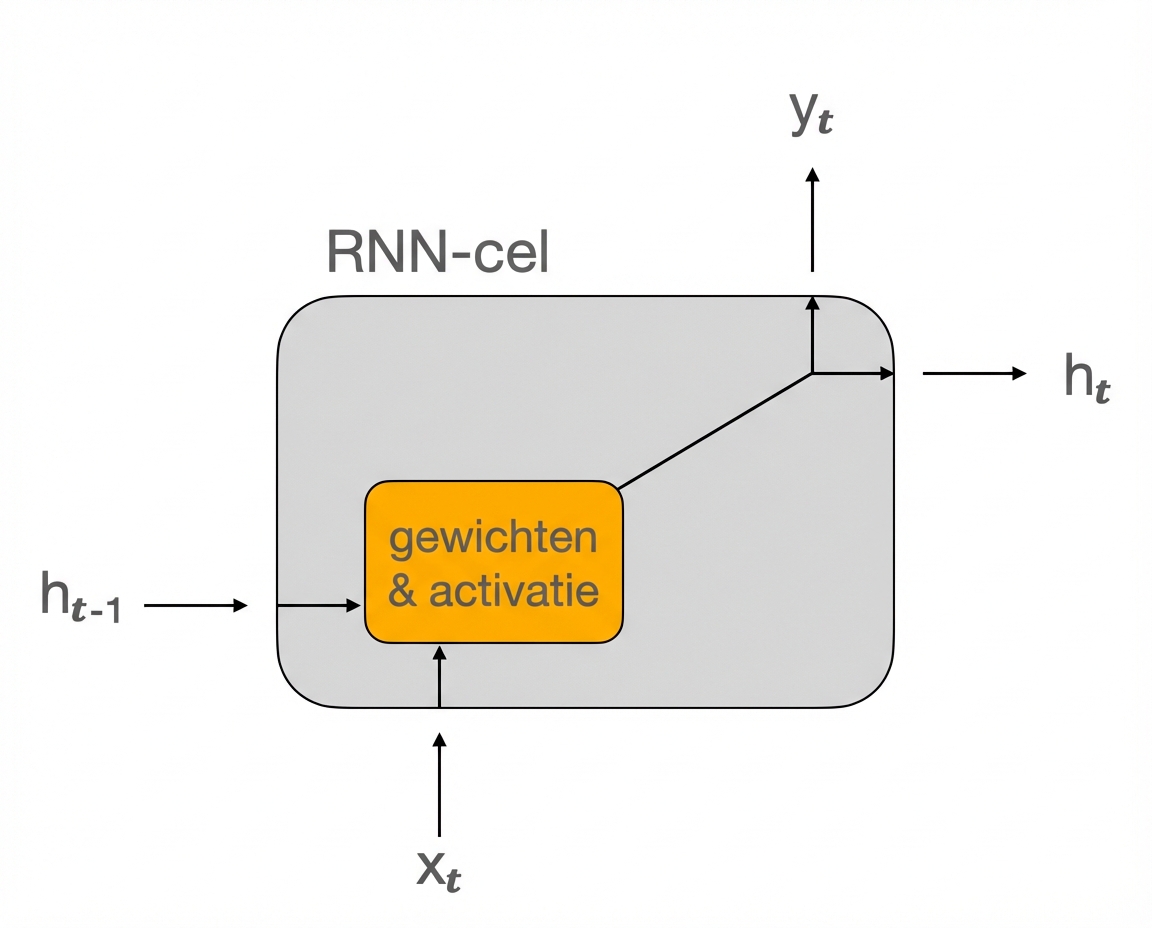

RNN-cel

- Twee inputs:

- huidige input

x - vorige hidden state

h

- huidige input

- Twee outputs:

- huidige output

y - volgende hidden state

h

- huidige output

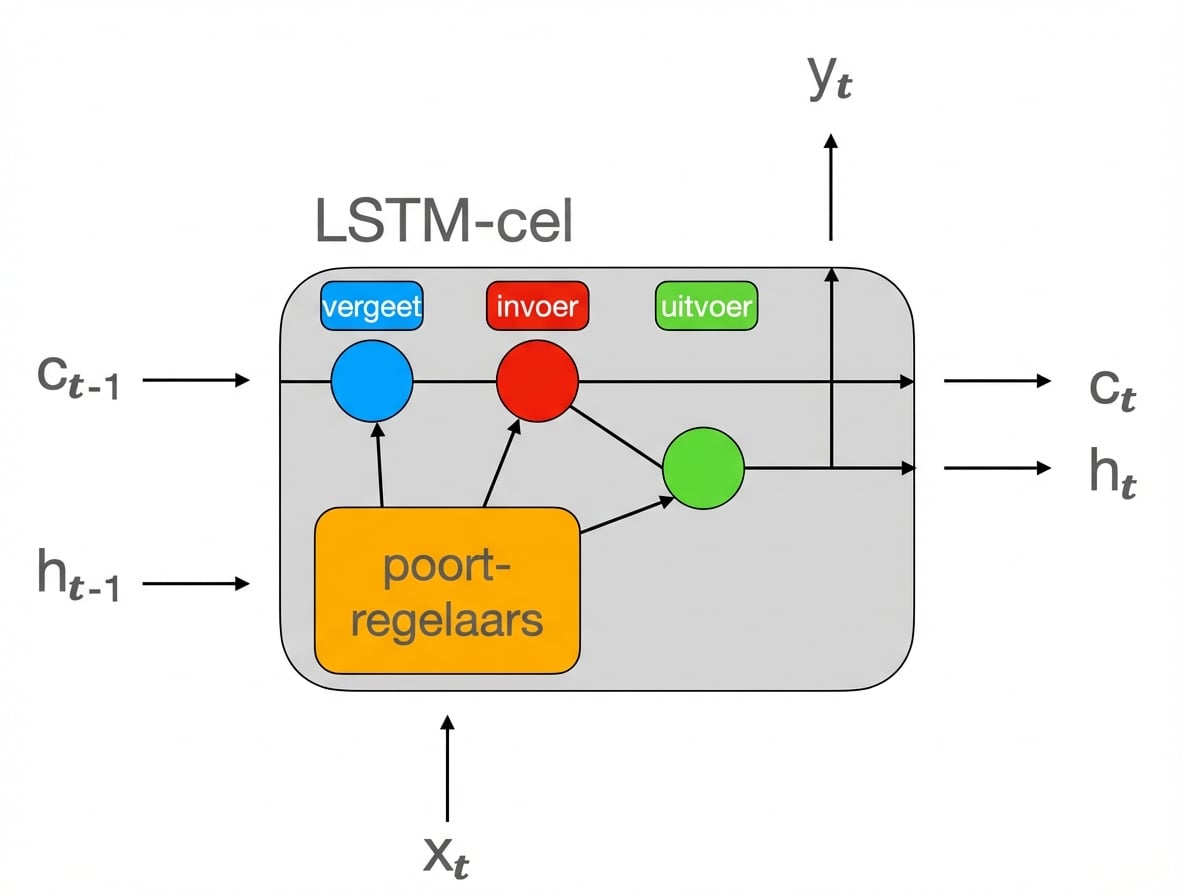

LSTM-cel

- Outputs

henyzijn hetzelfde

Drie inputs en outputs (twee hidden states):

h: kortetermijnstaatc: langetermijnstaat

Drie gates:

- Forget gate: wat te verwijderen uit langetermijngeheugen

- Input gate: wat op te slaan in langetermijngeheugen

- Output gate: wat terug te geven op de huidige tijdstap

LSTM in PyTorch

class Net(nn.Module): def __init__(self, input_size): super().__init__()self.lstm = nn.LSTM( input_size=1, hidden_size=32, num_layers=2, batch_first=True, ) self.fc = nn.Linear(32, 1)def forward(self, x): h0 = torch.zeros(2, x.size(0), 32) c0 = torch.zeros(2, x.size(0), 32)out, _ = self.lstm(x, (h0, c0))out = self.fc(out[:, -1, :]) return out

__init__():- Vervang

nn.RNNdoornn.LSTM

- Vervang

forward():- Voeg extra hidden state

ctoe - Initieer

cenhmet nullen - Geef beide hidden states door aan de

lstm-laag

- Voeg extra hidden state

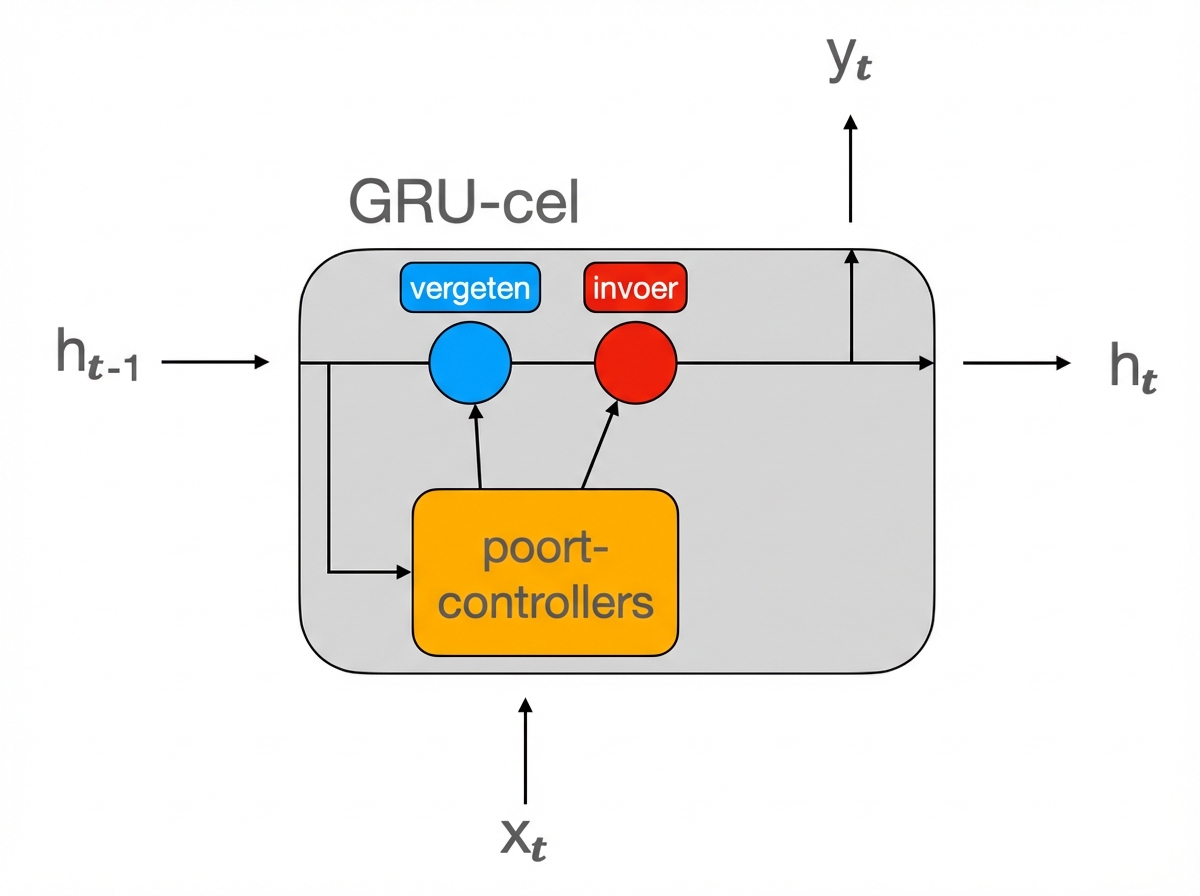

GRU-cel

- Vereenvoudigde versie van LSTM-cel

- Slechts één hidden state

- Geen output gate

GRU in PyTorch

class Net(nn.Module): def __init__(self, input_size): super().__init__()self.gru = nn.GRU( input_size=1, hidden_size=32, num_layers=2, batch_first=True, ) self.fc = nn.Linear(32, 1)def forward(self, x): h0 = torch.zeros(2, x.size(0), 32) out, _ = self.gru(x, h0) out = self.fc(out[:, -1, :]) return out

__init__():- Vervang

nn.RNNdoornn.GRU

- Vervang

forward():- Gebruik de

gru-laag

- Gebruik de

Moet ik RNN, LSTM of GRU gebruiken?

- RNN wordt weinig meer gebruikt

- GRU is eenvoudiger dan LSTM = minder rekenwerk

- Relatieve performance verschilt per use-case

- Probeer beide en vergelijk

Laten we oefenen!

Gevorderde Deep Learning met PyTorch