Recurrente neurale netwerken

Gevorderde Deep Learning met PyTorch

Michal Oleszak

Machine Learning Engineer

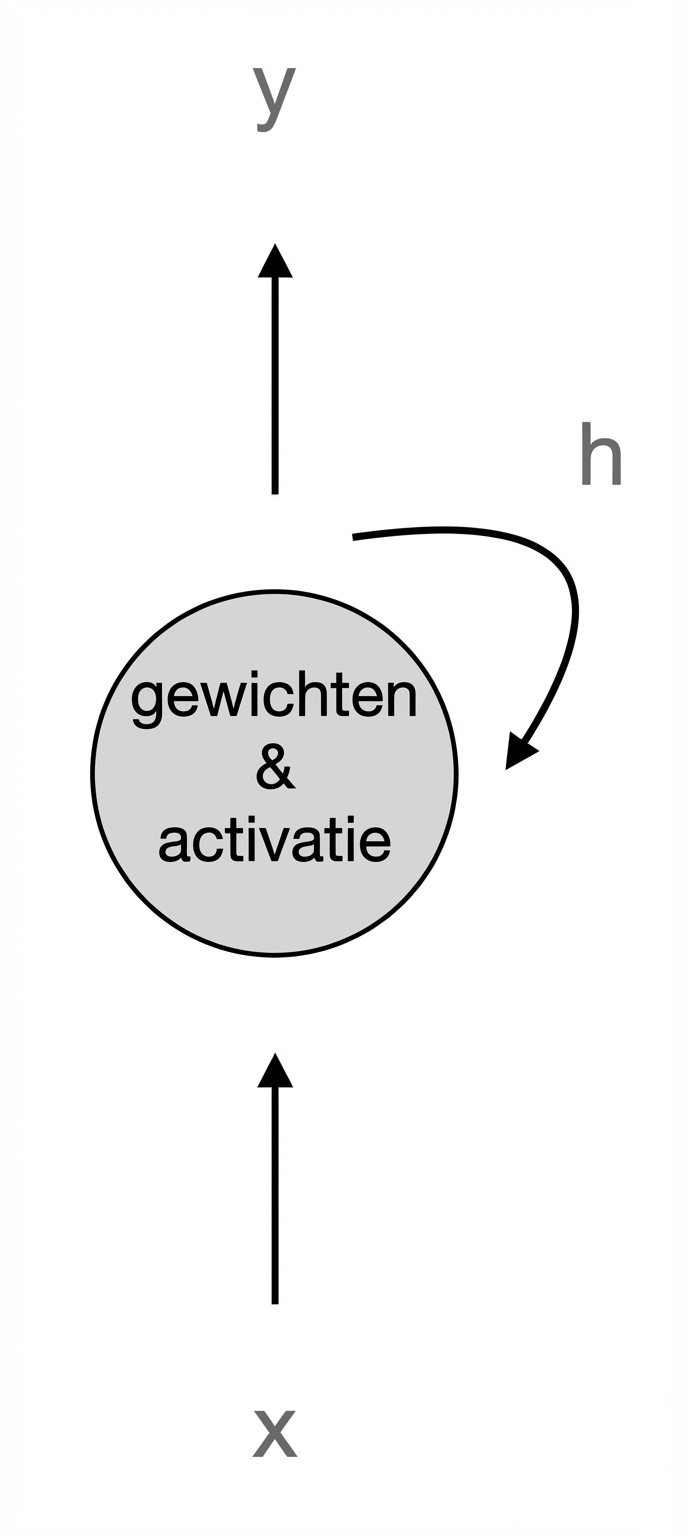

Recurrent neuron

- Feedforward-netwerken

- RNN’s: hebben terugkoppelingen

- Recurrent neuron:

- Input

x - Output

y - Verborgen staat

h

- Input

- In PyTorch:

nn.RNN()

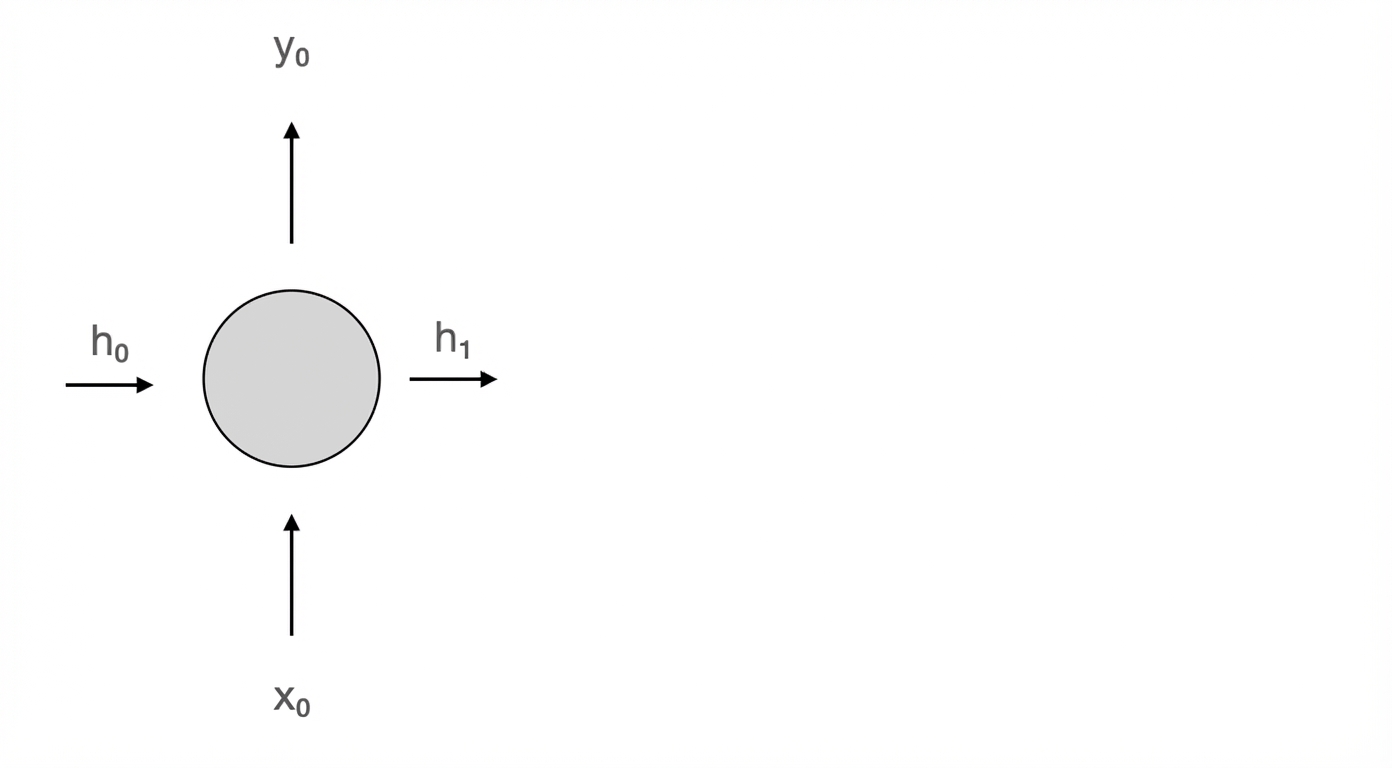

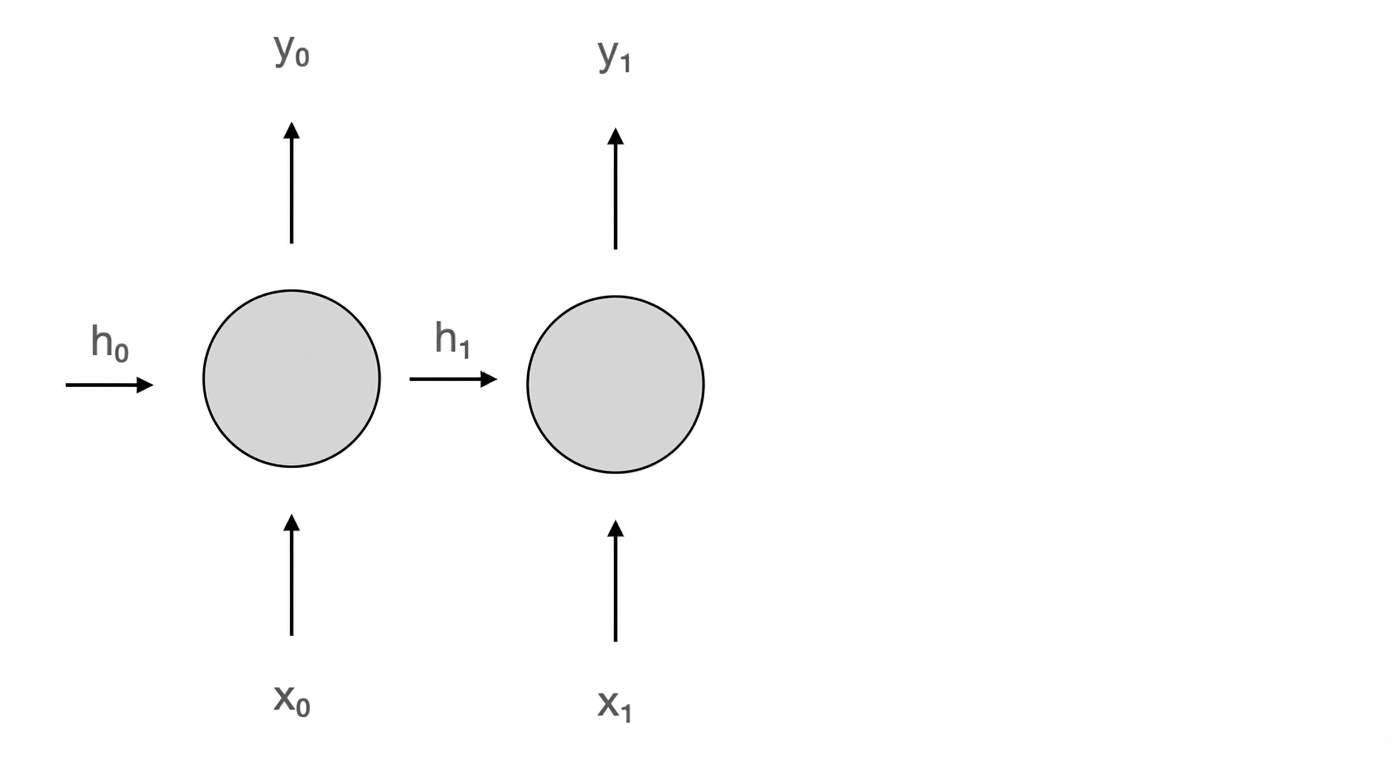

Recurrent neuron uitrollen in de tijd

Recurrent neuron uitrollen in de tijd

Recurrent neuron uitrollen in de tijd

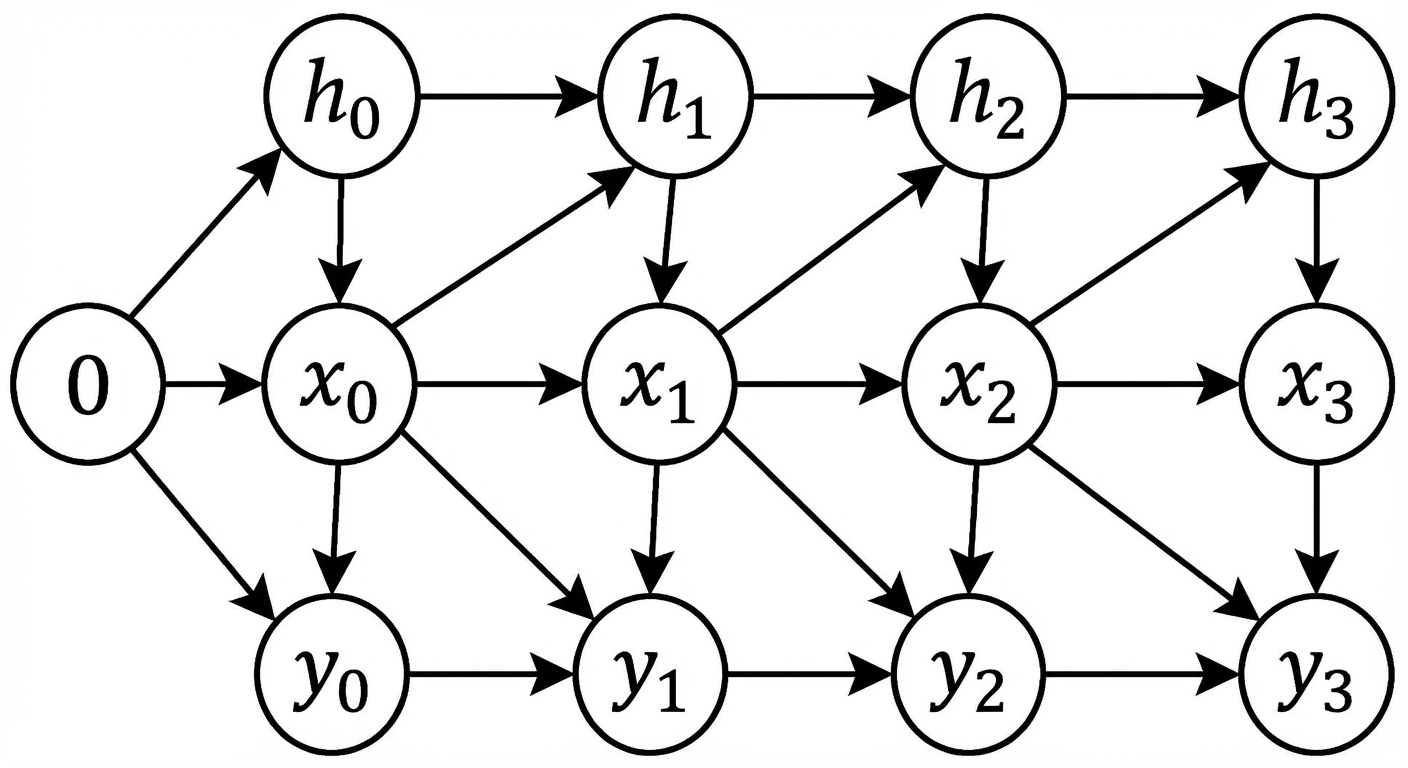

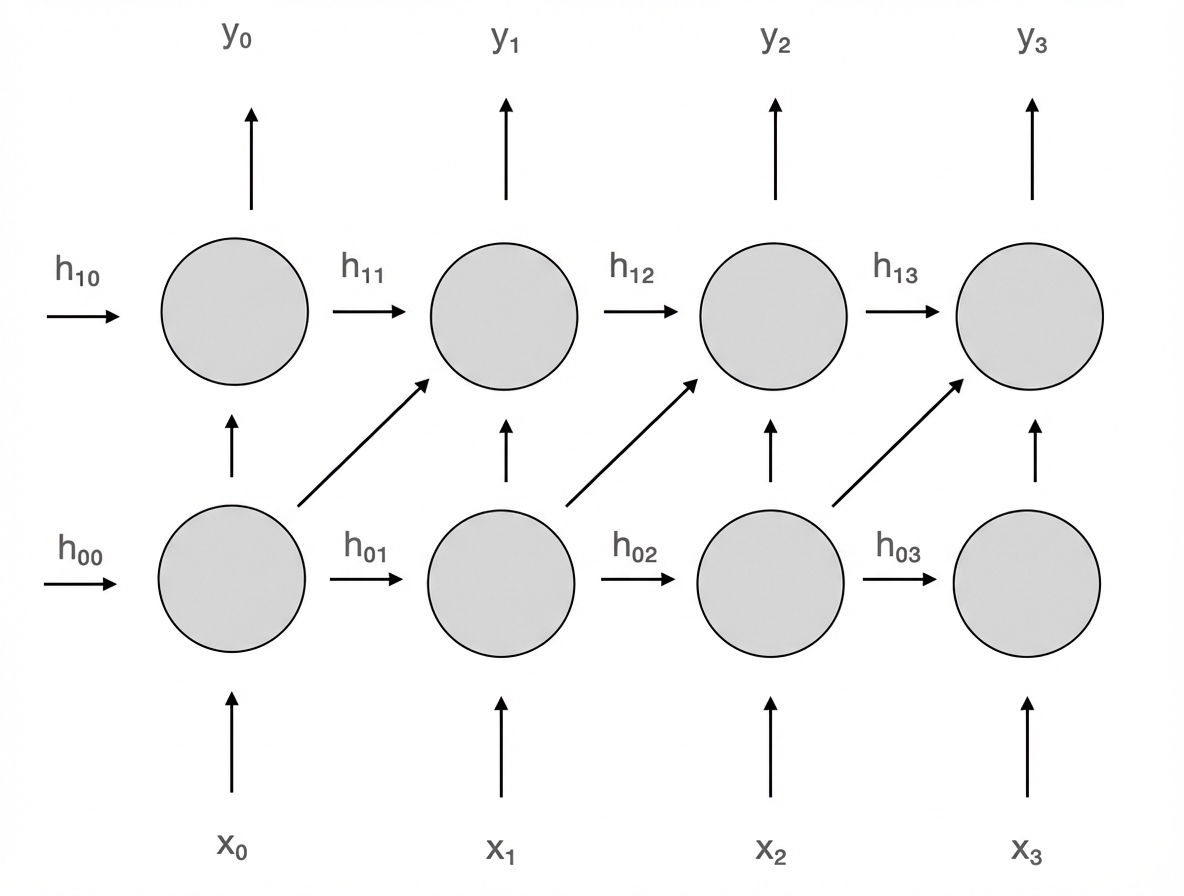

Diepe RNN’s

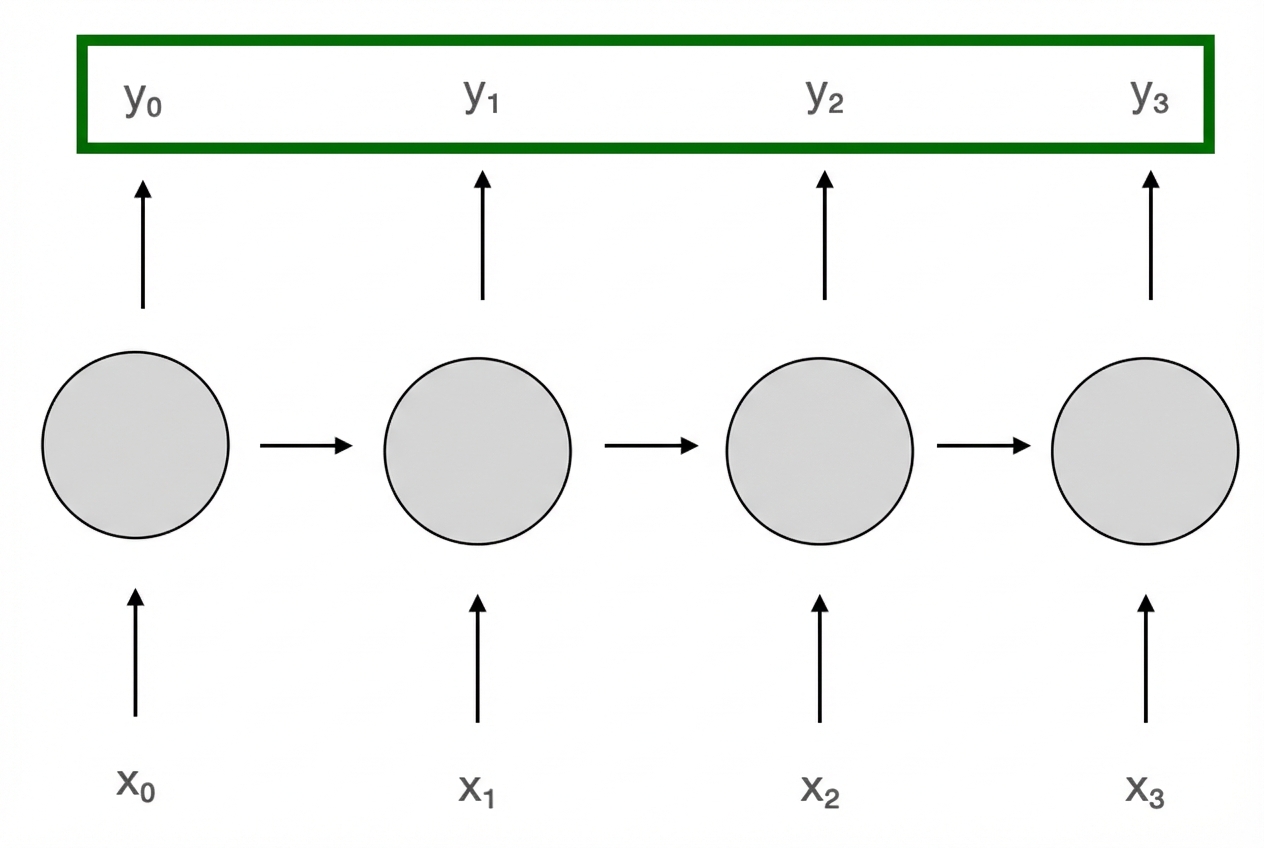

Sequence-to-sequence-architectuur

- Geef een sequentie als input, gebruik de hele outputsequentie

- Voorbeeld: spraakherkenning in realtime

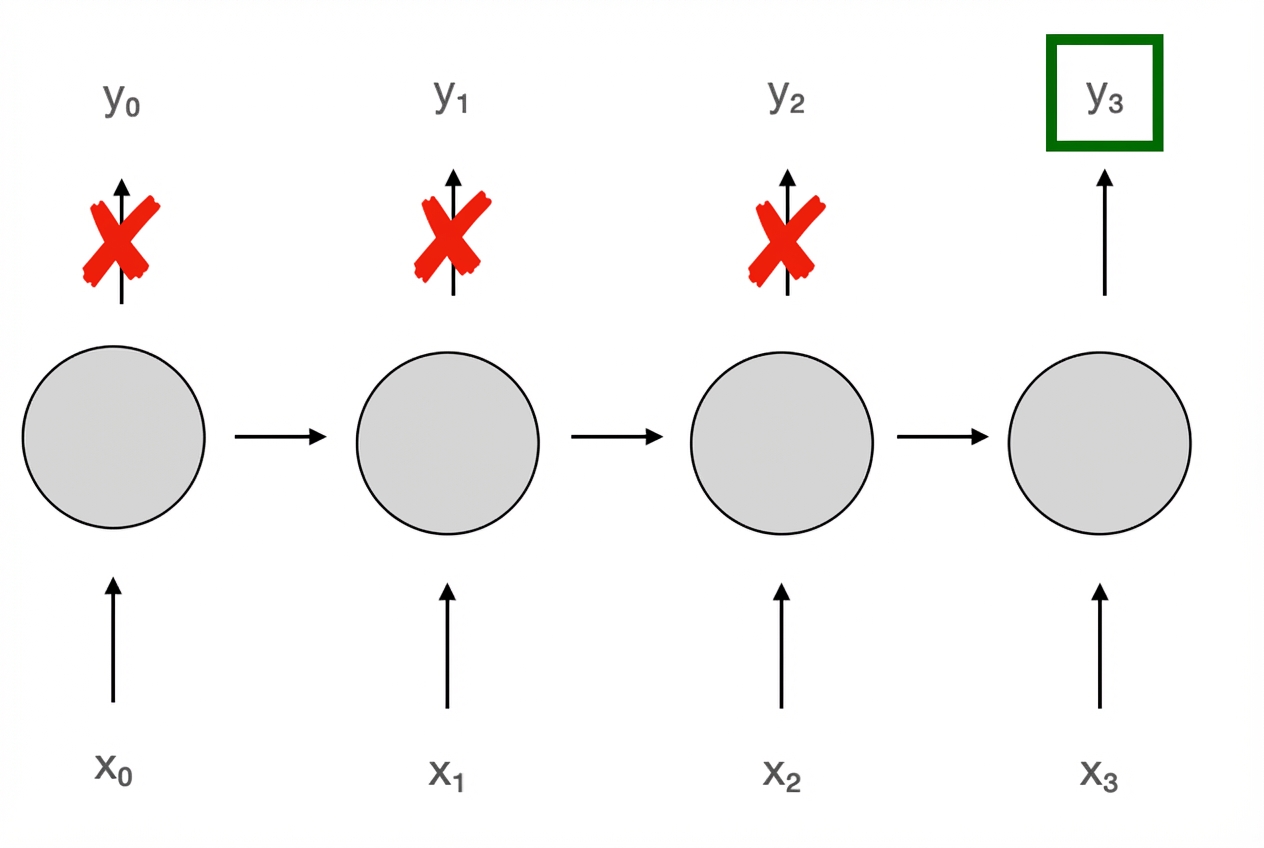

Sequence-to-vector-architectuur

- Geef een sequentie als input, gebruik alleen de laatste output

- Voorbeeld: tekstonderwerpsclassificatie

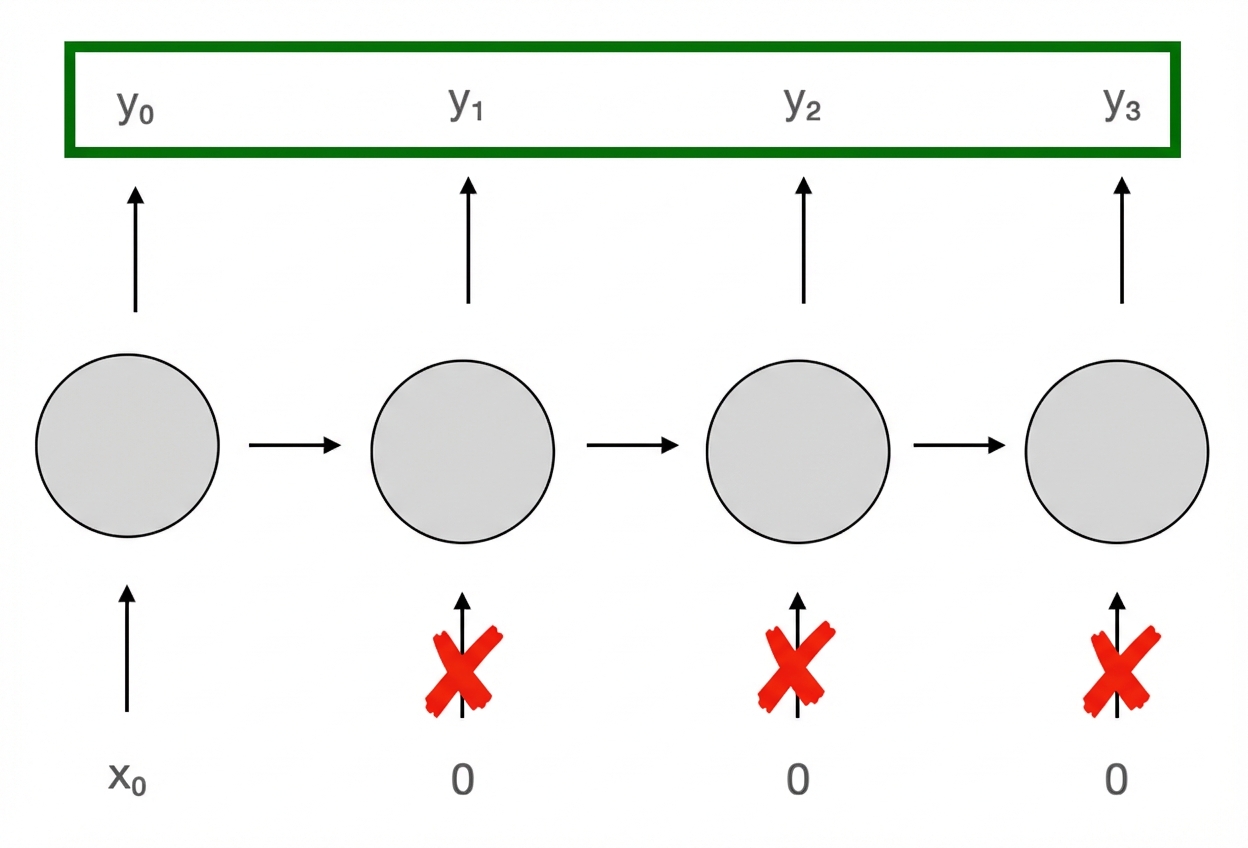

Vector-to-sequence-architectuur

- Geef één input, gebruik de hele outputsequentie

- Voorbeeld: tekstgeneratie

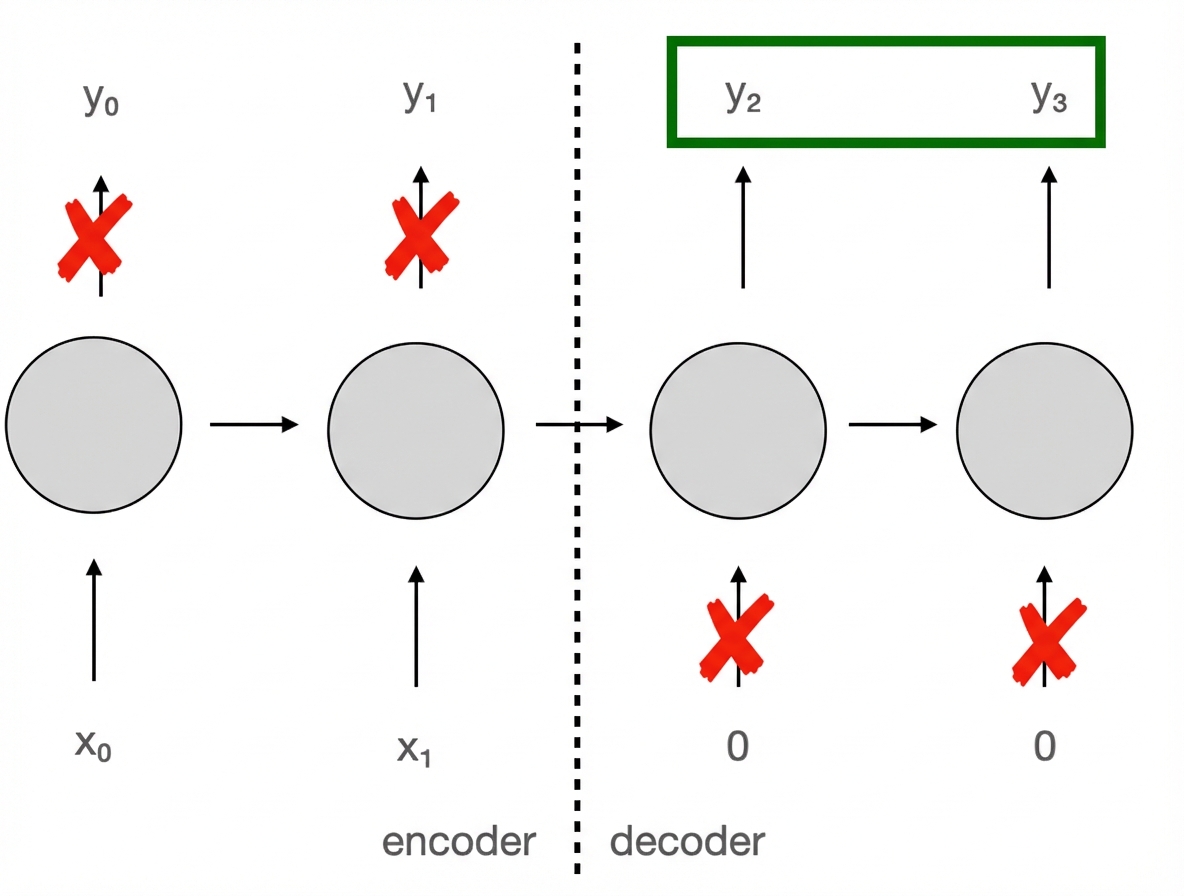

Encoder-decoder-architectuur

- Verwerk eerst de hele inputsequentie, start daarna met de outputsequentie

- Voorbeeld: machinevertaling

RNN in PyTorch

class Net(nn.Module): def __init__(self): super().__init__()self.rnn = nn.RNN( input_size=1, hidden_size=32, num_layers=2, batch_first=True, )self.fc = nn.Linear(32, 1)def forward(self, x): h0 = torch.zeros(2, x.size(0), 32)out, _ = self.rnn(x, h0)out = self.fc(out[:, -1, :]) return out

- Definieer modelklasse met

__init__ - Definieer recurrente laag,

self.rnn - Definieer lineaire laag,

fc - Initialiseer in

forward()de eerste verborgen staat met nullen - Geef input en eerste verborgen staat door de RNN-laag

- Pak de laatste RNN-output en geef die door de lineaire laag

Laten we oefenen!

Gevorderde Deep Learning met PyTorch