Verwijnende en exploderende gradiënten

Gevorderde Deep Learning met PyTorch

Michal Oleszak

Machine Learning Engineer

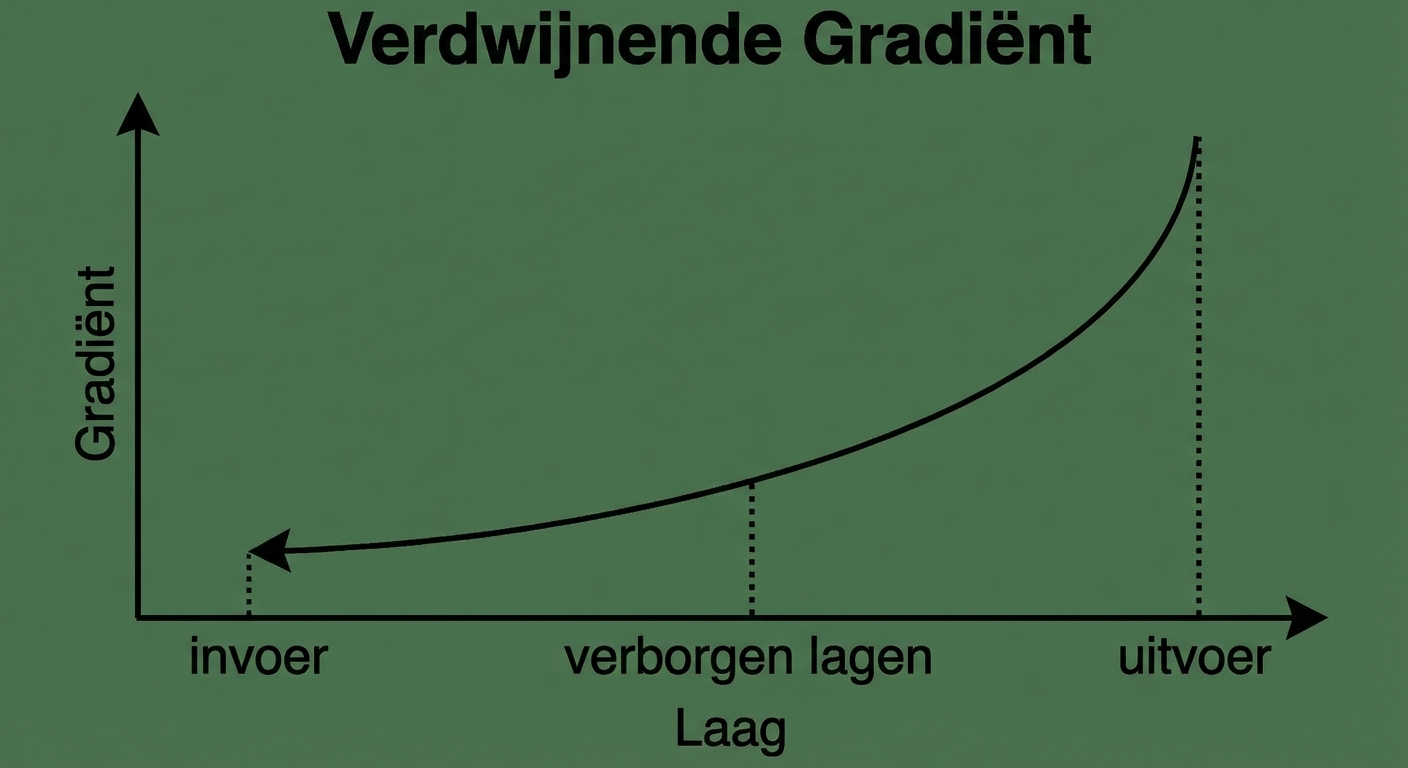

Verwijnende gradiënten

- Gradiënten worden steeds kleiner tijdens backprop

- Vroege lagen krijgen kleine parameterupdates

- Model leert niet

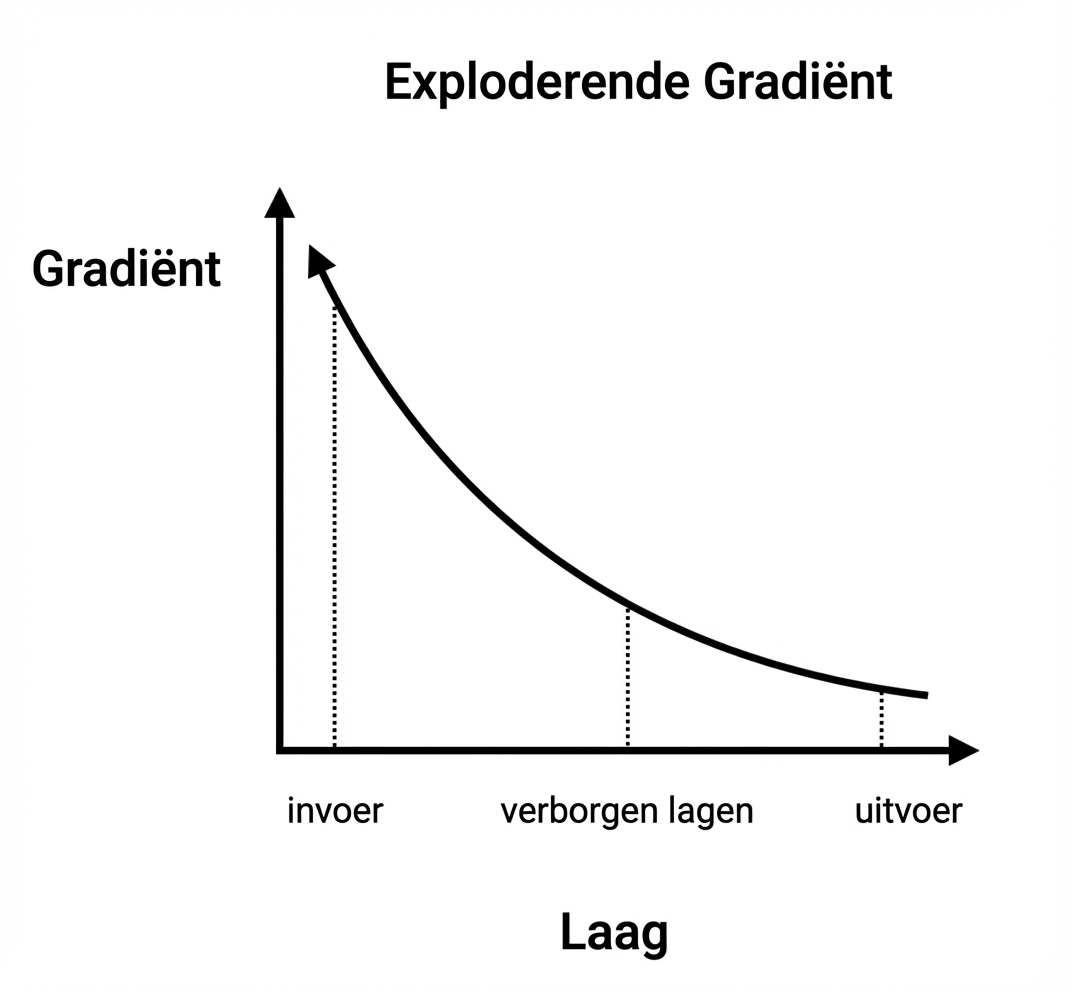

Exploderende gradiënten

- Gradiënten worden steeds groter

- Parameterupdates zijn te groot

- Training divergeert

Oplossing voor onstabiele gradiënten

- Juiste gewichtsinitialisatie

- Goede activaties

- Batch-normalisatie

Initialisatie van gewichten

layer = nn.Linear(8, 1)

print(layer.weight)

Parameter containing:

tensor([[-0.0195, 0.0992, 0.0391, 0.0212,

-0.3386, -0.1892, -0.3170, 0.2148]])

Initialisatie van gewichten

Goede initialisatie zorgt voor:

- Varianties van laaginputs = varianties van laagoutputs

- Varianties van gradiënten gelijk vóór en na een laag

Hoe je dit bereikt hangt af van de activatie:

- Voor ReLU en vergelijkbare: gebruik He/Kaiming-initialisatie

Initialisatie van gewichten

import torch.nn.init as init

init.kaiming_uniform_(layer.weight)

print(layer.weight)

Parameter containing:

tensor([[-0.3063, -0.2410, 0.0588, 0.2664,

0.0502, -0.0136, 0.2274, 0.0901]])

He-/Kaiming-initialisatie

init.kaiming_uniform_(self.fc1.weight)

init.kaiming_uniform_(self.fc2.weight)

init.kaiming_uniform_(

self.fc3.weight,

nonlinearity="sigmoid",

)

He-/Kaiming-initialisatie

import torch.nn as nn import torch.nn.init as init class Net(nn.Module): def __init__(self): super().__init__() self.fc1 = nn.Linear(9, 16) self.fc2 = nn.Linear(16, 8) self.fc3 = nn.Linear(8, 1)init.kaiming_uniform_(self.fc1.weight) init.kaiming_uniform_(self.fc2.weight) init.kaiming_uniform_( self.fc3.weight, nonlinearity="sigmoid", )

def forward(self, x):

x = nn.functional.relu(self.fc1(x))

x = nn.functional.relu(self.fc2(x))

x = nn.functional.sigmoid(self.fc3(x))

return x

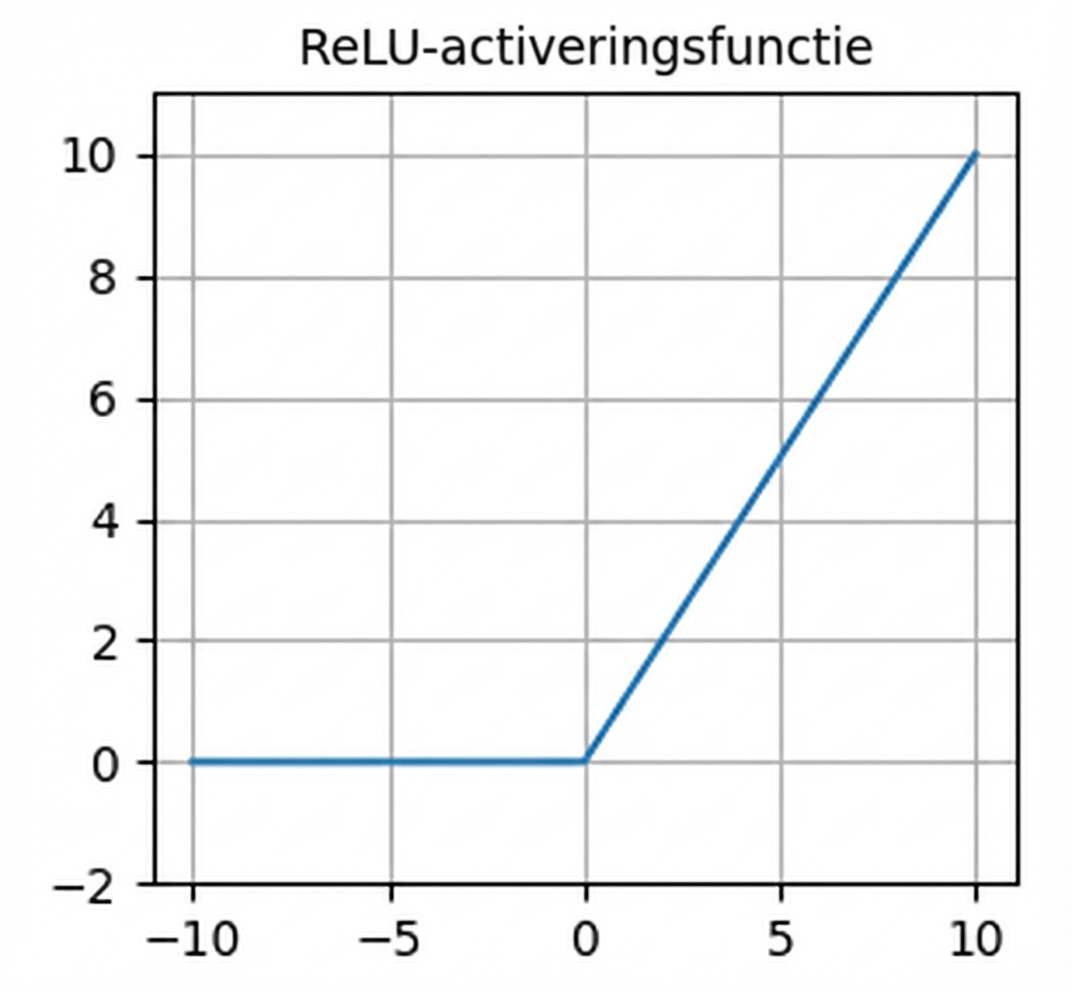

Activatiefuncties

- Vaak de standaardactivatie

nn.functional.relu()- Nul voor negatieve inputs – dode neuronen

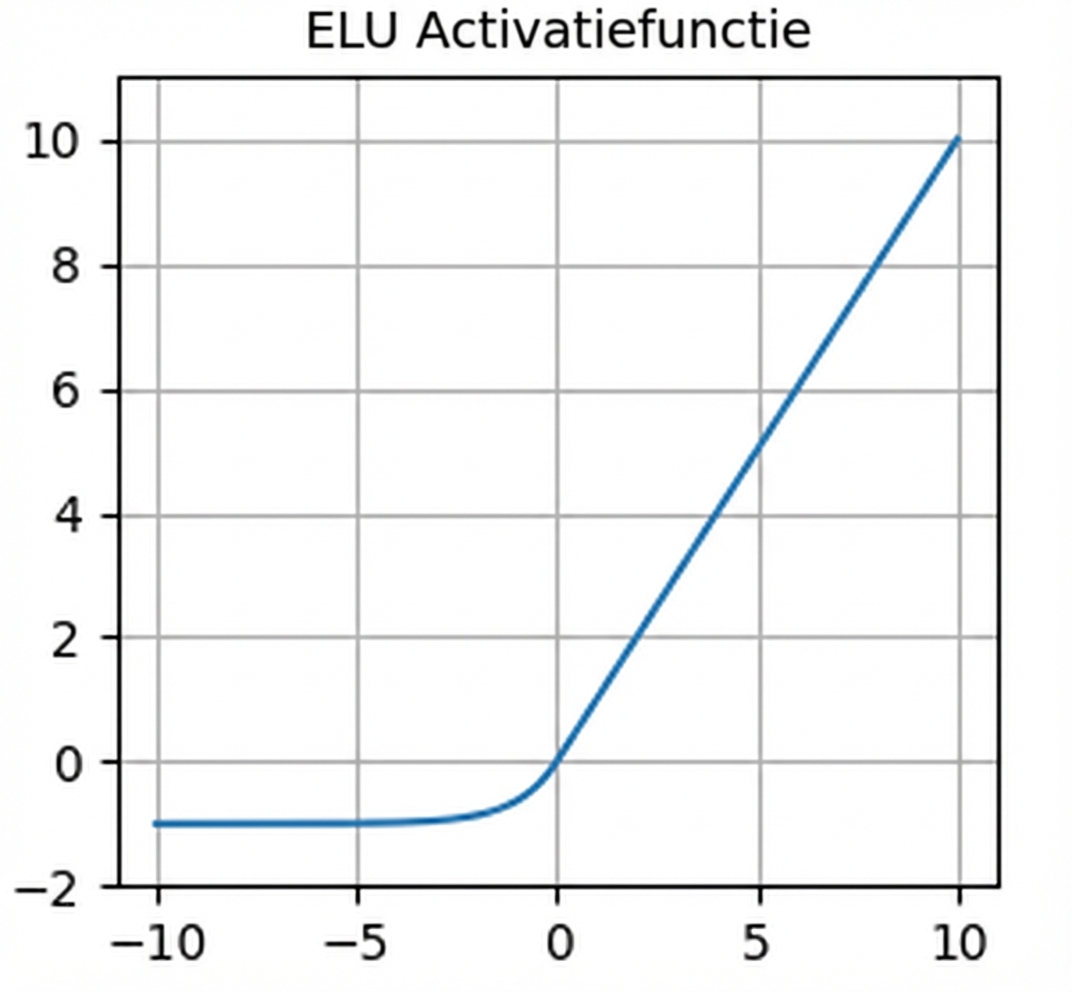

nn.functional.elu()- Niet-nul gradiënten voor negatieve waarden – helpt tegen dode neuronen

- Gemiddelde output rond nul – helpt tegen verdwijnende gradiënten

Batch-normalisatie

Na een laag:

Normaliseer de outputs door:

- Het gemiddelde af te trekken

- Te delen door de standaarddeviatie

Schaal en verschuif genormaliseerde outputs met geleerde parameters

Model leert de optimale inputverdeling per laag:

- Snellere verliesdaling

- Helpt tegen onstabiele gradiënten

Batch-normalisatie

class Net(nn.Module): def __init__(self): super().__init__() self.fc1 = nn.Linear(9, 16) self.bn1 = nn.BatchNorm1d(16) ...def forward(self, x): x = self.fc1(x) x = self.bn1(x) x = nn.functional.elu(x) ...

Laten we oefenen!

Gevorderde Deep Learning met PyTorch