Een LCEL-retrieval chain bouwen

Retrieval Augmented Generation (RAG) met LangChain

Meri Nova

Machine Learning Engineer

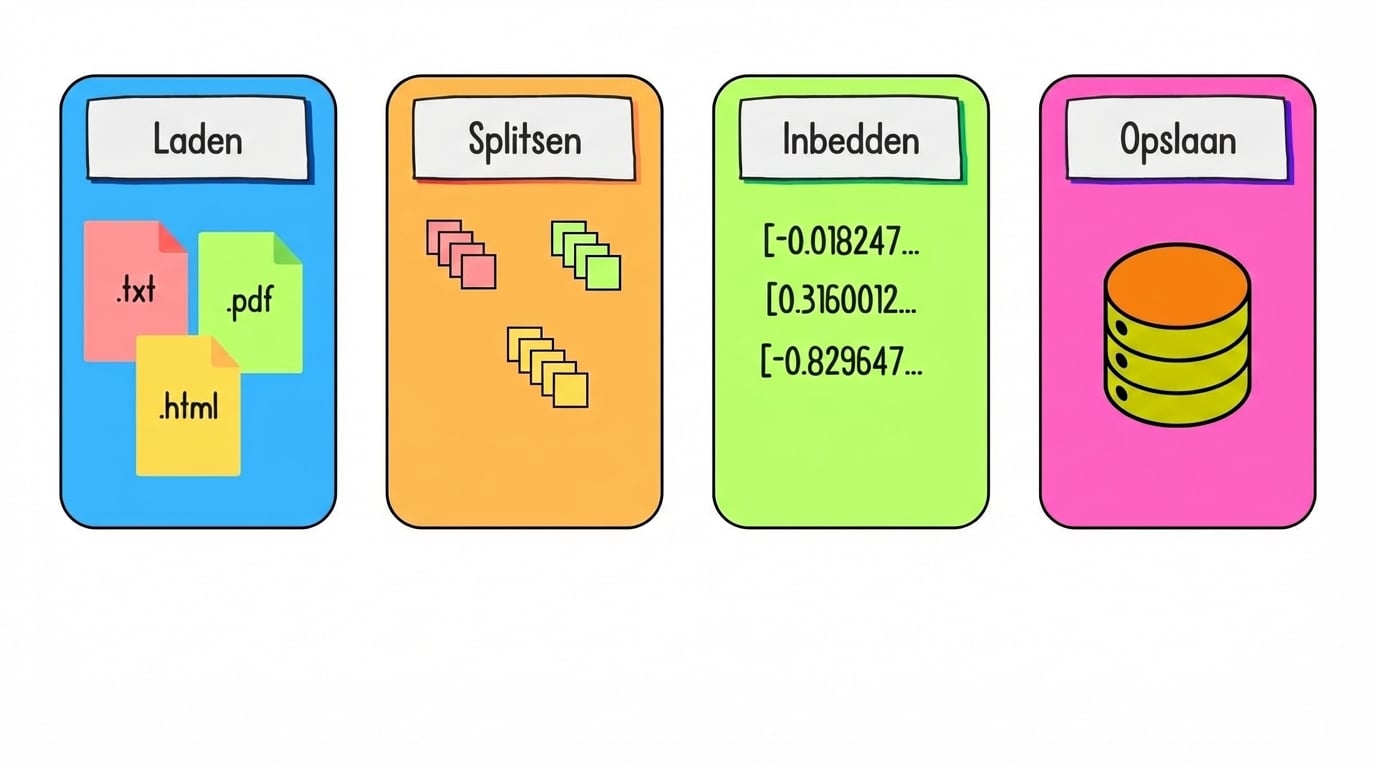

Data voorbereiden voor retrieval

Introductie tot LCEL voor RAG

Introductie tot LCEL voor RAG

Introductie tot LCEL voor RAG

Introductie tot LCEL voor RAG

Introductie tot LCEL voor RAG

Introductie tot LCEL voor RAG

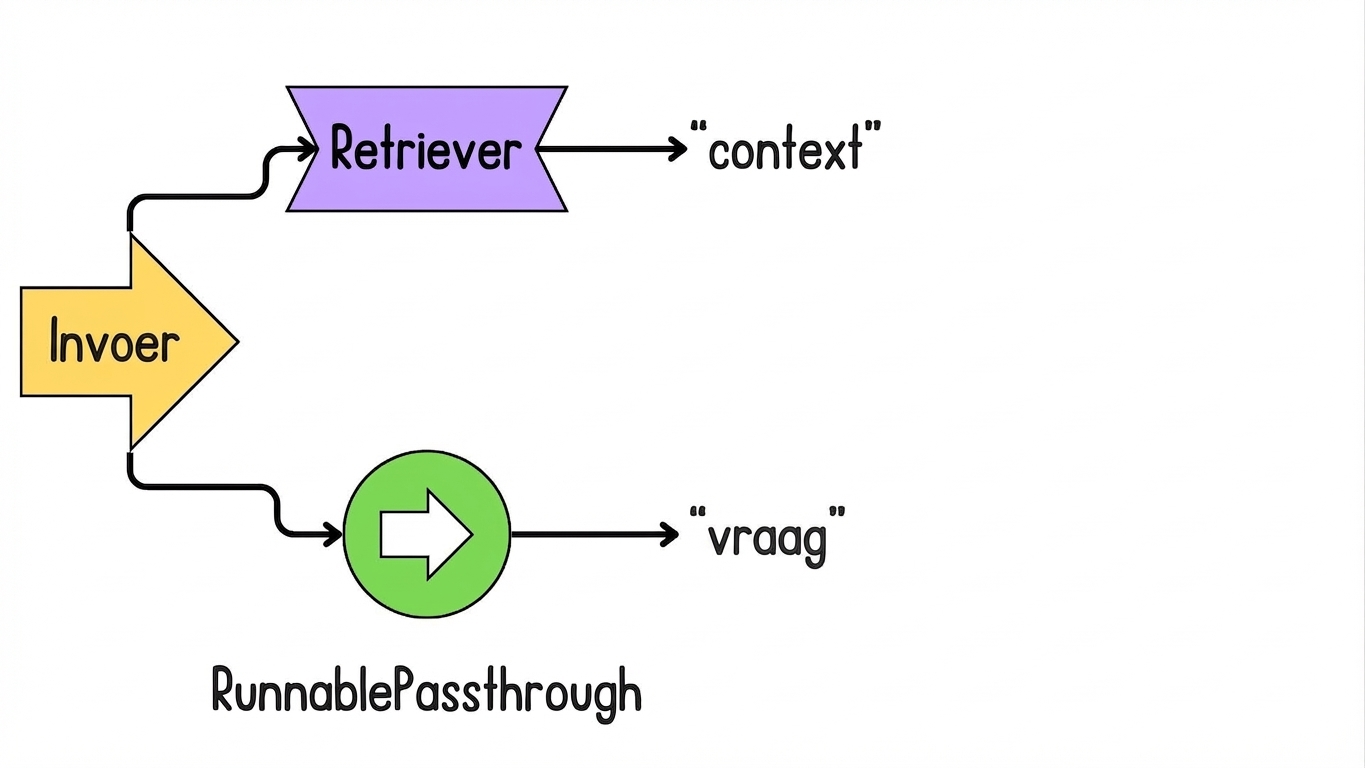

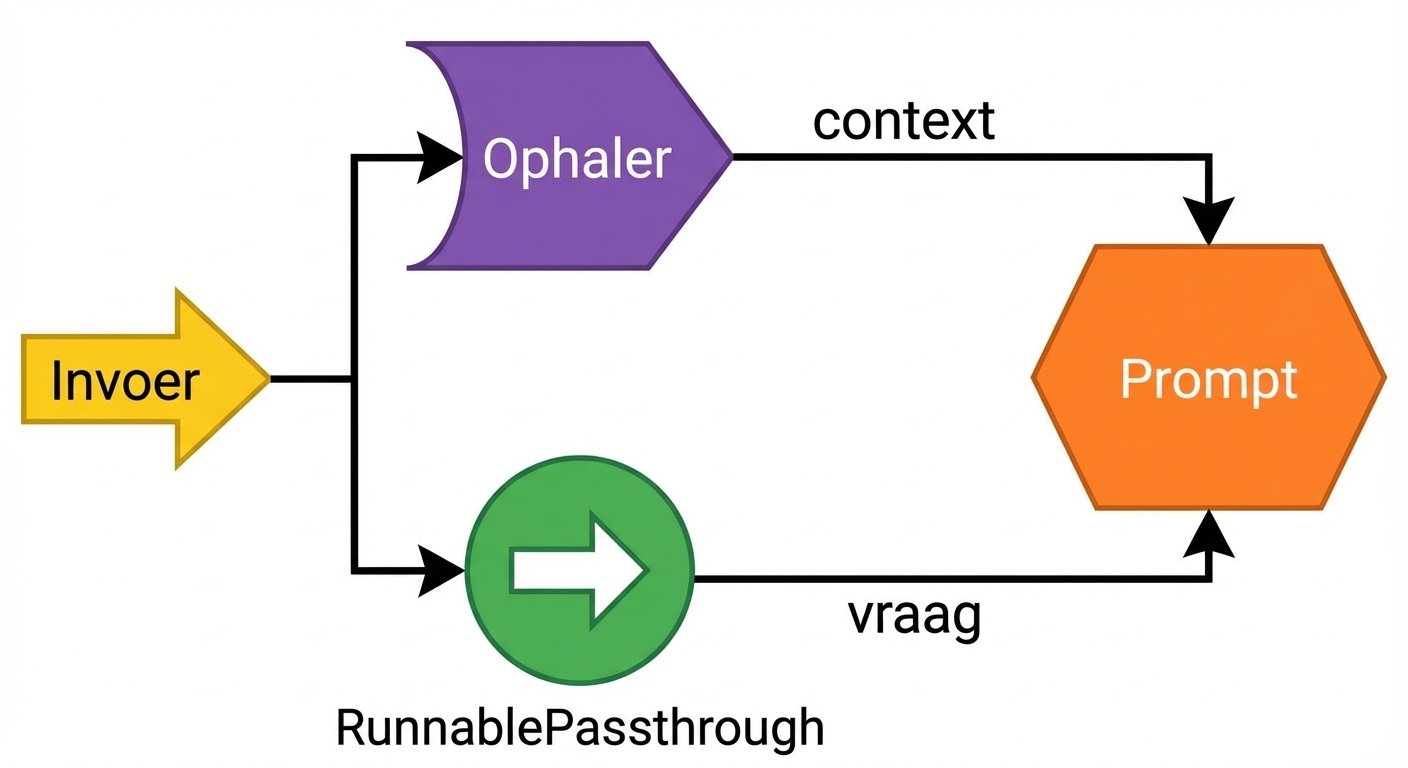

Een retriever instantiëren

vector_store = Chroma.from_documents( documents=chunks, embedding=embedding_model )retriever = vector_store.as_retriever( search_type="similarity", search_kwargs={"k": 2} )

Een prompttemplate maken

from langchain_core.prompts import ChatPromptTemplateprompt = ChatPromptTemplate.from_template(""" Gebruik de volgende context om de vraag aan het eind te beantwoorden. Als je het niet weet, zeg dan dat je het niet weet. Context: {context} Vraag: {question} """)

llm = ChatOpenAI(model="gpt-4o-mini", api_key="...", temperature=0)

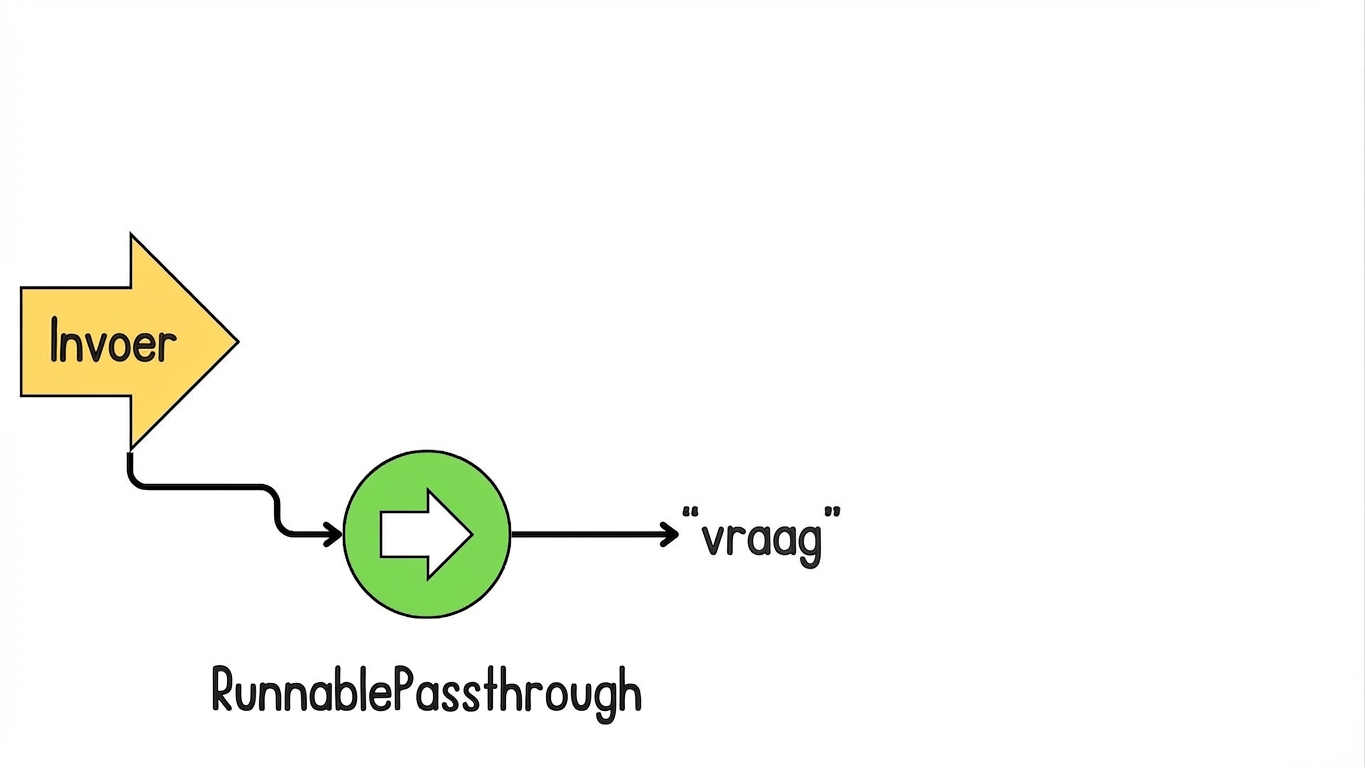

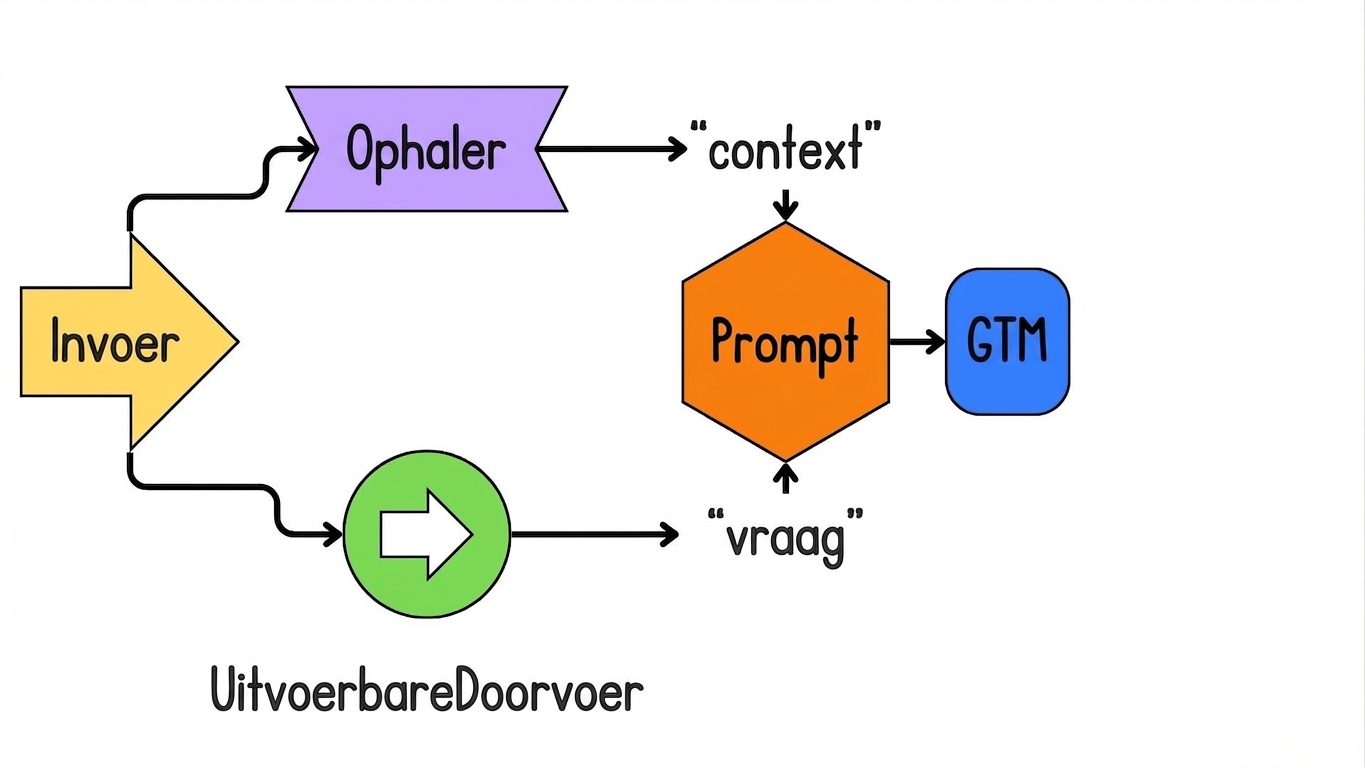

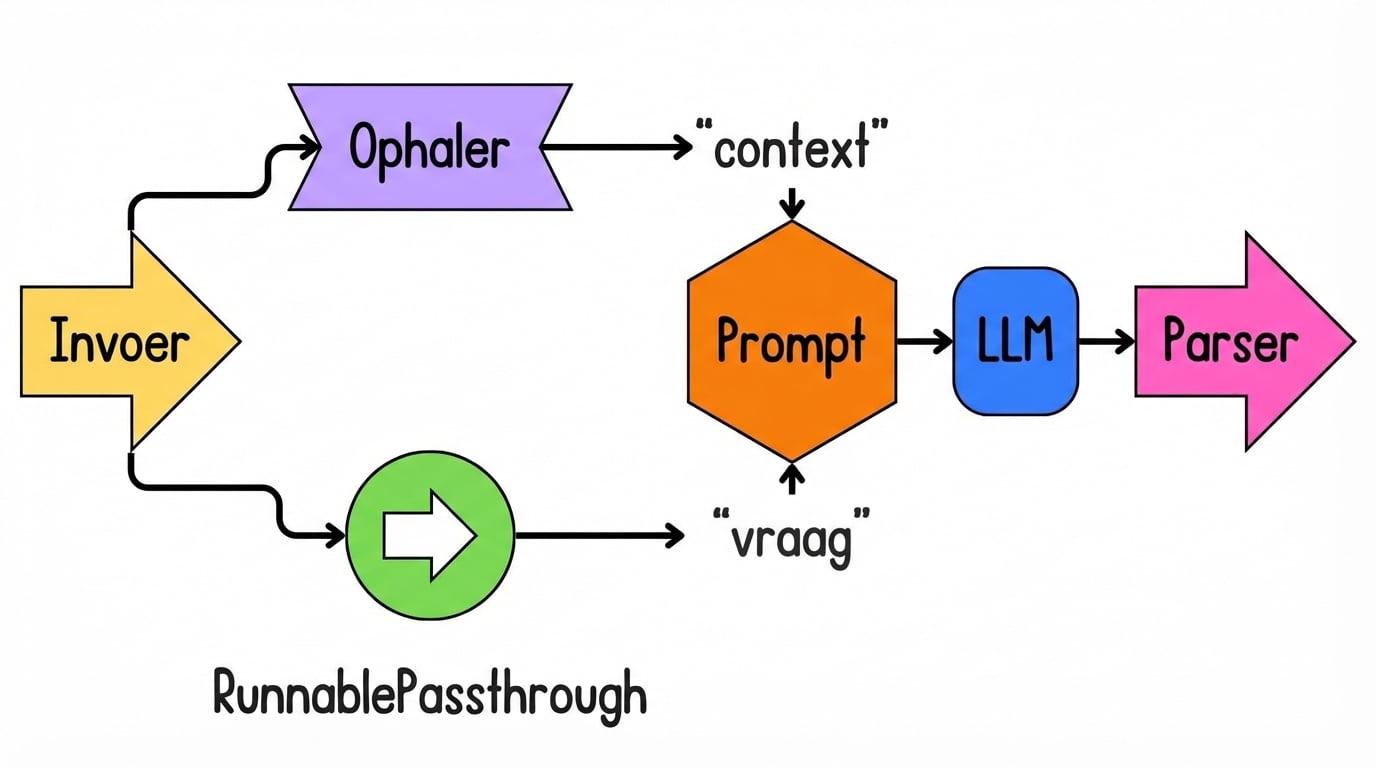

Een LCEL-retrieval chain bouwen

from langchain_core.runnables import RunnablePassthrough from langchain_core.output_parsers import StrOutputParserchain = ({"context": retriever, "question": RunnablePassthrough()}| prompt| llm| StrOutputParser())

De retrieval chain aanroepen

result = chain.invoke({"question": "What are the key findings or results presented in the paper?"})

print(result)

- Topprestaties: RAG-modellen zetten nieuwe records op open-domain vraag-antwoordingstaken...

- Betere generatie: RAG-modellen produceren specifiekere, diversere en feitelijkere taal...

- Dynamisch kennisgebruik: Het niet-parametrische geheugen laat RAG-modellen toegang krijgen tot en ...

Laten we oefenen!

Retrieval Augmented Generation (RAG) met LangChain