Van vectoren naar graafmodellen

Retrieval Augmented Generation (RAG) met LangChain

Meri Nova

Machine Learning Engineer

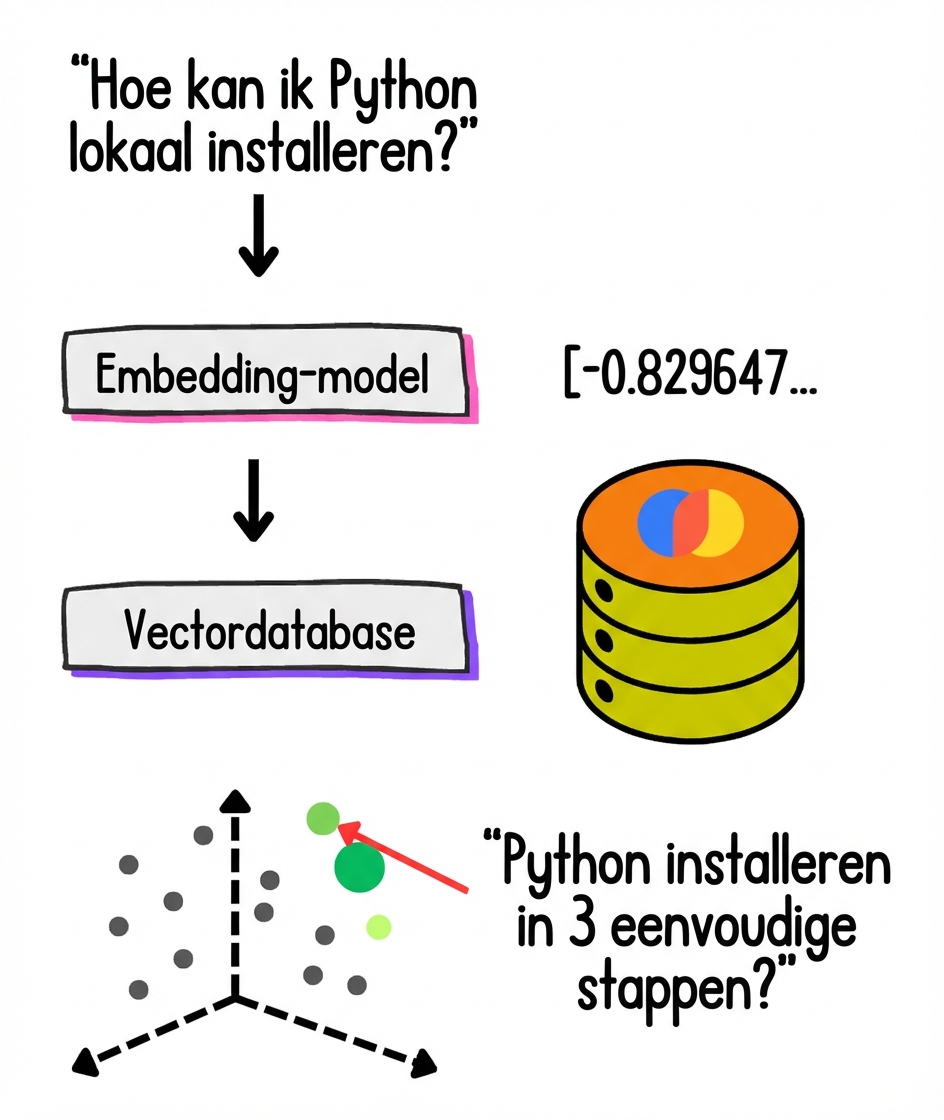

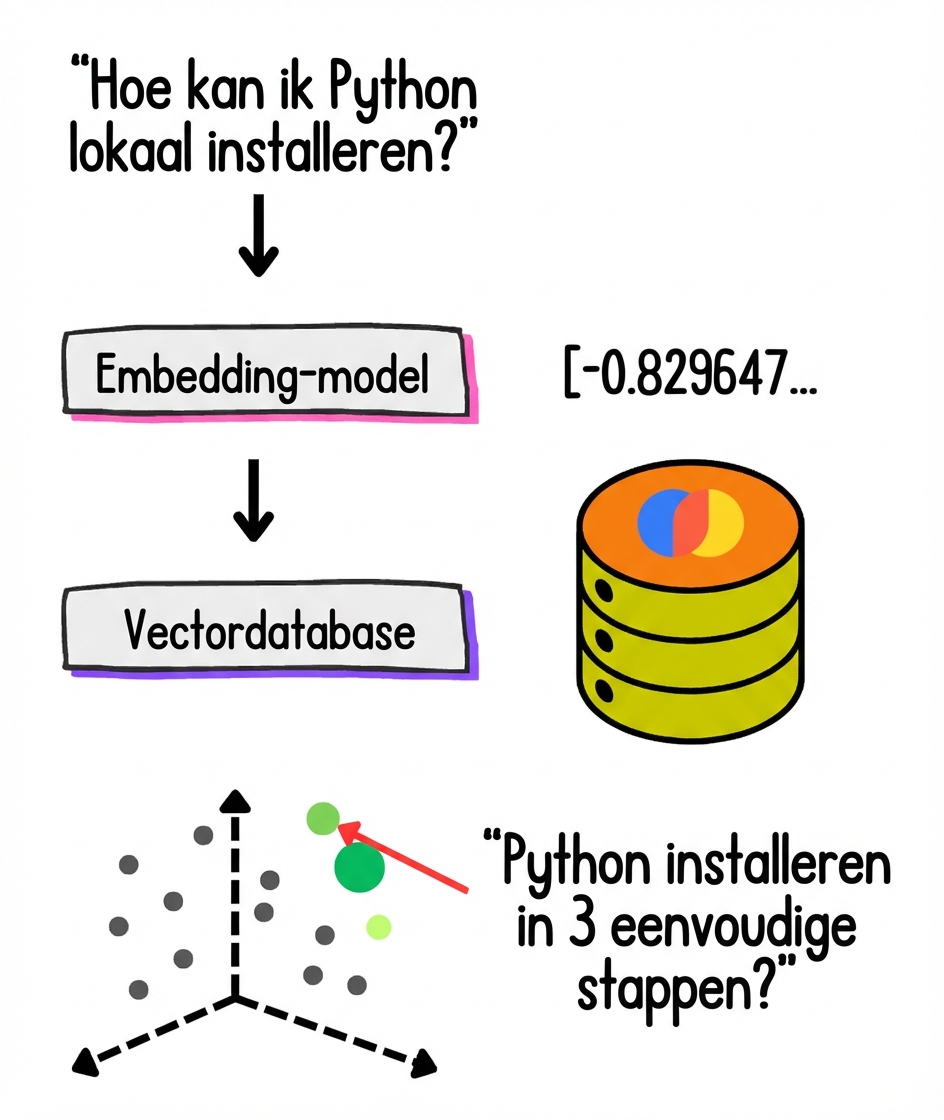

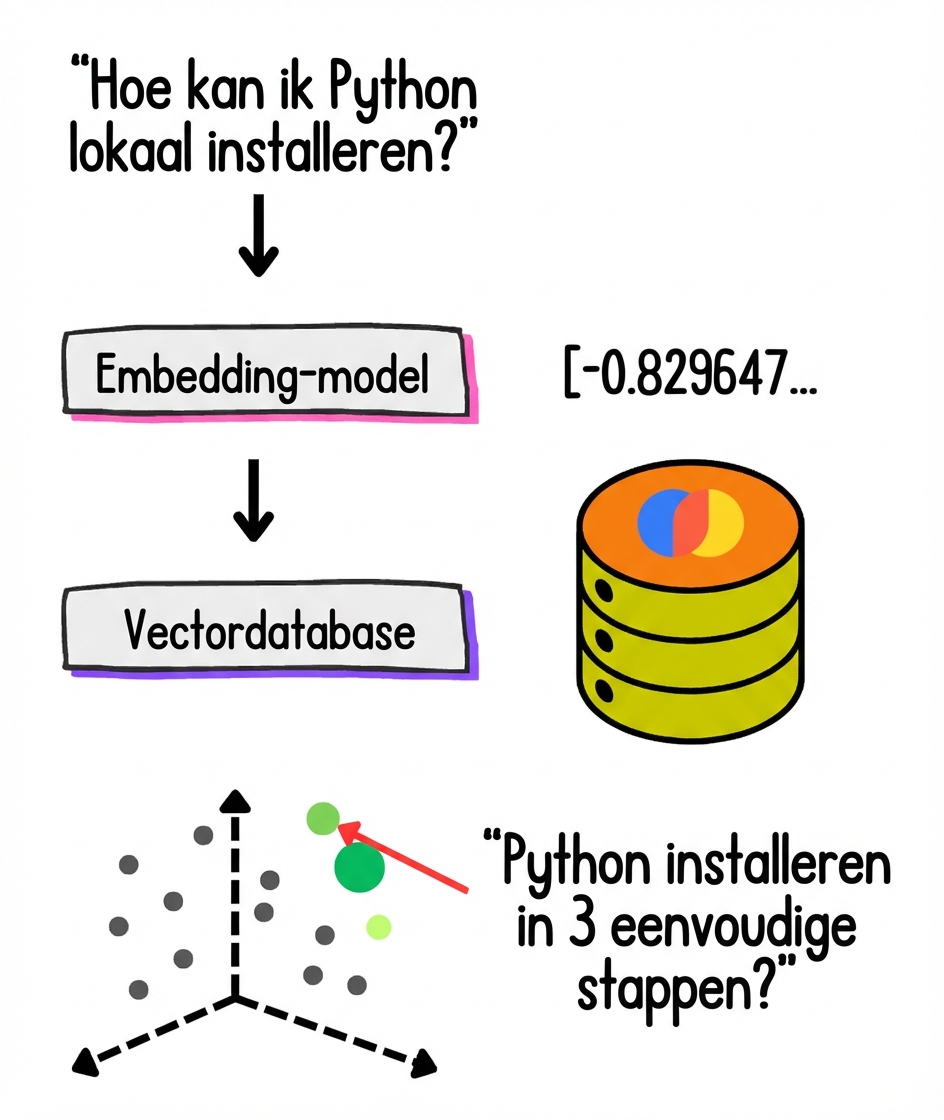

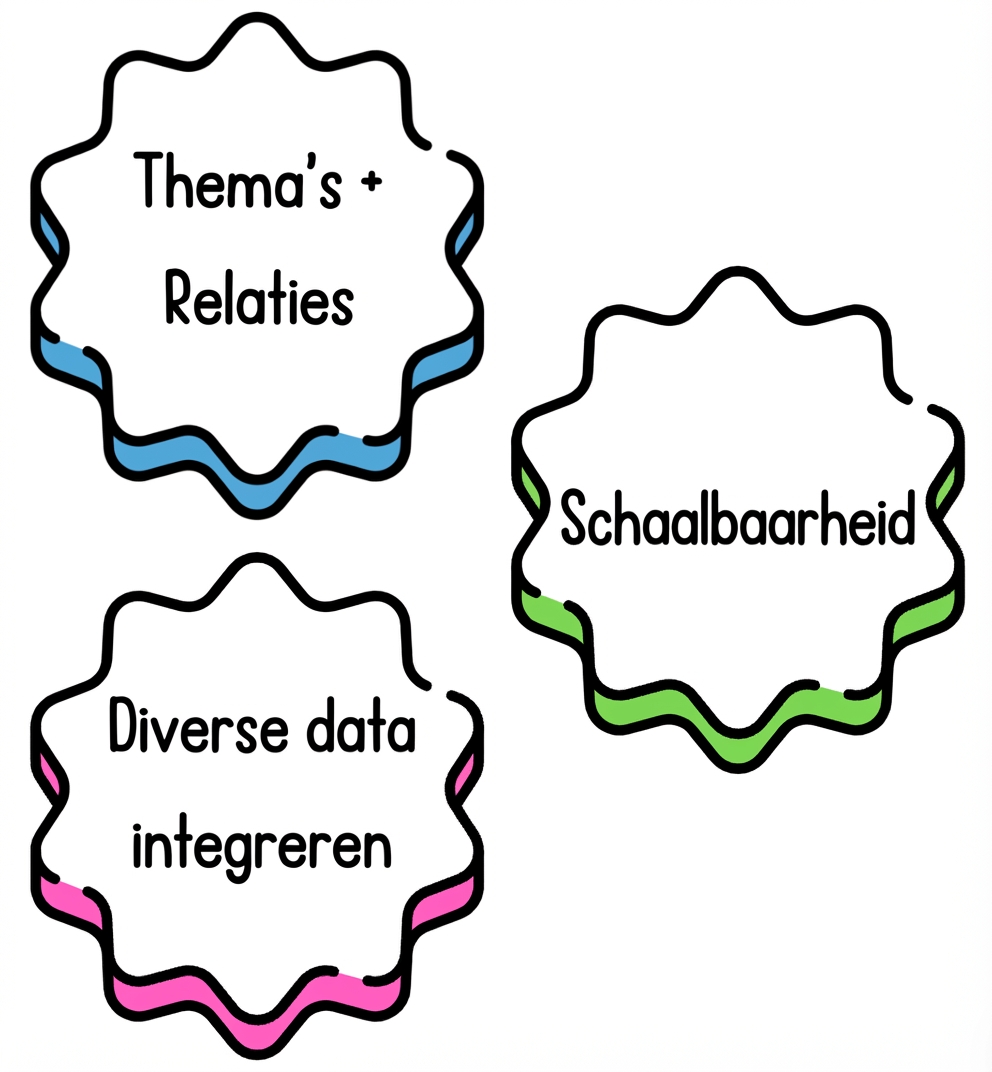

Beperkingen van vector-RAG

Beperkingen van vector-RAG

Beperkingen van vector-RAG

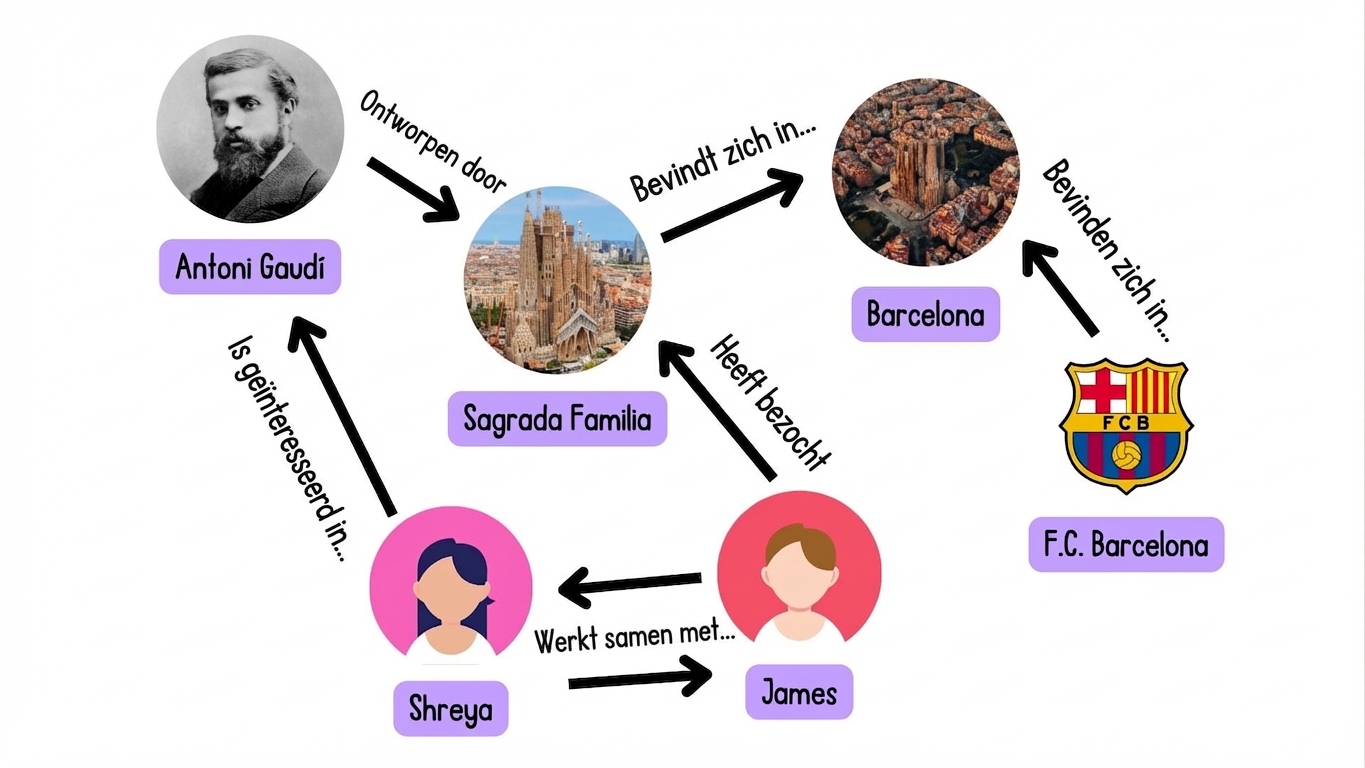

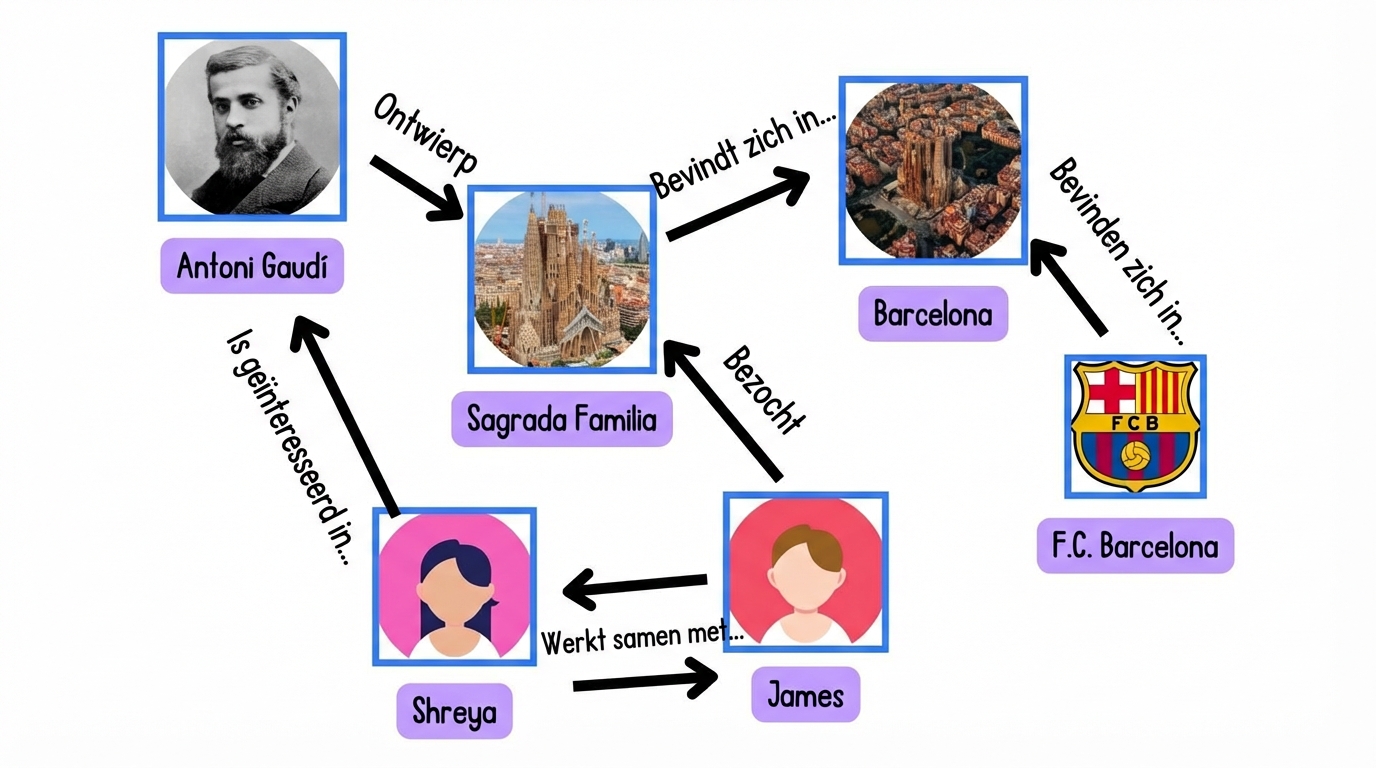

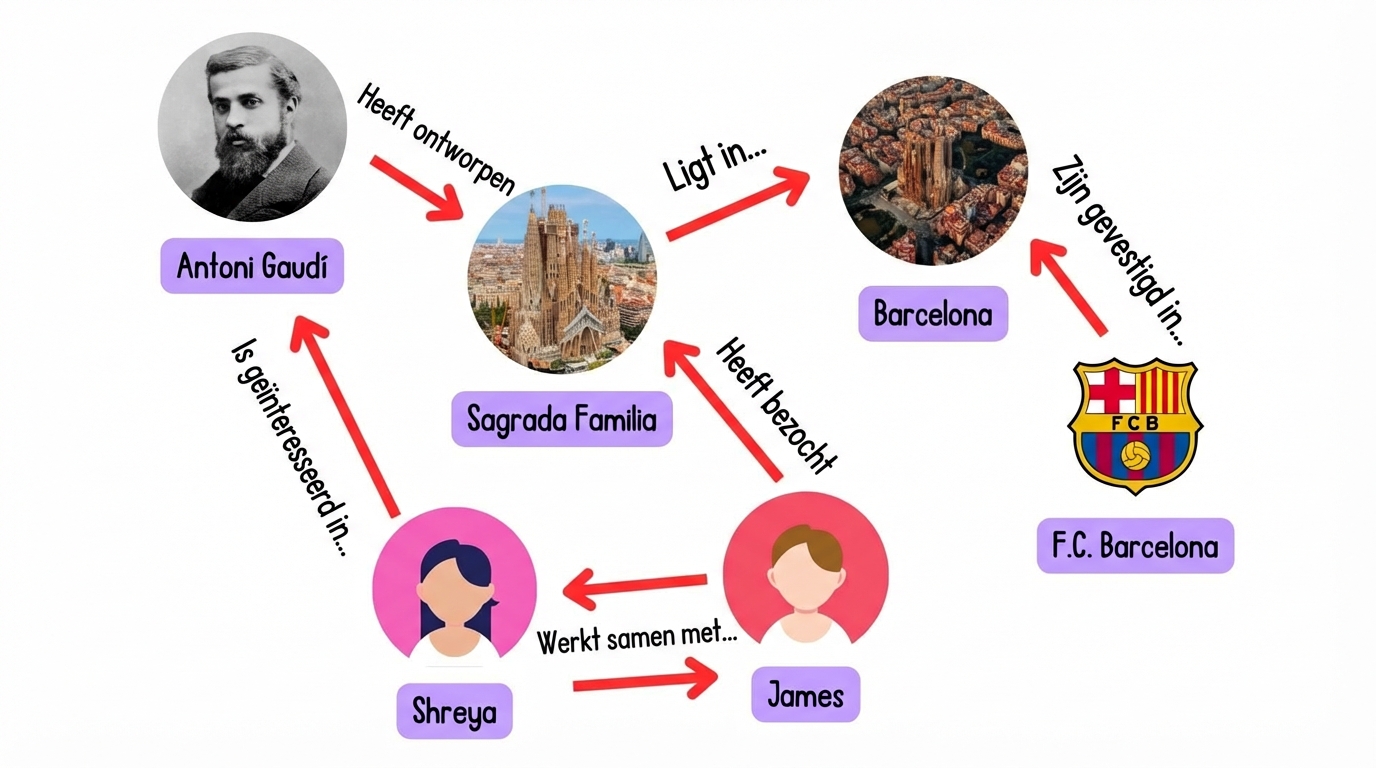

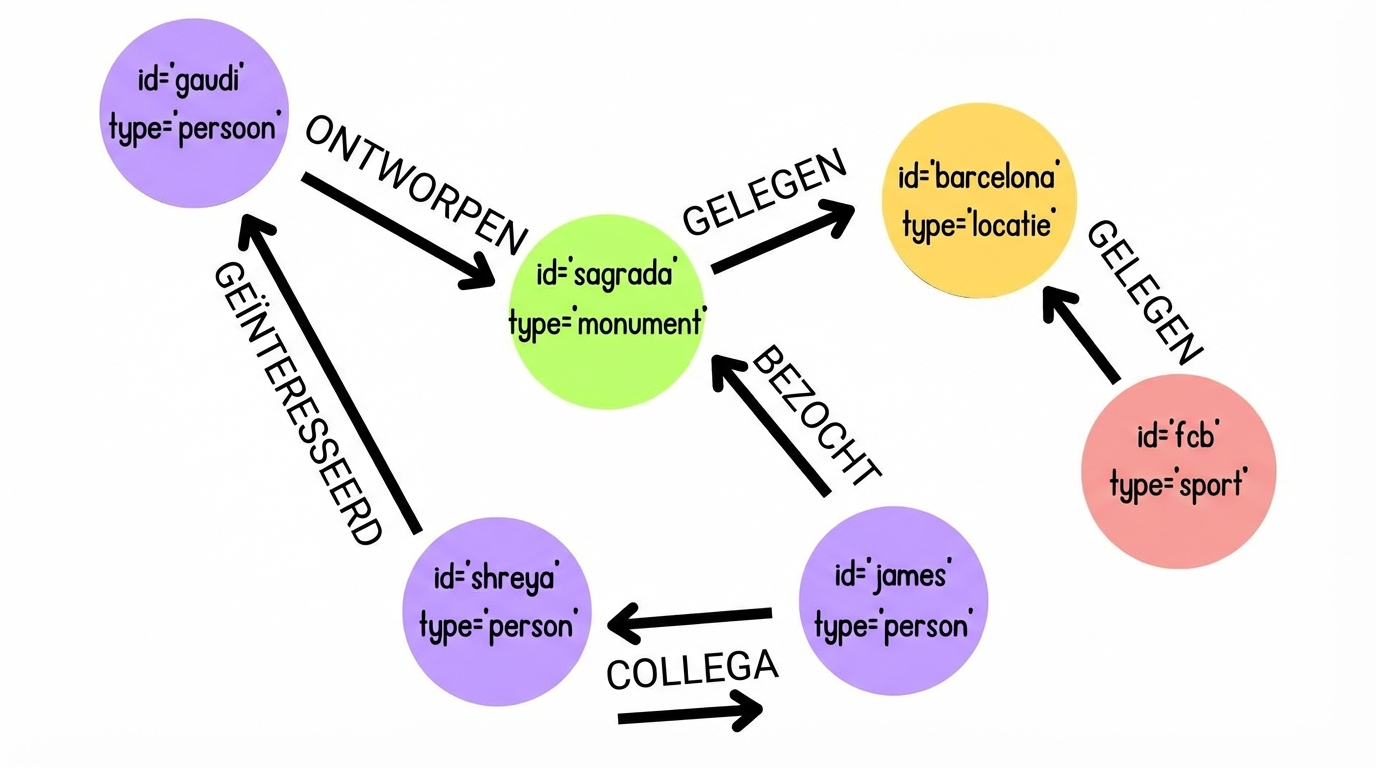

Graafdatabases

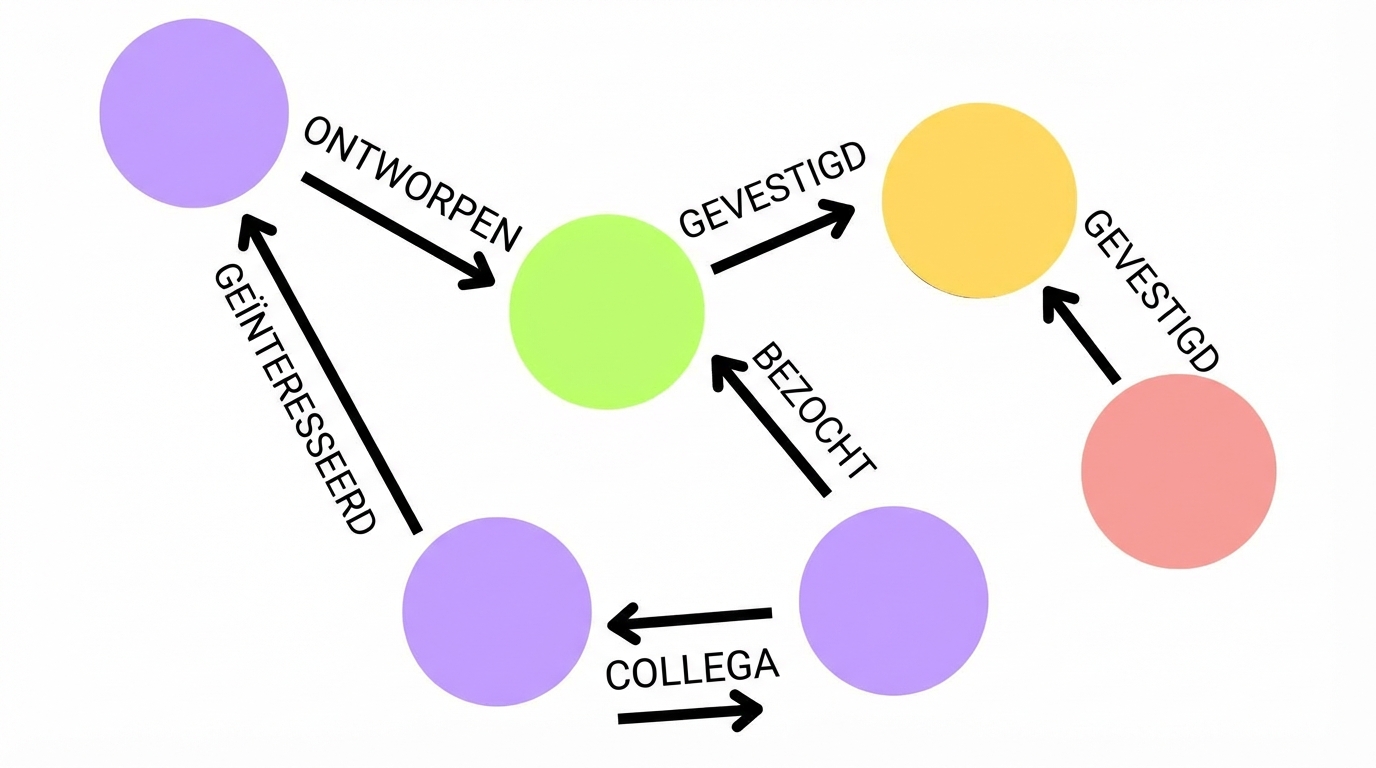

Graafdatabases – knopen

Graafdatabases – randen

Neo4j-graafdatabases

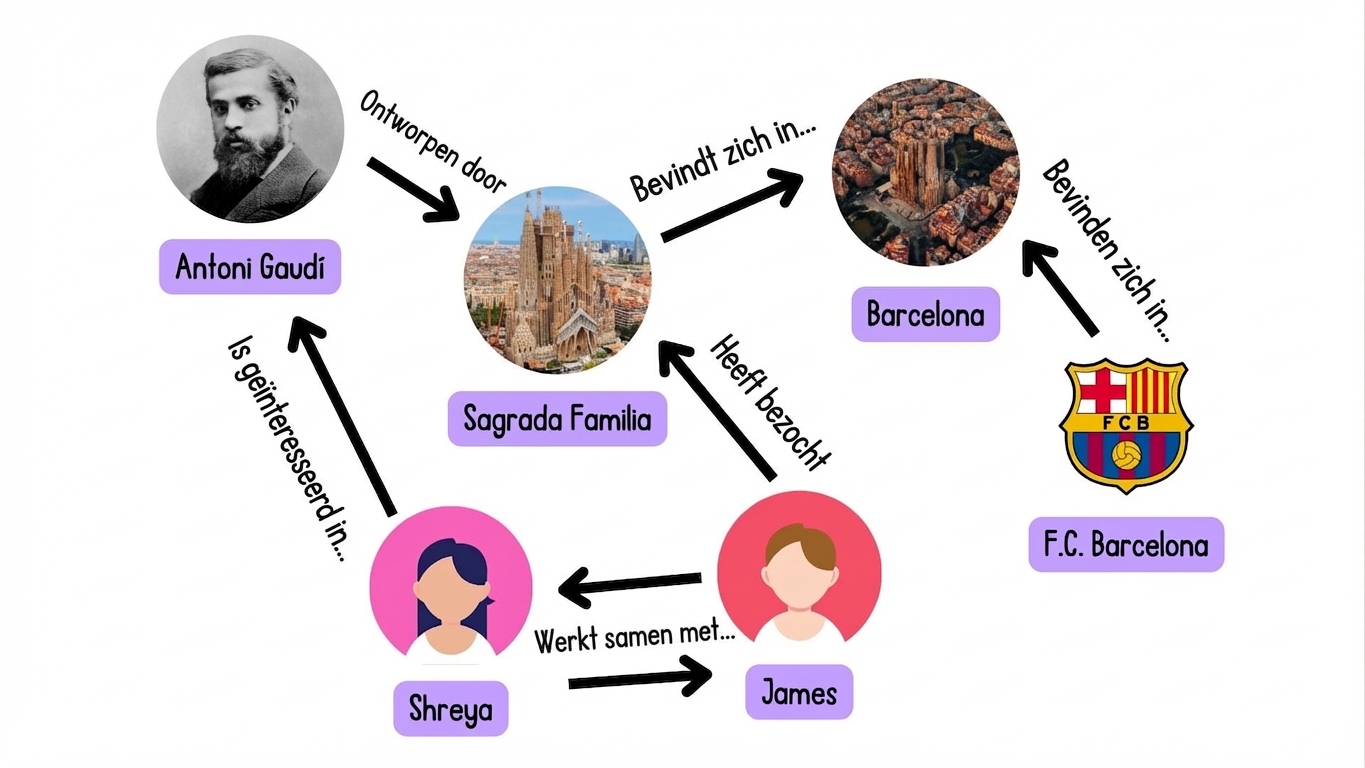

Van grafiek naar graaf...

Van grafiek naar graaf...

Van grafiek naar graaf...

Wikipedia-pagina’s laden en chunken

from langchain_community.document_loaders import WikipediaLoader from langchain_text_splitters import TokenTextSplitter raw_documents = WikipediaLoader(query="large language model").load()text_splitter = TokenTextSplitter(chunk_size=100, chunk_overlap=20) documents = text_splitter.split_documents(raw_documents[:3]) print(documents[0])

page_content='A large language model (LLM) is a computational model capable of...'

metadata={'title': 'Large language model',

'summary': "A large language model (LLM) is...",

'source': 'https://en.wikipedia.org/wiki/Large_language_model'}

Van tekst naar graaf!

from langchain_openai import ChatOpenAIfrom langchain_experimental.graph_transformers import LLMGraphTransformerllm = ChatOpenAI(api_key="...", temperature=0, model_name="gpt-4o-mini")llm_transformer = LLMGraphTransformer(llm=llm)graph_documents = llm_transformer.convert_to_graph_documents(documents) print(graph_documents)

Van tekst naar graaf!

[GraphDocument(

nodes=[

Node(id='Llm', type='Computational model'),

Node(id='Language Generation', type='Concept'),

Node(id='Natural Language Processing Tasks', type='Concept'),

Node(id='Llama Family', type='Computational model'),

Node(id='Ibm', type='Organization'),

..., Node(id='Bert', type='Computational model')],

relationships=[

Relationship(source=Node(id='Llm', type='Computational model'),

target=Node(id='Language Generation', type='Concept'),

type='CAPABLE_OF'),

...])]

Laten we oefenen!

Retrieval Augmented Generation (RAG) met LangChain