Basis van big data

Big Data Fundamentals met PySpark

Upendra Devisetty

Science Analyst, CyVerse

Wat is big data?

- Big data verwijst naar het bestuderen en toepassen van datasets die te complex zijn voor traditionele dataverwerking — Wikipedia

De 3 V’s van big data

Volume, variëteit en snelheid

Volume: Omvang van de data

Variëteit: Verschillende bronnen en formaten

Snelheid: Verwerk-/stroomsnelheid

Big-dataconcepten en -terminologie

Cluster computing: Bundeling van resources van meerdere machines

Parallel computing: Gelijktijdige berekening op één computer

Distributed computing: Verzameling knooppunten (netwerkcomputers) die parallel draaien

Batchverwerking: Taak opdelen en op losse machines draaien

Realtime verwerking: Directe verwerking van data

Big-dataverwerkingssystemen

Hadoop/MapReduce: Schaalbaar en fouttolerant framework in Java

Open source

Batchverwerking

Apache Spark: Algemeen, razendsnel clustercomputingsysteem

Open source

Zowel batch als realtime verwerking

Let op: Apache Spark heeft tegenwoordig de voorkeur boven Hadoop/MapReduce

Features van Apache Spark

Gedistribueerd clustercomputingframework

Efficiënte in-memory-berekeningen voor grote datasets

Razendsnel verwerkingsframework

Ondersteunt Java, Scala, Python, R en SQL

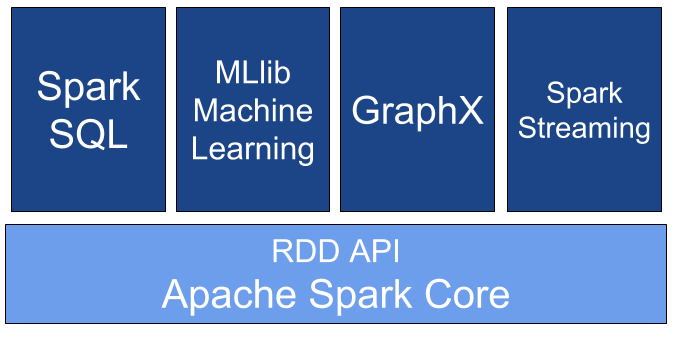

Onderdelen van Apache Spark

Spark-uitrolmodi

Local mode: Eén machine, zoals je laptop

- Handig voor testen, debuggen en demo’s

Cluster mode: Set vooraf ingestelde machines

- Geschikt voor productie

Workflow: lokaal -> clusters

Geen codewijziging nodig

Zo komt PySpark eraan

Big Data Fundamentals met PySpark