Multi-armed bandits

Reinforcement Learning met Gymnasium in Python

Fouad Trad

Machine Learning Engineer

Multi-armed bandits

- Gokker voor fruitautomaten

- Doel → winst maximaliseren

- Oplossing → exploratie vs. exploitatie

Fruitautomaten

- Beloning per arm is 0 of 1

- Doel van de agent → maximale totale beloning

De oplossing

- Afnemende epsilon-greedy

- Epsilon → kies willekeurige machine

De oplossing

- Afnemende epsilon-greedy

- Epsilon → kies willekeurige machine

- 1 - epsilon → kies beste machine tot nu toe

- Epsilon neemt af in de tijd

Initialisatie

n_bandits = 4 true_bandit_probs = np.random.rand(n_bandits)n_iterations = 100000 epsilon = 1.0 min_epsilon = 0.01 epsilon_decay = 0.999counts = np.zeros(n_bandits) # Hoe vaak elke bandit is gespeeldvalues = np.zeros(n_bandits) # Geschatte winstkans per banditrewards = np.zeros(n_iterations) # Beloningsgeschiedenisselected_arms = np.zeros(n_iterations, dtype=int) # Keuzehistorie van armen

Interactielus

for i in range(n_iterations): arm = epsilon_greedy()reward = np.random.rand() < true_bandit_probs[arm]rewards[i] = reward selected_arms[i] = arm counts[arm] += 1values[arm] += (reward - values[arm]) / counts[arm]epsilon = max(min_epsilon, epsilon * epsilon_decay)

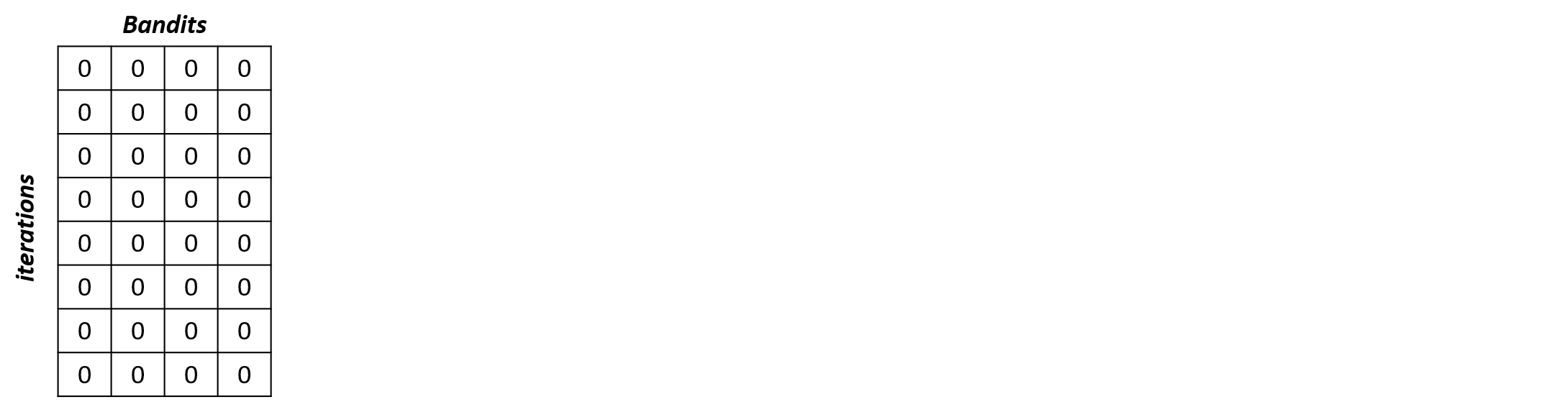

Selecties analyseren

selections_percentage = np.zeros((n_iterations, n_bandits))

Selecties analyseren

selections_percentage = np.zeros((n_iterations, n_bandits))for i in range(n_iterations): selections_percentage[i, selected_arms[i]] = 1

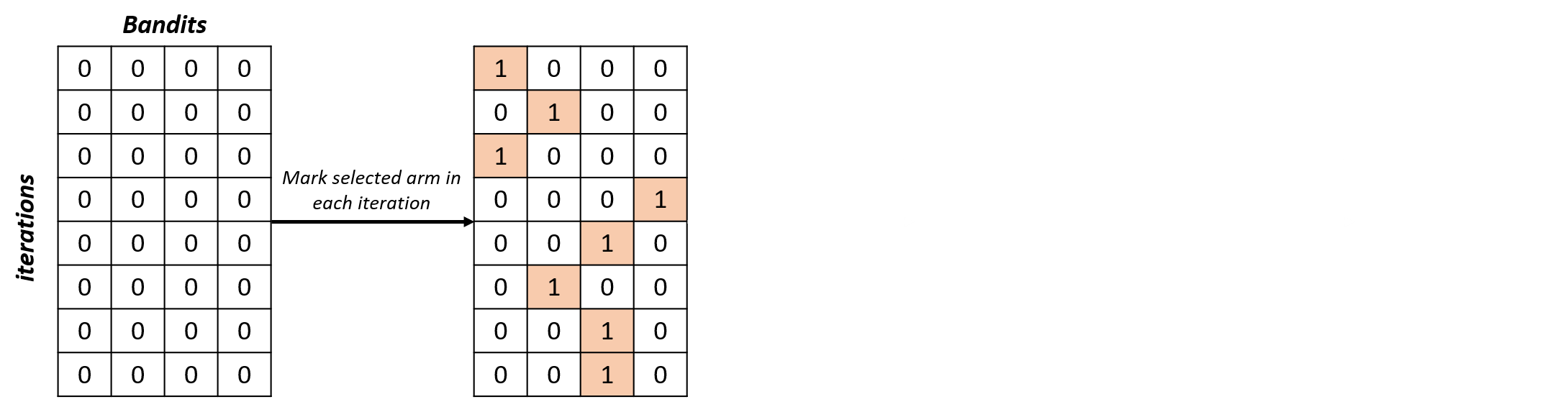

Selecties analyseren

selections_percentage = np.zeros((n_iterations, n_bandits))for i in range(n_iterations): selections_percentage[i, selected_arms[i]] = 1selections_percentage = np.cumsum(selections_percentage, axis=0) / np.arange(1, n_iterations + 1).reshape(-1, 1)

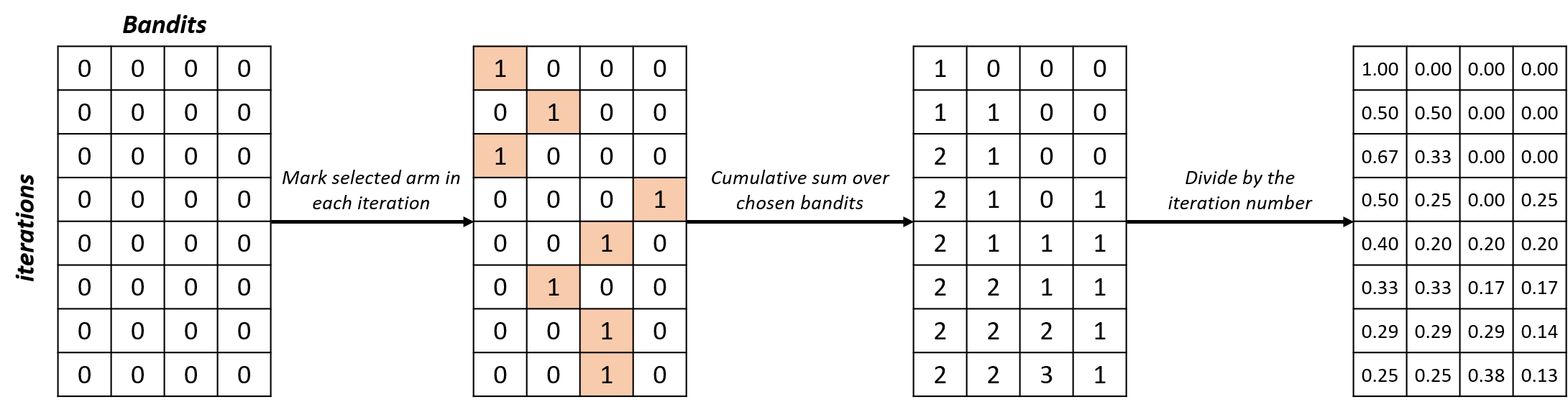

Selecties analyseren

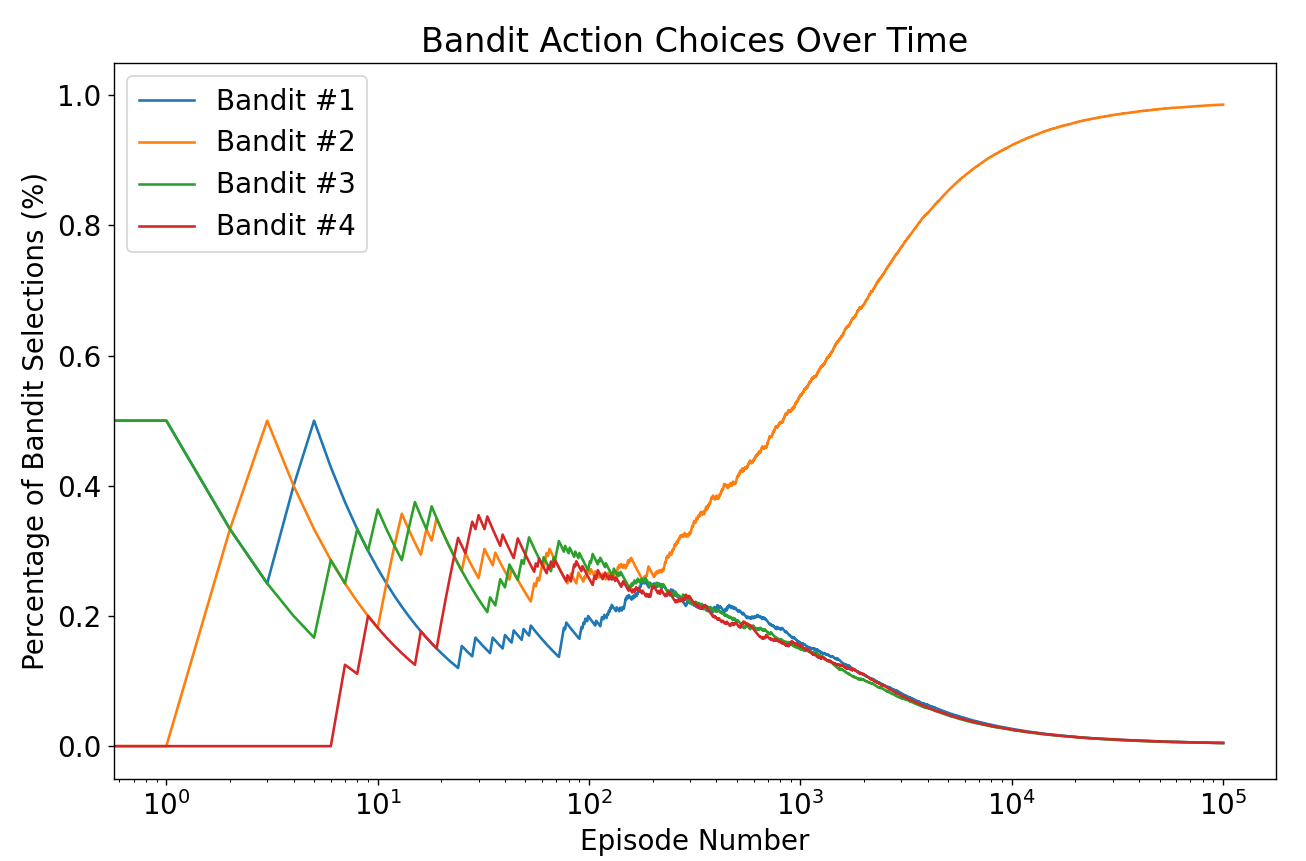

for arm in range(n_bandits): plt.plot(selections_percentage[:, arm], label=f'Bandit #{arm+1}') plt.xscale('log') plt.title('Bandit Action Choices Over Time') plt.xlabel('Episode Number') plt.ylabel('Percentage of Bandit Selections (%)') plt.legend() plt.show()for i, prob in enumerate(true_bandit_probs, 1): print(f"Bandit #{i} -> {prob:.2f}")

Bandit #1 -> 0.37

Bandit #2 -> 0.95

Bandit #3 -> 0.73

Bandit #4 -> 0.60

- Agent leert de bandit met hoogste kans te kiezen

Laten we oefenen!

Reinforcement Learning met Gymnasium in Python