Gefeliciteerd!

Transformermodels met PyTorch

James Chapman

Curriculum Manager, DataCamp

Hoofdstuk 1

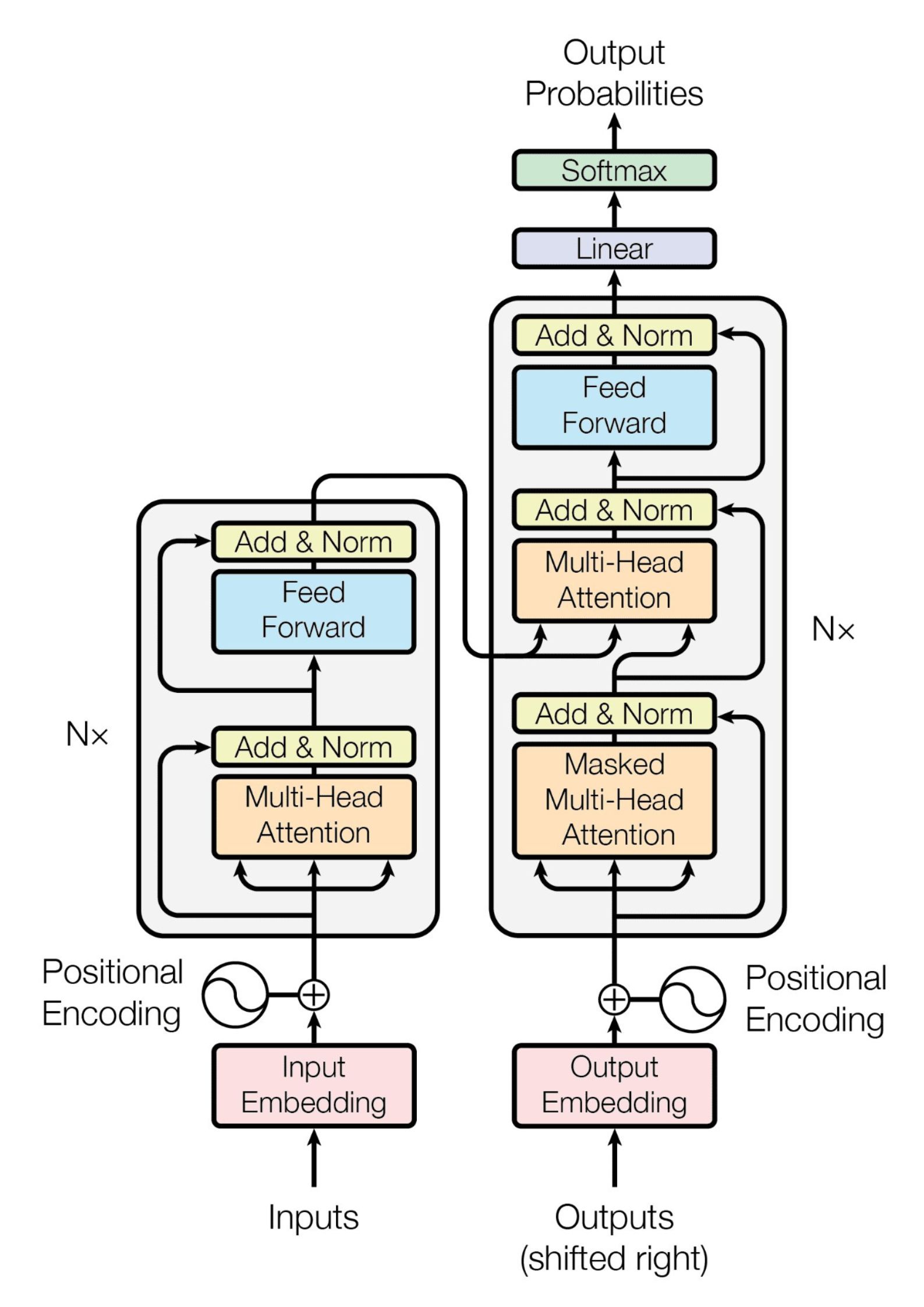

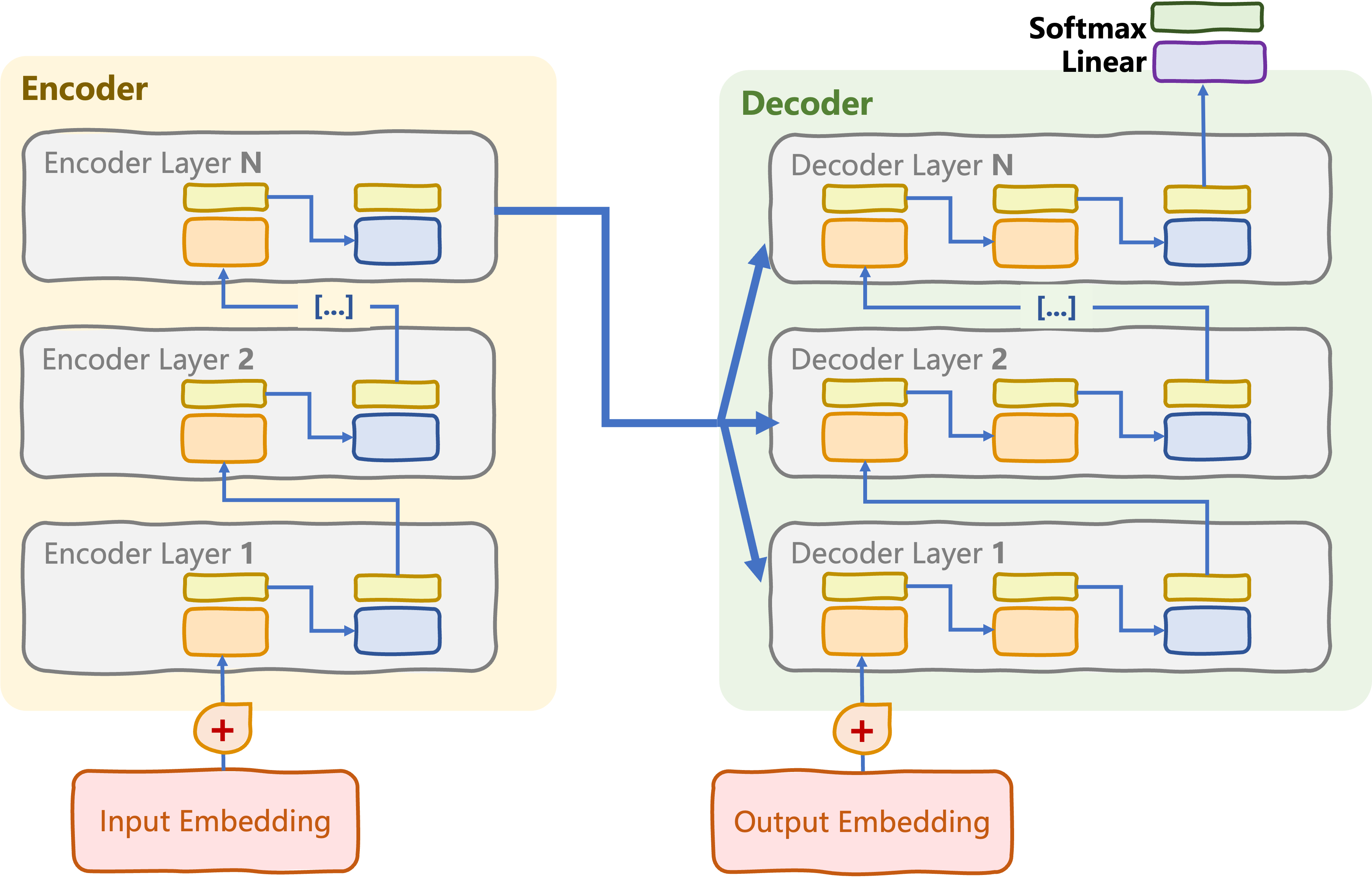

model = nn.Transformer(

d_model=1536,

nhead=8,

num_encoder_layers=6,

num_decoder_layers=6

)

class InputEmbeddings(nn.Module): ...

class PositionalEncoding(nn.Module): ...

class MultiHeadAttention(nn.Module): ...

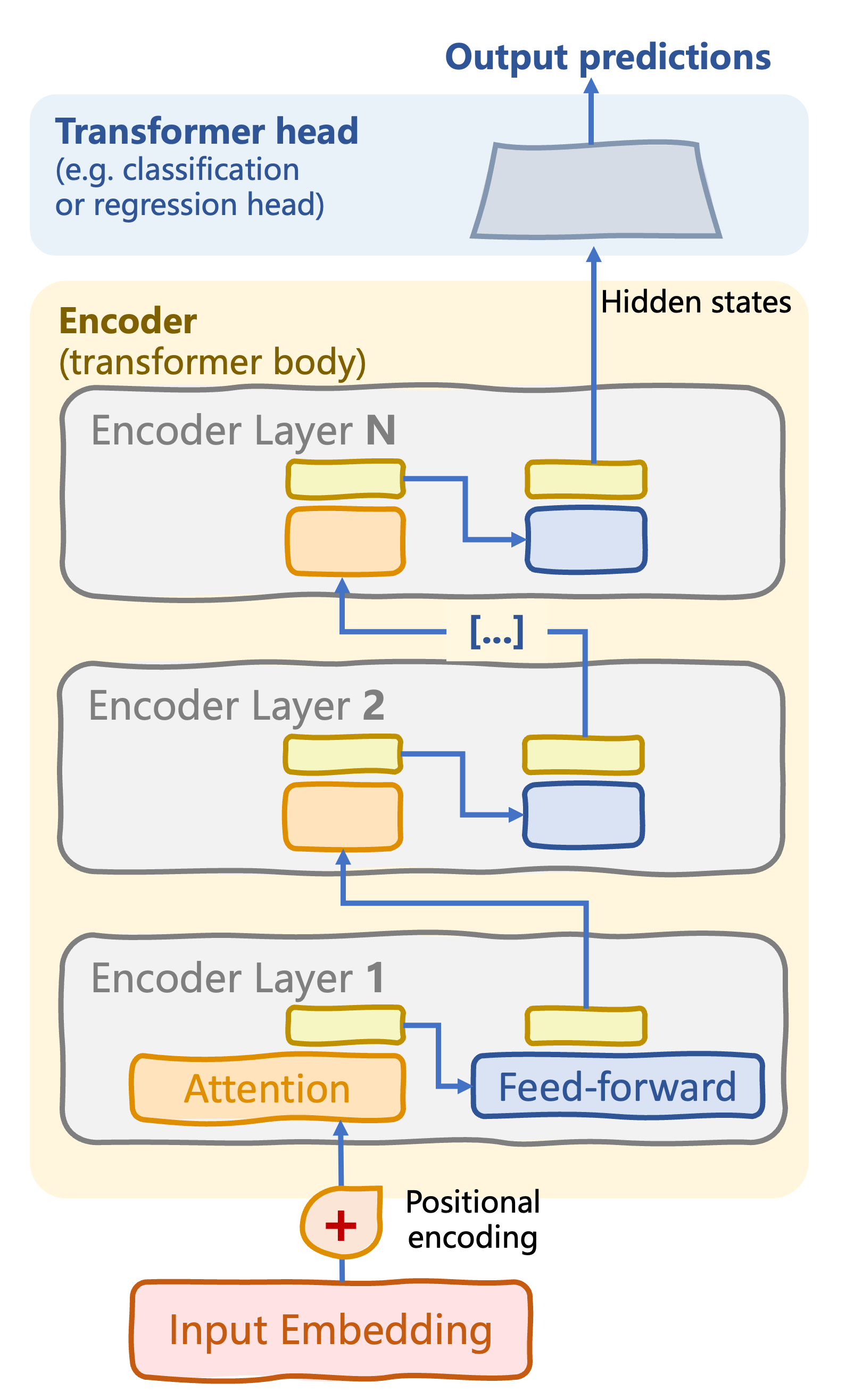

Alleen-encoder transformer

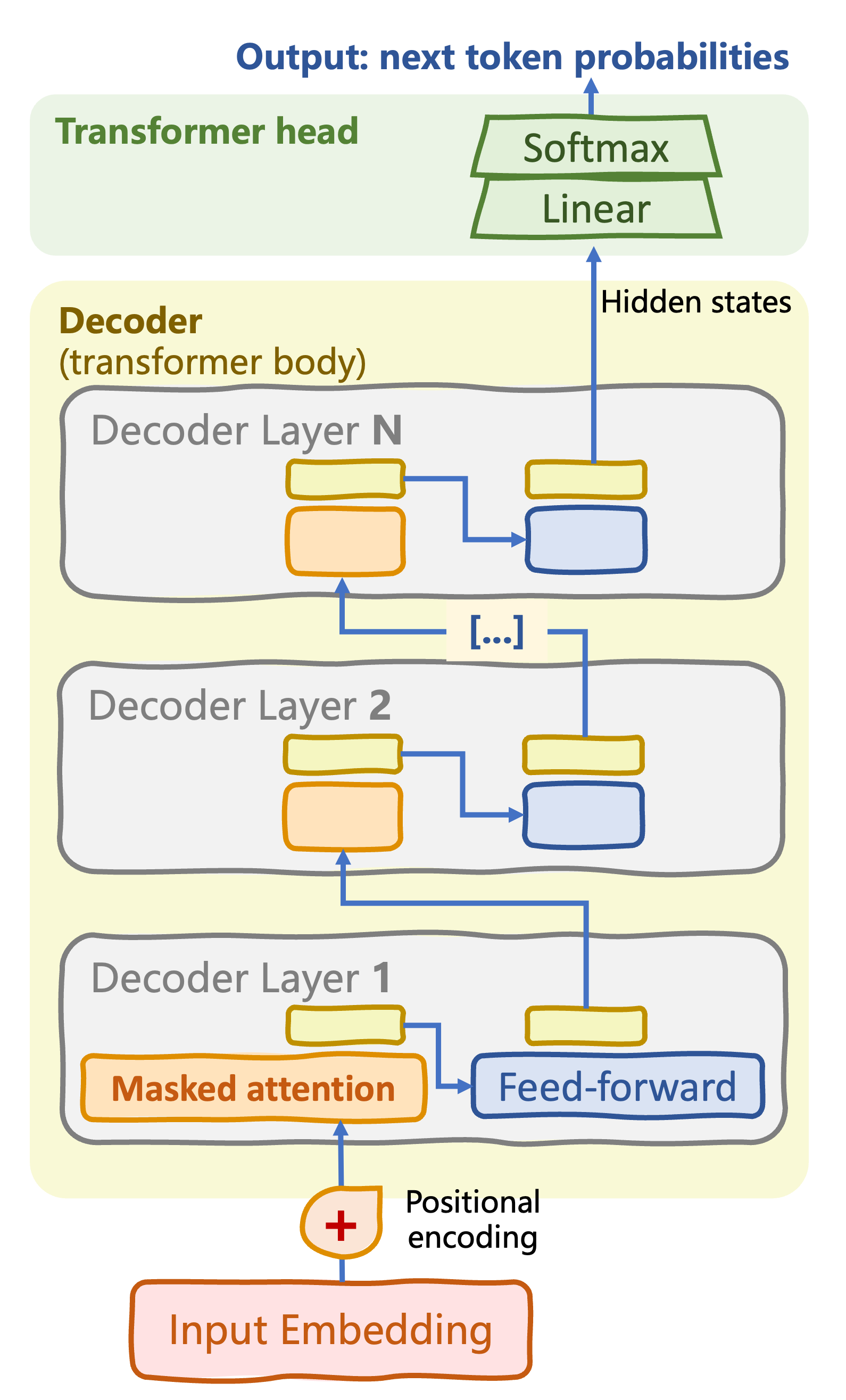

Alleen-decoder transformer

Hoofdstuk 2 - Encoder-decoder transformer

Wat nu?

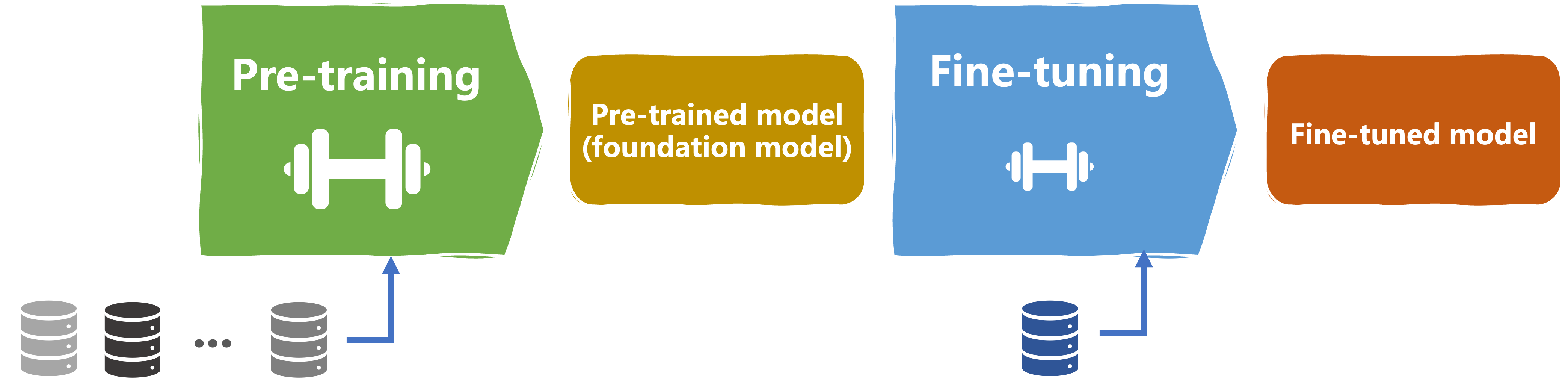

Voorgetrainde transformers

Laten we oefenen!

Transformermodels met PyTorch