Overzicht van tekstclassificatie

Deep Learning voor tekst met PyTorch

Shubham Jain

Instructor

Wat is tekstclassificatie

- Labels toekennen aan tekst

- Woorden en zinnen betekenis geven

- Brengt structuur aan in ongestructureerde data

Toepassingen:

- Klantsentiment in reviews analyseren

- Spam in e-mails detecteren

- Nieuwsartikelen taggen met relevante topics

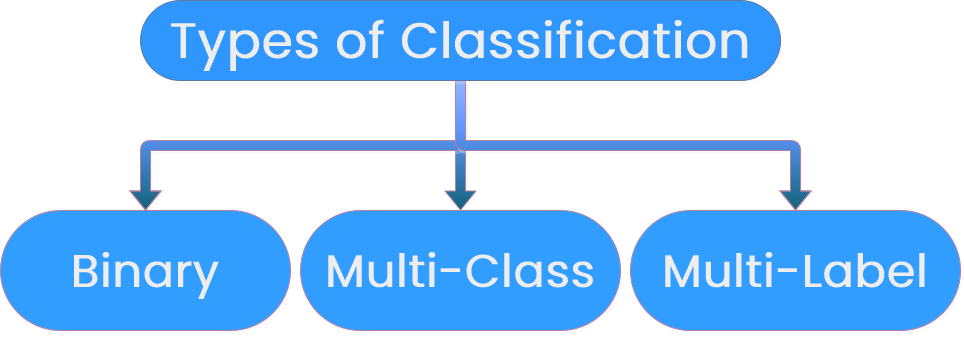

Types: binair, multi-class, multi-label

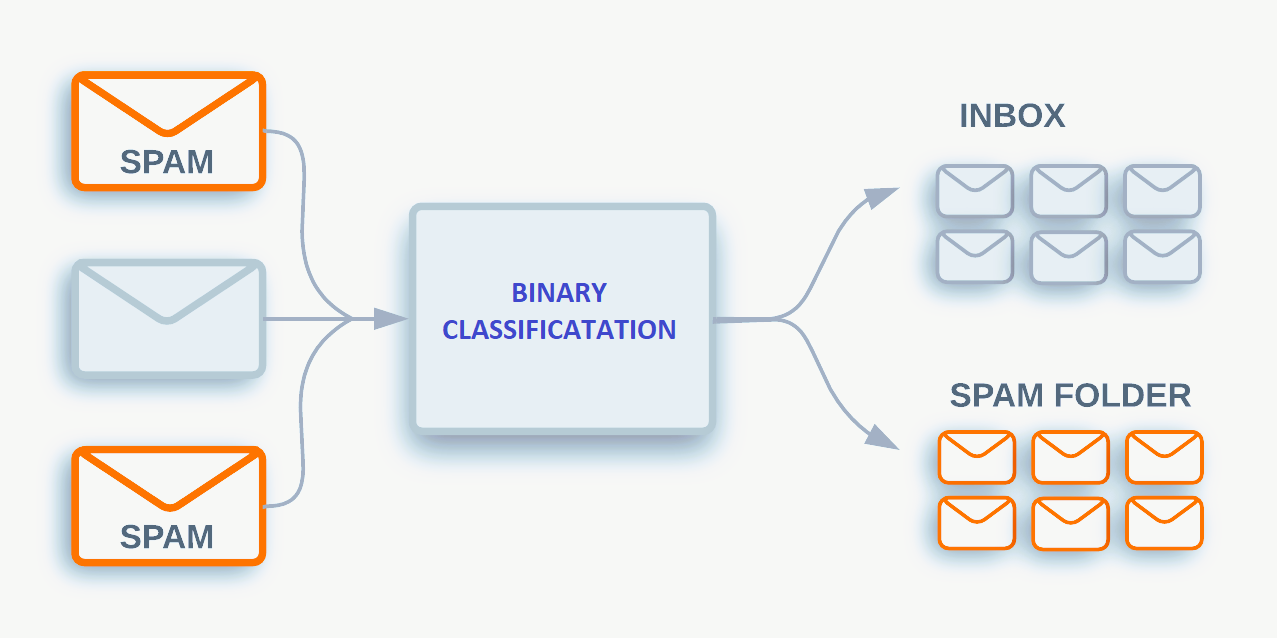

Binaire classificatie

- Indelen in twee categorieën

- Voorbeeld: spamdetectie in e-mail

- E-mails kunnen 'spam' of 'geen spam' zijn

1 https://storage.googleapis.com/gweb-cloudblog-publish/images/image4_v2LFcq0.max-1200x1200.png

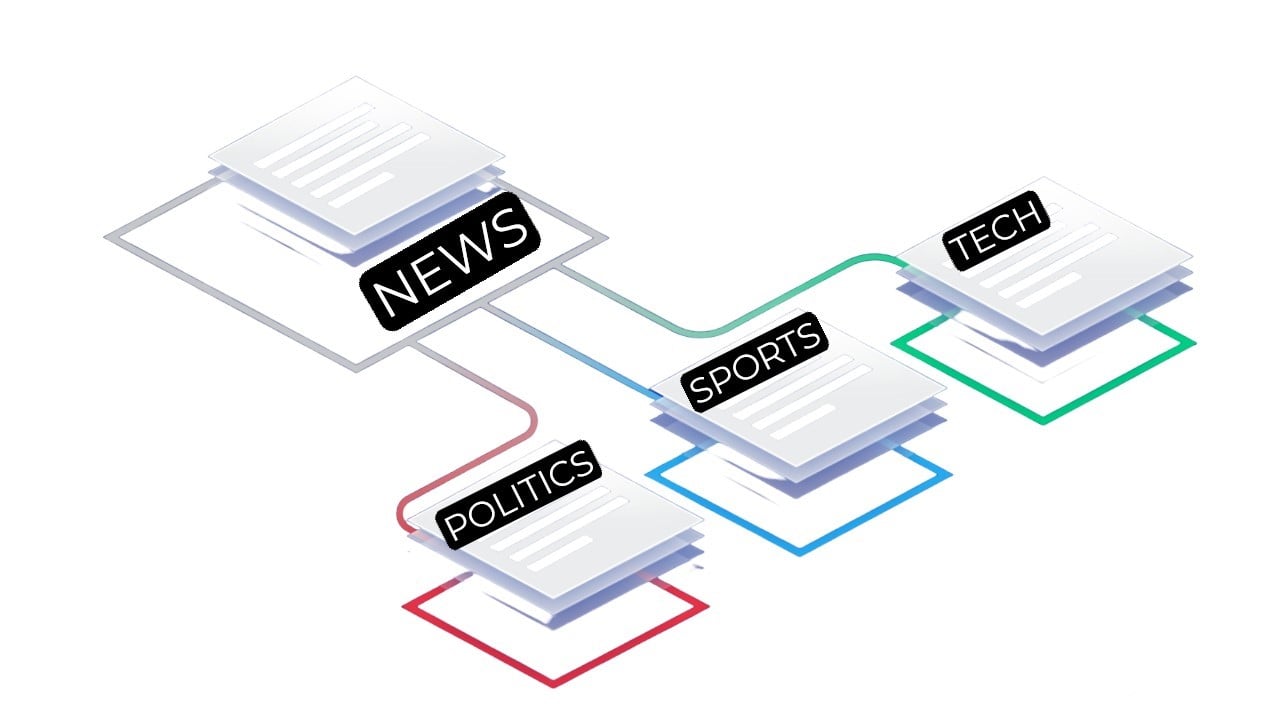

Multi-classclassificatie

- Indelen in meerdere categorieën

- Voorbeeld: Nieuwsartikelen kunnen vallen onder

- Politiek

- Sport

- Technologie

Multi-labelclassificatie

- Elke tekst kan meerdere labels krijgen

- Voorbeeld: Boeken kunnen meerdere genres hebben

- Actie

- Avontuur

- Fantasy

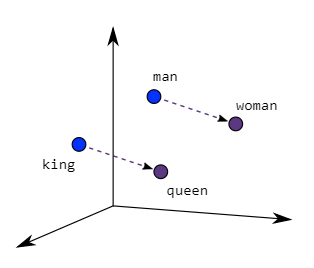

Wat zijn woordembeddings

- Eerdere encodetechnieken zijn een goed begin

- Leveren vaak te veel features op en herkennen geen soortgelijke woorden

- Woordembeddings zetten woorden om in numerieke vectoren

- Voorbeeld van semantische relatie:

- Koning en koningin

- Man en vrouw

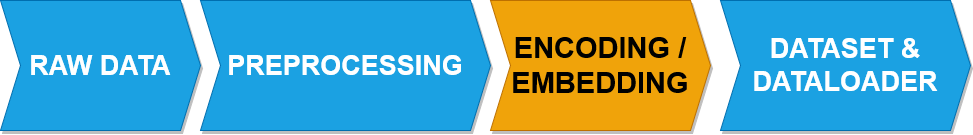

Woord-naar-index mapping

- Voorbeeld:

- "King" -> 1

- "Queen" -> 2

- Compact en rekenkundig efficiënt

- Volgt op tokenization in de pijplijn

Woordembeddings in PyTorch

torch.nn.Embedding:- Maakt woordvectoren op basis van indexen

- Input: indexen voor ['The', 'cat', 'sat', 'on', 'the', 'mat']

Embedding for 'the': tensor([-0.4689, 0.3164, -0.2971, -0.1291, 0.4064])

Embedding for 'cat': tensor([-0.0978, -0.4764, 0.0476, 0.1044, -0.3976])

Embedding for 'sat': tensor([ 0.2731, 0.4431, 0.1275, 0.1434, -0.4721])

torch.nn.Embedding gebruiken

import torch from torch import nnwords = ["The", "cat", "sat", "on", "the", "mat"] word_to_idx = {word: i for i, word in enumerate(words)}inputs = torch.LongTensor([word_to_idx[w] for w in words])embedding = nn.Embedding(num_embeddings=len(words), embedding_dim=10)output = embedding(inputs)print(output)

tensor([[ 1.0624, 0.6792, 0.0459, ... -1.0828, -0.4475, 0.4868],

...

[1.5766, 0.0106, 0.1161, ...,, -0.0859, 1.3160, 1.3621])

Embeddings in de pijplijn gebruiken

def preprocess_sentences(text): # Tokenization # Stemming ...# Word to index mappingclass TextDataset(Dataset): def __init__(self, encoded_sentences): self.data = encoded_sentences def __len__(self): return len(self.data) def __getitem__(self, index): return self.data[index]

def text_processing_pipeline(text): tokens = preprocess_sentences(text) dataset = TextDataset(tokens) dataloader = DataLoader(dataset, batch_size=2, shuffle=True) return dataloader, vectorizertext = "Your sample text here." dataloader, vectorizer = text_processing_pipeline(text)embedding = nn.Embedding(num_embeddings=10, embedding_dim=50) for batch in dataloader: output = embedding(batch) print(output)

Laten we oefenen!

Deep Learning voor tekst met PyTorch