Tekstdata encoderen

Deep Learning voor tekst met PyTorch

Shubham Jain

Data Scientist

Tekstcodering

- Zet tekst om in machineleesbare getallen

- Maakt analyse en modellering mogelijk

Encoderingstechnieken

- One-hot encoding: zet woorden om in unieke numerieke representaties

- Bag-of-Words (BoW): vangt woordfrequentie, negeert volgorde

- TF-IDF: balanceert uniekheid en belangrijkheid

- Embedding: zet woorden om in vectoren, met semantiek (Hoofdstuk 2)

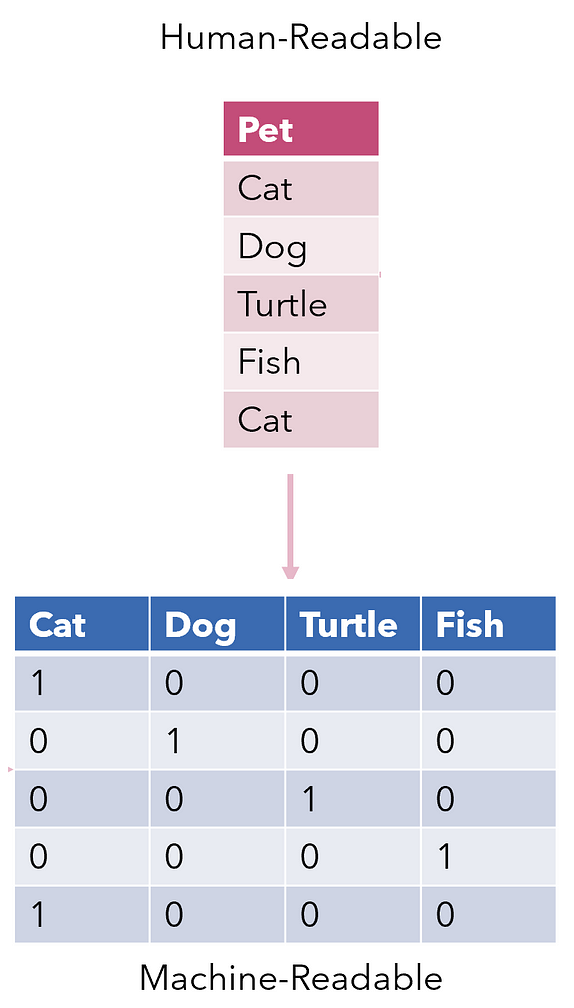

One-hot encoding

- Koppel elk woord aan een eigen vector

- Binaire vector:

- 1 als een woord aanwezig is

- 0 als een woord ontbreekt

- ['cat', 'dog', 'rabbit']

- 'cat' [1, 0, 0]

- 'dog' [0, 1, 0]

- 'rabbit' [0, 0, 1]

One-hot encoding met PyTorch

import torch vocab = ['cat', 'dog', 'rabbit']vocab_size = len(vocab)one_hot_vectors = torch.eye(vocab_size)one_hot_dict = {word: one_hot_vectors[i] for i, word in enumerate(vocab)}print(one_hot_dict)

{'cat': tensor([1., 0., 0.]),

'dog': tensor([0., 1., 0.]),

'rabbit': tensor([0., 0., 1.])}

Bag-of-words

- Voorbeeld: "The cat sat on the mat"

- Bag-of-words:

- {'the': 2, 'cat': 1, 'sat': 1, 'on': 1, 'mat': 1}

- Elk document als ongesorteerde woordverzameling

- Richt zich op frequentie, niet op volgorde

CountVectorizer

from sklearn.feature_extraction.text import CountVectorizervectorizer = CountVectorizer()corpus = ['This is the first document.', 'This document is the second document.', 'And this is the third one.', 'Is this the first document?']X = vectorizer.fit_transform(corpus)print(X.toarray())print(vectorizer.get_feature_names_out())

[[0 1 1 1 0 0 1 0 1] [0 2 0 1 0 1 1 0 1] [1 0 0 1 1 0 1 1 1] [0 1 1 1 0 0 1 0 1]]['and' 'document' 'first' 'is' 'one' 'second' 'the' 'third' 'this']

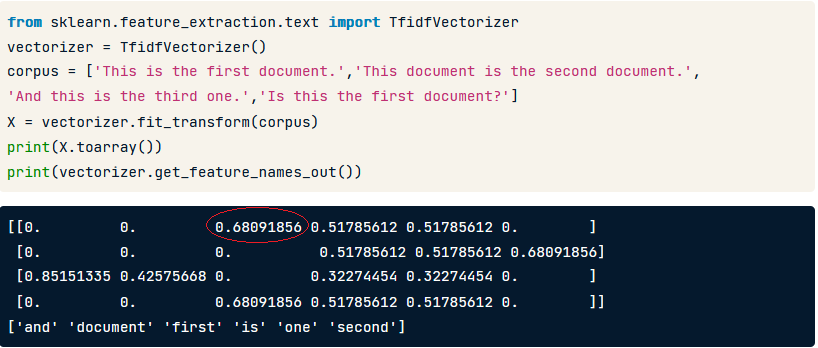

TF-IDF

- Term Frequency–Inverse Document Frequency

- Scoort de belangrijkheid van woorden in een document

- Zeldzame woorden scoren hoger

- Veelvoorkomende lager

- Benadrukt informatieve woorden

TfidfVectorizer

from sklearn.feature_extraction.text import TfidfVectorizer vectorizer = TfidfVectorizer()corpus = ['This is the first document.','This document is the second document.', 'And this is the third one.','Is this the first document?']X = vectorizer.fit_transform(corpus)print(X.toarray())print(vectorizer.get_feature_names_out())

[[0. 0. 0.68091856 0.51785612 0.51785612 0. ] [0. 0. 0. 0.51785612 0.51785612 0.68091856] [0.85151335 0.42575668 0. 0.32274454 0.32274454 0. ] [0. 0. 0.68091856 0.51785612 0.51785612 0. ]]['and' 'document' 'first' 'is' 'one' 'second']

TfidfVectorizer

Encoderingstechnieken

Technieken: one-hot encoding, bag-of-words en TF-IDF

- Laat modellen tekst begrijpen en verwerken

- Kies één techniek om redundantie te vermijden

- Er zijn meer technieken

Laten we oefenen!

Deep Learning voor tekst met PyTorch