Adversariële aanvallen op tekstclassificatiemodellen

Deep Learning voor tekst met PyTorch

Shubham Jain

Instructor

Wat zijn adversariële aanvallen?

- Kleine tweaks aan inputdata

- Niet willekeurig maar berekende, kwaadaardige wijzigingen

- Kunnen AI-beslissingen sterk beïnvloeden

Belang van robuustheid

- AI die beslist of reacties toxisch of oké zijn

- AI die negatieve stereotypen uit scheve data versterkt

- AI die misleidende info geeft

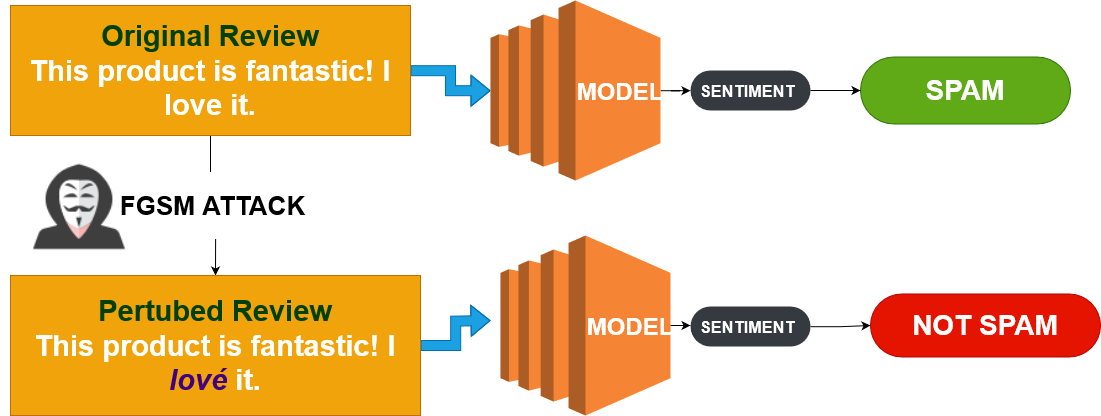

Fast Gradient Sign Method (FGSM)

- Misbruikt wat het model heeft geleerd

- Maakt minimale aanpassing om te misleiden

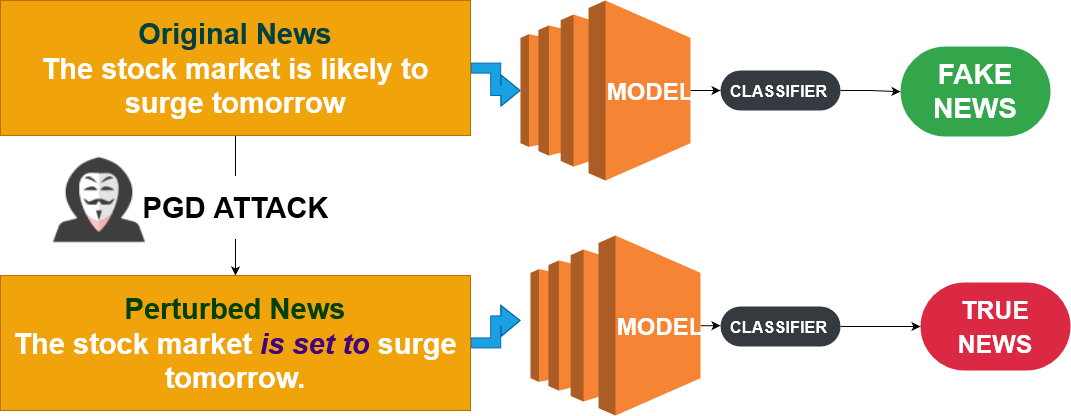

Projected Gradient Descent (PGD)

- Geavanceerder dan FGSM: iteratief

- Zoekt de meest effectieve verstoring

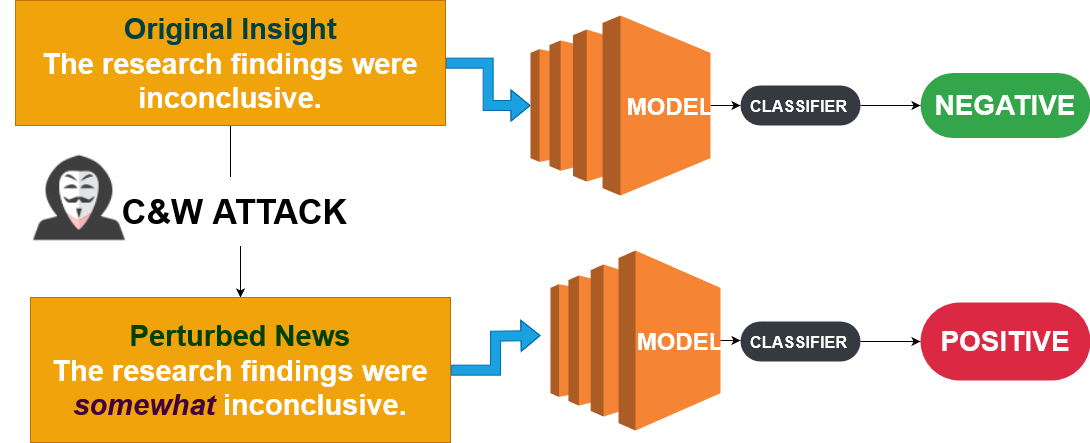

De Carlini & Wagner (C&W)-aanval

- Richt zich op het optimaliseren van de verliesfunctie

- Niet alleen misleiden, maar ook ondetecteerbaar zijn

Verdedigingen opbouwen: strategieën

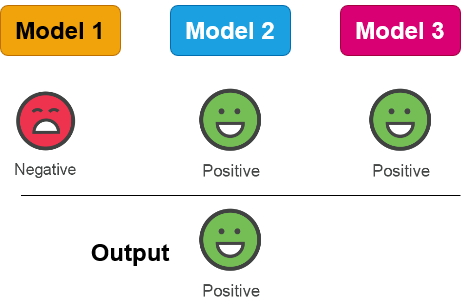

- Model-ensembling:

- Gebruik meerdere modellen

- Robuuste data-augmentatie:

- Data-augmentatie

- Adversariële training:

- Anticipeer op misleiding

Verdedigingen opbouwen: tools en technieken

- PyTorch's Robustness Toolbox:

- Versterk tekstmodellen

- Gradient masking:

- Voeg variatie toe aan trainingsdata om misbruikbare patronen te verbergen

- Regularisatietechnieken:

- Zorg voor modelbalans

1 https://adversarial-robustness-toolbox.readthedocs.io/en/latest/, https://stock.adobe.com/ie/contributor/209161356/designer-s-circle

Laten we oefenen!

Deep Learning voor tekst met PyTorch