De Llama-finetuningbibliotheken

Fijn-afstemmen met Llama 3

Francesca Donadoni

Curriculum Manager, DataCamp

Wanneer finetuning gebruiken

- Voorgetraind model

- Gebruikt gespecialiseerde data

- Nauwkeurigheid verbeteren

- Bias verminderen

- Kennisbasis verbeteren

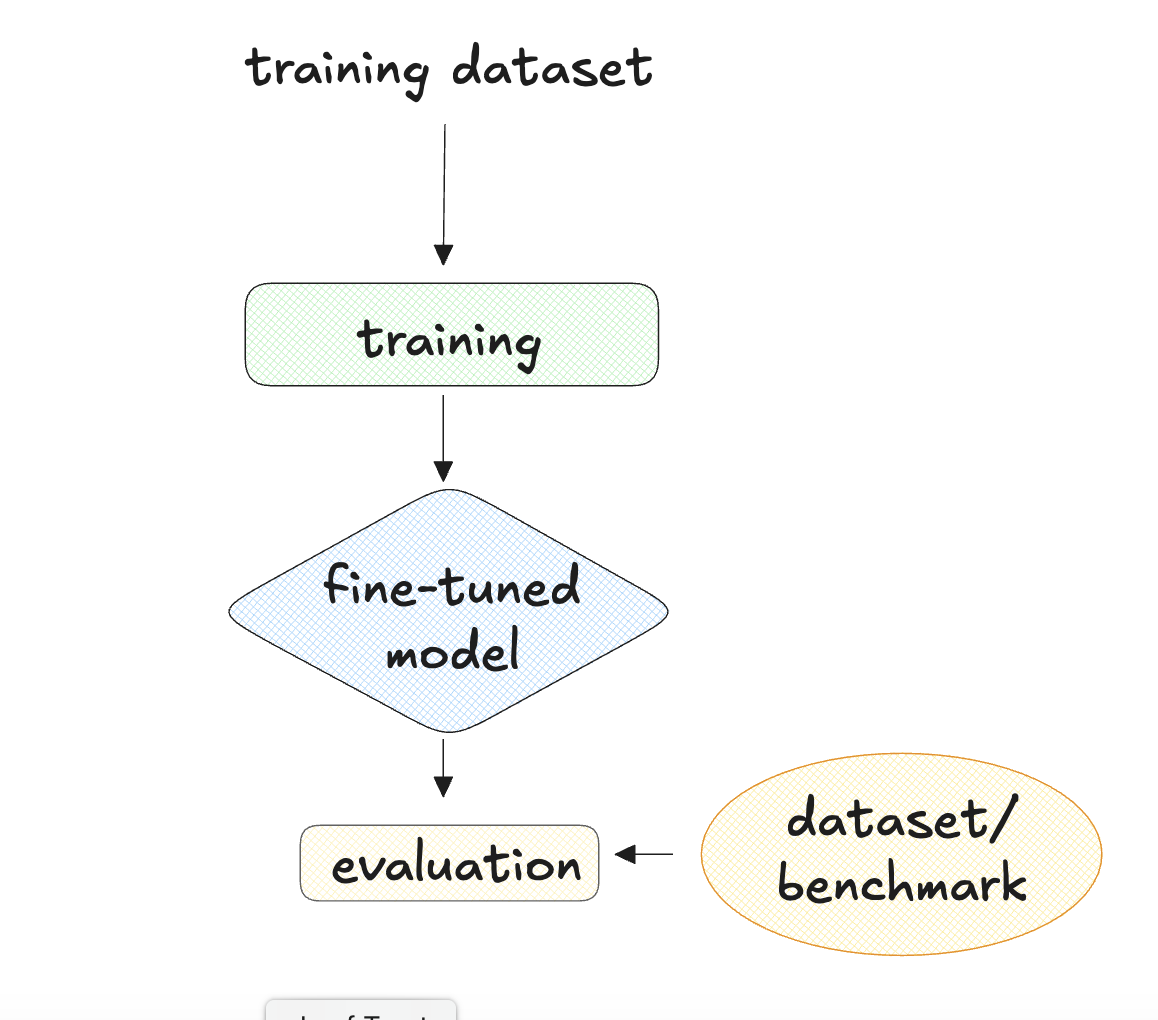

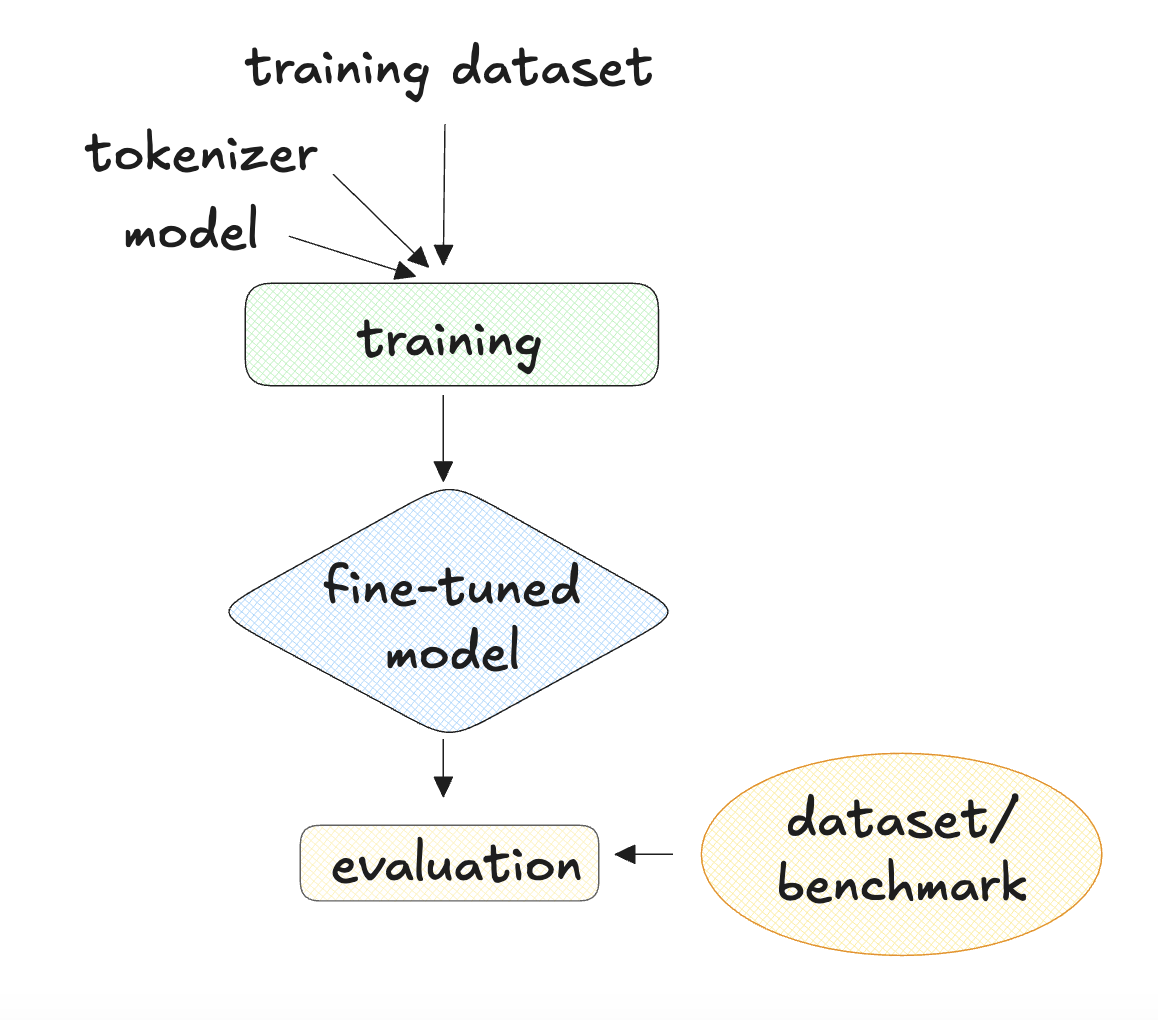

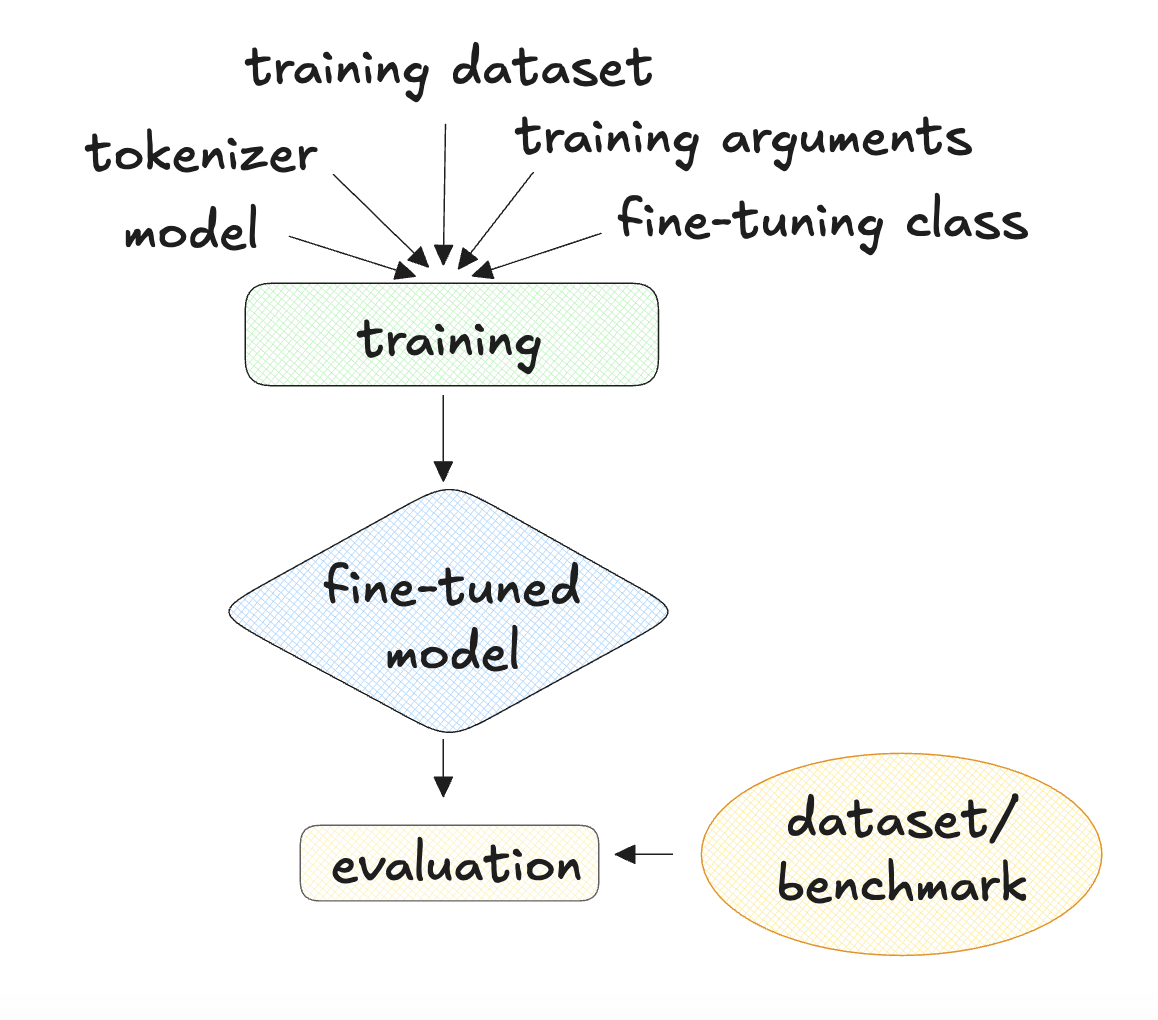

Finetuning gebruiken

- Datakwaliteit

- Modelcapaciteit

- Taakdefinitie

- Finetuningproces

Finetuning gebruiken

- Datakwaliteit

- Modelcapaciteit

- Taakdefinitie

- Finetuningproces

Finetuning gebruiken

- Datakwaliteit

- Modelcapaciteit

- Taakdefinitie

- Finetuningproces

Finetuning gebruiken

- Datakwaliteit

- Modelcapaciteit

- Taakdefinitie

- Finetuningproces

Finetuning gebruiken

- Datakwaliteit

- Modelcapaciteit

- Taakdefinitie

- Finetuningproces

- Nieuw model

- Evaluatie

De Llama-finetuningbibliotheken

- 📚 Meerdere libraries voor finetuning

- 🦙 TorchTune voor Llama-finetuning

- 🚀 Een finetuningtaak starten met TorchTune

Opties voor Llama-finetuning

- TorchTune

- Gebaseerd op configureerbare templates

- Ideaal voor: snel opschalen

- SFTTrainer van Hugging Face

- Toegang tot andere LLM’s

- Ideaal voor: meerdere modellen finetunen

- Unsloth

- Efficiënt geheugengebruik

- Ideaal voor: beperkte hardware

- Axolotl

- Modulaire aanpak

- Ideaal voor: geen uitgebreide herconfiguratie

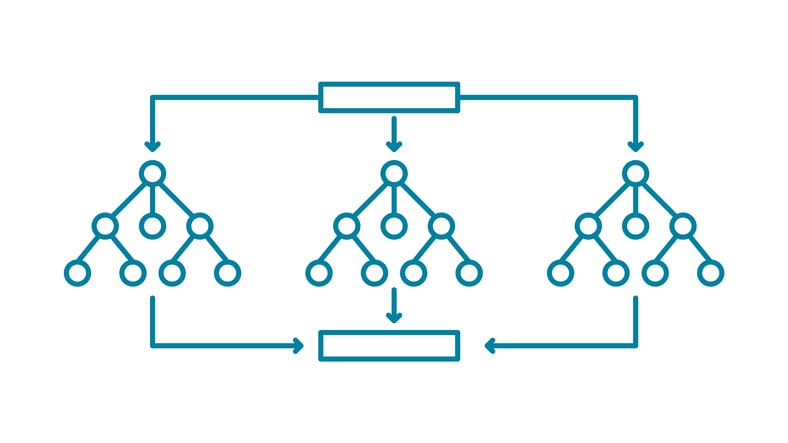

TorchTune en recepten voor finetuning

TorchTune-recepten:

- Modulaire templates

- Configureerbaar voor verschillende projecten

- Houdt code georganiseerd

- Zorgt voor reproduceerbaarheid

TorchTune-lijst

- Uitvoeren vanuit een terminal

- Omgeving met Python

- TorchTune installeren

pip3 install torchtune Beschikbare recepten tonen

tune ls! bij gebruik van IPython

!tune ls

TorchTune-lijst

!tune ls

- Output:

RECIPE CONFIG

full_finetune_single_device llama3/8B_full_single_device

llama3_1/8B_full_single_device

llama3_2/1B_full_single_device

llama3_2/3B_full_single_device

full_finetune_distributed llama3/8B_full

llama3_1/8B_full

llama3_2/1B_full

...

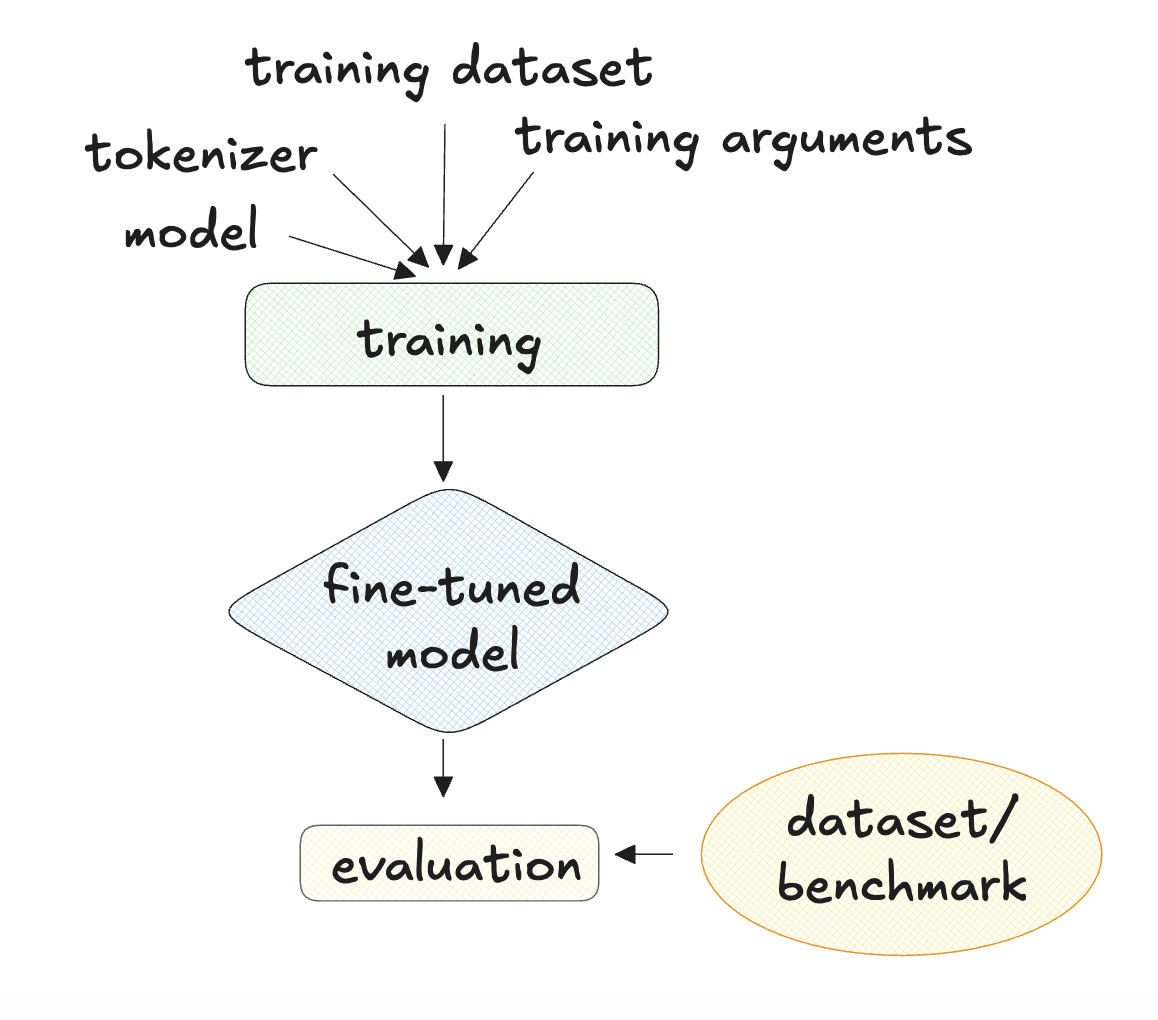

TorchTune-run

- Gebruik recipe +

--config+ configuratie Finetuning uitvoeren

tune run full_finetune_single_device --config \ llama3_1/8B_lora_single_deviceParameters

device=cpuofdevice=cudaepochs=<int>(<int>is 0 of een positief geheel getal)

Laten we oefenen!

Fijn-afstemmen met Llama 3