Data preprocessen voor fine-tuning

Fijn-afstemmen met Llama 3

Francesca Donadoni

Curriculum Manager, DataCamp

Datasets gebruiken voor fine-tuning

Datakwaliteit is cruciaal

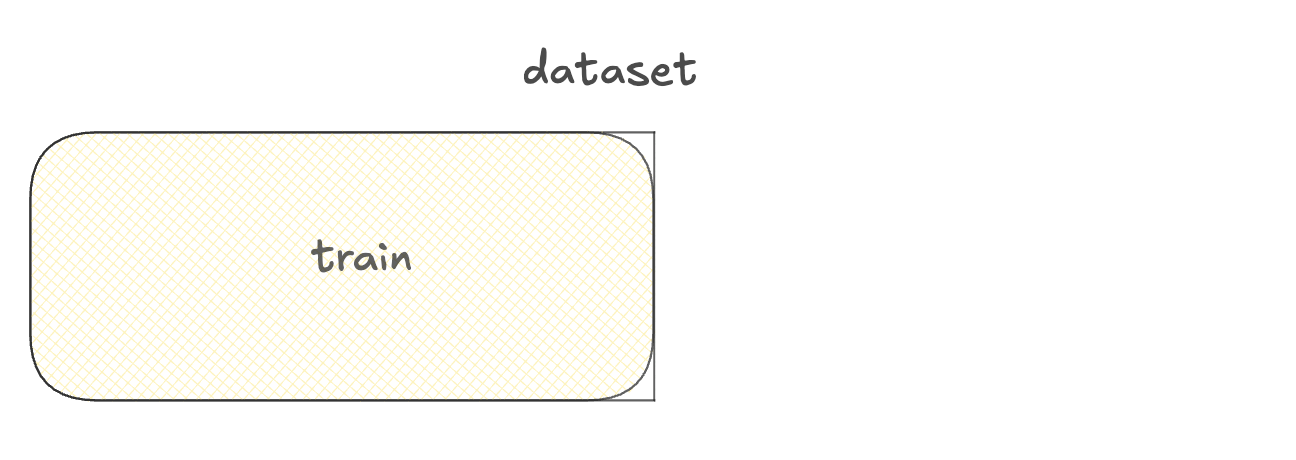

Training set:

- Voor modeltraining

- Meeste data

Datasets gebruiken voor fine-tuning

Datakwaliteit is cruciaal

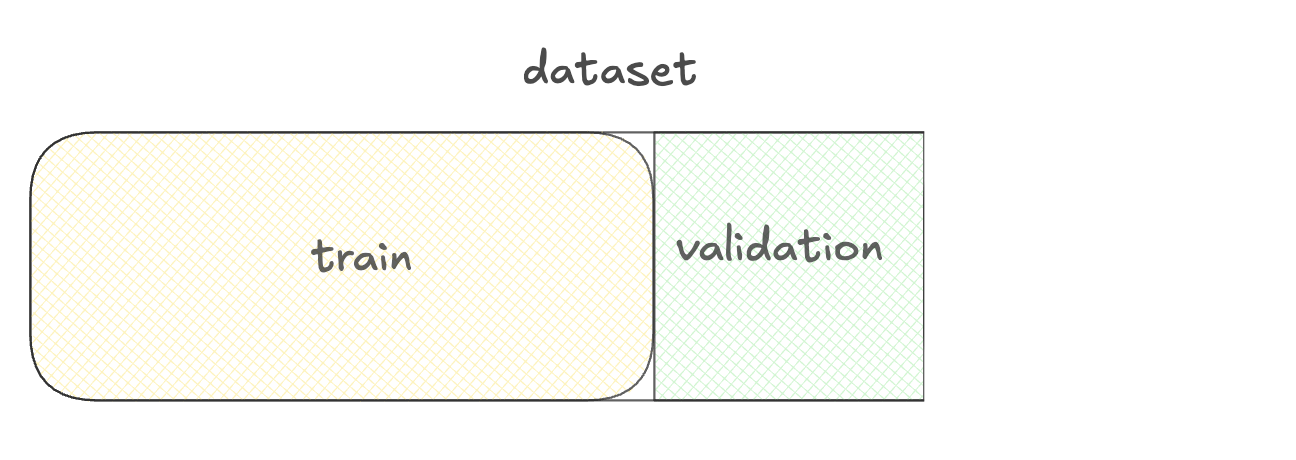

Training set:

- Voor modeltraining

- Meeste data

- Validatieset:

- Voor het kiezen van de beste modelversie

Datasets gebruiken voor fine-tuning

Datakwaliteit is cruciaal

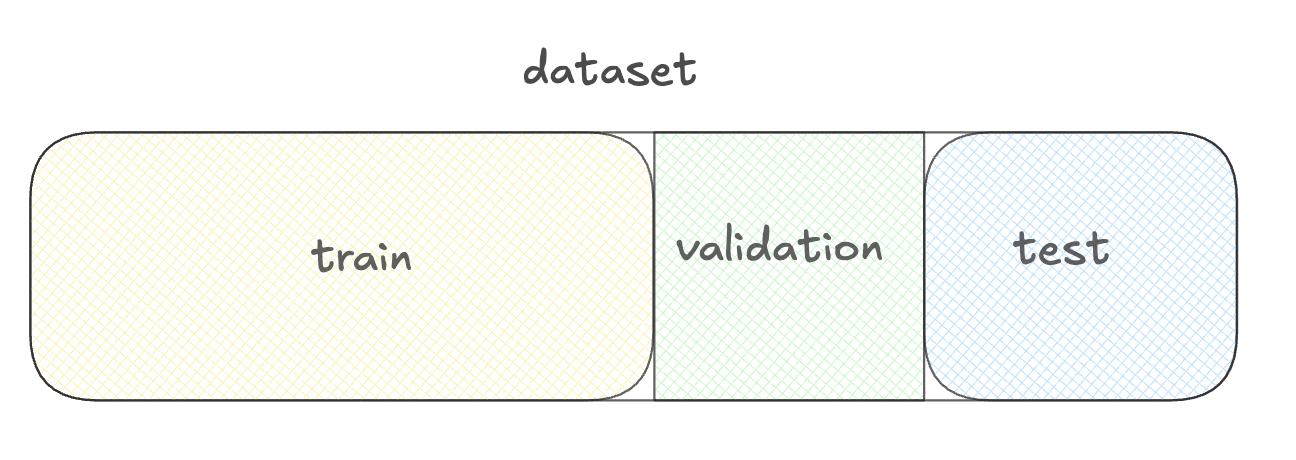

Training set:

- Voor modeltraining

- Meeste data

- Validatieset:

- Voor het kiezen van de beste modelversie

- Testset:

- Voor het evalueren van de modelprestatie

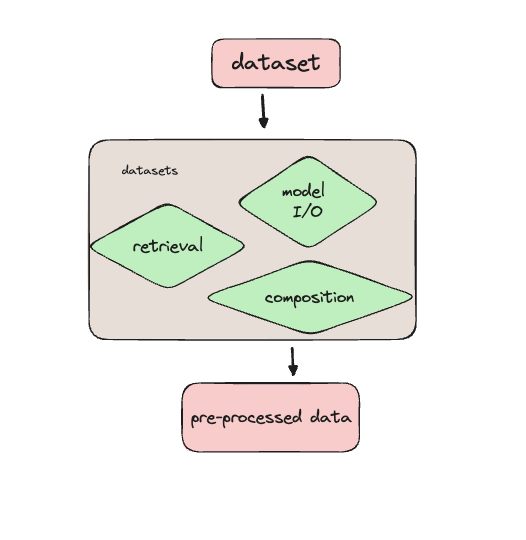

Data voorbereiden met de datasets-bibliotheek

- Datasets-bibliotheek

- Preprocessing

- Splitsen

- Laden

- Geheugenbeheer

Een klantenservicedataset laden

from datasets import load_datasetds = load_dataset( 'bitext/Bitext-customer-support-llm-chatbot-training-dataset',split="train")print(ds.column_names)

['flags', 'instruction', 'category', 'intent', 'response']

Een kijkje in de data

import pprint

pprint.pprint(ds[0])

{'category': 'ORDER',

'flags': 'B',

'instruction': 'question about cancelling order {{Order Number}}',

'intent': 'cancel_order',

'response': "I've understood you have a question regarding canceling order "

"{{Order Number}}, and I'm here to provide you with the "

'information you need. Please go ahead and ask your question, and '

"I'll do my best to assist you."}

De dataset filteren

from datasets import load_dataset, Dataset ds = load_dataset( 'bitext/Bitext-customer-support-llm-chatbot-training-dataset', split="train")print(ds.shape)

(26872, 5)

first_thousand_points = ds[:1000]ds = Dataset.from_dict(first_thousand_points)

De dataset preprocessen

def merge_example(row):row['conversation'] = f"Query: {row['instruction']}\nResponse: {row['response']}" return rowds = ds.map(merge_example)print(ds[0]['conversation'])

Query: question about cancelling order {{Order Number}}

Response: I've understood you have a question regarding canceling order {{Order Number}},

and I'm here to provide you with the information you need. Please go ahead and ask your

question, and I'll do my best to assist you.

De voorbewerkte dataset opslaan

ds.save_to_disk("preprocessed_dataset")

Saving the dataset (1/1 shards): 100%

26872/26872 [00:00<00:00, 383823.33 examples/s]

from datasets import load_from_disk

ds_preprocessed = load_from_disk("preprocessed_dataset")

Hugging Face-datasets gebruiken met TorchTune

- Hugging Face-datasets werken met TorchTune

- Stel een datasetpad en configs in

tune run full_finetune_single_device --config llama3/8B_full_single_device \

dataset=preprocessed_dataset dataset.split=train

Laten we oefenen!

Fijn-afstemmen met Llama 3