Introductie tot deep Q-learning

Deep Reinforcement Learning in Python

Timothée Carayol

Principal Machine Learning Engineer, Komment

Wat is Deep Q-learning?

Q-learning opfrissen

Kennis van $Q$ maakt optimaal beleid mogelijk: $$ \pi(s_t) = {\arg\max}_a Q(s_t, a) $$

Doel van Q-learning: $Q$ in de tijd leren

Q-learning opfrissen

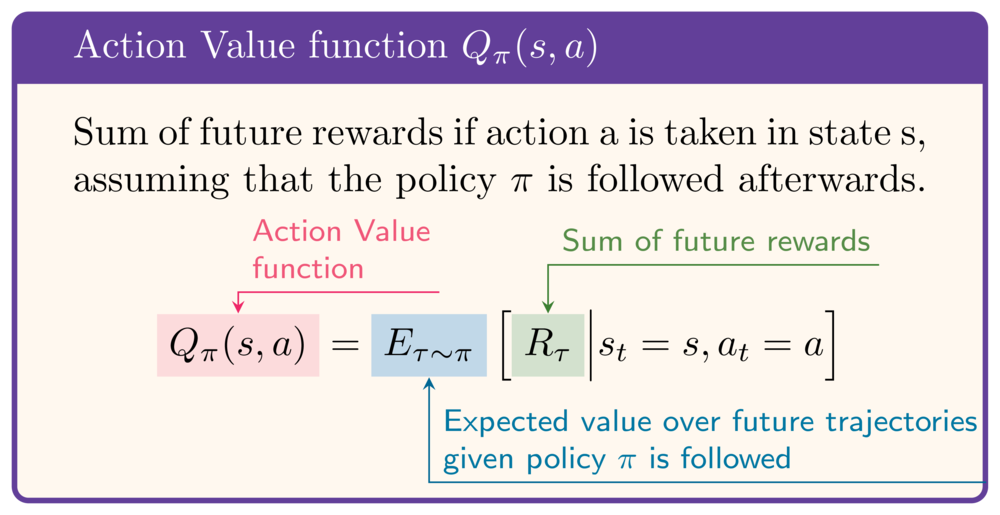

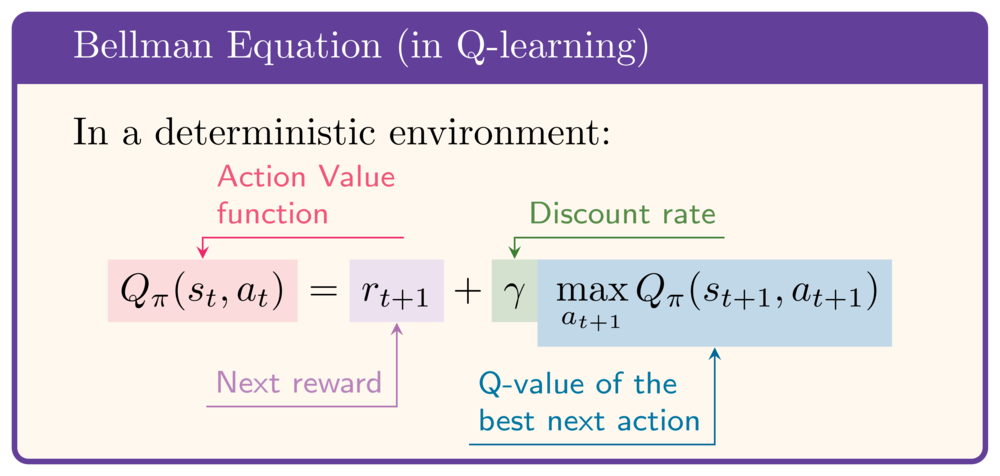

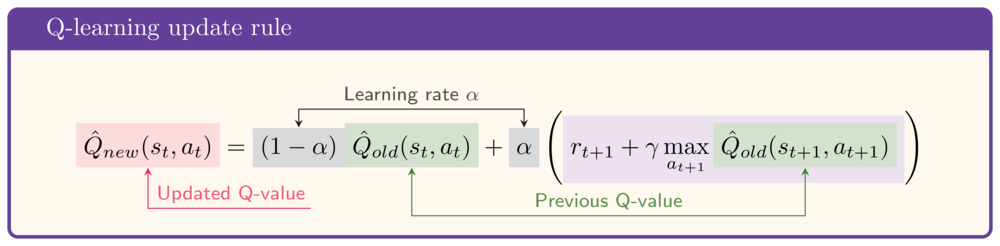

- Bellman-vergelijking: recursieve formule voor $Q$

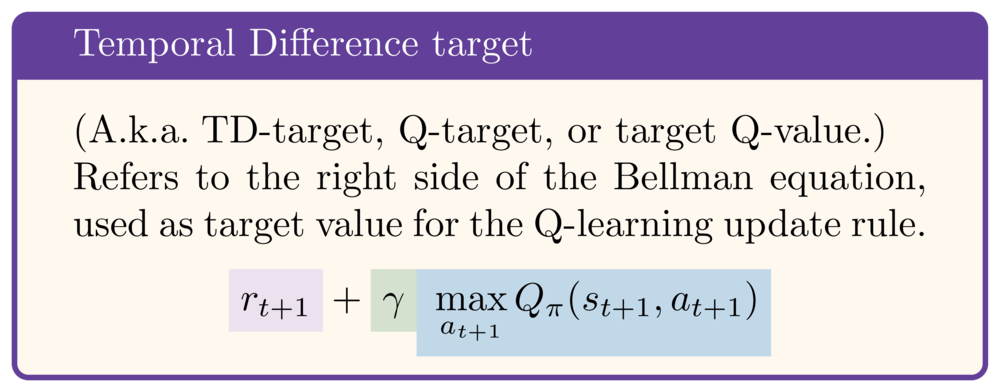

- Rechterkant van de Bellman-vergelijking: "TD-target"

- Gebruik TD-target uit de Bellman-vergelijking om $\hat{Q}$ na elke stap bij te werken

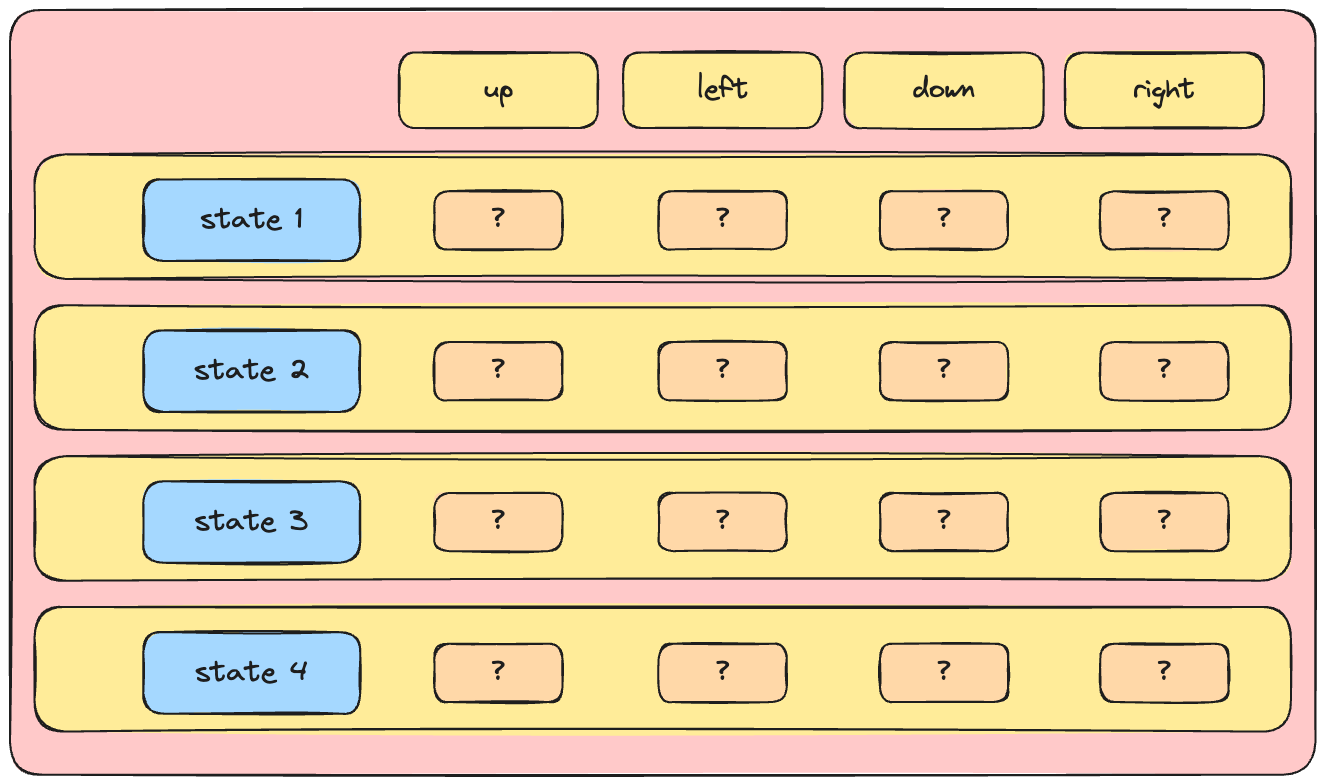

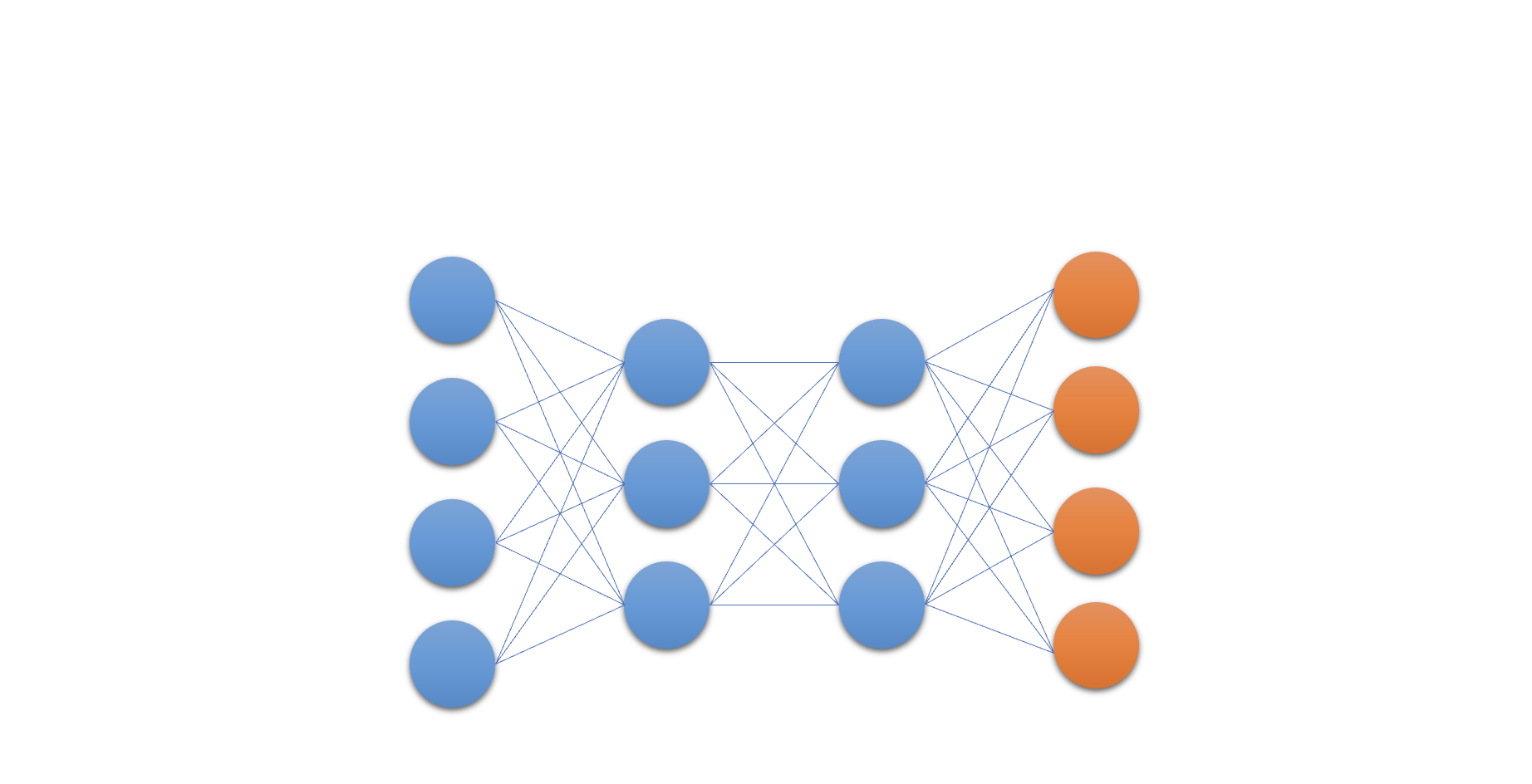

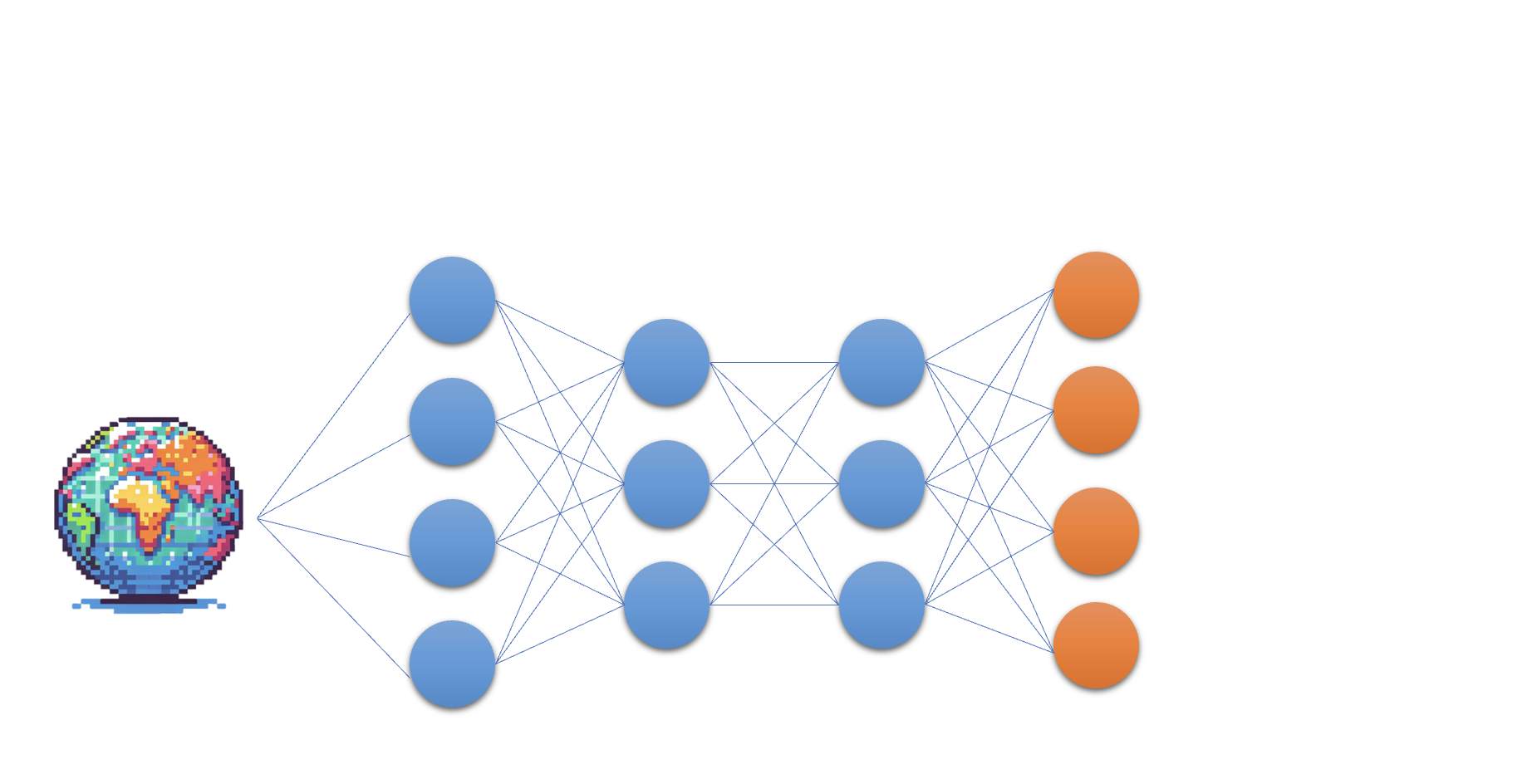

Het Q-netwerk

Het Q-netwerk

Het Q-netwerk

Het Q-netwerk

- De kern van Deep Q-learning: een neuraal netwerk

Het Q-netwerk

- De kern van Deep Q-learning: een neuraal netwerk

Het Q-netwerk

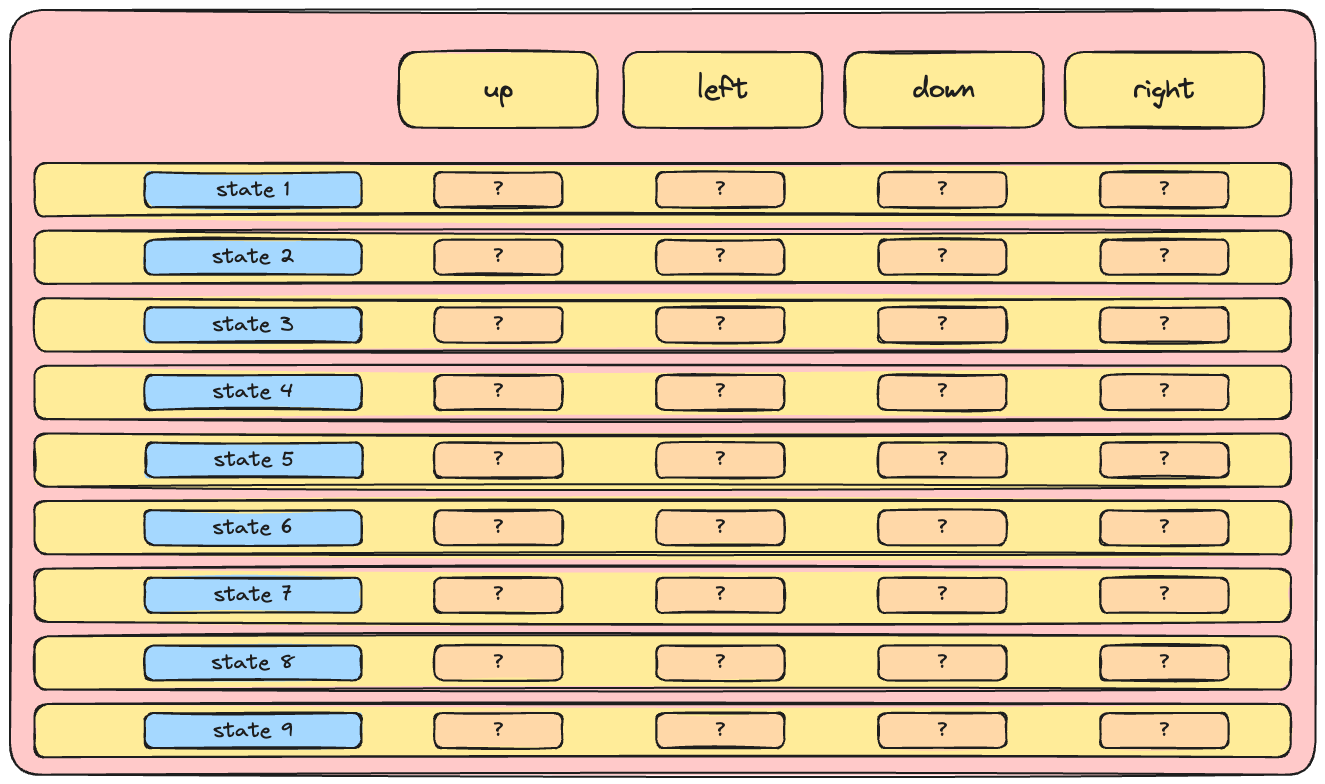

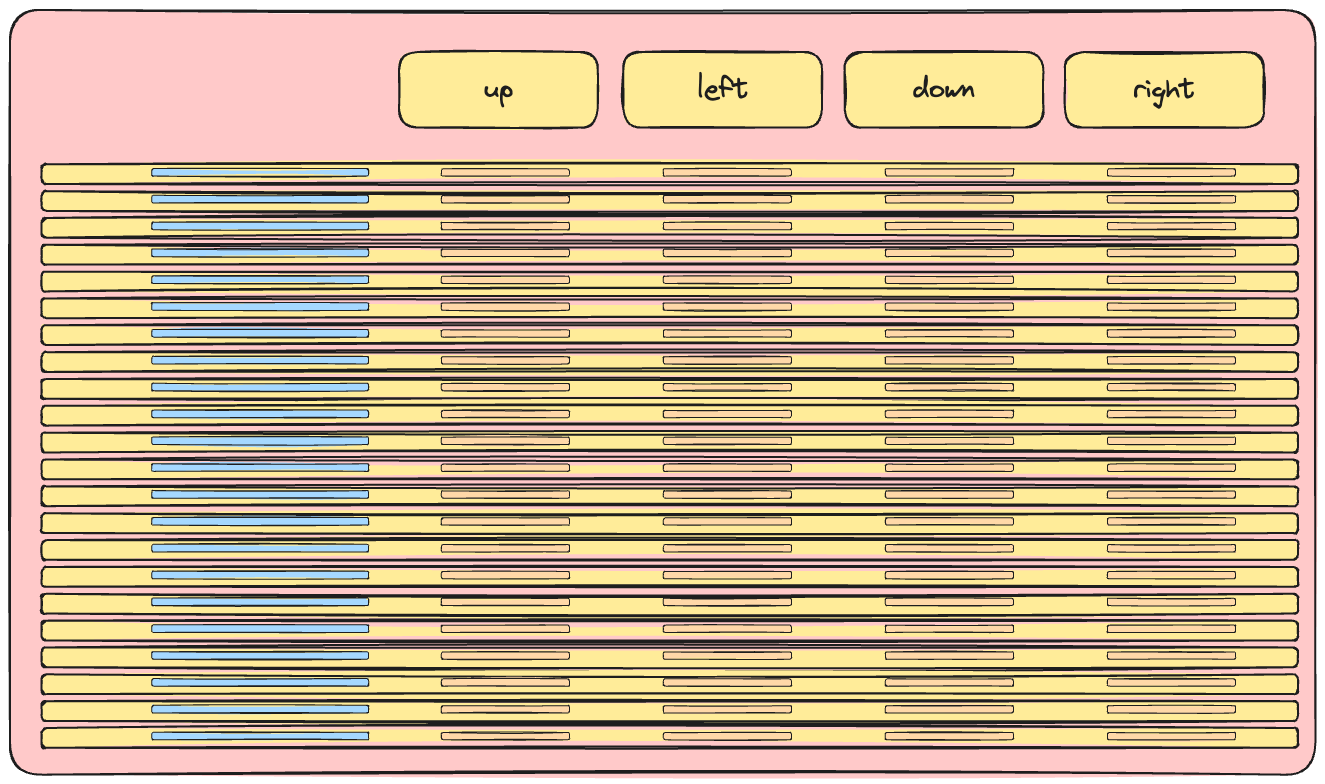

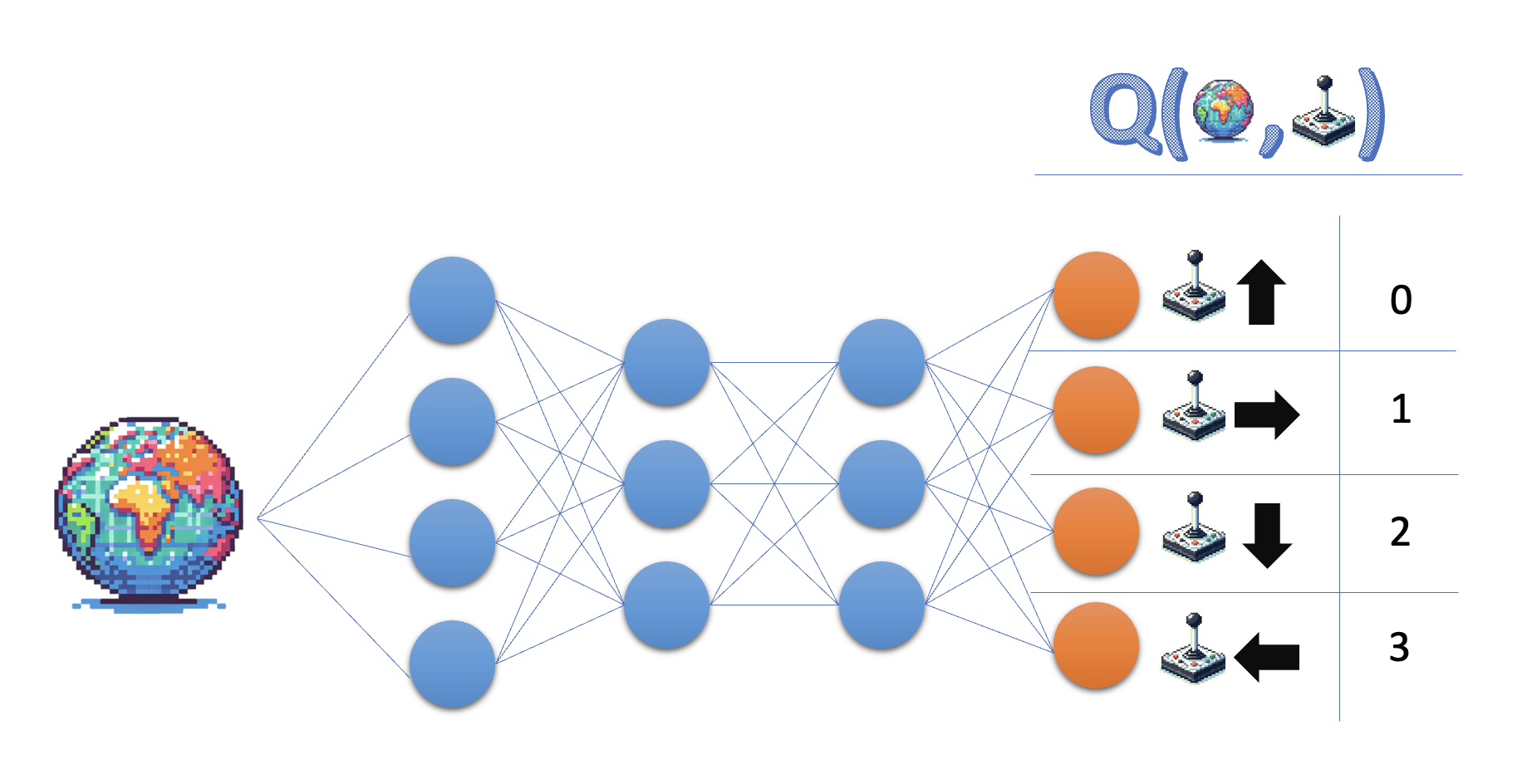

- De kern van Deep Q-learning: een neuraal netwerk dat toestand naar Q-waarden mappt

- Een netwerk dat de actie-waardefunctie benadert heet een 'Q-netwerk'

- Q-netwerken worden vaak gebruikt in Deep Q-learning-algoritmen, zoals DQN.

Het Q-netwerk implementeren

class QNetwork(nn.Module):def __init__(self, state_size, action_size): super(QNetwork, self).__init__()self.fc1 = nn.Linear(state_size, 64) self.fc2 = nn.Linear(64, 64) self.fc3 = nn.Linear(64, action_size)def forward(self, state): x = torch.relu(self.fc1(torch.tensor(state))) x = torch.relu(self.fc2(x)) return self.fc3(x)q_network = QNetwork(8, 4)optimizer = optim.Adam(q_network.parameters(), lr=0.0001)

- Invoerdimensie bepaald door toestand

Uitvoerdimensie bepaald door aantal mogelijke acties

In dit voorbeeld:

- 2 verborgen lagen met elk 64 nodes

- ReLU-activatiefunctie

Laten we oefenen!

Deep Reinforcement Learning in Python