Hyperparameteroptimalisatie met Optuna

Deep Reinforcement Learning in Python

Timothée Carayol

Principal Machine Learning Engineer, Komment

Wat zijn hyperparameters

- Veel hyperparameters in DRL-algoritmes

- Kunnen grote impact op performance hebben

- Zoekcomplexiteit groeit met het aantal hyperparameters

| Voorbeelden |

|---|

| Discontovoet |

| PPO: clipping-epsilon, entropiebonus |

| Experience replay: buffergrootte, batchgrootte |

| Afbouwschema epsilon-greediness |

| Fixed Q-targets: $\tau$ |

| Learning rate |

| Aantal lagen, nodes per laag... |

Hoe kies je hyperparametervaarden

Doel: gemiddelde cumulatieve beloningen

Technieken voor hyperparameterzoektocht:

- Handmatig trial-and-error

- Grid search

- Random search

- Specifieke algoritmes

Optuna-werkwijze:

- Definieer een doelfunctie

- Maak een Optuna

studyaan - Laat Optuna over trials itereren

import optunadef objective(trial): ...study = optuna.create_study()study.optimize(objective, n_trials=100)

study.best_params

{'learning_rate': 0.001292481, 'batch_size': 8}

De doelfunctie specificeren

In de doelfunctie:

- Definieer de hyperparameters van interesse

- Definieer de te optimaliseren metriek(en)

Volledige flexibiliteit voor hyperparameters:

- float

- integer

- categorisch

def objective(trial: optuna.trial.Trial):# Hyperparameters x en y tussen -10 en 10x = trial.suggest_float('x', -10, 10) y = trial.suggest_float('y', -10, 10)# Retourneer de te minimaliseren metriek return (x - 2) ** 2 + 1.2 * (y + 3) ** 2

De Optuna-studie

- Gebruik sqlite om de studie op te slaan

- Neem

n_trialsmet de standaard sampler (TPE)- Kiest eerst willekeurige hyperparameters

- Richt zich daarna op veelbelovende regio’s

- Als

n_trialsontbreekt: draait door tot je stopt - Studie later uit database laden kan

import sqlite study = optuna.create_study( storage="sqlite:///DRL.db", study_name="my_study")study.optimize(objective, n_trials=100)

loaded_study = optuna.load_study(

study_name="my_study",

storage="sqlite:///DRL.db")

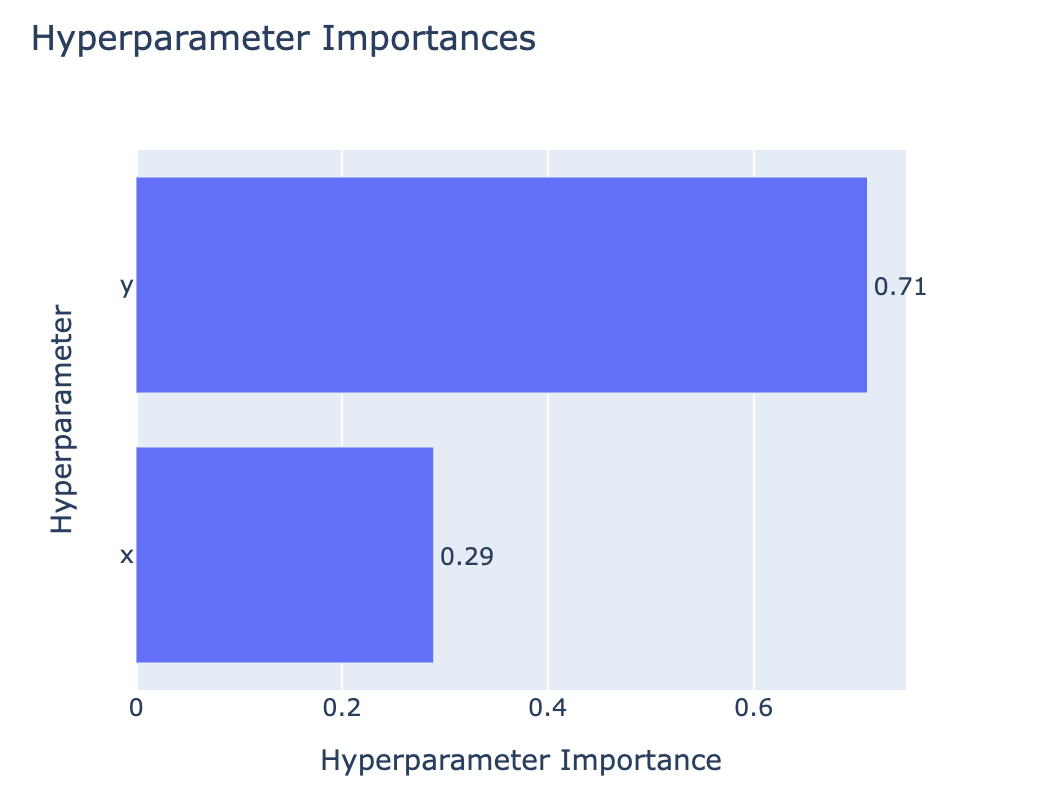

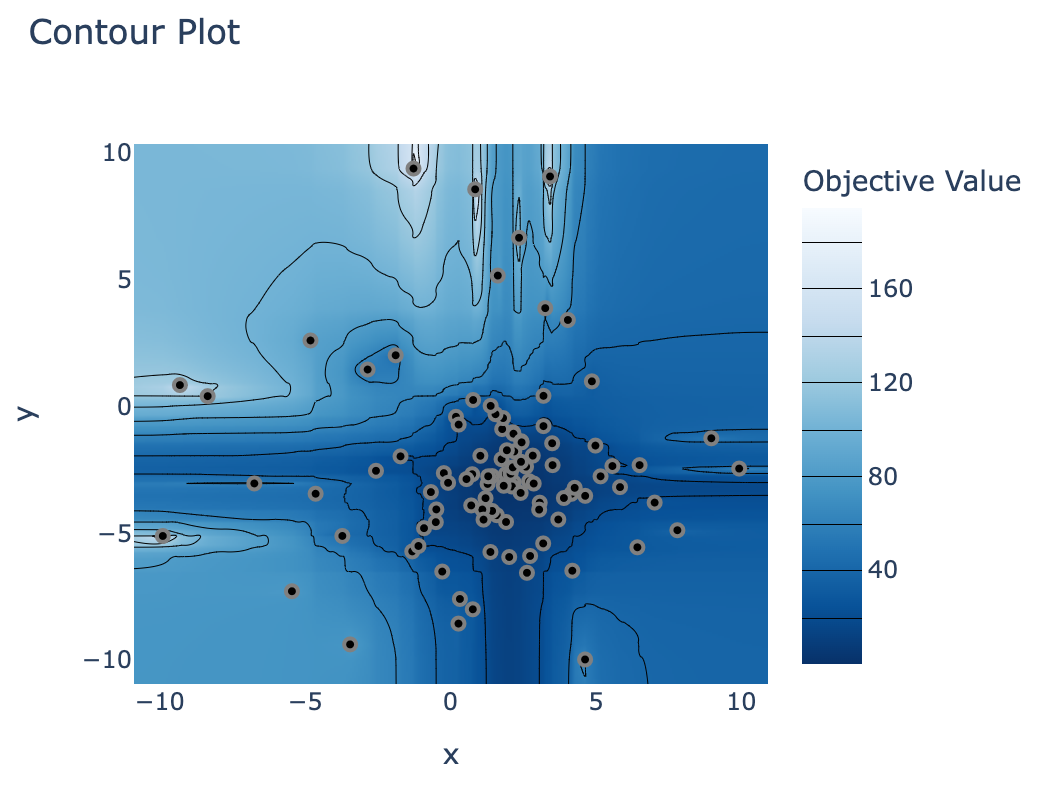

De studieresultaten verkennen

optuna.visualization.plot_param_importances(study)

optuna.visualization.plot_contour(study)

Laten we oefenen!

Deep Reinforcement Learning in Python