Batch-updates bij policy gradient

Deep Reinforcement Learning in Python

Timothée Carayol

Principal Machine Learning Engineer, Komment

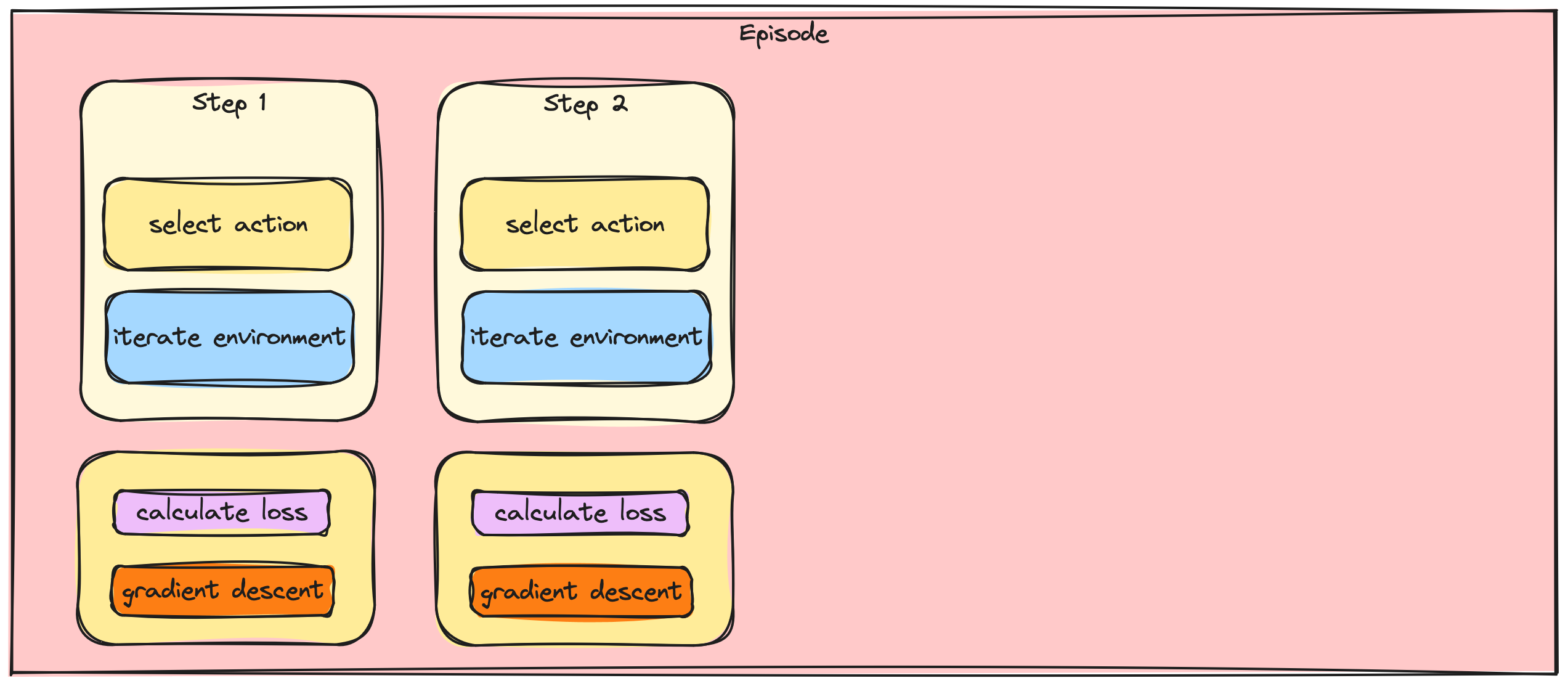

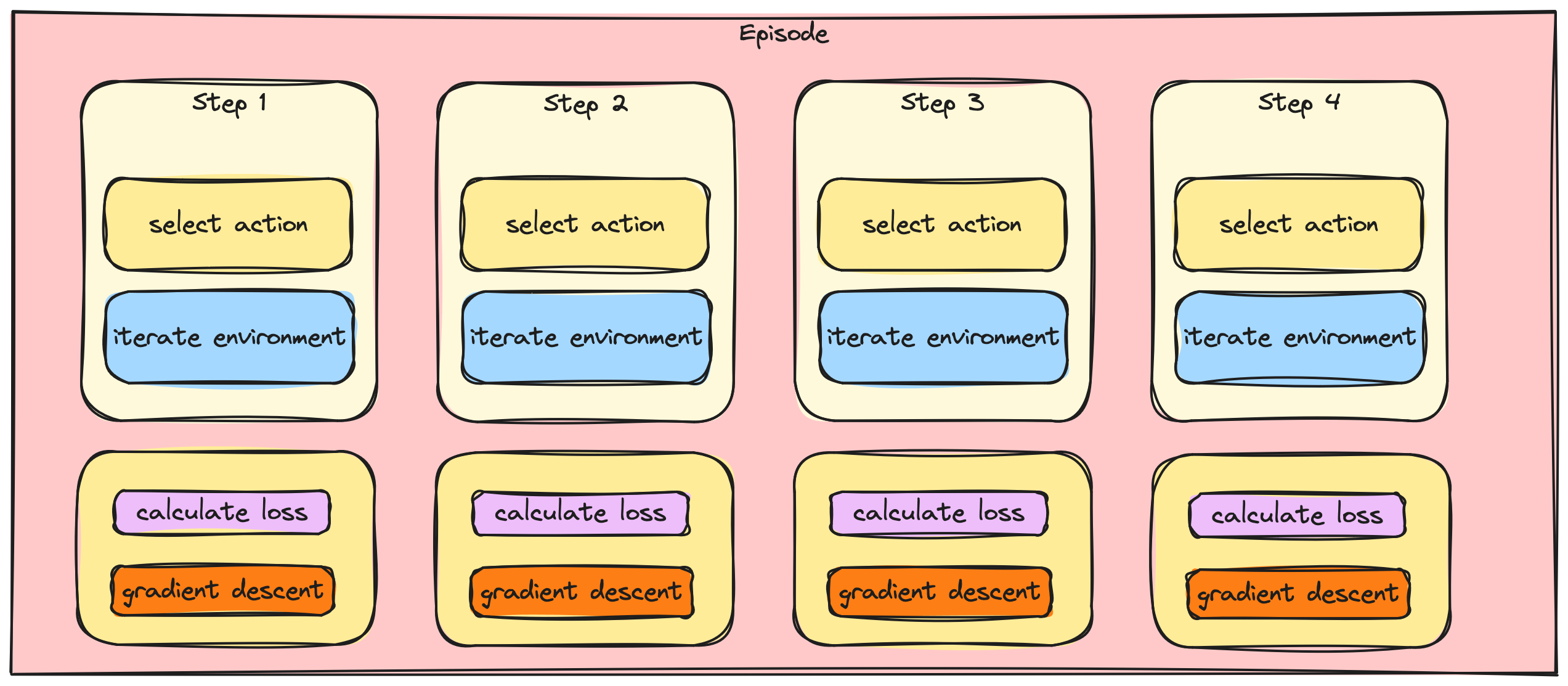

Stapsgewijze vs. batch-gradientupdates

Stapsgewijze vs. batch-gradientupdates

Stapsgewijze vs. batch-gradientupdates

Stapsgewijze vs. batch-gradientupdates

Stapsgewijze vs. batch-gradientupdates

Stapsgewijze vs. batch-gradientupdates

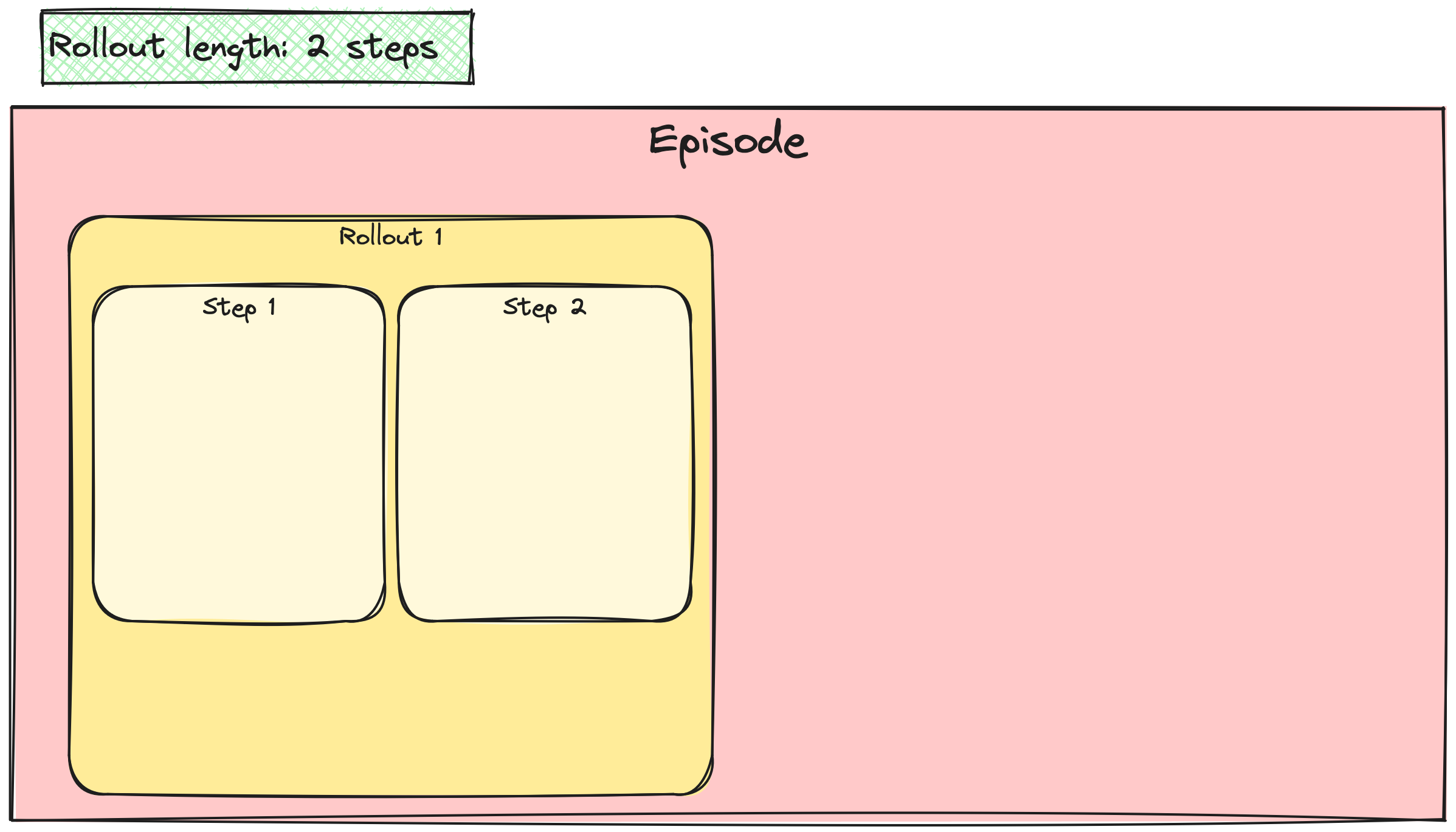

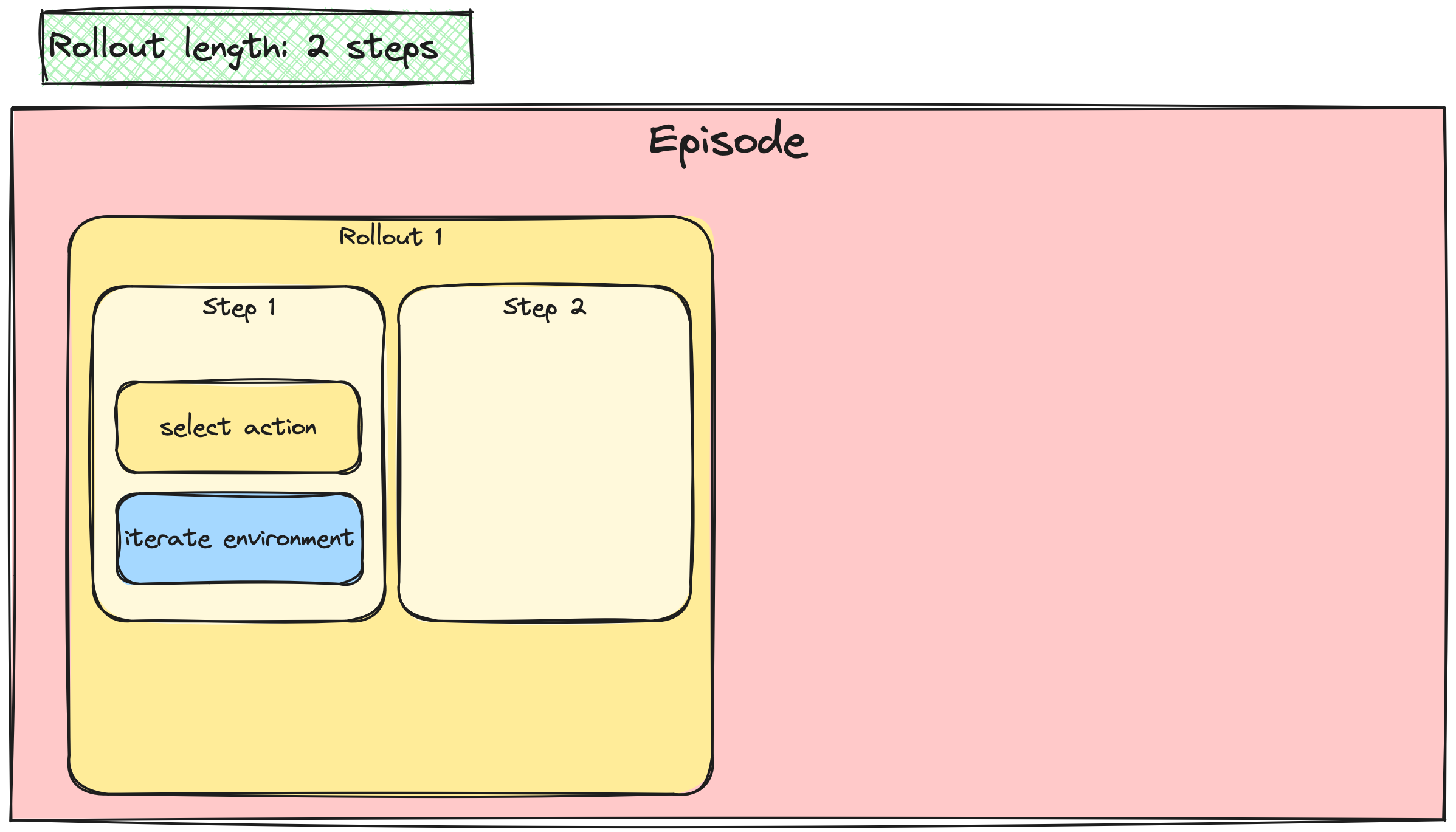

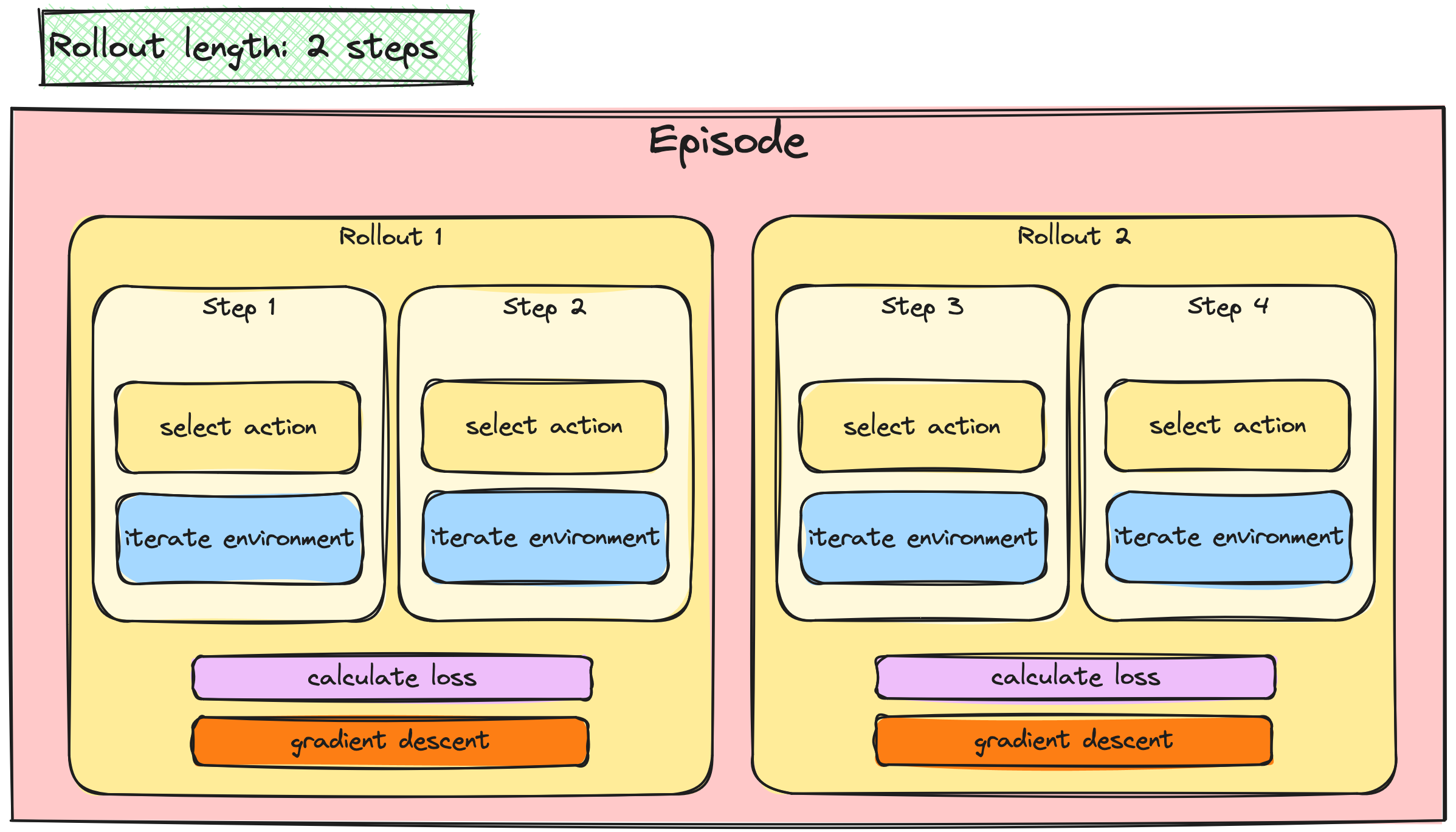

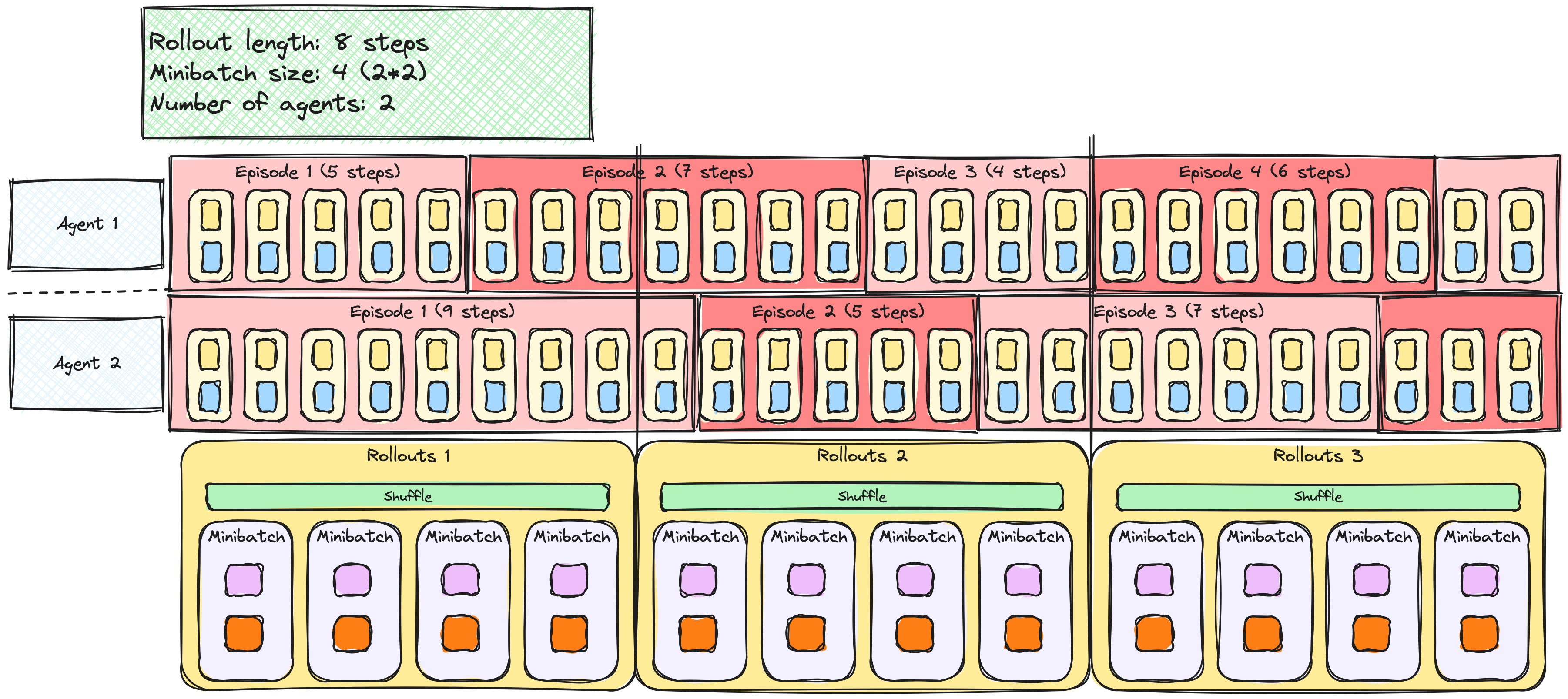

Batchen van A2C-/PPO-updates

Batchen van A2C-/PPO-updates

Batchen van A2C-/PPO-updates

Batchen van A2C-/PPO-updates

Batchen van A2C-/PPO-updates

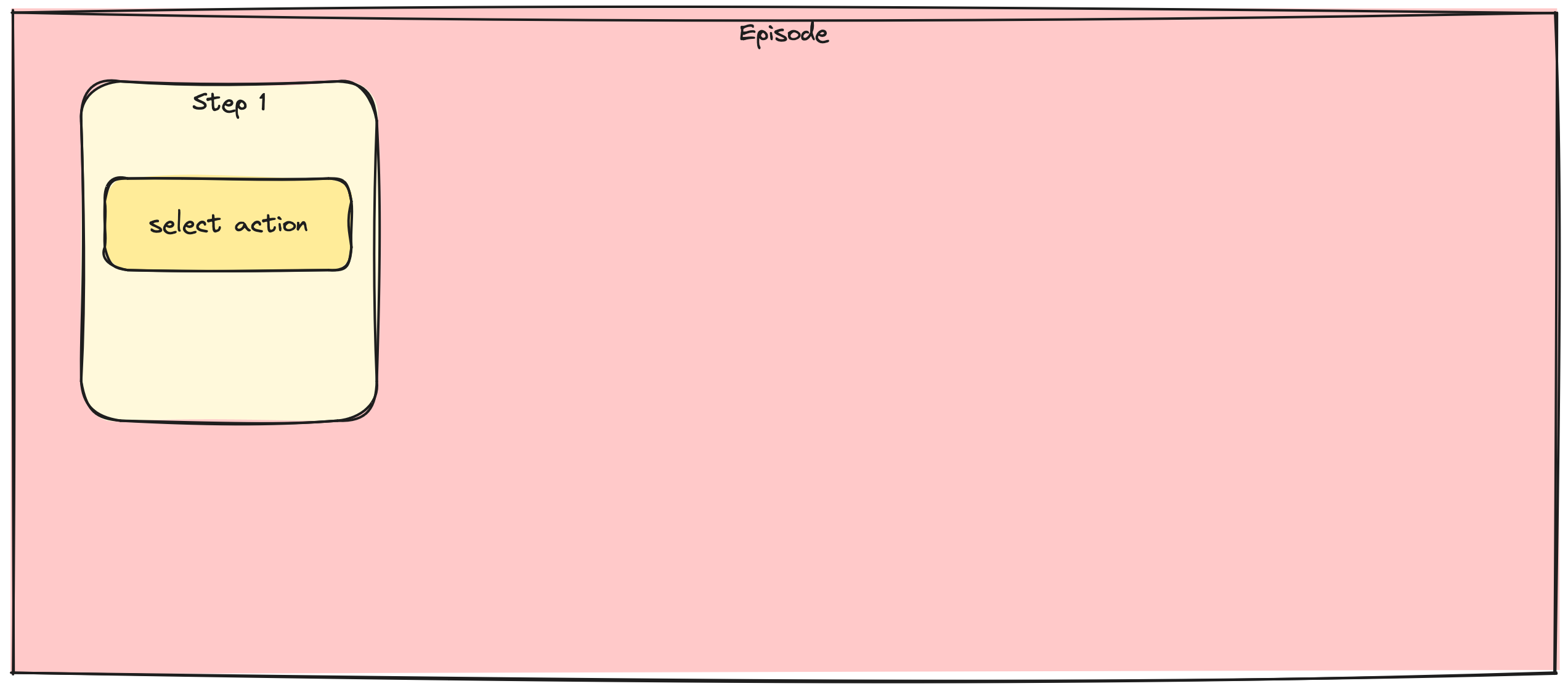

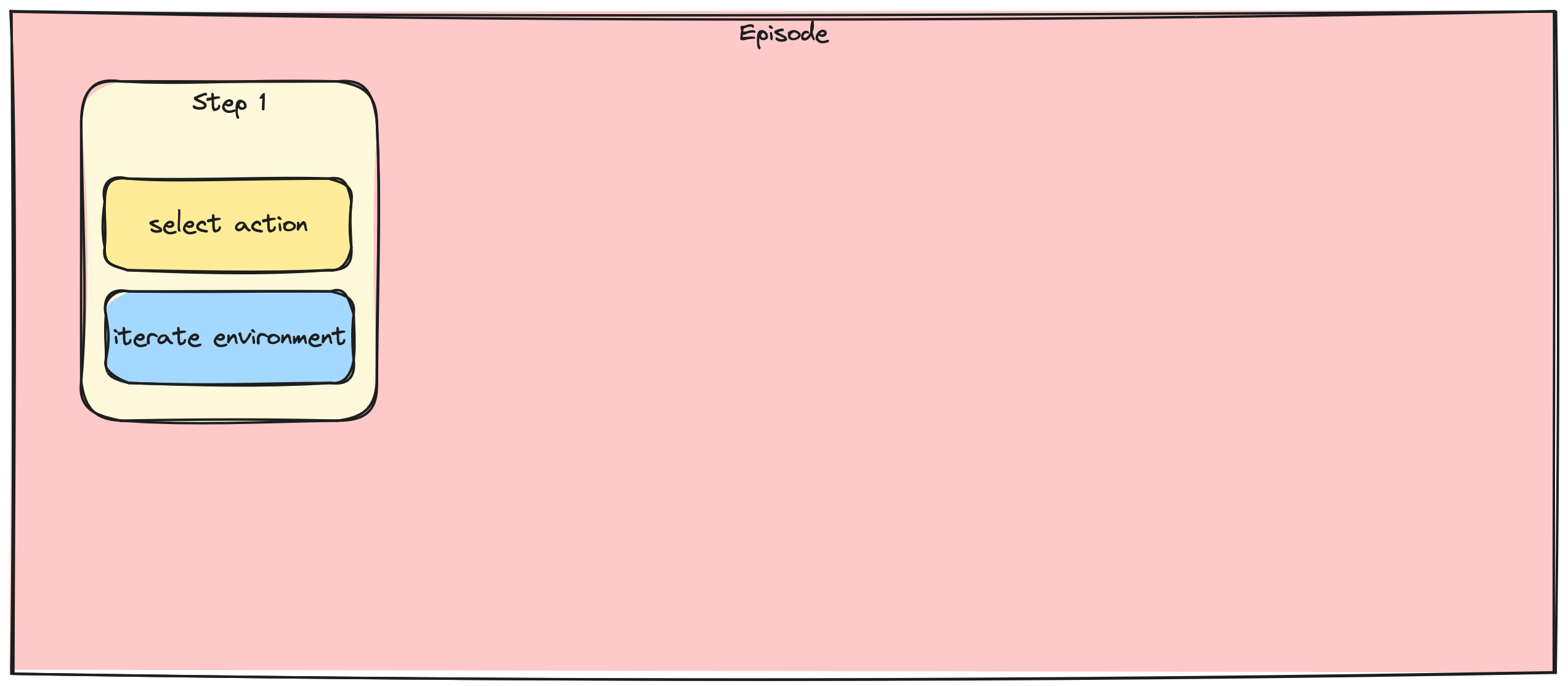

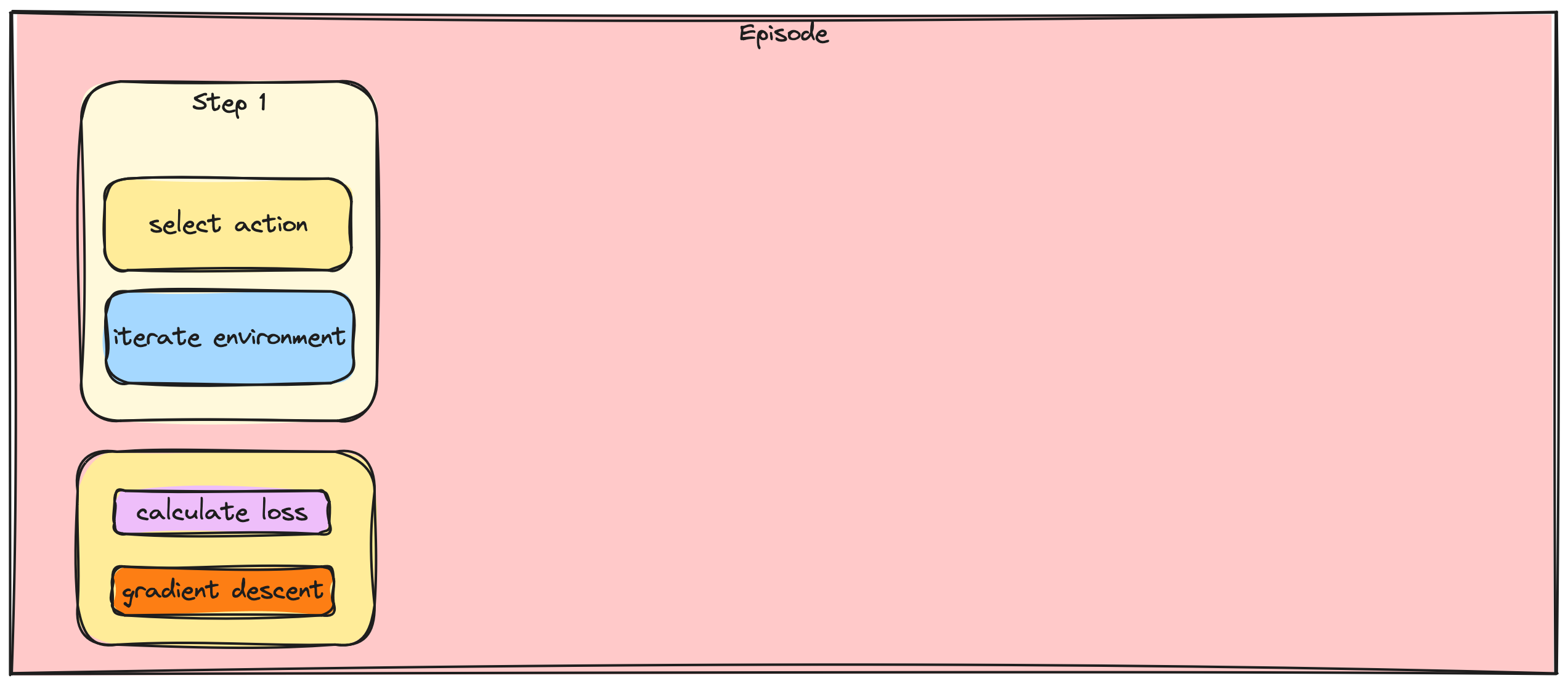

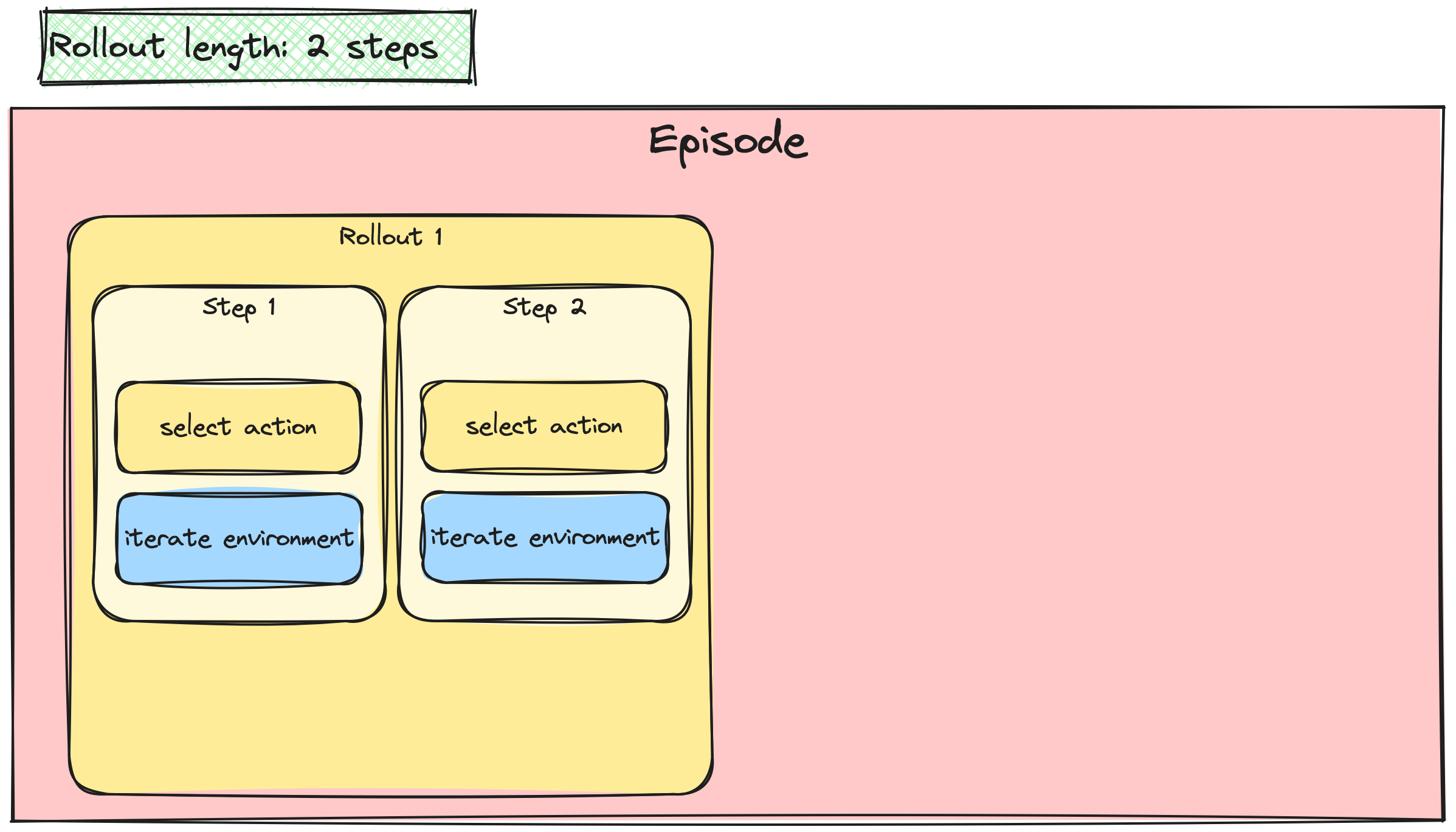

De A2C-trainingslus met batch-updates

# Set rollout length rollout_length = 10# Initiate loss batchesactor_losses = torch.tensor([]) critic_losses = torch.tensor([])

- Initialiseer verlies-batches

- Loop door episodes en stappen zoals gewoonlijk

for episode in range(10):

state, info = env.reset()

done = False

while not done:

action, action_log_prob = select_action(actor,

state)

next_state, reward, terminated, truncated, _ = (

env.step(action))

done = terminated or truncated

actor_loss, critic_loss = calculate_losses(

critic, action_log_prob,

reward, state, next_state, done)

...

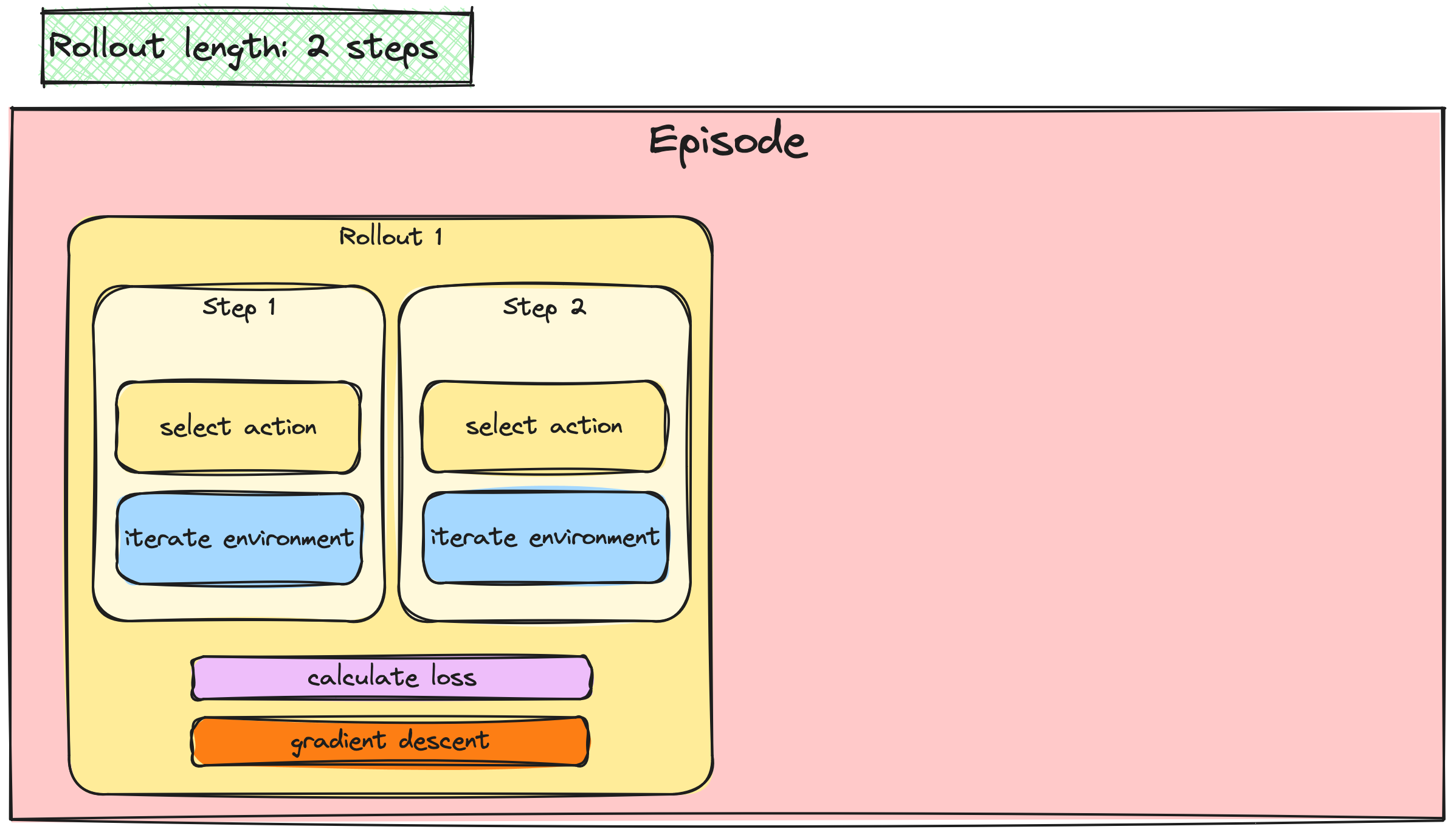

De A2C-trainingslus met batch-updates

... actor_losses = torch.cat((actor_losses, actor_loss)) critic_losses = torch.cat((critic_losses, critic_loss))# If rollout is full, update the networks if len(actor_losses) >= rollout_length:actor_loss_batch = actor_losses.mean() critic_loss_batch = critic_losses.mean()actor_optimizer.zero_grad() actor_loss_batch.backward() actor_optimizer.step() critic_optimizer.zero_grad() critic_loss_batch.backward() critic_optimizer.step()actor_losses = torch.tensor([]) critic_losses = torch.tensor([])state = next_state

- Voeg stapverlies toe aan de batches

- Als de rollout vol is:

- Neem het batchgemiddelde met

.mean() - Voer gradient descent uit

- Reset de verlies-batches

- Neem het batchgemiddelde met

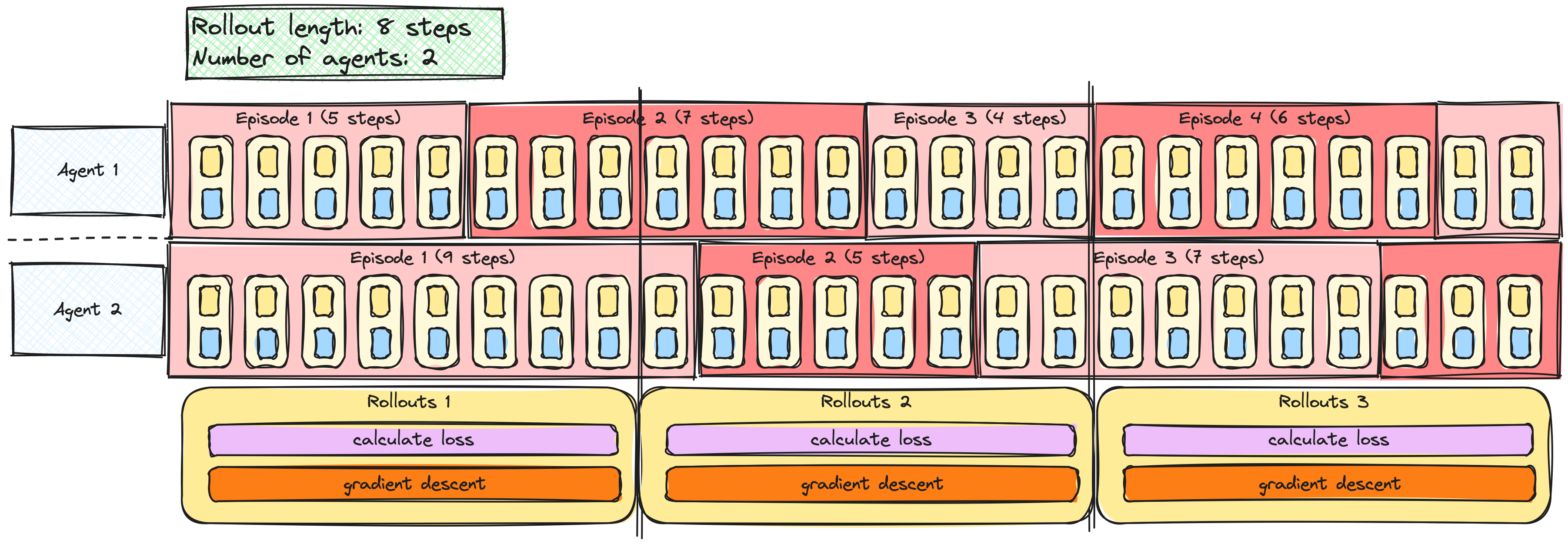

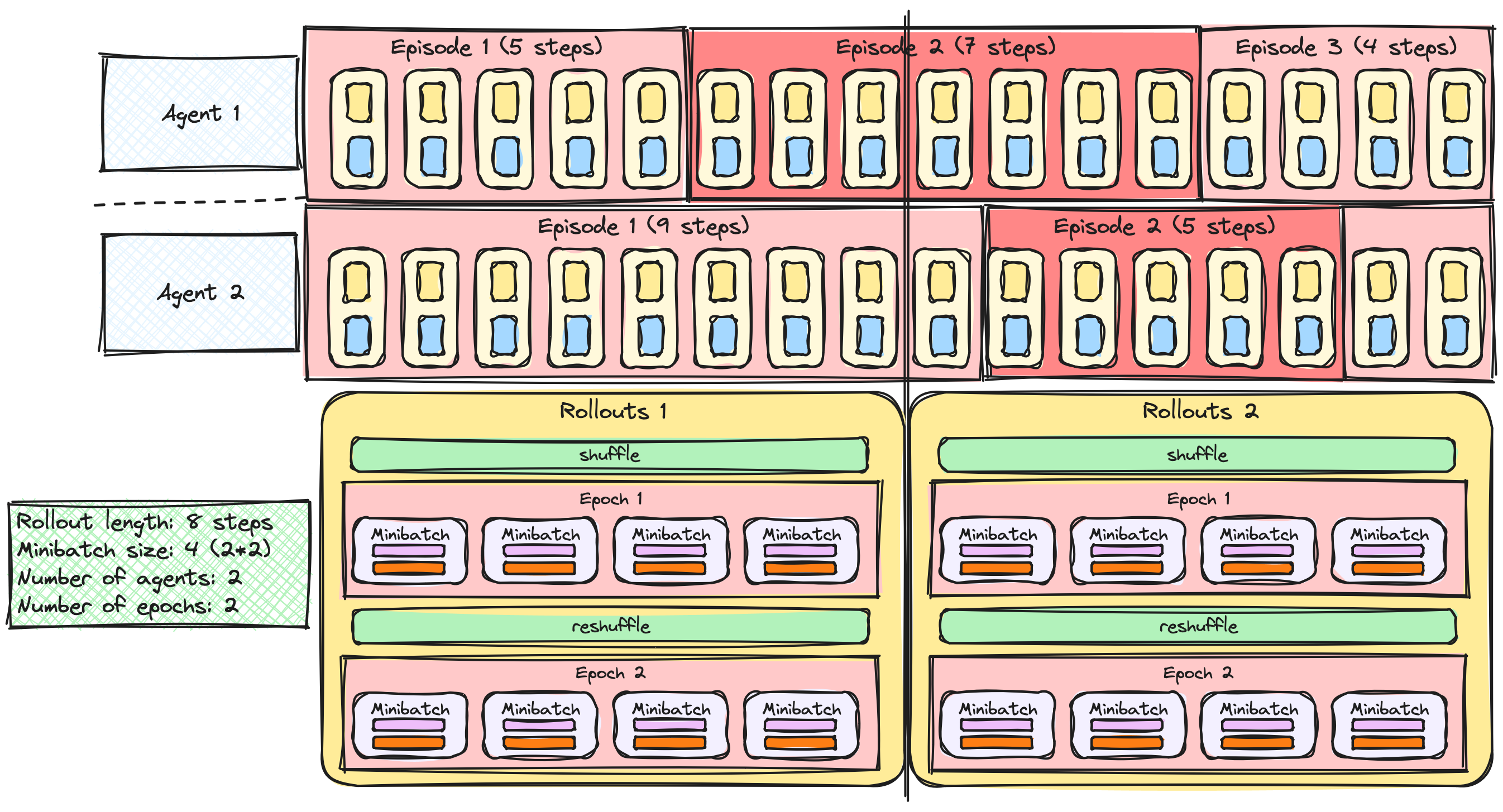

A2C/PPO met meerdere agents

Rollouts en minibatches

PPO met meerdere epochs

Laten we oefenen!

Deep Reinforcement Learning in Python