Entropiebonus en PPO

Deep Reinforcement Learning in Python

Timothée Carayol

Principal Machine Learning Engineer, Komment

Entropiebonus

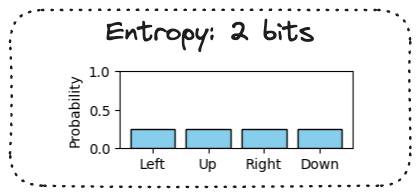

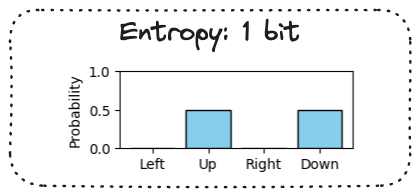

- Policy-gradientalgoritmen kunnen instorten tot deterministische policies

- Oplossing: voeg entropiebonus toe

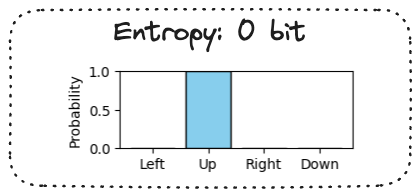

- Entropie meet de onzekerheid van een verdeling!

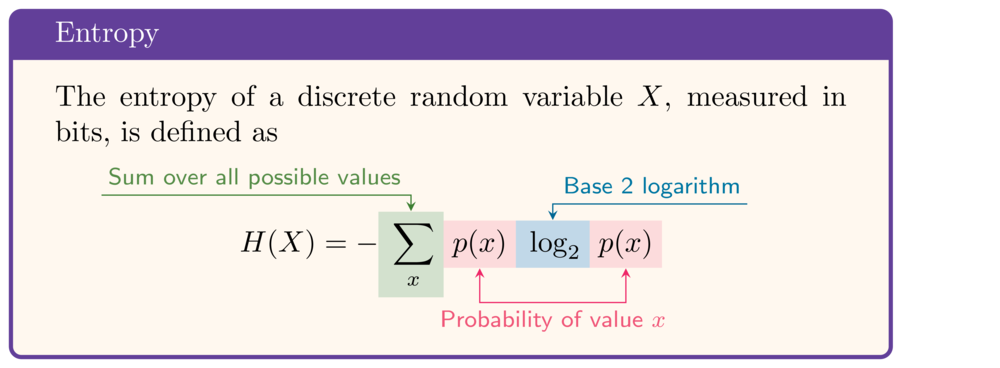

Entropie van een kansverdeling

- Als $\ln$ i.p.v. $\log_2$: resultaat gemeten in nats.

- $1\ nat = \frac{1}{\ln 2}\ bit \approx 1{,}44\ bit$

De entropiebonus implementeren

def select_action(policy_network, state): action_probs = policy_network(state) action_dist = Categorical(action_probs) action = action_dist.sample() log_prob = action_dist.log_prob(action)# Obtain the entropy of the policy entropy = action_dist.entropy()return (action.item(), log_prob.reshape(1), entropy)

- Actor loss:

actor_loss -= c_entropy * entropy - Let op:

Categorical.entropy()is in nats; deel doormath.log(2)voor bits

PPO-trainingslus

for episode in range(10):

state, info = env.reset()

done = False

while not done:

action, action_log_prob, entropy = select_action(actor, state)

next_state, reward, terminated, truncated, _ = env.step(action)

done = terminated or truncated

actor_loss, critic_loss = calculate_losses(critic, action_log_prob, action_log_prob,

reward, state, next_state, done)

actor_loss -= c_entropy * entropy

actor_optimizer.zero_grad(); actor_loss.backward(); actor_optimizer.step()

critic_optimizer.zero_grad(); critic_loss.backward(); critic_optimizer.step()

state = next_state

Naar PPO met batch-updates

- Updaten na elke stap: benut PPO-doelfunctie niet volledig

- Bij elke stap valt $\theta$ feitelijk samen met $\theta_{old}$.

- Volledige PPO-implementaties scheiden:

- Parameterupdates (minibatches)

- Policy-updates (rollouts)

Laten we oefenen!

Deep Reinforcement Learning in Python